一种手语交互辅助方法及系统

1.本发明涉及手语识别技术领域,特别涉及一种手语交互辅助方法及系统。

背景技术:

2.自计算机的不断普及和发展,越来越多的高新技术被开发并广泛应用于日常生活,同时人们的生活方式也随着高新技术的出现而获得巨大的改变。随着智能设备的研发渗透到生活的各个领域,人们与智能设备的互动较过往更加频繁。从过去的鼠标和键盘,发展到语音识别和动作识别,再到近年来新兴的一些带有虚拟现实、增强现实的穿戴设备,都体现出了人机交互技术不断发展。人机交互技术的不断发展也体现了当下各类行业市场对人机交互需求的不断增加。在服务业方面,关于智能导航系统,从过去的键盘、鼠标到触控板再到近年来的语音控制进行信息咨询,其发展正体现了现有人机交互技术发展的成熟程度。

3.但是,过去传统的键盘、鼠标这一类人机交互设备需要借助外部设备作为媒介,完成人对计算机以及智能系统的信息传达,依旧不够直接。而现有的语音识别、动作识别不需要借助其他设备就能实现与计算机进行信息传达,相较于前者就显得更为直观。其中,手势识别作为动作识别的一种,因其相较于语音识别不会对应用场所产生噪音,同时对比其他肢体的动作识别所占用的空间更小,因此手势识别潜在更高的研发价值。另外因手势识别更为直接,应用在智能导航系统中其更适用于聋哑及文化水平相对较低的对象。

4.虽然目前有部分智能导航系统载入了相对简单的基于神经网络的手势识别辅助系统,但是许多辅助系统存在需要长期维护更新的问题。

技术实现要素:

5.本发明实施例提供了一种手语交互辅助方法及系统,用以解决现有技术中辅助系统存在需要长期维护更新的问题。

6.一方面,本发明实施例提供了一种手语交互辅助方法,包括:

7.获取手语图像;

8.识别手语图像中的手语;

9.当无法识别手语图像中的手语时,获取用户手势在手语图像中的位置;

10.根据多张手语图像中用户手势的位置确定用户绘制的图形;

11.显示图形。

12.另一方面,本发明实施例提供了一种手语交互辅助系统,包括:

13.摄像头,用于获取手语图像;

14.手语识别模块,用于识别手语图像中的手语;

15.手势绘画模块,用于在无法识别手语图像中的手语时,获取用户手势在手语图像中的位置,根据多张手语图像中用户手势的位置确定用户绘制的图形,并显示图形。

16.本发明中的一种手语交互辅助方法及系统,具有以下优点:

17.可以对用户的手语进行识别,对于无法识别的手语可以通过隔空手绘的方式实现文字表达,基本可以做到系统免维护,不但方便了残障人士的使用,而且减少了系统维护成本。

附图说明

18.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

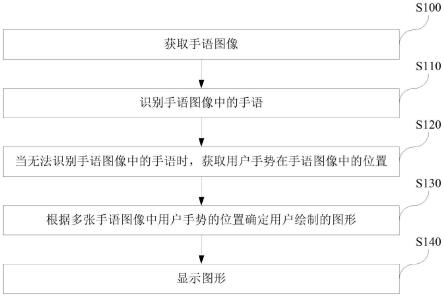

19.图1为本发明实施例提供的一种手语交互辅助方法的流程图;

20.图2为本发明实施例提供的图形用户界面的示意图;

21.图3为本发明实施例提供的摄像头成像界面的示意图。

具体实施方式

22.下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

23.图1为本发明实施例提供的一种手语交互辅助方法的流程图。本发明实施例提供了一种手语交互辅助方法,包括:

24.s100,获取手语图像。

25.示例性地,可以采用单目摄像头实时地采集手语图像。

26.s110,识别手语图像中的手语。

27.示例性地,可以使用预先训练好的对应手语的识别模型识别手语图像中的手语。在本发明的实施例中,该识别模型由卷积神经网络经过训练和测试得到。具体地,识别模型采用以下方法得到:采用训练数据集对卷积神经网络进行训练;采用测试数据集对训练后的卷积神经网络进行测试,获得识别模型。

28.而训练数据集和测试数据集均采用以下方法获得:获取背景图像;对背景图像进行预处理;将预处理后的背景图像与不同的手语表达图像进行组合,获得手语数据集。前述的训练数据集、测试数据集数据主要采自手语交互辅助方法及系统所投入使用对应特定场所的背景图像数据。

29.在实际应用时,可以利用单目摄像头对智能导航系统安装位置的背景图像进行采集,后对采集到的背景图像进行大量预处理,将预处理后背景图像与在空白幕布下不同的手语表达图像进行随机组合,快速生成手语数据集,训练数据集和测试数据集均选自手语数据集。然后通过远程服务器利用训练数据集对卷积神经网络进行训练,将训练后的卷积神经网络采用测试数据集进行性能测试,直到识别性能达到要求,测试完成的卷积神经网络即为识别模型。最后将识别模型传输至智能导航系统,并对原有的识别模型进行覆盖,以达到智能导航系统手语数据及时更新的效果,可以有效增强手语实时识别过程中的鲁棒性。

30.s120,当无法识别手语图像中的手语时,获取用户手势在手语图像中的位置。

31.示例性地,本发明将系统拆解为用户图形界面部分以及手势处理部分。用户图形界面如图2所示,左侧为静态手势识别、动态手势识别、手势画板、可识别手势预览和系统使用说明按钮,右侧为摄像头成像情况和识别结果对话框。用户可以通过近距离点击或隔空操作的方式选择左侧功能按钮中的任意一个,选择静态手势识别或动态手势识别可以对用户的静态手势或动态手势进行识别,用户做出的手语或手势可以在摄像头成像情况对话框中显示,而识别的手语或手势则可以在识别结果对话框中显示。

32.因此,s110中的识别手语图像中的手语包括对静态手势的识别以及对动态手势的识别。静态手势也可称为手语。关于静态手势识别,由于系统在设计过程中考虑到能够翻译多种不同手语标准的手语,因此在点击图2所示的“静态手势识别”功能按钮后,会弹出“识别手语类型”子程序窗口,窗口有“中国手语数字0~9”、“国际手语数字0~9”以及“手势预览”这三个功能按钮。其中点击“中国手语数字0~9”、“国际手语数字0~9”会出现一个静态手势识别的子程序弹窗,而点击“手势预览”则可以浏览到前述两个手势识别可识别到的手势。关于动态手势识别,可利用公开的20bn-jester手语视频数据集,能够搭载左扫、右扫、缩小、放大等一些日常手语,可被应用于对智能导航系统的功能控制。

33.关于手势画板,用户可以通过手指隔空对计算机的画板进行书写、绘画。点击“手势画板”功能按钮后,会弹出“手势画板”的一个由opencv读取的能够实时检测手势位置的画板,画板上有三种画笔颜色和一个擦除功能可供选择。实时手势位置检测借助的是mediapipe函数包,预先读取食指在摄像头中的成像位置,利用该点位结合opencv中的图像绘制实现隔空手势绘制文字表达。在点击图2所示的“手势画板”功能按钮后,先让一只手能在屏幕中被检测到,后根据手势不同进行绘画。伸出食指时为“绘画模式”,食指、中指同时伸出时为“移动选择模式”,在“移动选择模式”下可以移动手势位置去其他区域或者根据需求选择需要用到的工具。

34.s130,根据多张手语图像中用户手势的位置确定用户绘制的图形。

35.示例性地,通过对用户手势中特定手指,例如食指位置的持续跟踪,可以记录手指的移动轨迹,该轨迹即表示用户绘制的图形。

36.s140,显示图形。

37.示例性地,显示用户绘制的图形后可方便其他人员对使用者所要表述的信息进行解读,例如工作人员等了解用户要表达的信息及诉求。

38.本发明实施例还提供了一种手语交互辅助系统,该系统包括:

39.摄像头,用于获取手语图像;

40.手语识别模块,用于识别手语图像中的手语;

41.手势绘画模块,用于在无法识别手语图像中的手语时,获取用户手势在手语图像中的位置,根据多张手语图像中用户手势的位置确定用户绘制的图形,并显示图形。

42.示例性地,还包括:摄像头检视模块,用于检视摄像头是否已经接入计算机或是否有损坏。在系统提供的用户图形界面中,还具有摄像头功能检视操作按钮,点击该操作按钮后可以检视摄像头的工作状态,包括是否接入计算机或是否存在损坏。

43.点击摄像头功能检视操作按钮后,摄像头成像情况和识别结果对话框显示的情况有四种,分别为图3中的a、b、c和d所示。当未开启摄像头时,识别结果对话框会显示“未开启

摄像头”。若摄像头成像情况对话框能够出现成像画面且识别结果对话框显示“摄像头已开启,功能正常”,则摄像头正常。关闭功能按钮后,识别结果对话框显示“摄像头检视正常,可进行其他操作”,则可使用接下来的其他功能。反之若计算机本身并没有自带摄像头或通过i/o口接入摄像头,摄像头成像情况对话框将不会出现画面,且弹出“请检查相机于电脑是否连接正确”的提示信息。

44.本发明的系统还包括:手势预览模块,用于响应用户的操作展示可识别的手势。

45.尽管已描述了本发明的优选实施例,但本领域内的技术人员一旦得知了基本创造性概念,则可对这些实施例做出另外的变更和修改。所以,所附权利要求意欲解释为包括优选实施例以及落入本发明范围的所有变更和修改。

46.显然,本领域的技术人员可以对本发明进行各种改动和变型而不脱离本发明的精神和范围。这样,倘若本发明的这些修改和变型属于本发明权利要求及其等同技术的范围之内,则本发明也意图包含这些改动和变型在内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1