一种基于保留因子剪枝的生成对抗网络模型的压缩方法与流程

1.本发明属于人工智能技术领域,具体涉及一种基于保留因子剪枝的生成对 抗网络模型的压缩方法。

背景技术:

2.近年来,随着人工智能的快速发展,神经网络迅速在计算机视觉、自然语 言处理、模式识别等多个领域应用开来。alex krizhevsky等人设计出alexnet神经网络在百万数量级的imagenet图片集上取得突破性成绩,对近年来神经 网络的发展产生广泛的影响。alexnet包含超过6000万个浮点运算,处理一张 长宽均为224像素的彩色图像需要进行超过十亿次的浮点运算。随后发展的 vgg-16神经网络进一步提升了在imagenet数据集上预测准确率,却是一个网 络模型大小超过500m,单次预测需要超过280亿次浮点运算的庞然大物。人 们对预测准确率的追求,催生出了网络层数高达1001层的resnet神经网络。 神经网络的快速发展离不开gpu显卡强大的并行计算能力。现主流的gpu显 卡功耗为275w,相当于270秒钟耗尽一部iphone x的电池。高功耗也带来额 外散热系统的电量消耗。计算能力、高功耗等瓶颈限制了神经网络应用至更多 资源受限的设备中,例如手机、嵌入式硬件等设备。这些设备因为电池容量或 者计算能力的苛刻限制等原因无法承受这些强力的神经网络。此外,生成对抗 网络(generative adversarial networks,gans)在图像处理领域大放异彩,在 图像生成有着诸多有趣的应用,例如图像处理、图像编辑、风格迁移、超分辨 率等,而这些应用已经逐渐渗透至人们的娱乐生活中。然而gans相比于传统 卷积神经网络(convolutional neural networks,cnn),在计算量和参数量更是 上了一个台阶。例如,经典的cyclegan对于处理输入256*256大小的图片, 需要超过56.8g macs(multiply-accumulate operations),计算量是resnet-50 的13倍;另外一个经典的pix2pix网络,需要54.4m的参数量,接近2倍 resnet-50的参数量。因此,如何获得一个轻量的生成对抗网络模型也是亟待 解决的事情。

3.综上所述,现有技术的对抗网络模型往往参数量过多,计算量庞大,导致 运算效率低下。

技术实现要素:

4.本发明实施例的目的是提供一种基于保留因子剪枝的生成对抗网络模型 的压缩方法,能够解决现有技术的对抗网络模型往往参数量过多,计算量庞大, 导致运算效率低下的技术问题。

5.为了解决上述技术问题,本发明是这样实现的:

6.第一方面:

7.本发明实施例提供了一种基于保留因子剪枝的生成对抗网络模型的压缩 方法,包括:

8.s101:给定预训练教师生成对抗网络模型和待压缩学生对抗网络模型,预 训练教

师生成对抗网络模型包括教师生成器和教师判别器,待压缩学生对抗网 络模型包括学生生成器和学生判别器;

9.s102:为学生生成器的每个卷积核设置一个可学习的保留因子,根据边界 参数,将保留因子转换成对应的卷积核的参与前向运算比例;

10.s103:通过对保留因子添加约束条件和收缩边界参数,确定参与前向运算 比例为零的卷积核;

11.s104:移除参与前向运算比例为零的卷积核,获得轻量的学生生成器;

12.s105:根据教师生成器和教师判别器中的知识,对学生生成器进行微调训 练;

13.s106:移除学生判别器,保留学生生成器,部署学生对抗网络模型。

14.第二方面:

15.本发明实施例提供了一种基于保留因子剪枝的生成对抗网络模型的压缩 装置,包括:

16.给定模块,用于给定预训练教师生成对抗网络模型和待压缩学生对抗网络 模型,预训练教师生成对抗网络模型包括教师生成器和教师判别器,待压缩学 生对抗网络模型包括学生生成器和学生判别器;

17.设置模块,用于为学生生成器的每个卷积核设置一个可学习的保留因子, 根据边界参数,将保留因子转换成对应的卷积核的参与前向运算比例;

18.确定模块,用于通过对保留因子添加约束条件和收缩边界参数,确定参与 前向运算比例为零的卷积核;

19.移除模块,用于移除参与前向运算比例为零的卷积核,获得轻量的学生生 成器;

20.训练模块,用于根据教师生成器和教师判别器中的知识,对学生生成器进 行微调训练;

21.部署模块,用于移除学生判别器,保留学生生成器,部署学生对抗网络模 型。

22.在本发明实施例中,为学生生成器的每个卷积核设置一个可学习的保留因 子,根据边界参数,将保留因子转换成对应的卷积核的参与前向运算比例,通 过对保留因子添加约束条件和收缩边界参数,确定参与前向运算比例为零的卷 积核,并对其进行剪枝,去除不必要的卷积核。降低参数量,减少计算量,提 高运算效率。

附图说明

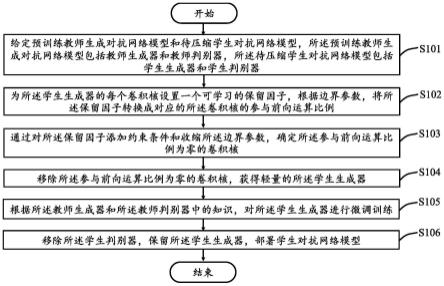

23.图1是本发明实施例提供的一种基于保留因子剪枝的生成对抗网络模型的 压缩方法的流程示意图。

24.本发明目的的实现、功能特点及优点将结合实施例、参照附图做进一步说 明。

具体实施方式

25.为使本发明的目的、技术方案和优点更加清楚,下面将结合本发明实施例 中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描 述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实 施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实 施例,都属于本发明保护的范围。

26.下面结合附图,通过具体的实施例及其应用场景对本发明实施例提供一种 生成

对抗网络模型的压缩方法以及压缩装置进行详细地说明。

27.实施例一

28.参照图1,示出了本发明实施例提供的一种基于保留因子剪枝的生成对抗 网络模型的压缩方法的流程示意图。

29.本发明实施例提供的一种基于保留因子剪枝的生成对抗网络模型的压缩 方法,包括:

30.s101:给定预训练教师生成对抗网络模型和待压缩学生对抗网络模型,预 训练教师生成对抗网络模型包括教师生成器和教师判别器,待压缩学生对抗网 络模型包括学生生成器和学生判别器。

31.s102:为学生生成器的每个卷积核设置一个可学习的保留因子,根据边界 参数,将保留因子转换成对应的卷积核的参与前向运算比例。

32.在一种可能的实施方式中,s102具体包括:

33.s1021:通过公式1将保留因子转换成对应的卷积核的参与前向运算比例:

[0034][0035]

其中,p

ij

表示保留因子,b表示边界,ij表示第i层卷积层的第j个卷积核,m

ij

表示参与前向运算比例。

[0036]

s103:通过对保留因子添加约束条件和收缩边界参数,确定参与前向运算 比例为零的卷积核。

[0037]

其中,在训练过程中不断对保留因子添加约束条件,使得其转换成参与前 向运算比例不断逼近为零。

[0038]

具体地,添加约束条件是指添加保留因子的绝对值至优化目标函数中。

[0039]

其中,在训练过程中不断收缩边界b,可以使得可变区域变小直至为零, 此时m

ij

变成一个非零即一的阶跃函数。

[0040]

在一种可能的实施方式中,s103具体包括:

[0041]

s1031:将卷积核的输出由o

ij

转变为o

′

ij

:

[0042]o′

ij

=m

ij

*o

ij

ꢀꢀꢀ

公式2 其中,o

ij

表示卷积核原始输出,o

′

ij

表示卷积核真实输出。

[0043]

在一种可能的实施方式中,s103具体包括:

[0044]

s1032:通过公式3对保留因子添加约束条件,使得参与前向运算比例不 断趋近于零,保留因子向边界靠齐:

[0045][0046]

s1033:通过公式4对边界参数进行收缩,将边界参数不断变小直至为零:

[0047][0048]

其中,e表示当前迭代次数,e表示全部迭代次数。

[0049]

s104:移除参与前向运算比例为零的卷积核,获得轻量的学生生成器。

[0050]

可选地,可以预先设置训练次数,在达到预先设置的训练次数时,停止对 于参与前向运算比例为零的卷积核进行剪枝。

[0051]

s105:根据教师生成器和教师判别器中的知识,对学生生成器进行微调训 练。

[0052]

在一种可能的实施方式中,s105具体包括:

[0053]

s1051:对于第i层特征图oi,逐通道相加得到第i层特征图oi的注意力图:

[0054][0055]

s1052:提取教师生成器g

t

和教师判别器中的注意力图并进行融合得到:

[0056][0057]

其中,g

t

表示教师生成器,d

t

表示教师判别器,表示融合注意力图;

[0058]

s1053:学生生成器模仿提取的融合注意力图得到对应的优化目标为:

[0059][0060]

s1054:将学生生成器生成的图像作为输入,在教师判别器的最后一层卷 积中进行输出,以逼近教师生成器生成的图片,对应的优化目标为:

[0061][0062]

其中,表示返回教师判别器的最后一层卷积输出;

[0063]

s1055:确定学生生成器的优化目标为:

[0064][0065]

其中,是生成对抗网络基本的损失函数,α、β和γ是超参数,用于 平衡不同损失项。

[0066]

s106:移除学生判别器,保留学生生成器,部署学生对抗网络模型。

[0067]

在本发明实施例中,为学生生成器的每个卷积核设置一个可学习的保留因 子,根据边界参数,将保留因子转换成对应的卷积核的参与前向运算比例,通 过对保留因子添加约束条件和收缩边界参数,确定参与前向运算比例为零的卷 积核,并对其进行剪枝,去除不必要的卷积核。降低参数量,减少计算量,提 高运算效率。

[0068]

进一步地,本发明实施例还提供一种仿真实验,以验证本发明提供的生成 对抗网络的压缩方法的优越性。

[0069]

仿真条件:本发明在gtx 1080ti gpu环境上进行开发,开发的深度学习 框架基于pytorch。本发明中主要用的语言为python。

[0070]

仿真内容:我们使用cyclegan在未配对(unpaired)的数据集horse2zebra 和summer2winter上进行实验,所有输入图像的大小都被调整为256

×

256像 素大小用于训练。我们使用fid(frechet inception distance)来评估生成图像 的质量,fid数值越低说明生成图像质量越接近原始图像。另外,我们还在图 像到图像的翻译任务上进行了实验,我们使用经典的pix2pix模型来翻译成对 图像,分别在edges2shoes和cityscapes数据集

上进行实验,所有图像被调整 为256

×

256像素用于训练。对于edge2shoes数据集,我们仍然使用fid指标 评价生成图像质量的好坏。对于cityscpes数据集,我们通过运行drn-d-105 来计算平均交并比(mean intersection over union,miou)以评估生成图像的 质量,分数越高表示图像生成性能越好。经过大量实验验证,均证明了我们提 出方法的有效性和先进性。

[0071]

参照表1,表1示出了本发明实施例提供的一种基于pix2pix模型各压缩 方法压缩效果对照表。

[0072]

表1

[0073][0074]

参照表2,表2示出了本发明实施例提供的一种基于cyclegan模型各压 缩方法压缩效果对照表。

[0075]

表2

[0076][0077]

实施例二

[0078]

本发明实施例提供的一种基于保留因子剪枝的生成对抗网络模型的压缩 装置,包括:

[0079]

本发明实施例提供的一种基于保留因子剪枝的生成对抗网络模型的压缩 装置20,包括:

[0080]

给定模块201,用于给定预训练教师生成对抗网络模型和待压缩学生对抗 网络模型,预训练教师生成对抗网络模型包括教师生成器和教师判别器,待压 缩学生对抗网络模型包括学生生成器和学生判别器;

[0081]

设置模块202,用于为学生生成器的每个卷积核设置一个可学习的保留因 子,根据边界参数,将保留因子转换成对应的卷积核的参与前向运算比例;

[0082]

确定模块203,用于通过对保留因子添加约束条件和收缩边界参数,确定 参与前向运算比例为零的卷积核;

[0083]

移除模块204,用于移除参与前向运算比例为零的卷积核,获得轻量的学 生生成器;

[0084]

训练模块205,用于根据教师生成器和教师判别器中的知识,对学生生成 器进行微调训练;

[0085]

部署模块206,用于移除学生判别器,保留学生生成器,部署学生对抗网 络模型。

[0086]

可选地,设置模块202具体包括:

[0087]

转换子模块,用于通过公式1将保留因子转换成对应的卷积核的参与前向 运算比例:

[0088][0089]

其中,p

ij

表示保留因子,b表示边界,ij表示第i层卷积层的第j个卷积核,m

ij

表示参与前向运算比例。

[0090]

可选地,确定模块203具体包括:

[0091]

转变子模块,用于将卷积核的输出由o

ij

转变为o

′

ij

:

[0092]o′

ij

=m

ij

*o

ij

ꢀꢀꢀ

公式2 其中,o

ij

表示卷积核原始输出,o

′

ij

表示卷积核真实输出。

[0093]

可选地,确定模块203具体包括:

[0094]

约束子模块,用于通过公式3对保留因子添加约束条件,使得参与前向运 算比例不断趋近于零,保留因子向边界靠齐:

[0095][0096]

收缩子模块,用于通过公式4对边界参数进行收缩,将边界参数不断变小 直至为零:

[0097][0098]

其中,e表示当前迭代次数,e表示全部迭代次数。

[0099]

可选地,训练模块205具体包括:

[0100]

相加子模块,用于对于第i层特征图oi,逐通道相加得到第i层特征图oi的 注意力图:

[0101][0102]

提取子模块,用于提取教师生成器g

t

和教师判别器中的注意力图并进行 融合得到:

[0103][0104]

其中,g

t

表示教师生成器,d

t

表示教师判别器,表示融合注意力图;

[0105]

模仿子模块,用于学生生成器模仿提取的融合注意力图得到对应的优 化目标为:

[0106][0107]

输出子模块,用于将学生生成器生成的图像作为输入,在教师判别器的最 后一层卷积中进行输出,以逼近教师生成器生成的图片,对应的优化目标为:

[0108][0109]

其中,表示返回教师判别器的最后一层卷积输出;

[0110]

确定子模块,用于确定学生生成器的优化目标为:

[0111][0112]

其中,是生成对抗网络基本的损失函数,α、β和γ是超参数,用于 平衡不同损失项。

[0113]

本发明实施例提供的数据监控装置20能够实现上述方法实施例中实现的 各个过程,为避免重复,这里不再赘述。

[0114]

在本发明实施例中,为学生生成器的每个卷积核设置一个可学习的保留因 子,根据边界参数,将保留因子转换成对应的卷积核的参与前向运算比例,通 过对保留因子添加约束条件和收缩边界参数,确定参与前向运算比例为零的卷 积核,并对其进行剪枝,去除不必要的卷积核。降低参数量,减少计算量,提 高运算效率。

[0115]

本发明实施例中的虚拟装置可以是装置,也可以是终端中的部件、集成电 路、或芯片。

[0116]

以上所述仅为本发明的实施例而已,并不用于限制本发明。对于本领域技 术人员来说,本发明可以有各种更改和变化。凡在本发明的精神和原理之内所 作的任何修改、等同替换、改进等,均应包含在本发明的权利要求范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1