一种支持可变时长的视觉注意力动态预测方法和系统

1.本发明涉及计算机视觉技术领域,具体涉及一种支持可变时长的视觉注意力动态预测方法和系统。

背景技术:

2.在视觉注意力预测结果的可视化方面,现有关于静态图像的视觉注意力预测结果表示均为静态,例如cn101493890b的中国发明专利提出了基于特征的动态视觉注意区域提取方法,该方法将一段时长的视觉注意分布利用有效编码原理,为图片上每个特征衡量增量编码长度指标,连续的采样,从而不同帧的数据可以一起指导显著度的处理。但是最终显示结果仍以静态预测图表现,没有考虑真实人眼的视觉注意是连续动态随时间变化且前后连贯,没有做出可变时长的动态预测。

3.在视觉注意力评估人群方面,现有的视觉注意力预测技术所用数据集多为单一人群,未细分用户且预测结果唯一。例如cn114170537a的中国发明专利通过构建多模态模型得出固定视觉兴趣区域,单一结果视觉注意力预测结果并没有考虑人的个体差异,热点图区域代表一个用户结果,未在研究人群方面做出一定细分,也没有展现不同用户之间的差异,无法模拟个体差异。例如cn114092900a的中国发明专利公开了一种驾驶员视觉注意力预测方法,针对驾驶场景中驾驶员这一单一群体用户进行视觉注意力预测,再如cn111951637a的中国发明专利公开了一种任务情景相关联的无人机飞行员视觉注意力分配模式提取方法,针对无人机飞行员进行视觉注意力预测,涵盖人群单一,同一用户群体的个体未做区分,预测结果固定唯一。

技术实现要素:

4.鉴于上述,本发明的目的是提供一种支持可变时长的视觉注意力动态预测方法和系统,通过预测用户注视点的动态变化,并将动态变化融合形成视频进行可视化呈现。

5.为实现上述发明目的,实施例提供的一种支持可变时长的视觉注意力动态预测方法,包括以下步骤:

6.步骤1,采集多年龄段用户注视静态图像的注视点状态图序列;

7.步骤2,对静态图像进行特征拆分和合并得到低分辨率图,基于低分辨率图得到对应的高分辨率图;

8.步骤3,基于注视点状态图确定注视点遮罩,将注视点状态图的注视点遮罩位置替换为高分辨图,其余位置替换为低分辨率图,以得到注视点增强的动态视觉注视点序列;

9.步骤4,采用动态视觉注视点序列和静态图像对包含生成器和鉴别器的gail模型进行训练以优化模型参数;

10.步骤5,将待预测的静态图像输入至参数优化的生成器中,利用生成器预测输出表示视觉注意力的视觉注视点图像序列;

11.步骤6,根据用户指定的可变时长,将视觉注视点图像序列融合成标注有视觉注意

力的视频。

12.优选地,步骤1中,首先根据年龄阶段对用户群体进行细分,并将采用眼动仪记录用户在不同任务驱动下的动态眼动数据,即得到的注视点状态图序列。

13.优选地,在采集注视点状态图序列时,图像与图像之间留有至少5s的空白时间,以避免对原先注意过的物体或者位置存在反应上的延迟。

14.优选地,步骤2中,将静态图像在颜色、强度和方向三个维度特征上分解后,将三个维度特征进行叠加得到低分辨率图。

15.优选地,步骤2中,采用超分辨率重建算法srcnn将低分辨率图转换为对应的高分辨率图。

16.优选地,步骤3中,所述基于注视点状态图确定注视点遮罩,包括:将注视点状态图在空间离散为网格,将注视点所在网格作为注视点遮罩;

17.步骤3中,采用以下公式得到注视点增强的动态视觉注视点序列:

18.b

t+1

=m

t

⊙

h+(1-m

t

)

⊙bt

19.b0=l

20.其中,b

t

和b

t+1

分辨表示第t个和第t+1个注视点状态图,l表示低分辨率图,b0表示初始注视点状态图,h表示高分辨率图,m

t

表示根据第t个注视点状态图确定的注视点遮罩,

⊙

符号表示哈达玛积。

21.优选地,gail模型中,生成器接收静态图像并生成预测的视觉注视点图像序列,输入的静态图像作为状态,预测的视觉注视点图像序列作为预测动作,针对静态图像采集的注视点状态图序列作为真实动作,状态与预测动作形成假数据,状态与真实动作形成真数据,判别器接收假数据和真数据并输出对假数据和真数据的辨别结果,每次鉴别器做出错误判别时,生成器的假数据都会得到奖励,使假数据更有可能在将来生成。

22.优选地,步骤6中,当视觉注视点图像序列包含t个视觉注视点图像,用户指定的可变时长为s时,根据可变时长和预设帧率计算融合所需帧数f,融合第0个视觉注视点图像至t-f个视觉注视点图像为一帧,融合第1视觉注视点图像至第t-f+1为个视觉注视点图像一帧,以此类推,直至第f个视觉注视点图像至第t个视觉注视点图像融合为最后一帧,且注视点采用圆形散点可视化,合成帧数为f、时长为s的视频画面。

23.为实现上述发明目的,实施例还提供了一种支持可变时长的视觉注意力动态预测系统,包括前端显示器和后端服务器,其中,前端显示器利用electron和react技术完成桌面应用配置,后端服务器存储有上述支持可变时长的视觉注意力动态预测方法构建的参数优化的gail模型;

24.后端服务器接收用户输入的静态图像,调用参数优化的gail模型,利用参数优化的生成器预测输出表示视觉注意力的视觉注视点图像序列;然后根据用户指定的可变时长,将视觉注视点图像序列融合成标注有视觉注意力的视频;

25.前端显示器对标注有视觉注意力的视频进行可视化呈现。

26.与现有技术相比,本发明具有的有益效果至少包括:

27.在构建样本数据时,基于不同用户群体和不同用户差异化构建样本数据,在此基础上进行训练得到可用的视觉注意力模型,实现用户年龄层的细分和个体之间差异扰动的预测,更能准确预测个体与群体的视觉注意力变化及其差异化表示。

28.在对表征注意力的注视点预测时,考虑了时间维度,预测的视觉注视点图像序列,更能有效表示人类连续动态发生的注视点运动。

附图说明

29.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图做简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动前提下,还可以根据这些附图获得其他附图。

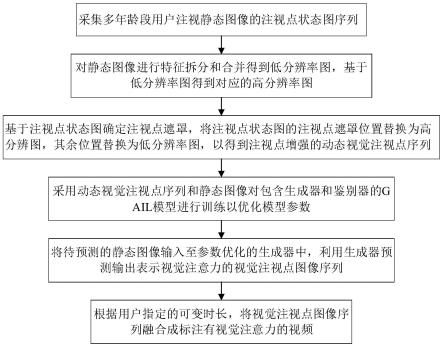

30.图1是实施例提供的支持可变时长的视觉注意力动态预测方法的流程图;

31.图2是实施例提供的gail样本数据的构建示意图;

32.图3是实施例提供的gail模型的训练示意图。

具体实施方式

33.为使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例对本发明进行进一步的详细说明。应当理解,此处所描述的具体实施方式仅仅用以解释本发明,并不限定本发明的保护范围。

34.图1是实施例提供的支持可变时长的视觉注意力动态预测方法的流程图。如图1所示,实施例提供的支持可变时长的视觉注意力动态预测方法,包括以下步骤:

35.步骤1,采集多年龄段用户注视静态图像的注视点状态图序列。

36.实施例中,通过眼动仪采集不同用户注视静态图像时的动态眼动数据集,也就是注视点状态图序列,包括:无任务驱动的自然状态下人眼对图片1-3秒的动态眼动数据记录和特定任务驱动下的人眼对图片的1-3秒内的动态眼动数据记录。实验根据年龄阶段对用户群体做出细分,采集多年龄段用户在不同任务驱动下的动态眼动数据集,在数据采集的过程中,图片与图片之间存在5s空白时间,以避免对原先注意过的物体或者位置存在反应上的延迟。采集的动态眼动数据集被存储并动态更新数据库中的用户数据,以提高模型的精准度。

37.步骤2,对静态图像进行特征拆分和合并得到低分辨率图,基于低分辨率图得到对应的高分辨率图。

38.实施例中,如图2所示,对静态图像进行噪声数据清洗,并且将静态图像在颜色、强度和方向三个维度特征上分解后,将三个维度特征进行叠加得到低分辨率图l,然后在通过超分辨率重建算法srcnn将低分辨率图转换为对应的高分辨率图h,具体原理为:对于输入的低分辨率图像,srcnn首先使用双立方插值将其放大至目标尺寸,然后利用一个三层的卷积神经网络去拟合低分辨率图与高分辨率图之间的非线性映射,最后将卷积神经网络输出的结果作为重建后的高分辨率图。

39.步骤3,基于注视点状态图确定注视点遮罩,将注视点状态图的注视点遮罩位置替换为高分辨图,其余位置替换为低分辨率图,以得到注视点增强的动态视觉注视点序列。

40.实施例中,对于注视点状态图序列中每个注视点状态图,将每个注视点状态图在空间上离散为一个20*32的网格,定义为行动空间去降低预测的复杂性。每个注视点状态图包含了单个注视点,对于每个注视点,如图2所示,通过在新注视点处用相应的高分辨率部

分替换低分辨率部分来更新状态,表示如下:

41.b

t+1

=m

t

⊙

h+(1-m

t

)

⊙bt

42.b0=l

43.其中,b

t

和b

t+1

分辨表示第t个和第t+1个注视点状态图,l表示低分辨率图,b0表示初始注视点状态图,h表示高分辨率图,m

t

表示根据第t个注视点状态图确定的注视点遮罩,初始状态是基于模糊了遮罩外围视觉的低分辨率图,

⊙

符号表示哈达玛积。对于每一帧注视点落点,通过将注视点状态图遮罩外的低分辨率部分保留并在注视点遮罩处叠加高分辨率图片来更新状态,通过该步骤可以模拟出动态视觉注意力的图像序列。

44.步骤4,采用动态视觉注视点序列和静态图像对包含生成器和鉴别器的gail模型进行训练以优化模型参数。

45.实施例中,采用动态视觉注视点序列和静态图像对包含生成器和鉴别器的gail模型进行训练以优化模型参数。参数优化的生成器作为视觉注意力预测模型。该视觉注意力预测模型用于动态预测用户兴趣区域。

46.如图3所示,gail模型中,生成器接收静态图像并生成预测的视觉注视点图像序列(假眼动),输入的静态图像作为状态,预测的视觉注视点图像序列作为预测动作,针对静态图像采集的注视点状态图序列作为真实动作,状态与预测动作形成假的状态-动作对作为假数据,状态与真实动作形成真实的状态-动作对作为真数据,判别器接收假数据和真数据并输出对假数据和真数据的辨别结果,每次鉴别器做出错误判别时,生成器的假数据都会得到奖励,使假数据更有可能在将来生成。在训练期间,鉴别器越来越难以区分生成器的数据和真实数据,生成器生成的数据越来越像人类。

47.步骤5,将待预测的静态图像输入至参数优化的生成器中,利用生成器预测输出表示视觉注意力的视觉注视点图像序列。

48.实施例中,将待预测的静态图像输入至视觉注意力预测模型中,经过计算预测输出表示视觉注意力的视觉注视点图像序列。

49.步骤6,根据用户指定的可变时长,将视觉注视点图像序列融合成标注有视觉注意力的视频。

50.实施例中,支持可变时长的视频处理算法,实现视觉注视点图像序列可视化为可变时长的视频,并叠加到输入图像上实现动态视觉注意力显示。

51.实施例中,对应步骤5输出的视觉注视点图像序列包含t个视觉注视点图像,用户指定的可变时长为s时,根据可变时长和预设帧率计算融合所需帧数f,融合第0个视觉注视点图像至t-f个视觉注视点图像为一帧,融合第1视觉注视点图像至第t-f+1为个视觉注视点图像一帧,以此类推,直至第f个视觉注视点图像至第t个视觉注视点图像融合为最后一帧,且注视点采用圆形散点可视化,合成帧数为f、时长为s的视频画面。

52.基于同样的发明构思,实施例还提供了一种支持可变时长的视觉注意力动态预测系统,包括前端显示器和后端服务器,其中,前端显示器利用electron和react技术完成桌面应用配置,后端服务器存储有上述支持可变时长的视觉注意力动态预测方法构建的参数优化的gail模型;

53.用户在前端显示器中输入静态图像,完成预测情景和预测参数的设置;后端服务器接收用户输入的静态图像,启动视觉注意力预测模型,利用参数优化的生成器预测输出

表示视觉注意力的视觉注视点图像序列;然后根据用户指定的可变时长,将视觉注视点图像序列融合成标注有视觉注意力的视频;前端显示器对标注有视觉注意力的视频进行可视化呈现,具体视频将以动态热力图的形式呈现在应用之中。

54.上述实施例提供的支持可变时长的视觉注意力预测方法和系统,支持用户群体细分和多次模拟个体差异的视觉注意力预测,通过细分用户群体的动态视觉注意力数据集训练,得到可用的视觉注意力模型,实现静态图片输入可变时长的动态视觉注意力预测与评估的输出,提高了预测结果的准确度。

55.上述实施例提供的支持可变时长的视觉注意力预测方法,在用户细分的带有时间序列的视觉注意力数据集上进行训练得到可用的视觉注意力模型并通过算法进行视频处理,实现输入任意静态图像后生成动态视觉兴趣区域,可视化用户视觉注意重点。

56.上述实施例提供的支持可变时长的视觉注意力预测系统,构建不同群体用户人群差异化的系统应用。对于用户输入的图片数据,支持选定时长、模拟次数和用户群体等参数,后台可以调用模型处理输入数据,最终反馈生成的视觉注意力预测动态图。

57.以上所述的具体实施方式对本发明的技术方案和有益效果进行了详细说明,应理解的是以上所述仅为本发明的最优选实施例,并不用于限制本发明,凡在本发明的原则范围内所做的任何修改、补充和等同替换等,均应包含在本发明的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1