一种基于摄像的多模态学习状态识别方法

1.本发明涉及学生学习状态分析技术领域,尤其涉及一种基于摄像的多模态学习状态识别方法。

背景技术:

2.学习状态是指学生在从事学习活动时,身心活动在强度、稳定性、持久性方面所表现出来的特征。对学习者而言,学习状态的优良与否,是影响学习效率和学习结果的重要影响因素之一。“以生为本”的教学中,更应关注学习者的学习状态。为保证学习者的学习效果,教师需及时对消极学习状态进行干预,以及调整教学策略。所以,教学中及时了解学习者的学习状态对于教学是否有效非常重要。但在在线教学中,老师与学生空间上的分隔,使得任课教师很难了解到网络另一端学生的学习状态。

3.学习状态研究方向有以下2大方面:(1)基于学习者学习中的认知表现,如:通过监听学习过程、记录学习数据建立学习行为与学习评价之间的相互关联。以mooc为代表的在线学习平台则广泛采用课件、作业、测验、考试、提问、讨论、互评等环节的参与度作为评测依据。(2)基于学习者学习中的生理与心里反应,如:基于人脸表情识别判别学习者的学习状态;通过可穿戴设备了解学习者学习过程中体征参数的变化判别学习者的学习状态,例如利用心率预测学生的注意力。随着物联网、大数据和人工智能等技术的不断成熟,构建自动化或半自动化的学习行为跟踪与分析系统成为可能,显性化在线学习行为及跟踪与评估其情感状态成为学习分析等教育研究的热点问题。

4.教师实施教学的过程中,尤其是在线上教学师生空间相隔的情况下,及时了解学生的学习状态是保证教学效果的必需。现有研究中,特别是能投入应用的技术中,多为事后评估,实时性能差。

技术实现要素:

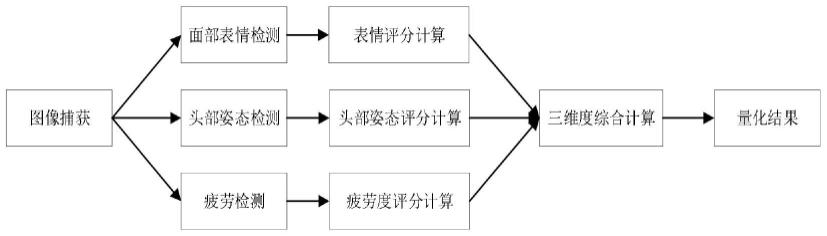

5.本发明的目的是为了解决现有技术中存在的缺点,而提出的一种基于摄像的多模态学习状态识别方法,通过给出了基于人脸摄像的情绪、头部姿态及疲劳度识别的多模态信息融合的学习状态识别方法,实施方便,可信度高,且具有实时性,可自动地将学生状态告知老师和学生,帮助教师调整教学策略进行有效教学,也可提醒倦怠的学生认真投入学习。

6.为了实现上述目的,本发明采用了如下技术方案:

7.一种基于摄像的多模态学习状态识别方法,具体步骤如下:

8.s1:通过摄像头获取学习者的人脸摄像;

9.s2:从摄像中提取人脸图像,进行面部表情检测,求表情分;

10.s3:从摄像中提取头部姿态图像,进行头部姿态检测,求头部姿态分;

11.s4:从摄像中提取人眼图像,进行眼闭次数统计,求疲劳度分;

12.s5:基于s2、s3、s4的评分进行综合评分,并量化学习状态结果。

13.优选地,在步骤s1中,具体步骤如下:

14.s101:周期性地进行拍摄,每0.5~1秒取一帧。

15.优选地,在步骤s2中,具体步骤如下:

16.s201:表情识别,具体方法为:使用openvino中已经训练好的人脸表情模型进行识别;

17.s202:对一个时间周期内的视频每一帧图片的表情识别结果按情绪分类计数ci;

18.s203:采用“yaahp”的层次分析法软件,计算情绪得分,具体步骤如下:

19.step 1:构造层次模型:目标层为面部表情得分,准则层为消极表情、积极表情和中性情绪,子准则层为k种情绪,其中消极情绪k1种,积极情绪k2种,中性表情为1种。

20.step 2:构造一致性判断矩阵,具体操作如下:

21.2.1点击“判断矩阵”页面;

22.2.2在“判断矩阵”页面上,成对比较两因素针对上一层某一个因素的相对重要性,手工输入比较值或点击屏幕给出的选项得到值;

23.2.3所有值设置完,如果出现不一致数据提示,需修改数据,直至所有数据均符合一致性要求;一致性《0.1,为符合要求;

24.step 3:点击计算结果页面,得到各情绪的权重值;

25.s204:计算情绪综合得分g1,计算式子如下:

[0026][0027]

其中,g1是情绪的综合加权评分,m是周期内获取的视频帧数,ci是对应标签的表情统计次数,wi是对应的权重值。

[0028]

优选地,在步骤s3中,具体步骤如下:

[0029]

s301:计算周期内欧位角的平均值,方法如下:

[0030]

step 1:计算头部上下平均俯仰角

[0031][0032]

其中,m为周期内获取的视频帧数,αi为第i个视频帧中人脸的俯仰角;

[0033]

step 2:计算头部左右平均偏航角

[0034][0035]

其中,m为周期内获取的视频帧数,βi为第i个视频帧中人脸的偏航角;

[0036]

s302:计算头部姿态得分,方法如下:

[0037]

step 1:计算俯仰角得分

[0038]

step 2:计算偏航角得分

[0039]

step 3:计算头部综合评分,

[0040]

其中,g2为头部姿态得分。

[0041]

优选地,在步骤s4中,具体步骤如下:

[0042]

s401:闭眼检测采用perclos疲劳检测算法的p80标准,以周期内学生的闭眼比例表示学生的疲劳度,计算方法如下:

[0043][0044]

其中,n为周期内闭眼次数帧,m是周期内获取的视频帧数;

[0045]

s402:计算疲劳度评分g3=1-p

[0046]

其中,g3为疲劳度得分。

[0047]

优选地,在步骤s5中,具体步骤如下:

[0048]

s501:采用“yaahp”的层次分析法软件,求表情、头部姿态和疲劳度在学习状态中的权值;

[0049]

step 1:层次模型为3层:目标层为“学习状态”,准则层为3种特征得分:面部表情得分、头部姿态得分、疲劳度得分,措施层为:好、一般、差;

[0050]

step 2:构造一致性判断矩阵,得到分别对应3个特征的权值:v1、v2、v3;

[0051]

s502:学习状态综合得分

[0052]

与现有技术相比,本发明具有以下有益效果:

[0053]

1、本发明基于视频的人脸摄像,给出情绪、头部姿态和疲劳度的评分,将这三方面的信息融合判断学习者的学习状态;通过情绪、头部姿态和疲劳体现出学习者的心理和生理表现,可信度较高。

[0054]

2、本发明只需摄像头,摄像头是笔记本电脑、平析、智能手机的固定配置,所以,无需额外硬件支持;视频以5分种为一周期,每次取120帧图像处理,处理完成后无需保存原图像;所以,本发明具有实时性且对内存要求较低。

附图说明

[0055]

图1为本发明的流程图;

[0056]

图2为本发明实施例中情绪评分层次结构图;

[0057]

图3为本发明实施例中表情识别判断矩阵图;

[0058]

图4为本发明实施例中组合权值示意图;

[0059]

图5为本发明实施例中三特征整合学习状态决策图;

[0060]

图6为本发明实施例中学习状态综合评估权值图。

具体实施方式

[0061]

下面结合附图将对本发明实施例中的技术方案进行清楚、完整地描述,以使本领域的技术人员能够更好的理解本发明的优点和特征,从而对本发明的保护范围做出更为清楚的界定。本发明所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例,基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动的前提下所获得的所有其

他实施例,都属于本发明保护的范围。

[0062]

参照图1-6,一种基于摄像的多模态学习状态识别方法,具体步骤如下:

[0063]

s1:通过摄像头获取学习者的人脸摄像;

[0064]

s2:从摄像中提取人脸图像,进行面部表情检测,求表情分;

[0065]

s3:从摄像中提取头部姿态图像,进行头部姿态检测,求头部姿态分;

[0066]

s4:从摄像中提取人眼图像,进行眼闭次数统计,求疲劳度分;

[0067]

s5:基于s2、s3、s4的评分进行综合评分,并量化学习状态结果。

[0068]

具体的,步骤s1,通过摄像头获取学习者的人脸摄像,具体操作如下:

[0069]

以3~5分钟周期性地进行拍摄,每1秒取一帧,取100~120帧。

[0070]

具体的,步骤s2,从摄像中提取人脸图像,进行面部表情检测,求表情分,操作方法如下:

[0071]

s201:使用openvino中已经训练好的人脸表情模型进行识别;

[0072]

s202:对一个时间周期内的视频每一帧图片的表情识别结果按情绪分类计数ci;

[0073]

s203:采用“yaahp”的层次分析法软件,计算各绪权值,步骤如下:

[0074]

step 1:构造层次模型:目标层为面部表情得分,准则层为消极表情、积极表情和中性情绪,子准则层为k种情绪,其中消极情绪k1种,积极情绪k2种,中性表情为1种。

[0075]

设消极表情4种:恐惧,难过,厌恶,生气;积极表情有3种:生气,惊讶,开心;中怀表情1种,一般。层次模型如图2所示。

[0076]

step 2:构造一致性判断矩阵。具体操作如下:

[0077]

2.1点击“判断矩阵”页面;

[0078]

2.2在“判断矩阵”页面上,成对比较两因素针对上一层某一个因素(准则或目标)的相对重要性,手工输入比较值或点击屏幕给出的选项得到值。

[0079]

图2所示模型的一致性判断矩阵如图3所示,一致性《0.1时,为符合要求。

[0080]

step 3:点击计算结果页面,得到各情绪的权重值;

[0081]

图2所示层次结构,分别得到面部表情、消极表情和积极表情3个一致性判断矩阵,如图3所示。

[0082]

s204:计算情绪综合得分g1,计算式子如下:

[0083][0084]

其中,在周期内,g1是情绪的综合加权评分,m是捕获的视频帧数,ci是对应标签的表情统计次数,wi是对应的权重值。

[0085]

对于图3的判断矩阵,得到7种情绪的权值如图4所示。

[0086]

具体的,步骤s3,从摄像中提取头部姿态图像,进行头部姿态检测,求头部姿态分,计算方法如下:

[0087]

s301:计算周期内俯仰角、偏航角的平均值,方法如下:

[0088]

step 1:计算头部上下平均俯仰角

[0089]

[0090]

其中,n为周期内获取的视频帧数,αi为第i个视频帧中人脸的俯仰角。

[0091]

step 2:计算头部左右平均偏航角

[0092][0093]

其中,n为周期内获取的视频帧数,βi为第i个视频帧中人脸的偏航角。

[0094]

s302:计算头部姿态得分,方法如下:

[0095]

step 1:计算俯仰角得分

[0096]

step 2:计算偏航角得分

[0097]

step 3:计算头部综合评分,

[0098]

具体的,步骤s4,从摄像中提取人眼图像,进行眼闭次数统计,求疲劳度分:

[0099]

s401:闭眼检测采用perclos疲劳检测算法的p80标准,以周期内学生的闭眼比例表示学生的疲劳度,计算方法如下:

[0100][0101]

其中,n为周期内闭眼次数帧,m是单位周期帧数。

[0102]

s402:计算疲劳度评分g3=1-p。

[0103]

具体的,步骤s5:基于s2、s3、s4的评分进行综合评分,并量化学习状态结果:

[0104]

s501:采用“yaahp”的层次分析法软件,求表情、头部姿态和疲劳度在学习状态中的权值。

[0105]

step 1:层次模型为3层:目标层为“学习状态”,准则层为3种特征得分:面部表情得分、头部姿态得分、疲劳度得分,备选方案层为:好、一般、差。

[0106]

层次模型如图5所示。

[0107]

step 2:构造一致性判断矩阵,得到分别对应3个特征的权值:v1、v2、v3。

[0108]

s502:学习状态综合得分

[0109]

其中,g1、g2、g3为分别为情绪的综合加权评分、头部姿态得分和疲劳度得分。

[0110]

对于图5模型,权值的计算结果如图6所示。

[0111]

综上所述,本发明通过给出了基于人脸摄像的情绪、头部姿态及疲劳度识别的多模态信息融合的学习状态识别方法,实施方便,可信度高,且具有实时性,可自动地将学生状态告知老师和学生,帮助教师调整教学策略进行有效教学,也可提醒倦怠的学生认真投入学习。

[0112]

本发明中披露的说明和实践,对于本技术领域的普通技术人员来说,都是易于思考和理解的,且在不脱离本发明原理的前提下,还可以做出若干改进和润饰。因此,在不偏离本发明精神的基础上所做的修改或改进,也应视为本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1