一种三维形象发音头部姿态模拟方法与流程

本发明属于三维形象发音,具体而言,涉及一种三维形象发音头部姿态模拟方法。

背景技术:

1、虚拟人物建模与渲染技术在动画、游戏和电影等行业得到广泛应用。使虚拟人物讲话时能够具有自然流畅并与声音同步的口型动作是提升用户体验的关键。在实时系统中,需要同步播放以流的形式实时获取的音频,和同步渲染的虚拟人物形象,这个过程中需要保证音频和人物口型之间的同步。

2、公开号为cn111081270b的中国发明专利(申请号:cn201911314031.3)公开了一种实时音频驱动的虚拟人物口型同步控制方法,包括如下步骤:从实时语音流中识别出视素概率的步骤;对所述视素概率进行滤波的步骤;将所述视素概率的采样率转换为和虚拟人物渲染帧率相同的采样率的步骤;将所述视素概率转换为标准口型配置并进行口型渲染的步骤。该方法可以避免要求在传递音频流时同步传递音素序列或口型序列信息,可以显著降低系统复杂性、耦合度和实现难度,适用于各种在显示设备上渲染虚拟人物的应用场景。

3、上述发明以及当前的众多三维形象在发音过程中,只有单纯口型变化,头部姿态与发音缺乏联动,使得三维形象发音过程呆板、不自然。

技术实现思路

1、有鉴于此,本发明提供一种三维形象发音头部姿态模拟方法,能够解决三维形象在发音过程中,只有单纯口型变化,头部姿态与发音缺乏联动,使得三维形象发音过程呆板、不自然的技术问题。

2、本发明是这样实现的:

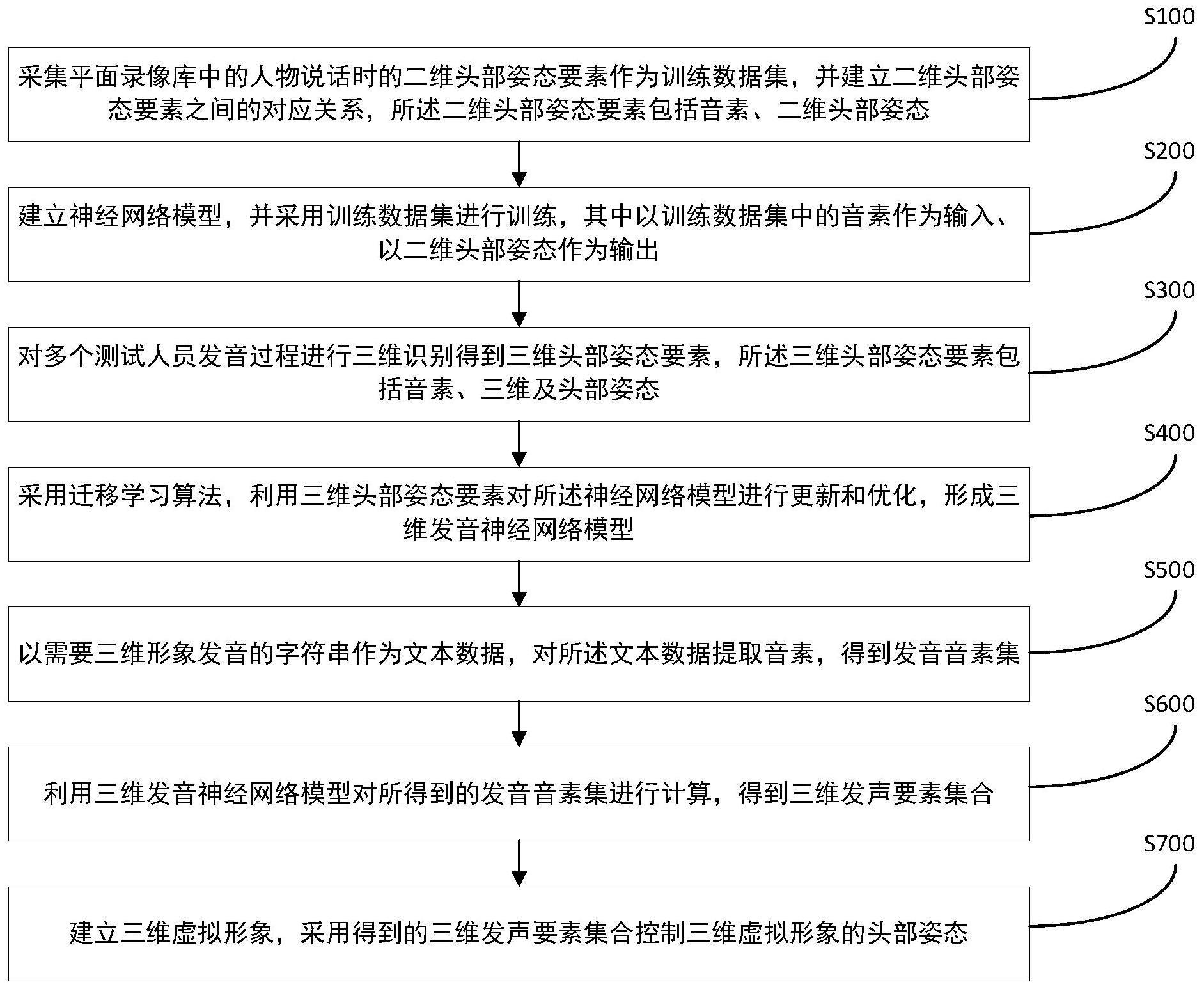

3、本发明提供一种三维形象发音头部姿态模拟方法,其中,包含以下步骤:

4、s100:采集平面录像库中的人物说话时的二维头部姿态要素作为训练数据集,并建立二维头部姿态要素之间的对应关系,所述二维头部姿态要素包括音素、二维头部姿态;

5、s200:建立神经网络模型,并采用训练数据集进行训练,其中以训练数据集中的音素作为输入、以二维头部姿态作为输出;

6、s300:对多个测试人员发音过程进行三维识别得到三维头部姿态要素,所述三维头部姿态要素包括音素、三维 头部姿态;

7、s400:采用迁移学习算法,利用三维头部姿态要素对所述神经网络模型进行更新和优化,形成三维发音神经网络模型;

8、s500:以需要三维形象发音的字符串作为文本数据,对所述文本数据提取音素,得到发音音素集;

9、s600:利用三维发音神经网络模型对所得到的发音音素集进行计算,得到三维发声要素集合;

10、s700:建立三维虚拟形象,采用得到的三维发声要素集合控制三维虚拟形象的头部姿态;

11、其中,所述头部姿态采用头部姿态关键点的坐标进行描述。

12、在上述技术方案的基础上,本发明的一种三维形象发音头部姿态模拟方法还可以做如下改进:

13、其中,所述步骤s100中采集平面录像库中的人物说话时的二维头部姿态要素的具体步骤包括:

14、第一步:选取平面录像库中的人物说话录像片段,其中录像片段包括录像音频和多个帧;

15、第二步:对每个帧中的图像建立二维坐标系,同时采用人脸识别方法识别人脸;

16、第三步:在所识别的人脸上设置二维关键点并记录平面中的头部姿态关键点的二维坐标。

17、第四步:对每个帧采集对应的录像音频中的音素。

18、进一步的,所述步骤s100中建立二维头部姿态要素之间的对应关系的具体步骤为:根据录像的时间轴建立音素以及二维头部姿态的对应关系。

19、其中,所述步骤s300中对多个测试人员发音过程进行三维识别得到三维头部姿态要素的具体步骤包括:

20、第一步:对多个测试人员的面部设置绿色的三维识别点;

21、第二步:建立三维坐标系,并对每个三维识别点进行三维坐标标记,形成头部姿态关键点的三维坐标;

22、第三步:在测试人员面部的前后左右上五个方向上,采用互相垂直的设置5个摄像机;

23、第四步:测试人员进行对话发音或朗读,利用摄像机对测试人员的对话发音或朗读过程进行视频采集;

24、第五步:记录采集的视频中每个三维识别点的不同时刻的坐标,形成三维识别点坐标序列作为三维头部姿态要素;识别测试人员不同时刻的发音音素,形成发音音素序列;并按照时刻建立三维头部姿态要素与发音音素序列的关系。

25、进一步的,所述三维识别点至少包括测试人员人脸的鼻尖、下额中点、左眼角、右眼角、左嘴角、右嘴角、头顶中心、左耳顶、左耳下尖、右耳顶、右耳下尖所在的点。

26、其中,所述步骤s700中采用得到的三维发声要素集合控制三维虚拟形象的头部姿态的步骤具体包括:

27、首先,为每一种头部姿态定义标准口型配置,所述标准口型配置为关键帧或描述口型的参数;

28、其次,通过映射函数将视素概率转换为标准口型配置的混合比例;其中,在关键帧场景下,所述混合比例是不同关键帧之间的插值比例;

29、在关键点参数、骨骼参数或blenshape参数的场景下,所述混合比例是关键点参数、骨骼参数或blenshape参数的混合比例。

30、进一步的,所述头部姿态关键点至少包括人脸的鼻尖、下额中点、左眼角、右眼角、左嘴角、右嘴角、头顶中心、左耳顶、左耳下尖、右耳顶、右耳下尖所在的点。

31、进一步的,所述二维头部姿态要素还包括二维视素,所述三维头部姿态要素还包括三维视素。

32、其中,所述平面录像库中发音超过2分钟的人物数量大于10000。

33、进一步的,所述多个测试人员的数量大于10,所述测试人员对话发音或朗读的时长大于10分钟。

34、与现有技术相比较,本发明提供的一种三维形象发音头部姿态模拟方法的有益效果是:采用头部姿态关键点来描述头部动作,其中头部姿态关键点至少包括人脸的鼻尖、下额中点、左眼角、右眼角、左嘴角、右嘴角、头顶中心、左耳顶、左耳下尖、右耳顶、右耳下尖所在的点;利用三维发音神经网络模型对所得到的发音音素集进行计算,得到三维发声要素集合建立三维虚拟形象,采用得到的三维发声要素集合控制三维虚拟形象的头部姿态;并实现发音与头部姿态关键点动作的联动,解决了三维形象发音过程呆板、不自然的技术问题。

技术特征:

1.一种三维形象发音头部姿态模拟方法,其特征在于,包含以下步骤:

2.根据权利要求1所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述步骤s100中采集平面录像库中的人物说话时的二维头部姿态要素的具体步骤包括:

3.根据权利要求2所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述步骤s100中建立二维头部姿态要素之间的对应关系的具体步骤为:根据录像的时间轴建立音素以及二维头部姿态的对应关系。

4.根据权利要求1所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述步骤s300中对多个测试人员发音过程进行三维识别得到三维头部姿态要素的具体步骤包括:

5.根据权利要求4所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述三维识别点至少包括测试人员人脸的鼻尖、下额中点、左眼角、右眼角、左嘴角、右嘴角、头顶中心、左耳顶、左耳下尖、右耳顶、右耳下尖所在的点。

6.根据权利要求1所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述步骤s700中采用得到的三维发声要素集合控制三维虚拟形象的头部姿态的步骤具体包括:

7.根据权利要求1-6任一项所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述头部姿态关键点至少包括人脸的鼻尖、下额中点、左眼角、右眼角、左嘴角、右嘴角、头顶中心、左耳顶、左耳下尖、右耳顶、右耳下尖所在的点。

8.根据权利要求1-6任一项所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述二维头部姿态要素还包括二维视素,所述三维头部姿态要素还包括三维视素。

9.根据权利要求1所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述平面录像库中发音超过2分钟的人物数量大于10000。

10.根据权利要求4所述的一种三维形象发音头部姿态模拟方法,其特征在于,所述多个测试人员的数量大于10,所述测试人员对话发音或朗读的时长大于10分钟。

技术总结

本发明提供了一种三维形象发音头部姿态模拟方法,属于三维形象发音技术领域,该方法包括:采集平面录像库中的人物说话时的二维头部姿态要素作为训练数据集,并建立二维头部姿态要素之间的对应关系;建立神经网络模型并进行训练;对多个测试人员发音过程进行三维识别得到三维头部姿态要素;采用迁移学习算法,利用三维头部姿态要素对所述神经网络模型进行更新和优化,形成三维发音神经网络模型;以需要三维形象发音的字符串作为文本数据,对所述文本数据提取音素,得到发音音素集;利用三维发音神经网络模型对所得到的发音音素集进行计算,得到三维发声要素集合;建立三维虚拟形象,采用得到的三维发声要素集合控制三维虚拟形象的头部姿态。

技术研发人员:周安斌,晏武志,潘见见,李鑫,彭辰

受保护的技术使用者:山东金东数字创意股份有限公司

技术研发日:

技术公布日:2024/1/12

- 还没有人留言评论。精彩留言会获得点赞!