一种基于Transformer网络的行人重识别方法及装置

本发明涉及网络图像处理,特别是涉及一种基于transformer网络的行人重识别方法及装置。

背景技术:

1、随着经济的发展和科技的提升,行人重识别是智能视频分析领域的研究热点,得到了学术界的广泛重视。行人重识别就是利用计算机视觉技术,根据不同摄像头或者监控下的图像或者视频去判断该图像或者视频中是否存在目标人物。而由于不同摄像头或者监控下的相机分辨率不同,或者由于角度原因,光照变化等一系列客观因素,我们通常很难得到质量高的图片,行人重识别技术面临着巨大的挑战。

2、目前,随着深度学习的发展,cnn卷积神经网络被作为用来提取行人重识别的表征特征的非常常用的一个网络,但是由于一般的cnn只注重于局部特征的提取,而对于行人重识别的任务来说,全局特征尤为重要。而transformer是从nlp中延伸过来的,他是以一整个序列作为输入的,所以transformer相比于cnn更加注重对全局特征的提取,transformer网络作为对图片或者视频进行特征提取也是一种常用选择。但是,事实上在行人重识别的任务领域中,全局特征和局部特征所提取出来的信息对于该任务的精确度和鲁棒性都非常的重要,而现有的transformer网络特征提取的倾向性不适于提高行人重识别任务的精确度和鲁棒性。

3、因此,提供一种相比于cnn和现有transformer网络而言,可以有效提高行人重识别任务精确度和鲁棒性的基于transformer网络的行人重识别方法及装置的现有是本领域技术人员亟待解决的问题。

技术实现思路

1、本发明的目的在于提供一种基于transformer网络的行人重识别方法及装置,该方法逻辑清晰,步骤精简,操作简便,针对cnn卷积神经网络和现有transformer网络在行人重识别任务中的不足,可以有效的提高行人重识别任务精确度和鲁棒性。该装置同样具有上述有益效果。

2、基于以上目的,本发明提供的技术方案如下:

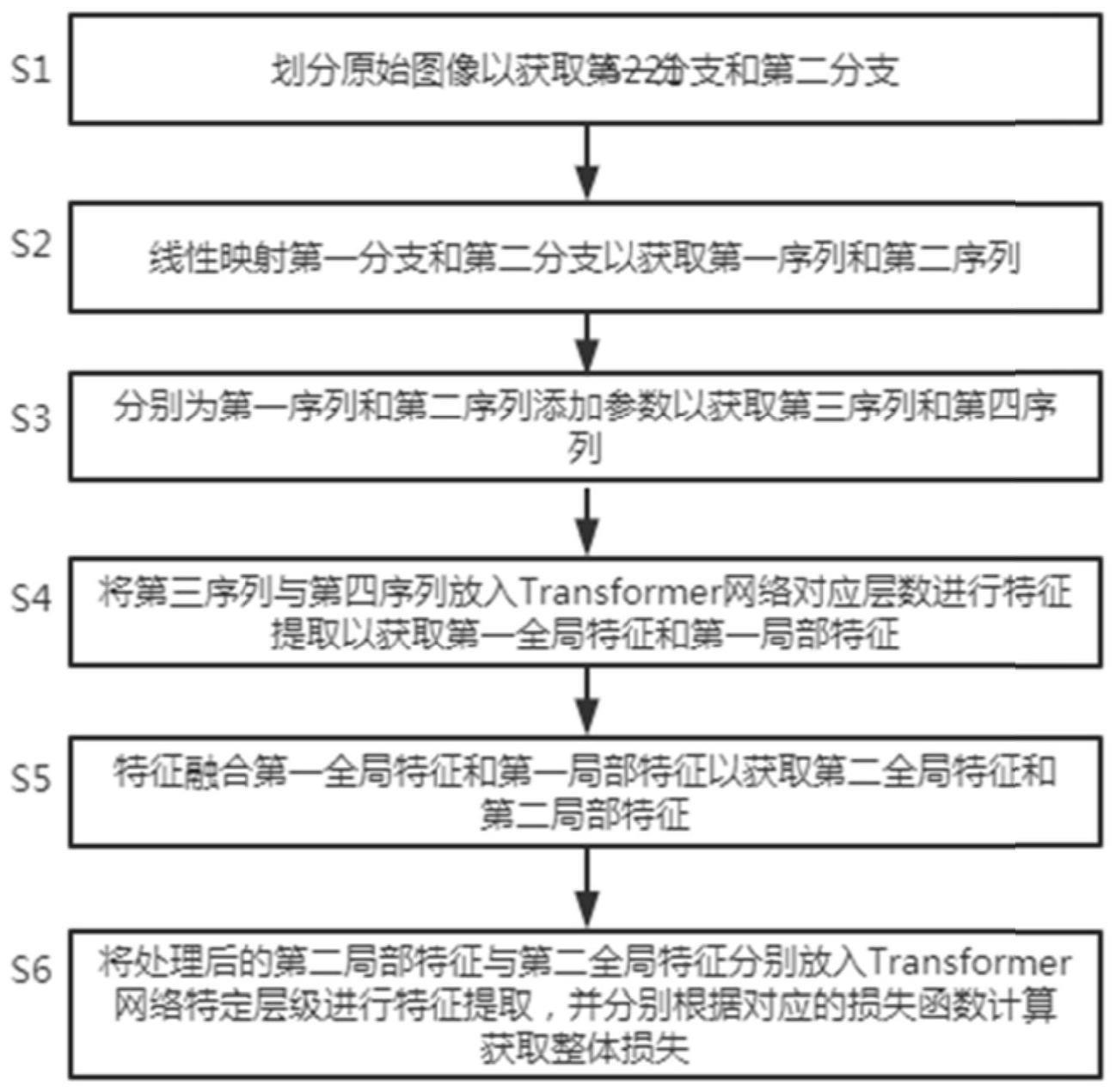

3、一种基于transformer网络的行人重识别方法,包括如下步骤:

4、划分原始图像以获取第一分支和第二分支;

5、线性映射所述第一分支和所述第二分支以获取第一序列和第二序列;

6、分别为所述第一序列和所述第二序列添加参数以获取第三序列和第四序列;

7、将第三序列与第四序列放入transformer网络对应层数进行特征提取以获取第一全局特征和第一局部特征;

8、特征融合所述第一全局特征和所述第一局部特征以获取第二全局特征和第二局部特征;

9、将处理后的所述第二局部特征与所述第二全局特征分别放入transformer网络特定层级进行特征提取,并分别根据对应的损失函数计算获取整体损失;

10、其中,所述第三序列为添加参数后的所述第一序列,所述第四序列为添加参数后的所述第二序列。

11、优选地,在所述划分原始图像以获取第一分支和第二分支之前,还包括如下步骤:

12、预设第一斑块和预设第二斑块;

13、输入所述原始图像;

14、其中,所述第一斑块大小大于所述第二斑块大小。

15、优选地,所述参数具体为:辅助信息和位置编码信息。

16、优选地,所述将第三序列与第四序列放入transformer网络对应层数进行特征提取以获取第一全局特征和第一局部特征,具体包括如下步骤:

17、根据消融实验获取第三序列所对应的第一层数;

18、根据消融实验获取第四序列所对应的第二层数;

19、将第三序列放入所述第一层数的transformer网络中,将第四序列放入所述第二层数的transformer网络中后,分别进行特征提取以获取第三序列的第一全局特征和第一局部特征与第四序列的第一全局特征和第一局部特征;

20、其中,特征提取是基于transformer网络中的encoder和decoder进行特征交互。

21、优选地,所述特征融合所述第一全局特征和所述第一局部特征以获取第二全局特征和第二局部特征,具体包括如下步骤:

22、将第三序列的第一全局特征与第四序列的第一局部特征,将第三序列的第一局部特征与第四序列的第一全局特征分别放入交叉注意力网络进行特征融合以获取第二全局特征和第二局部特征。

23、优选地,在所述特征融合所述第一全局特征和所述第一局部特征以获取第二全局特征和第二局部特征之前,还包括如下步骤:

24、在所述交叉注意力网络中,将全功能节点替换为映射与反映射关系。

25、优选地,在所述将处理后的所述第二局部特征与所述第二全局特征分别放入transformer网络特定层级进行特征提取,并分别根据对应的损失函数计算获取整体损失之前,还包括如下步骤:

26、对所述第二局部特征进行混洗操作;

27、其中,混洗操作具体为:打乱所述第二局部特征中的所述辅助信息和所述位置编码信息。

28、优选地,所述特定层级具体为transformer网络中的最后一层。

29、优选地,所述将处理后的所述第二局部特征与所述第二全局特征分别放入transformer网络特定层级进行特征提取,并分别根据对应的损失函数计算获取整体损失,具体包括如下步骤:

30、将混洗操作后的所述第二局部特征和所述第二全局特征分别放入transformer网络中最后一层进行特征提取以获取第三全局特征和第三局部特征;

31、根据所述第三全局特征和预设损失函数id loss获取第一损失;

32、根据所述第三局部特征和预设损失函数triple loss获取第二损失;

33、根据所述第一损失和所述第二损失获取整体损失;

34、其中,所述整体损失具体为所述第一损失和所述第二损失的平均值。

35、一种基于transformer网络的行人重识别装置,包括:

36、划分模块,用于将原始图像划分为第一分支和第二分支;

37、映射模块,用于线性映射所述第一分支和所述第二分支以获取第一序列和第二序列;

38、参数添加模块,用于为所述第一序列和所述第二序列添加参数,使其转换为第三序列和第四序列;

39、特征提取模块,用于分别提取所述第三序列和所述第四序列的第一全局特征和第一局部特征;

40、特征融合模块,用于融合所述第一全局特征和所述第一局部特征以获取第二全局特征和第二局部特征;

41、处理模块,用于对所述第二局部特征进行处理;

42、计算模块,用于根据处理后的所述第二局部特征和所述第二全局特征以及相对应的损失函数计算获取整体损失。

43、本发明提供了一种基于transformer网络的行人重识别方法,是通过将原始图像划分为两个分支;将两个分支分别进行线性映射,得到第一序列和第二序列;在第一序列和第二序列中加入新的参数,生成第三序列和第四序列;将第三序列和第四序列放入transformer网络中对应的不同层级进行特征提取,从而获得第一全局特征和第一局部特征;将第一全局特征和第一局部特征进行特征融合,获得第二全局特征和第二局部特征;对第二局部特征处理,对第二全局特征不做处理,将处理后的第二局部特征和第二全局特征分别放入transformer网络特定的层级进行特征提取,将提取后的特征分别根据对应的损失函数计算整体损失。

44、实际上,申请人在研究行人重识别领域的相关问题是发现,由于以往的方法cnn更多的是关注于局部的细粒度的特征表示,而行人重识别中不仅仅需要细粒度的特征,由于光照影响,环境背景变化,摄像头监控的角度变化等一系列客观因素的影响,仅仅依靠局部特征是无法精准的进行判断的。近年来的研究表明:cnn对海量数据的适配能力没有想象中的要好,相反transformer随着数据量的增加,模型的性能表现更加优异,从而使得transformer较cnn在行人重识别中的大型数据集上的优势更为明显。此外,cnn注重于局部特征的提取,容易陷入局部优化,以及一般cnn的网络中的池化会造成信息丢失的问题。而现有技术使用了transformer网络去进行全局特征的提取,在行人重识别的任务中对于细粒度特征也同样重要。

45、在此基础上,本案将原始图像划分为两个分支,一个分支提取粗粒度特征,另一个分支提取细粒度特征,再将所获得的表示为粗粒度特征与细粒度特征的二维分支转变为一维序列,得到第一序列和第二序列,以此可以同时进行两个粗细粒度的特征提取,对于行人重识别的任务的精准性有了极大的提升;为避免摄像头提取的图片因光照因素影响,或者角度印象,或者背景环境不同等客观因素影响而造成的模型识别偏差带来的一系列不利的因素,在第一序列和第二序列中添加参数得到第三序列和第四序列;再将第三序列和第四序列放入transformer网络的对应层数中进行特征提取;提取出两个不同分支的特征后,进行特征融合,随着两者之间的粗细粒度信息进行交互,进而使选择不同尺度的特征能够相互融合;在特征融合之后,对局部特征提前进行处理,达到数据图像增强的效果,使输出流程更具有鲁棒性;最后将处理后的局部特征和全局特征分别利用对应的损失函数计算获取整体损失。

46、本发明还提供了一种基于transformer网络的行人重识别装置,该装置包含有实现上述方法的模块,由于该装置采用了相应的模块,因此该装置理应具有与上述方法相同的有益效果,在此不再赘述。

- 还没有人留言评论。精彩留言会获得点赞!