一种基于红外小样本扩增与YOLOv5的红外弱小目标检测方法与流程

一种基于红外小样本扩增与yolov5的红外弱小目标检测方法

技术领域

1.本发明涉及图像目标技术检测领域,特别是涉及一种基于红外小样本扩增与yolov5的红外弱小目标检测方法。

背景技术:

2.高于热力学零度的物体都会向外辐射红外线,其中红外线穿透云雾的能力比较强,受光照强度的影响很小,在白天和夜晚都可以实现很好的目标检测效果。但是红外图像的对比度比较低、纹理特征比较弱、受到的干扰比较多,检测目标在海上云雾相似背景的影响之下,会成为弱小目标,一般的目标识别算法很难适用于弱小目标检测。随着深度学习技术的发展,lecun证明随机梯度下降通过反向传播可以训练卷积神经网络,这一结论大大加速了卷积神经网络在目标检测领域上的应用。ross girshick的r

–

cnn模型第一次将卷积神经网络运用到目标检测领域,其两阶段进行检测识别的思想也深刻影响了后来的fast r

–

cnn算法与faster r

–

cnn算法。针对两阶段目标检测算法存在的运行速度较慢和难以实现工程化等问题,yolo算法和ssd算法先后被提出,它们将目标检测任务视为一个回归问题,在不影响检测精度的同时大幅度地提高了检测速度。

3.注意力机制是人类视觉系统固有的一种筛选图像信息和聚焦显著物体的信息处理机制,深度学习中注意力机制借鉴了人类的视觉注意力思维方式。人类可以通过快速浏览整体图像,迅速寻找出需要重点关注的区域,从而抑制次要信息对整体的影响,极大地提高了视觉信息处理的效率与准确性。深度卷积神经网络在经过多层卷积处理后将产生大量的高维特征图,这些由各层网络生成的特征图包含输入图像的各种纹理、特征、形态等信息。jie hu的se模型将这些饱含信息的特征图在传递给更深层网络前赋予不同的权值。sanghyun的cbam模型通过并行的特征信息编码将特征图赋予相应的权值。上述模型都能在增加相应计算量的前提下,使最终深度网络模型的输出更多地受到包含关键区域特征图的影响。

4.生成对抗网络(generative adversarial network,gan)旨在生成不存在于真实世界的数据,在传统图像仿真领域,图像的仿真需经过建模、添加纹理和光照、渲染等一系列复杂的步骤。gan网络的出现简化了这一过程,其利用深度神经网络模型构建生成器和判别器,生成器负责生成伪样本,而判别器用于分辨样本的真伪,生成器和判别器之间采用对抗博弈的方法自动学习样本数据的真实分布,从而实现图像的样本扩增。在动态博弈的过程中,gan网络的生成器和判别器取样于随机噪声。这样生成的伪样本状态并不可控,即生成的红外域样本图像的具体内容并不受用户控制。此外,由随机噪声生成的伪样本还存在图像边缘不清晰、细节模糊等问题。

技术实现要素:

5.本发明针对现有技术中红外弱小目标检测效率仍须改善的问题,提供一种检测精度高、检测速度快的基于红外小样本扩增与yolov5的红外弱小目标检测方法。

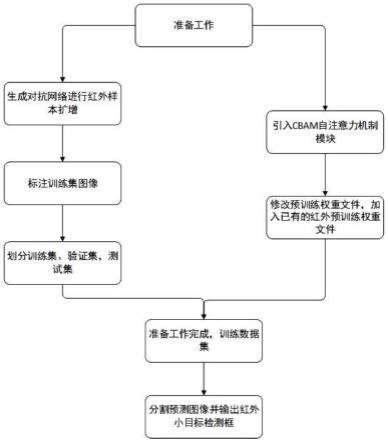

6.本发明的技术解决方案是,提供一种具有以下步骤的基于红外小样本扩增与yolov5的红外弱小目标检测方法:含有以下步骤,

7.步骤1:生成对抗网络;

8.步骤2:训练集图像采用labelimg工具进行标注;

9.步骤3:采用迁移学习的方法,加入已有数据集的预训练权重文件训练自己的数据集;

10.步骤4:定义损失函数loss:

11.步骤5:加入自注意力机制,引入cbam模块;

12.步骤6:准备工作完成开始训练数据集,将训练结果正确绘制在原始图像上;

13.步骤7:将训练数据集的结果正确绘制在原始图像上并分割预测的图像,将红外图像测试数据集输入训练好的模型中,输出红外图像测试数据集目标预测边界框。

14.优选地,所述步骤1中含有以下步骤,

15.步骤1.1:生成对抗网络,采用未成对样本数据训练网络模型,给网络增加限制条件使得网络学习高维数据间的映射关系;将可见光域的图像转换为红外域的图像;

16.步骤1.1.1:采用2个判别器和2个生成器构成循环的网络结构,2个生成器对可见光域和红外域的图像进行相互转换,2个判别器分别判别红外域和可见光红外域图像的真伪;

17.步骤1.1.2:可见光域图像经过生成器后生成一幅红外域上的伪样本图像,网络模型在训练的过程中不断优化目标损失函数,学习到高维数据的特征分布,构建出可见光域至红外域的映射关系;

18.步骤1.2:通过将2个单向的生成对抗网络耦合成一个环状网络结构,构建可见光域至红外域的映射关系,加入重构损失函数后,生成对抗网络在训练的过程中给生成伪样本的生成器添加强制性约束,即真实样本与通过连续的生成器所生成的伪样本间的差异应尽可能的小;

19.步骤1.3:将注意力机制模型添加至生成对抗网络的生成器网络结构中;

20.步骤1.3.1:网络模型是对称的结构,分别学习变换函数,实现两个数据域之间的映射,在loss设计时提出循环一致性损失,在注意力机制的网络结构中,注意力模块生成注意力掩码,然后将注意力掩码与输入图像进行融合,通过网络训练得到高质量的生成样本,生成器不仅要生成样本,还要生成注意力掩码,然后通过loss函数的设计以及网络生成器和判别器的博弈,网络的注意力将关注在目标上并生成质量比较好的样本;

21.步骤1.3.2:生成器中注意力机制模型将输入的特征图经过全局平均池化和全局最大池化操作得到依托通道数的特征向量,将特征向量经过全连接层、拼接处理后送入分类器做源域和目标域的分类,反向传播学习到特征图对应的权值,最后,特征图对应的权值和特征图进行位乘得到经过注意力机制增强的特征图,使生成器着重于可见光域图像的关键区域信息以实现红外风格迁移。

22.优选地,所述步骤2含有以下步骤:

23.步骤2.1、训练集图像采用labelimg工具进行标注,对需要标注的图像打好标签后进行保存;

24.步骤2.2、采用红外弱小目标数据集分辨率为1920

×

1080像素的红外弱小目标图

像;

25.步骤2.3、使用不同复杂背景下的数据进行实验,训练集、验证集、测试集划分比例为7:2:1。

26.优选地,所述步骤3含有以下步骤:

27.采用已有的flir红外数据集的预训练模型,采用红外弱小目标数据集分辨率为1920

×

1080像素的红外弱小目标图像;通过冻结网络层行迁移训练实现在新模型上快速进行重新训练,yolov5所有层的冻结通过设置其梯度为零来实现,执行train文件,在yaml文件中查看网络层,通过freeze冻结头部进行训练,冻结除了输出层以外的所有层进行训练。

28.优选地,所述步骤4中用损失函数来度量神经网络预测信息与期望信息的距离,预测信息越接近期望信息,损失函数值越小,训练时包含三个方面的损失:矩形框损失、置信度损失和分类损失,定义为loss=a*lossobj+b*lossrect+c*lossclc,其中yolov5使用ciou loss来衡量矩形框的损失,ciou loss的定义为:

29.优选地,所述步骤5含有以下步骤:

30.步骤5.1:cbam模块首先将给定特征图f送入通道注意力模块,通过平均池化和最大池化得到每个通道的信息,并将得到的参数通过多层感知器进行叠加,再经过sigmoid函数激活,从而得到通道注意力特征mc(f);

31.步骤5.2:将给定特征图f

x

送入空间注意力模块后,通过平均池化和最大池化沿通道维度汇聚空间信息,生成空间特征图f

avg

∈ri×h×w和f

max

∈ri×h×w,再通过1

×

1的卷积和sigmoid函数激活,得到空间注意力特征;接着与f

x

逐元素乘,最终得到空间注意力特征图fs;

32.步骤5.3:在3个csp模块后分别引入cbam模块解决原网络无注意力偏好问题;

33.步骤5.4:结合注意力机制需要的参数及自己模型的通道数,改写yaml配置文件;

34.步骤5.5:运行yolo文件,查看是否加入了cbam注意力模块。

35.优选地,所述步骤6含有以下步骤:

36.步骤6.1:评价指标采用准确率、召回率和平均精度均值来衡量,其中precision和recall计算公式如下所示:

[0037][0038]

式中:tp表示目标为真实目标,检测结果为真实目标;fp表示目标不是真实目标,检测结果不是真实目标;fn表示目标为真实目标,检测结果为不是真实目标;

[0039]

步骤6.2:precision表示在检测出为红外弱小目标的样本中有多少是真正的红外弱小目标,反映了检测结果是否准确的问题,recall表示在全部的红外弱小目标图像样本中,有多少红外弱小目标被正确检测出,反映了红外弱小目标是否齐全的问题,精度均值ap为以准确率precision和召回率recall所围成的曲线面积值,map为学习的所有类别精度均值的平均值,map@0.5表示将交并比iou设为0.5时,计算每一类的所有图像数据集的ap,然后所有类别求平均的值。

[0040]

优选地,所述所述步骤7含将预测的图像分割成四张912

×

608,提升检测精度,将红外图像测试数据集载入训练好的基于改进yolov5的红外图像小目标检测模型,输出红外图像测试数据集目标预测边界框。

[0041]

与现有技术相比,本发明基于红外小样本扩增与yolov5的红外弱小目标检测方法具有以下优点:

[0042]

1、针对红外目标检测领域,目标样本稀缺一直是制约检测识别精度的难题,提出了一种小样本红外图像的样本扩增,生成一系列保留原始可见光图像关键区域的红外连续图像。

[0043]

2、为解决gan网络生成图像状态不可控的问题,在cyclegan算法的基础上进行改进,使用注意力机制区分源域和目标域,帮助生成对抗网络模型集中转换关键区域,从而有效缓解高维数据跨域重复映射问题。

[0044]

3、采用迁移学习的方法,加入已有数据集的预训练权重文件训练自己的数据集,从而更快的使模型有效收敛。

[0045]

4、在训练过程中加入自注意力机制,加入cbam注意力层。

[0046]

5、修改了预测模块,增加了分割检验模块提升了检测精度,更准确的输出了检测框。

[0047]

6、通过生成对抗网络寻找可见光域与红外域的高维数据表征,并采用注意力机制将图像从可见光域映射至红外域,在保留关键区域的前提下实现完备的图像风格迁移,引入迁移学习的方法,使模型更加有效的收敛,在网络模型的残差模块引入注意力机制,最后在预测阶段分割预测图像,使得在执行卷积操作时能够更加关注图像中的目标信息。

附图说明

[0048]

图1是本发明的方法流程图;

[0049]

图2是本发明中可见光域样本的单网络的结构示意图;

[0050]

图3是本发明中attentiongan的示意图;

[0051]

图4是本发明中生成器的注意力模型结构示意图;

[0052]

图5是本发明中生成器网络的结构示意图;

[0053]

图6是本发明中卷积块注意力模型中的通道注意力示意图;

[0054]

图7是本发明中训练模型准确度、召回率和平均精度均值的示意图。

具体实施方式

[0055]

为了使本技术领域的人员更好地理解本发明方案,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分的实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都应当属于本发明保护的范围。

[0056]

下面结合附图和具体实施方式对本发明基于红外小样本扩增与yolov5的红外弱小目标检测方法作进一步说明:本实施例中包括以下步骤:

[0057]

步骤1:生成对抗网络:

[0058]

步骤1.1:采用2个判别器和2个生成器构成循环的网络结构,2个生成器g1和g2用于对可见光域和红外域的图像进行相互转换,2个判别器d1和d2分别判别红外域和可见光红外域图像的真伪。

[0059]

步骤1.1.1:如图2所示,可见光域图像x经过生成器g1后生成一幅红外域上的伪样本图像g1(x),利用判别器d1来辨别真伪后得出判别器d1的损失函数接着将这个伪样本再次经过生成器g2生成一幅可见光域上的重构图像g2(g1(x)),接着将重构图像g2(g1(x))同原始输入图像x进行对比分析得出重构损失l1。

[0060]

步骤1.1.2:网络模型在训练的过程中不断优化目标损失函数,从而学习到高维数据的特征分布,并构建出可见光域至红外域的映射关系。

[0061][0062][0063]

l1=e

x

:

data

(

x

)[||g2(g1(x))-x||1]

[0064]

l1=ey:

data(y)

[||g1(g2(x))-y||1]

[0065]

步骤1.2:将2个单向的生成对抗网络耦合成一个环状网络结构,可以构建可见光域至红外域的映射关系。加入重构损失函数后,生成对抗网络在训练的过程中给生成伪样本的生成器添加了强制性约束,即真实样本与通过连续的生成器所生成的伪样本间的差异应尽可能的小。这可以在一定程度上缓解生成对抗网络中普遍存在的模式崩溃问题,即来自一个域的多个模式的数据映射到另一个域的单个模式,从而实现可见光域图像至红外域图像的风格迁移。

[0066]

步骤1.3:在现有cyclegan的基础上引入注意力机制,将样本图像分为前景和背景,网络的特征提取重点关注对于目标的特征提取上。

[0067]

步骤1.3.1:基于注意力引导的生成器模块,如图3所示,生成器模块不仅要生成样本,同时生成attention mask。对于一个典型的生成对抗网络,存在生成器和鉴别器两个部件,而gan的目标就是实现数据域x到数据域y的映射,即是一种单向的映射,同时还会要求数据的匹配,生成器g

x

→

y即是将x从数据域x映射到数据域y中,即生成数据域y中的样本,而鉴别器dy则专注于改进自身,使得能够判断出样本是生成样本还是真实样本。而对于改进的cyclegan,是包含具有内置注意力机制的两个生成器和两个判别器,目的是用来学习数据域x和数据域y之间的两个映射,即g

x

→

y:x

→

[my,ry,gy]和gy→

x:y

→

[m

x

,r

x

,g

x

],其中m

x

和my分别表示图像x和图像y的注意力掩码,即attention mask,r

x

和ry分别表示图像x和图像y的内容掩码,即content mask,g

x

和gy分别表示生成的图像x和图像y。

[0068]

步骤1.3.2:生成器中注意力机制模型结构图如图4所示,将注意力机制模型添加至生成对抗网络的生成器网络结构中。将可见光域图像输入生成器下采样后,将经过多个残差块处理后得到的特征图送入注意力机制模型。模型为包含不同区域关键信息的特征图赋予相应的权值,最后经残差块处理后,上采样得到红外域生成图像,其中生成器网络的结构示意图如图5所示。

[0069]

步骤2:训练集图像采用labelimg工具进行标注。

[0070]

步骤2.1.1:首先点击按钮“open dir”打开要进行标注的红外图像的文件夹,在右下角的“file list”会罗列出文件夹中所有的图像文件,点击“change save dir”按钮选择标注生成的.xml文件保存路径。

[0071]

步骤2.1.2:使用快捷键“w”按钮,然后画框选取要标注的对象,尽量图像减少尺寸,框画好后自动弹出“类别填写框”,填写红外弱小目标的物体种类,点击“ok”按钮后会显示所填写的类别。

[0072]

步骤2.1.3:图像中所有需要被标注的对象均标注完之后,点击“save”按钮,进行保存。最后在保存文件的路径下生成.xml文件,文件的名称是和标注照片的名字一样,如果要修改已经标注过的图像,文件中的信息会自动改变。

[0073]

步骤2.1.4:点击“next image”或者“pre image”按钮切换图像,重复上述步骤进行标注。

[0074]

步骤2.2:采用红外弱小目标数据集分辨率为1920

×

1080像素的红外弱小目标图像。

[0075]

步骤2.3:使用不同复杂背景下的数据进行实验,训练集、验证集、测试集划分比例为7:2:1。

[0076]

步骤3:采用迁移学习的方法,使用已有数据集的预训练权重文件训练自己的数据集,从而更快的使模型有效收敛:

[0077]

步骤3.1:采用已有的flir红外数据集的预训练模型。

[0078]

步骤3.2:通过冻结某些层进行迁移训练可以实现在新模型上快速进行重新训练,以节省训练资源;

[0079]

步骤3.3:yolov5所有层的冻结通过设置其梯度为零来实现,执行train文件;

[0080]

步骤3.4:在yaml文件中可以查看网络层,通过freeze冻结头部进行训练。冻结除了输出层以外的所有层进行训练。

[0081]

步骤4:定义损失函数loss,损失函数的作用为度量神经网络预测信息与期望信息(标签)的距离,预测信息越接近期望信息,损失函数值越小。训练时主要包含三个方面的损失:矩形框损失(lossrect)、置信度损失(lossobj)、分类损失(lossclc)。定义为:loss=a*lossobj+b*lossrect+c*lossclc,其中yolov5采用的是ciou loss来衡量矩形框的损失,定义为:ciou=diou-αv

[0082][0083][0084][0085]

上式中,p为框a和框b的中心点距离,c为框a和框b的最小包围矩形的对角线长度,v为框a、框b的宽高比相似度,α为v的影响因子,反正切arctan函数的取值范围是那么v的取值范围为0~1,当框a、框b的的宽高比相等时v取0,当框a、框b的的宽高比相差无限大时v取1,当框a、框b的距离无限远,且宽高比差别无限大时diou取-1,v取1,α取0.5,此时ciou取-1-0.5=-1.5,当框a、框b完全重叠时,diou取1,v取0,α取0,则ciou取1,因此ciou取值范围是-1.5~1。

[0086]

步骤5:加入自注意力机制,引入cbam模块,卷积块注意力模型中的通道注意力如图6所示。

[0087]

步骤5.1:cbam模块首先将f送入通道注意力模块,通过平均池化和最大池化得到每个通道的信息,并将得到的参数通过多层感知器进行叠加,再经过sigmoid函数激活,从而得到通道注意力特征mc(f);

[0088]

步骤5.2:将给定特征图f

x

送入空间注意力模块后,通过平均池化和最大池化沿通道维度汇聚空间信息,生成空间特征图f

avg

∈ri×h×w和f

max

∈ri×h×w,再通过1

×

1的卷积和sigmoid函数激活,得到空间注意力特征;接着与f

x

逐元素乘,最终得到空间注意力特征图fs;

[0089]

步骤5.3:在3个csp模块后分别引入cbam模块来解决原网络无注意力偏好问题;

[0090]

步骤5.4:结合注意力机制需要的参数以及自己模型的通道数等条件,改写yaml配置文件;

[0091]

步骤5.5:在解析文件中的函数里再编写一段代码,使得配置文件里写的参数适应配置文件中的width、depth的设置;

[0092]

步骤5.6:运行yolo文件,查看是否加入了相应模块。

[0093]

步骤6:准备工作完成开始训练数据集,将训练结果正确绘制在原始图像上。

[0094]

步骤6.1:训练模型准确度、召回率和平均精度均值如下图所示;

[0095]

步骤6.2:将预测的图像分割成四张912

×

608,提升检测精度,将红外图像测试数据集载入训练好的基于改进yolov5的红外图像小目标检测模型,输出红外图像测试数据集目标预测边界框。

[0096]

以上所述仅是本发明的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明原理的前提下,还可以做出若干改进和润饰,这些改进和润饰也应视为本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1