基于改进CenterNet网络的SAR图像舰船检测方法

本发明涉及合成孔径雷达图像目标检测领域,具体地说,是基于改进centernet网络的sar图像舰船目标检测方法。

背景技术:

1、合成孔径雷达(synthetic aperture radar,sar)是一种主动式的微波成像传感器。sar能够穿透云层,不受天气的影响,持续地成像来实现全天时全天候的海洋遥感的监测。而我国拥有广袤的海域,利用sar对海洋进行监测,开展研究基于sar图像的舰船检测,对保卫国家海洋安全,维护国家利益具有重要的意义。

2、利用sar图像进行舰船检测是存在困难的,影响sar图像舰船检测的性能主要由sar系统本身和海域环境的影响,由于相干斑噪声和散射成像的影响,其目标区域的像素散射强度不定,容易存在目标特征丢失的迹象。而且由于拍摄的角度与距离的影响,舰船的目标在较远海域时的尺寸会变小,就会检测不到目标存在。而对于近岸区域,会存在建筑物以及岛屿相似的散射特性,误认为是舰船目标,导致检测不精确。传统的舰船检测的方法,如恒虚警率(constant falsealarm rate,cfar)。对于大目标的舰船有一定的检测能力,但是对于远海的舰船目标和复杂场景仍然不能表现出很好的性能,且耗时长,难以用于满足舰船检测的基本要求。但是,随着硬件的升级以及深度学习的发展,对于舰船检测的任务上展现出强大的能力。

3、基于深度学习的目标检测算法,按是否利用锚框产生候选框,被分为基于锚框的检测方法和无锚框的检测算法,如ssd、faster r-cnn、mask r-cnn和yolo系列都是基于锚框的算法。确实,相比于传统算法是有很大的进步,但是他们都需要很大的锚框,需要用大量的锚框对真实框尽可能的重叠,可是只有一小部分能够重合,从而导致正负样本不平衡,减慢训练速度,还有就是需要很多超参数的引入,致使难以调通和通用。而无锚框检测的算法,大都采用关键点进行定位目标,减少大量的锚框的匹配计算,加快检测速度。centernet就是无锚框的检测算法,利用目标物体的中心点的特征信息完成对目标的定位于分类,其检测的速度和精度都取得不错的结果,但是对于小目标还是会将特征信息丢失,导致检测精度略低。

4、申请号为201910718858.4,名称为“基于边界约束centernet的遥感目标检测方法”的发明专利中披露了一种遥感目标检测方法,该方法利用级联多层的卷积层和采样层堆叠来提取特征信息,用边界约束卷积网络输出进行边界约束完成精度的提升。但是这类方法还是有许多问题,第一:对于sar舰船图像数据集中的选取的场景单一,样本数太少,不能完全体现该网络检测的泛用性。第二:不断地堆叠网络深度确实是对舰船的分类更加准确,但是会将关键的特征信息丢失,定位造成偏差,训练速度也会变慢。第三:生成的边界约束预测标签,对于虚假目标的预测框约束少,不能完全剔除虚假的预测框,造成总体损失的偏差,对于检测的召回率和速度指标影响太大。

技术实现思路

1、为了解决上述技术问题,本发明提供了一种基于改进centernet网络的sar图像舰船目标检测方法,该方法用repvgg网络代替网络中的主干网络进行图像的特征提取,减少网络深度,缩短训练时间,降低资源设备要求,提高检测精度。

2、为实现上述目的,本发明提供如下技术方案:

3、一种基于改进centernet网络的sar图像舰船检测方法,包括如下步骤:

4、步骤1、获取原始图像,对原始图像进行数据预处理,并进行数据增强,扩充数据集,将扩充后的数据集图片变成同一尺寸的分辨率,将他们划分为7:2:1的比例,依次作为实验的训练集、测试集和验证集;

5、步骤2、采用注意力机制增强的repvgg网络提取图像特征;

6、步骤3、将提取出来图像的特征图进行多尺度特征融合;

7、步骤4、将融合后的特征图进行预测,得到热力图、目标的宽、高和中心点的坐标;

8、步骤5、从热力图取出检测框,得到检测结果。

9、本发明进一步改进,步骤1具体数据增强操作包括随机裁剪出来的图片大小是原来图片大小的0.8倍到1倍之间,裁剪长宽比为4∶3;随机锐化增强采用usm锐化增强算法;亮度与对比度操作为调整图片的亮度为1.2,对比度为100;伽马校正算法的伽马值设为0.7。

10、本发明进一步改进,步骤2的具体流程如下:

11、流程2.1、特征提取主干网络采用的repvgg网络,通过重构的方式,将1*1的支链卷积和恒等映射合并到3*3的卷积堆栈中,减小模型参数量,即在训练时在每次卷积后都加入bn层,即归一化层,若使用表示在输入通道为c1,输出通道为c2时使用的卷积核为3×3大小,μ3,θ3,α3,β3分别表示为其后bn层中的均值、方差、学习比例因子和偏置量,当表示使用的为1×1的卷积核,μ1,θ1,α1,β1同样表示为其后bn层中的均值、方差、学习比例因子和偏置量,而对于只含有bn层的恒等映射层来说,则其参数因子表示为μ0,θ0,α0,β0,为表示输入,为输出,假设c1=c2,h1=h2,w1=w2的情况下,*表示卷积操作的过程,则训练时原始卷积块运算过程的数字形式由公式(1)表示为:

12、o2=bn{(o1*w3),μ3,θ3,α3,β3}

13、+bn{(o1*w1),μ1,θ1,α1,β1}

14、+bn{o1,μ0,θ0,α0,β0} (1)

15、在重新参数化的过程中,为便于卷积核的计算,将1×1的卷积核通过边缘补零的方式转换成同样的3×3形状;要进行统一操作,可将恒等映射的过程看作线性的过程,即可看作用单位矩阵进行转换;利用同样的操作原理,用边缘零填充得到3×3卷积核尺寸,最终通过卷积和叠加运算,将分支路径统一为3×3的卷积操作。则经过重新参数化的方式后,运算的方式由公式(2)表示为:

16、o2=o1*wi+b (2)

17、其中wi代表3×3卷积的卷积核大小;

18、流程2.2、将relu激活函数转换为mish函数,该函数更加的平滑,允许更好的信息深入神经网络,使得能够有更好的泛化性和准确性。原centernet网络加入relu(rectifiedlinear unit)激活函数是为了增加非线性因素,提高模型的表达能力。由该函数的公式α=g(x)=max(0,z)得出对于其他的激活函数能够更加有效率的梯度下降以及反向传播,避免梯度爆炸和梯度消失的问题。但是会在训练过程中容易出现神经元死亡,导致梯度为0。mish函数是一种自正则的非单调神经激活函数,比原函数更加的平滑,由该函数的公式y=x*tanh(ln(1+exp(x)))看出当正值达到任何高度时,避免由于封顶导致的饱和,而对于负值可以轻微的允许,不像原函数那样的硬零边界,让更好的信息深入神经网络中,更快的学习信息特征;

19、流程2.3、利用全局平均池化层对上一个卷积模块提取特征图的每个通道进行尺寸修改,完成降维,将降维后的特征图通过一维卷积减少特征映射的深度,提取输出的特征图,让所有的通道和k个邻居之间信息交互来提高主干网络的模型性能;

20、流程2.4、利用不降维的聚合特征为x∈rc',c'为通道维数,那么通道注意力可以通过公式(3)得到:

21、ω=σ(c1dk(x)) (3)

22、式中c1dk表示卷积核大小为k的快速的一维卷积,σ表示为sigmoid函数;ω表示通道的权重,k表示模块的参数个数;

23、流程2.5、对于k值的确定采用自适应的方式,其大小由通道维数c'的正比关系由公式(4)得到:

24、

25、式中,|*|odd表示最临近的奇数,c'为通道维数,γ和b在本次实验中分别设为2和1。

26、本发明进一步改进,步骤3的具体流程如下:

27、轻量级通用上采样算子(carafe)上采样主要分为两个部分核预测和特征重组;

28、流程3.1、将经过通道注意力增强的特征图的尺寸进行通道压缩,由c×w×h处理成cm×w×h的结果,来降低后续的计算量,cm为通道压缩后的通道数;

29、流程3.2、将内容编码卷积核尺寸为ken×ken的卷积核对上述压缩特征图进行内容编码得到尺寸为的特征图(为预测的上采样核尺寸)。在通道维数上展开,此时尺寸变为

30、流程3.3、利用softmax函数进行归一化处理,使得上采样核的权重之和为1,并将输入的特征图与预测的上采样核进行卷积得到最终的上采样结果,则carafe上采样过程的参数量由公式(5)表示为:

31、

32、本发明进一步改进,步骤4的具体流程还包括:

33、流程4.1、将经过特征金字塔网络融合后的特征图,进行预测而产生关键点的热力图当对应检测目标的中心点,为目标的背景,通过计算得到低分辨率上对应的关键点用高斯函数下采样后的关键点映射,得到特征图中心点的点权重,若对于同个关键点或同个类别c,当两个高斯函数发生重叠,则选择元素级最大的,训练目标函数,像素级逻辑回归的焦点损失lk由公式(6)表示为:

34、

35、式中,n表示图像关键点的个数,α和β表示焦点损失函数的超参数,x表示x轴坐标,y表示y轴坐标,z轴表示z轴坐标;yxyz表示高斯函数结果值,为热力图的预测值;

36、流程4.2、设特征提取网络输出的偏置值为r表示张量空间,h表示图像的高,w表示图像的宽,c表示图像的通道值,采用l1训练网络输出的偏置值由公式(7)表示为:

37、

38、其中,loffset表示目标偏移量的损失;n表示图像关键点个数,表示网络输出的偏置值,p表示目标框的中心点,r表示下采样的倍数,表示下采样之后的目标框的中心点,表示偏差值;

39、流程4.3、当第k个目标定位他的具体坐标与预测坐标产生偏差,采用l1损失对目标的长和宽进行训练由公式(8)表示为:

40、

41、其中,lsize表示目标尺寸的损失,n代表图像关键点的个数,表示卷积网络输出的结果,r表示张量空间,h表示图像的高,w表示图像的宽,c表示图像的通道值,sk表示目标框的长或宽;

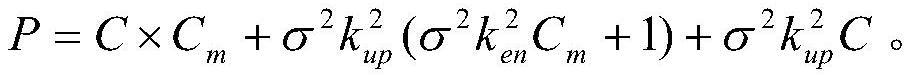

42、流程4.4、根据预设的权重,得到整体的损失函数由公式(9)表示为:

43、ldet=lk+λsuzelsize+λoffsetloffset (9)

44、其中,lk表示像素级逻辑回归的焦点损失,lsize表示目标尺寸的损失,loffset表示目标偏移量的损失,λsize表示lsize的权重,λoffset表示loffset的权重。

45、本发明进一步改进,步骤5的具体步骤为采用sigmoid函数将热力图归一化,利用3×3最大池化,得到热力图的关键点位置,根据分数查询是否为舰船目标;并通过对应的长、宽和中心点坐标,得出目标框的四个角点坐标,得出结果。

46、本发明的有益效果:本发明采用数据增强来扩充数据集,增加训练样本的多样性,提升模型的鲁棒性和泛化能力,降低模型对某些属性的依赖;本发明的特征提取网络采用repvgg网络,其架构简单强大,通过结构重新参数化,将训练过程和推理时间进行解耦实现精度与速度的完美兼得,提高优化能力;本发明在经过网络提取的特征图进行金字塔网络融合中,利用高效通道注意力模块避免降维和适当的跨通道交互显著降低复杂性时,完成高性能、高效率的学习,提升效果显著提升;本发明通过carafe上采样对不同位置生成不同的上采样核,充分增强网络特征图信息,在分辨率提高时,不会造成信息遗漏,降低误检和漏检。

- 还没有人留言评论。精彩留言会获得点赞!