一种小样本遥感图像场景分类方法与流程

本发明属于图像感知领域,特别是指一种小样本遥感图像场景分类方法,可用于对小样本遥感图像进行分类,为环境感知提供支撑。

背景技术:

1、遥感是远距离获取目标信息的一种探测技术,随着遥感技术的快速发展,遥感图像在军事和民用领域都发挥着越来越重要的作用。场景分类根据图像内容将每个遥感图像划分为不同的场景类别,是理解遥感图像的重要手段,可以实际应用于自然灾害检测、城市规划、环境监测、植被制图、土地覆盖分析等领域。

2、近年来,深度学习在遥感图像场景分类任务中取得了令人鼓舞的成绩。然而这些优秀的模型在很大程度上依赖于大量的标记训练样本。在实际应用中,由于遥感影像的特殊性,获取大量人工标注的高分辨率遥感图像是非常困难和耗时的,特别是对于军事设施等特殊场景(例如,导弹位置,军事区域)。一旦可用的标记数据不足,深度学习模型就会有过拟合的风险从而导致性能下降。因此,在标记样本较少的情况下,遥感图像场景分类问题已成为一项紧迫而重要的研究任务。

3、小样本场景分类网络可以直接对训练集中不存在的新场景进行分类,省去了标记图像以及重新训练的成本。但是现有的小样本图像分类网络通常是应用在自然图像,遥感图像与自然场景图像的差异非常显著。由于遥感图像以一种鸟瞰的俯视角度拍摄,不可避免地包含与场景语义类别无关的对象,会对分类性能造成不利干扰。例如在篮球场中,主要的目标物体是篮球场区域,但在图像中也存在一些不相关的物体,如汽车、建筑物和植物。类似的情况也出现在环形路口、田径场、高速公路等其余的场景中。

4、在基于度量的小样本学习方法中,深度近邻神经网络(deep nearest neighborneural network,dn4)是最先进的算法之一。基于度量学习的小样本方法主要依赖于对信息相似度量的学习,这些方法主要利用图像级别特征进行分类,而小样本条件下的图像级别特征往往较为稀疏,会丢失一些判别信息,这种损失往往是不可恢复的,并导致较差的分类性能。与一些小样本方法中的图像到图像度量方式相比,dn4网络受到朴素贝叶斯最近邻(naive-bayes nearest-neighbor,nbnn)的启发,利用深度局部描述子并采用图像到类度量的方式,直接计算查询图像的描述符与整个类之间的距离,有效地减轻了量化误差。dn4在小样本学习方面取得了突破,但由于遥感图像中背景十分复杂,模型容易受到无关局部特征的影响,该模型并不能直接应用在遥感场景。

技术实现思路

1、有鉴于此,本发明提出了一种小样本遥感图像场景分类方法,该方法采用基于注意力机制的深度近邻神经网络,实现了端到端的小样本遥感图像场景分类框架。

2、为了实现上述目的,本发明采用的技术方案为:

3、一种小样本遥感图像场景分类方法,包括如下步骤:

4、步骤1,将遥感图像场景分类数据集划分为训练集、验证集和测试集;

5、步骤2,基于上述数据集分别构建情景集;

6、步骤3,构建基于注意力机制的深度近邻神经网络模型;

7、步骤4,基于情景集对基于注意力机制的深度近邻神经网络模型进行训练及验证;

8、步骤5,基于情景集对训练好的基于注意力机制的深度近邻神经网络模型进行测试。

9、进一步地,步骤1所述的遥感图像场景分类数据集的划分方式为:

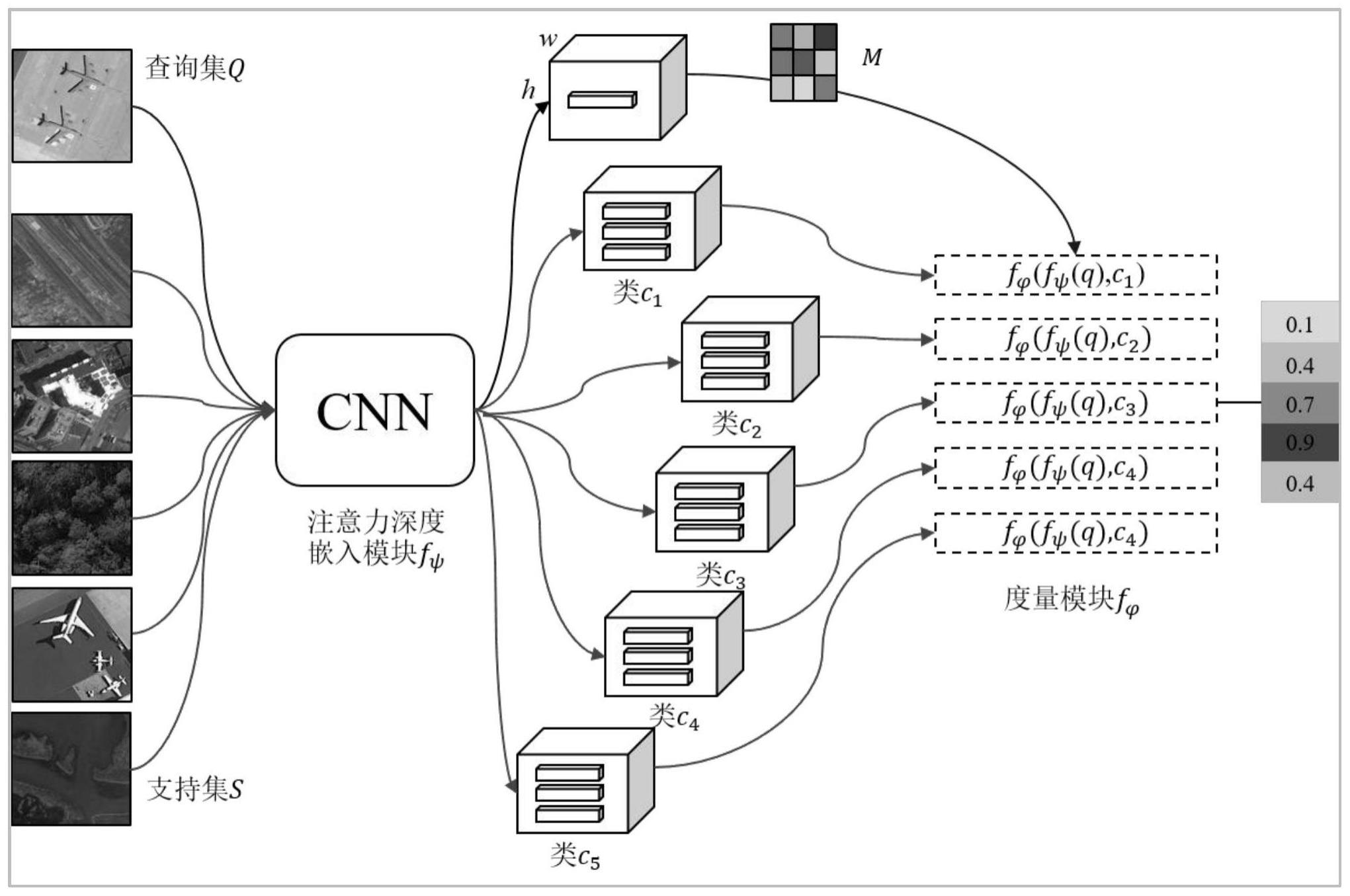

10、1a)将遥感图像场景分类数据集用dtotal表示,训练集用dtrain表示,验证集dval用表示,测试集用dtest表示;

11、1b)将遥感图像场景分类数据集中的一部分类别划分为训练集dtrain,将剩余的一部分类别划分为验证集dval,将最后的类别划分为测试集dtest;其中,dtrain∪dval∪dtest=dtotal。

12、进一步地,步骤2所述的基于情景训练方法构建情景集的具体方式为:

13、2a)从数据集中随机选取c个类别,每个类别k个样本,将抽取到的样本集合作为支持集s={(si,yi)|i=1,...,c×k},其中si表示支持样本集中的第i个样本,yi表示对应的标签;

14、2b)在支持集中每个类别的剩余样本中随机选取n个样本,得到对应的查询集其中qi表示查询集中第j个样本,表示对应的标签;

15、支持集与查询集不存在交集,即1个支持集和1个查询集构成1个情景集。

16、进一步地,步骤3所述的基于注意力机制的深度近邻神经网络模型的构建方式为:

17、3a)将基于注意力机制的深度近邻神经网络模型分为2个模块,分别为基于注意力机制的深入嵌入模块fψ(·)和度量模块

18、3b)基于注意力机制的深入嵌入模块fψ(·)的构建方式为:

19、3b-1)使用卷积神经网络conv-64f、vgg16、resnet18或resnet50作为深度嵌入模块;

20、3b-2)经过深度嵌入模块提取后的深度特征fψ(ximage)是一个大小为h×w×d的张量,其中w、h、d分别表示深度嵌入模块提取特征图的宽度、高度和通道数,将其视为m个d维的深度描述子的集合:

21、fψ(ximage)=[x1,x2,...,xm]∈rd×m

22、式中,m=h×w,xi是第i个深度局部描述子,rd×m表示元素为实数的d行m列矩阵;

23、3b-3)采用类别相关注意力模块为深度嵌入模块引入注意力机制,将深度局部描述子区分为与场景相关部分和不相干部分,即为由深度嵌入模块得到的特征图中的每一个像素点构建一个特征图,具体方式为,使用挤压激励网络作为基础模块,使用非局部注意力机制代替挤压激励网络中的全局平均池化操作,具体计算方式如下:

24、

25、式中,σ和δ分别表示relu激活函数和sigmoid激活函数;wz1和wz2均为全连接权重,分别用于按比例缩减和扩张特征图维度;np表示特征图像素的总数;fg(xjj)=wg·xjj;表示矩阵乘法;fk(xjj)与原始的非局部注意力模块相同,是计算沿着像素点jj的注意力特征图,计算方式如下:

26、fk(xjj)=softmax(wk·xjj)

27、3b-4)类别相关注意力模块的输出结果为权重向量[am1,...,amc],其中,c为特征图的通道数,am1表示第i个通道是否与场景类别相关,如果相关,ami=1,否则,ami=0,根据学习到的特征通道权值向量,进一步得到类别相关的注意力特征图,如下所示:

28、m(x)=sigmoid(∑amifi)

29、其中,fi代表的是第i个通道的特征,即把与场景相关的通道累加起来从而获取更加丰富的信息,然后经过sigmoid函数得到各个像素位置与场景类别相关的注意力特征图;

30、3c)度量模块的构建方式为:

31、通过深度嵌入模块,每个查询图像将得到m个描述子,对于每个描述子xi,基于k近邻方法在类别c中找到k个最近邻计算xi与之间的相似度;使用在基于注意力机制的深度嵌入模块中得到的注意力图,对描述子的相似度进行加权求和,计算方式如下;

32、

33、

34、其中,表示非定的查询图像q与类别c之间的相似度,xi表示查询图像q的第i个局部描述子,m表示局部描述子的总数,表示xi在类别c中的第j个最近邻,cos(·)表示两个向量之间的余弦相似度,m(xi)表示注意力特征图在xi位置处的响应度;

35、3d)将查询图像与各个类别的相似度作为预测类别的概率,网络的损失函数使用softmax损失来计算:

36、

37、其中,pi表示xi被正确分类的概率,n代表训练样本的数量,c代表类的数量。

38、进一步地,步骤4的具体方式为:

39、4a)在模型训练的一个迭代过程中,从训练集随机抽取情景集作为输入数据,进行前向传播,并通过损失函数的梯度下降来更新网络参数,最终学习一个训练良好的模型;

40、4b)在模型验证的一个过程中,从验证集随机抽取情景集作为输入数据,基于支持集对查询集的标签进行预测,取多个过程的平均正确率作为模型验证结果。

41、进一步地,步骤5的具体方式为:

42、在模型测试的一个过程中,从验证集随机抽取情景集作为输入数据,基于支持集对查询集的标签进行预测,取多个过程的平均正确率作为模型测试结果。

43、本发明与现有技术相比具有如下优点:

44、1、本发明针对遥感图像场景分类中场景背景复杂的问题,提出了基于注意力机制的深度神经网络模型,并引入情景训练方式,解决了小样本遥感图像场景分类问题。

45、2、本发明为了解决小样本场景下的图像级特征稀疏的问题,采用深度局部描述子进行特征表示,充分利用图像的局部特征。

46、3、本发明为了抑制图像中与场景类别无关区域的影响,引入了注意力机制得到场景类别相关的注意力图,将深度局部描述子区分为与场景相关和无关的两部分,避免场景图像中复杂背景的干扰。

47、4、本发明在度量模块计算查询图像的局部描述子与类别之间的相似性,并利用注意力图进行加权求和,求和结果作为最终的预测概率值。

- 还没有人留言评论。精彩留言会获得点赞!