基于多尺度细粒度哈希网络的跨模态遥感检索方法及系统

本发明涉及跨模态检索,具体涉及基于多尺度细粒度哈希网络的跨模态遥感检索方法及系统。

背景技术:

1、近年来,由于遥感卫星技术的进步,它在天气预报、环境监测和旅游导航等方面得到了广泛的应用,这也导致了遥感数据的爆炸性增长。因此,如何从海量的遥感数据中快速、高效和准确地提取预期目标成为研究人员关注和感兴趣的问题。

2、遥感数据检索方法一般可分为单模态检索和跨模态检索两大类。在单模态检索中,查询和检索数据属于同一模态,例如遥感图像检索,由于其数据类型相对单一,单模态检索往往能取得较好的检索效果。另一方面,跨模态检索是指查询和检索的数据处于不同的模态,而跨模态遥感图文检索在其中起着至关重要的作用,它通过给出查询的自然语言描述,从数据集中检索出视觉内容高度相关的遥感图像。

3、在跨模态遥感图文检索任务中,目前大部分工作通过将遥感图像和描述文本映射到一个公共的空间中来衡量它们之间的相似性。这些常见的公共空间特征学习方法需要占用大量的计算和存储资源,这在大规模的遥感图文检索任务中是很难实现的。

4、为了实现高效的检索速度和较低的存储开销,跨模态哈希方法受到了高度重视,并应用于高空间分辨率遥感图像中。虽然目前的跨模态哈希方法在遥感图文检索任务中取得了较好的性能,但其仍然存在以下问题:1)与自然场景图像相比,遥感图像中的显著地物较少,且地物的大小差异明显,这阻碍了检索模型对遥感图像内容的理解,导致跨模态遥感图文检索的准确性较低。2)现有跨模态哈希方法本质上是通过某种多标签格式来表示文本模态,将跨模态哈希检索转化为图像多标签匹配任务,然而多标签文本模态中包含较少的语义信息,忽略了日益丰富的遥感数据中许多细粒度语义信息(如时间、地点、目标状态等),导致跨模态遥感图文检索的全面性不高。3)遥感图像中存在大量冗余对象,这些对象表示了相同的特征和语义信息,严重影响了检索模型的学习和检索效率。因此,如何设计一种能够改善跨模态遥感图文检索准确性和全面性的高效方法是亟需解决的技术问题。

技术实现思路

1、针对上述现有技术的不足,本发明所要解决的技术问题是:如何提供一种基于多尺度细粒度哈希网络的跨模态遥感检索方法,能够提取遥感图像的多尺度融合图像特征以及描述文本的细粒度文本特征,并且能够通过视觉引导的方式实现图像特征和文本特征的动态学习融合,从而能够提高跨模态遥感图文检索的准确性、全面性和效率,并为跨模态检索提供一种新的思路。

2、为了解决上述技术问题,本发明采用了如下的技术方案:

3、基于多尺度细粒度哈希网络的跨模态遥感检索方法,包括:

4、s1:获取用户输入的遥感图像或描述文本作为待检索数据;

5、s2:将待检索数据输入经过训练的跨模态检索模型中,输出与其语义相关的文本或图像结果;

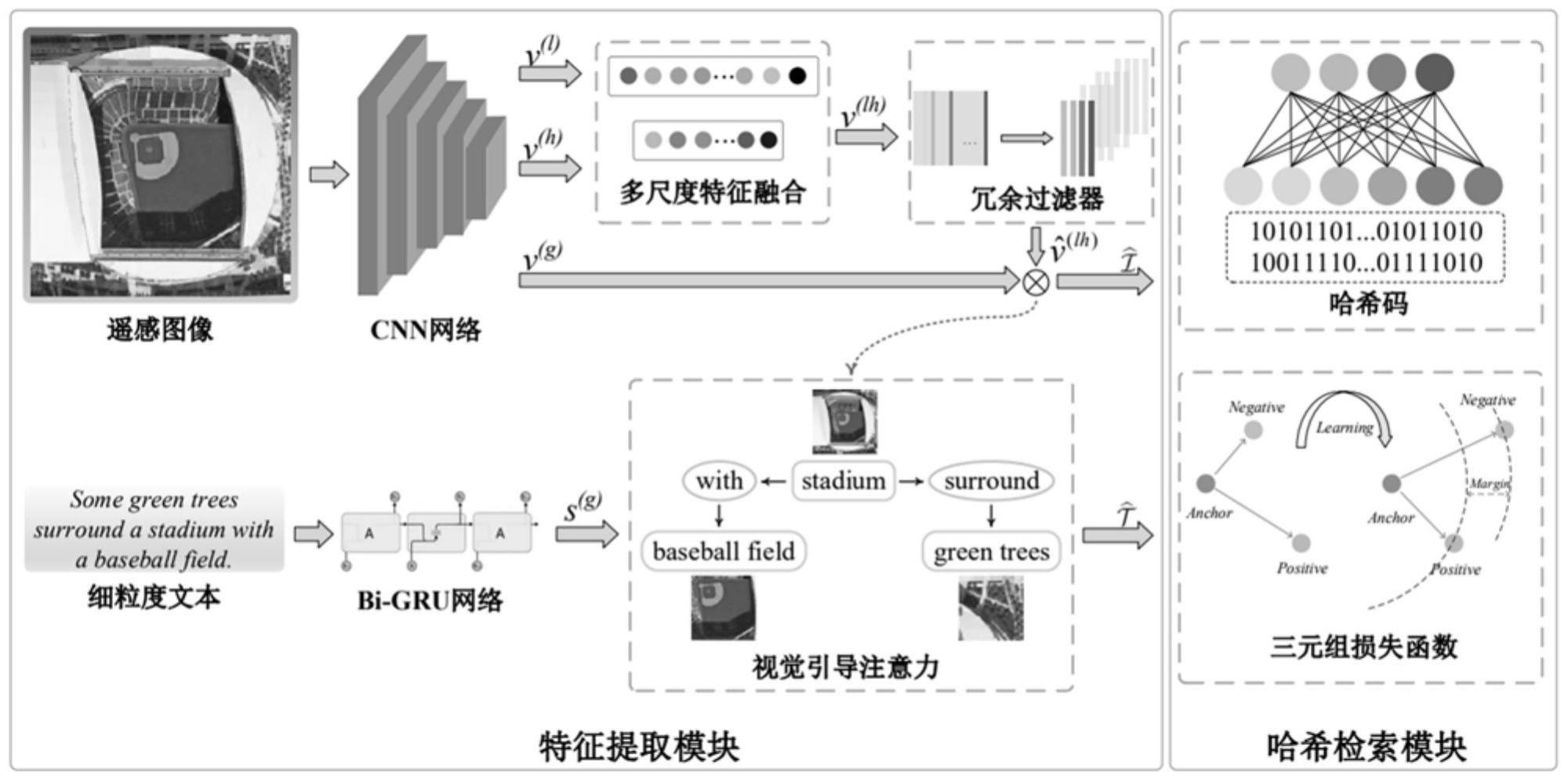

6、训练时,跨模态检索模型首先将用作训练样本的遥感图像及对应的描述文本作为模型输入;然后通过cnn网络和多尺度特征融合模块提取遥感图像的多尺度融合特征,并引入冗余过滤器去除重复特征,生成对应的图像特征;其次利用bi-gru网络和视觉引导注意力模块提取描述文本的细粒度语义特征,并结合图像特征进行视觉引导,生成对应的文本特征;再通过哈希检索网络将图像特征和文本特征转换为对应的二进制哈希码,进而计算对应哈希码的汉明距离并排序;最后通过损失函数优化哈希检索网络的网络参数直至收敛;

7、s3:将跨模态检索模型输出的与对应待检索数据语义相关的文本或图像结果作为对应的检索结果。

8、优选的,步骤s2中,通过如下步骤提取多尺度融合特征:

9、s201:通过预先训练的resnet模型提取遥感图像的图像全局特征v(g);

10、公式描述为:

11、v(g)=fcnn(i);

12、式中:v(g)表示图像全局特征;i表示输入的遥感图像;fcnn表示resnet模型;

13、s202:基于图像全局特征v(g),通过组合不同上采层的上采样特征生成对应的图像低级特征v(l)和图像高级特征v(h);

14、公式描述为:

15、

16、v(l)=cat({lk}k=1.2.3);

17、v(h)=cat({lk}k=4,5);

18、式中:v(l)表示图像低级特征;v(h)表示图像高级特征;cat表示特征连接;upsample表示上采样;lk表示第k层上采样层;

19、s203:通过3×3和1×1的卷积核分别对图像低级特征v(l)和图像高级特征v(h)进行下采样,并连接下采样后的图像低级特征和图像高级特征生成对应的多尺度特征

20、公式描述为:

21、

22、

23、

24、式中:表示下采样后的图像低级特征;表示下采样后的图像高级特征;表示3×3的卷积核;表示1×1的卷积核;prelu表示激活函数;

25、s204:将多尺度特征和平均化后的图像高级特征v(h)进行残差连接,生成对应的多尺度融合特征v(lh);

26、公式描述为:

27、

28、式中:v(lh)表示多尺度融合特征;average表示平均化操作;+表示特征相加。

29、优选的,冗余过滤器通过如下步骤生成图像特征:

30、s211:对多尺度融合特征v(lh)进行l2正则化,并通过1×1的卷积核进行下采样,得到第一滤波表示v(1);

31、公式描述为:

32、

33、式中:v(1)表示第一滤波表示;表示1×1的卷积核;l2(·)表示l2正则化;

34、s212:对多尺度融合特征v(lh)进行l2正则化,并通过1×1的卷积核进行下采样和激活函数,得到第二滤波表示v(2);

35、公式描述为:

36、

37、式中:v(2)表示第二滤波表示;σ表示激活函数;

38、s213:将第一滤波表示v(1)和第二滤波表示v(2)相乘,得到对应的多尺度滤波表示

39、公式描述为:

40、

41、式中:表示多尺度滤波表示;元素相乘;

42、s214:将全局图像特征v(g)和多尺度滤波表示相乘得到最终的图像特征

43、公式描述为:

44、

45、式中:表示图像特征;v(g)表示全局图像特征;表示多尺度滤波表示。

46、优选的,步骤s2中,通过wordpiece模型对描述文本进行分词,再通过预训练bi-gru网络提取描述文本的细粒度语义特征s(g);

47、公式描述为:

48、

49、

50、

51、式中:表示正向gru网络;表示反向gru网络;表示正向gru网络的隐藏状态;表示反向gru网络的隐藏状态;ek表示描述文本的第k个单词;s(g)表示细粒度语义特征,即文本全局特征。

52、优选的,步骤s2中,视觉引导注意力模块首先将图像特征和细粒度语义特征s(g)进行连接,得到对应的细粒度语义特征向量;然后将细粒度语义特征向量输入全连接层并结合激活函数进行相乘以实现视觉引导,进而生成对应的文本特征

53、公式描述为:

54、

55、

56、式中:表示文本特征;s(g)表示细粒度语义特征;表示图像特征;v(is)表示细粒度语义特征向量;σ表示激活函数。

57、优选的,步骤s2中,通过全连接层和符号函数将图像特征和文本特征转换为对应的二进制哈希码;

58、公式描述为:

59、

60、

61、式中:bi、bt表示图像特征和文本特征的二进制哈希码;表示文本特征;表示图像特征;fc表示全连接层;sign表示符号函数。

62、优选的,步骤s2中,哈希检索网络首先将图像特征和文本特征转换为一个固定长度的二进制哈希码,以使得不同模态的数据被统一到同一公共空间中;然后根据检索需求计算不同模态数据哈希码的汉明距离并排序,其中具有相似语义的数据对应的汉明距离越小;最后根据排序结果实现相似语义数据的检索。

63、优选的,通过如下公式计算不同模态数据哈希码的汉明距离:

64、

65、式中:d表示汉明距离函数;b1,b2分别表示不同模态数据的哈希码;n表示哈希码的长度;b[i]表示哈希码第i位的编码;表示异或操作。

66、优选的,步骤s2中,通过最小化如下的三元组损失函数实现哈希检索网络的网络参数优化:

67、

68、式中:l表示三元组损失函数;分别表示对应的负样本;α表示边际参数;sim(·)表示相似度计算函数;i、t分别表示输入的遥感图像和描述文本。

69、本发明还公开了基于多尺度细粒度哈希网络的跨模态遥感检索系统,基于本发明的跨模态遥感检索方法实施,具体包括:

70、数据收集模块,用于收集包含遥感图像及对应描述文本的训练数据集和测试数据集;

71、模型搭建模块,用于通过pytorch框架搭建跨模态检索模型;

72、模型训练模块,用于通过训练数据集和测试数据集对跨模态检索模型进行训练和测试;

73、跨模态检索模块,用于通过前后端网络架构搭建web检索平台,并将跨模态检索模型作为检索平台的算法后端,以处理用户的待检索描述文本:即根据用户输入的待检索描述文本输出遥感图像预测结果。

74、本发明中基于多尺度细粒度哈希网络的跨模态检索方法及系统与现有技术相比,具有如下有益效果:

75、本发明中,一方面通过cnn网络、多尺度特征融合模块和冗余过滤器提取遥感图像的多尺度融合图像特征,能够帮助检索模型更好、更全面的理解遥感图像内容,并有效适应遥感图像中显著地物较少且地物大小差异明显的特点,同时能够过滤图像特征中的冗余特征以提高检索效率;另一方面通过bi-gru网络和视觉引导注意力模块提取描述文本的细粒度文本特征,能够帮助检索模型捕捉遥感数据的细粒度语义信息(如时间、地点、目标状态等),并且能够通过视觉引导的方式实现图像特征和文本特征的动态学习融合,从而能够提高跨模态遥感图文检索的准确性、全面性和效率,并为跨模态遥感检索提供一种新的思路。

76、本发明通过哈希检索网络将图像特征和文本特征转换为对应的二进制哈希码,进而计算哈希码的汉明距离并排序,使得能够根据排序结果准确的检索出相似语义的数据,一方面将图像特征和文本特征转换成哈希码可以大幅减小后续检索系统的存储空间开销,同时保留了原始不同模态数据的语义信息;另一方面计算不同模态数据哈希码的汉明距离比直接进行多模态相似度的速度更快,能够大幅提高系统的检索效率,从而能够实现遥感图像和描述文本的高精度、高效跨模态检索。

- 还没有人留言评论。精彩留言会获得点赞!