一种基于忆阻器的文本情感检测系统及方法

本发明涉及文本情感识别,尤其涉及一种基于忆阻器的文本情感检测系统及方法。

背景技术:

1、随着web 2.0和5g网络的快速发展,互联网上大量的社交媒体已经影响到人们生活的各个方面。由于用户数量的增加,大量不同格式的数据被上传到网络上进行分享,包括照片、语音和文字。因此,大量的可用文本数据最近受到了很多关注。

2、由于nlp(情感分析、机器阅读理解)任务的扩展,深度神经网络(dnn)被广泛用于处理文本数据,包括循环神经网络(rnn)和长短期记忆(lstm)网络。虽然rnn和lstm网络都解决了文本信息处理中的一些问题,但它们仍然不能完全理解上下文关系。因此,基于注意力的网络被用来实现nlp任务,在处理上下文信息方面比rnn和lstm网络表现更好。新颖的网络模型transformer,利用多头注意力机制作为编码器和解码器,正在成为nlp中的一种计算范式。最近,有几项工作应用预先训练好的bert模型,也就是nlp中普遍使用的transformer的变体,来检测对话任务中的情绪,并得到了一个很好的分数。然而,由于基于注意力的网络模型的参数迅速增加,在将基于注意力的网络部署到嵌入式设备时,需要更多的内存和计算资源。另一方面,经典的冯-诺依曼结构将计算和内存单元分开,这被称为"内存墙",导致在执行大量数据传输时,能量开销和计算延迟增加。这表明,在实际应用中实现文本情感检测系统会受到内存墙的严重阻碍。特别是,社交媒体和其他应用程序已经可以应用于嵌入式设备,如手机、平板电脑,甚至是智能手表。因此,在嵌入式设备上部署文字情感检测系统是嵌入式应用的一个很有前景的方向。然而,为了克服内存墙的瓶颈,需要为嵌入式情感检测系统建立一个新的计算架构,为此,本实施例基于忆阻的神经形态计算系统提供了一个可行的解决方案。

3、忆阻器是一种理想的内存计算设备,因为它是一种双终端设备,具有动态电阻、低功耗和易于集成的特点。此外,忆阻交叉阵列已被证明可用于实现卷积神经网络(cnn)的硬件部署,也被广泛用于开发各种智能应用。然而,只有少数硬件解决方案被提出用于实现基于注意力的架构。目前通过使用忆阻器电路成功地完成了一个字符识别任务,证明了忆阻器可以被用来在硬件上部署基于注意力的网络。但仍有许多工作需要完成。首先,用于多层注意力网络的忆阻器硬件实现方案仍然是空缺的。此外,由于大量的网络参数和计算资源的开销,在嵌入式设备上实现文本情感检测仍然是一个巨大的挑战。

4、简单来说,文本对话中的情感检测在人机交互领域有广泛的应用。与检测单句不同,检测对话文本中的潜在情绪需要对上下文和局部信息之间的依赖关系进行建模。然而,传统的情感检测网络并不关注对话的局部和整体之间的内在联系。同时,由于情感检测网络的参数数量巨大,文本信息的规模巨大,目前将文本情感检测系统部署到嵌入式设备上仍具有挑战性。

技术实现思路

1、本发明提供一种基于忆阻器的文本情感检测系统及方法,解决的技术问题在于:如何关注对话的局部和整体之间的内在联系,以及如何降低网络参数数量以及系统面积。

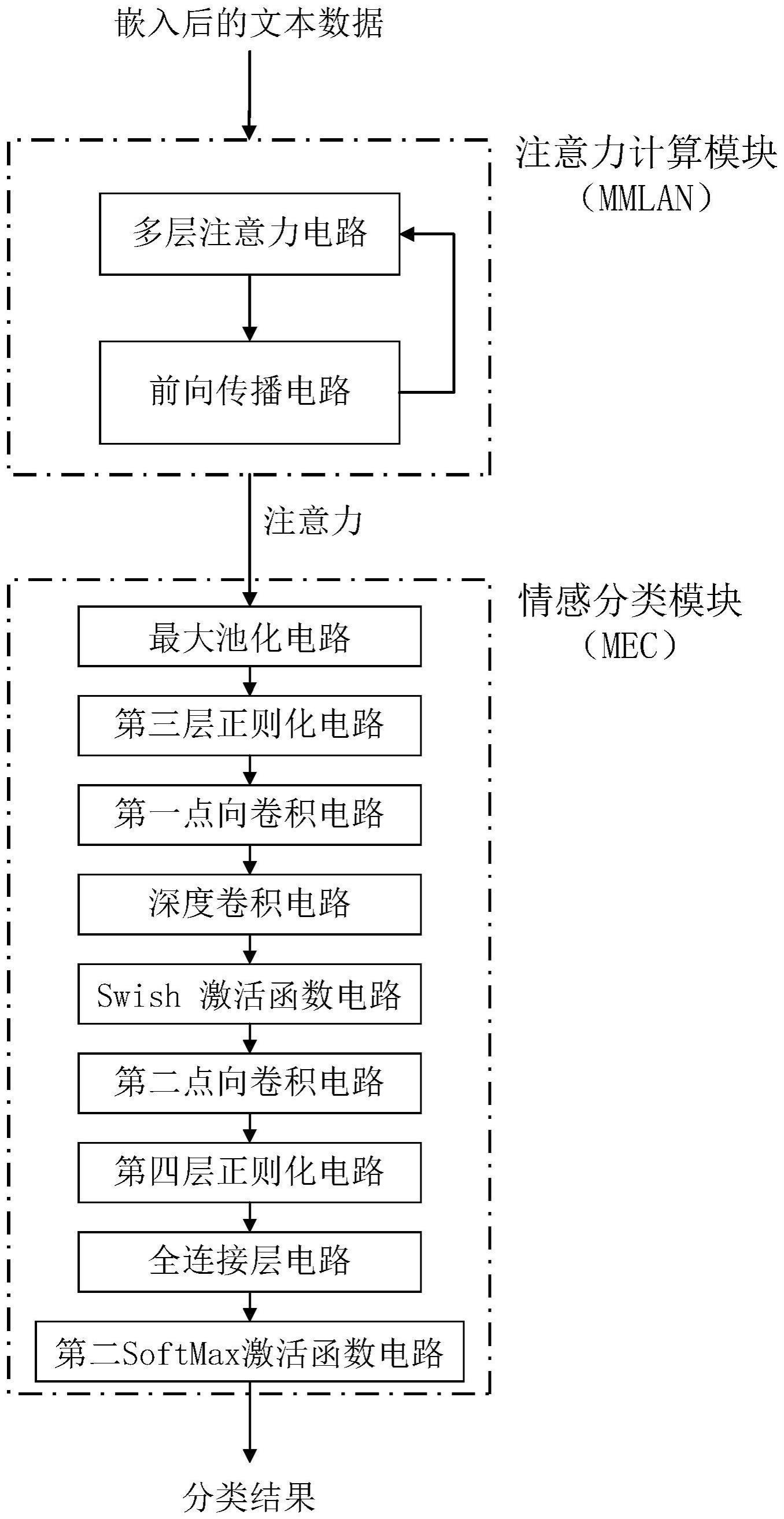

2、为解决以上技术问题,本发明提供一种基于忆阻器的文本情感检测系统,包括预处理模块、注意力计算模块和情感分类模块;

3、所述预处理模块用于输入话语文本数据并对话语文本数据进行位置编码和标记嵌入,得到嵌入后的文本数据;

4、所述注意力计算模块包括多层注意力电路和前向传播电路;第一层的注意力电路用于提取嵌入后的文本数据的多头注意力,所述前向传播电路用于将当前层的注意力电路的输出传播至下一层的注意力电路作为输入,直至最后一层注意力电路,得到最终的注意力输出至所述情感分类模块;

5、所述情感分类模块包括顺序连接的最大池化电路、第三层正则化电路、第一点向卷积电路、深度卷积电路、swish激活函数电路、第二点向卷积电路、第四层正则化电路、全连接层电路和第二softmax激活函数电路,用于对各自的输入执行对应的最大池化、正则化、点向卷积、深度卷积、swish激活函数计算、点向卷积、正则化、全连接和softmax激活函数计算操作,最后输出情感检测结果;

6、所述注意力计算模块中的注意力提取操作、权重映射操作和所述第一点向卷积电路、所述深度卷积电路、所述第二点向卷积电路、所述全连接层电路均基于忆阻交叉阵列构建,所述忆阻交叉阵列的每两列对应于神经网络中的正负权重,每两列的输出对应于一个输出电压。

7、具体的,所述注意力电路包括基于忆阻交叉阵列构建的多头注意力电路,用于存储电压信号的第一记忆单元模块电路,连接所述第一记忆单元模块电路的第一乘累加电路、第二乘累加电路,还包括第一softmax激活函数电路,所述多头注意力电路用于对嵌入后的文本数据进行多头注意力提取输出多头的q、k、v信号,所述第一乘累加电路用于对多头的q、k信号进行乘累加得到总的q、k信号,所述第二乘累加电路用于对多头的v信号进行乘累加得到总的v信号,所述第一softmax激活函数电路用于对总的q、k信号采用softmax函数进行计算,其计算结果与所述总的v信号进行权重相乘后输出至所述前向传播电路;

8、所述注意力电路的输出表示为:

9、

10、其中,concat{}表示进行串联,softmax()表示softmax函数,dh=d/h表示头的维度,h表示头的数量,d是输入q、k、v的维度,qh、kh、vh分别表示单头输出的q、k、v值,wz表示映射矩阵。

11、具体的,所述前向传播电路包括顺序连接的第一权重映射电路、第一层正则化电路、第二权重映射电路、第三权重映射电路和第二层正则化电路,还包括第二记忆单元模块电路;其中所述第二层正则化电路用于连接下一层的所述注意力电路,所述第二记忆单元模块电路用于存储前向传播过程中每一次计算得到的注意力;

12、所述第一权重映射电路、所述第二权重映射电路、所述第三权重映射电路均基于所述忆阻交叉阵列构建;

13、所述前向传播电路的前向传播过程表示为:

14、forward=ln{w3[w2(ln(w1·attention+b1))+b2]+b3},

15、其中,forward表示该次前向传播的输出,attention表示该次前向传播的输入,w1、b1分别表示所述第一权重映射电路的权重和偏置,w2、b2分别表示所述第二权重映射电路的权重和偏置,w3、b3分别表示所述第三权重映射电路的权重和偏置,ln()表示正则化函数。

16、所述深度卷积电路单通道的输出表示为:

17、

18、其中,k是深度卷积的核宽度,表示核权值,表示深度卷积电路的输入,u表示通道数;

19、所述深度卷积电路的输出表示为:

20、

21、所述第二点向卷积电路的输出表示为:

22、

23、wpw1、wpw2和wdw分别表示所述第一点向卷积电路、所述第二点向卷积电路卷积核和所述深度卷积电路的卷积核的权值,wp1表示第三层正则化电路的权重,max(vattenm,n)表示最大池化电路的输出结果,swish()表示swish函数。

24、具体的,所述情感分类模块还包括连接在所述最大池化电路、第三层正则化电路之间的第三记忆单元模块电路,连接在所述第一点向卷积电路与所述深度卷积电路之间的第四记忆单元模块电路,连接在所述第一点向卷积电路和所述第四层正则化电路之间的第五记忆单元模块电路,用于存储上级电路的输出信号并提供给下级电路。

25、具体的,所述第一记忆单元模块电路、所述第二记忆单元模块电路、所述第三记忆单元模块电路、所述第四记忆单元模块电路、所述第五记忆单元模块电路均基于记忆单元模块电路构建,所述记忆单元模块电路包括阵列式连接的多个记忆单元电路,所述记忆单元电路的个数与需要存储的电压信号个数相同;

26、对于所述记忆单元模块电路每一行的所述记忆单元电路,所有的所述电压信号输入端连接在一起,所有的所述电压信号输出端连接在一起,所有的所述第一mos开关的控制端连接在一起,所有的所述第二mos开关的控制端连接在一起;所述记忆单元模块电路按照时钟的节拍依次输入和输出电压。

27、具体的,所述记忆单元电路包括第一mos开关、第二mos开关、第一运算放大器、电容,所述第一mos开关的控制端与所述第二mos开关的控制端连接时钟控制信号,所述第一运算放大器的反向输入端连接所述第一mos开关的输出端,所述第一运算放大器的正向输入端连接所述电容后接地,所述第一运算放大器的输出端连接所述第二mos开关的输入端,所述第一mos开关的输入端用于作为所述记忆单元电路的电压信号输入端,所述第二mos开关的输出端作为所述记忆单元电路的电压信号输出端;

28、具体的,所述忆阻交叉阵列采用2m结构的忆阻器模型。

29、具体的,同时使用friends和emotionpush数据集来训练网络训练该文本情感检测系统,采用加权交叉熵用作训练损失。

30、本发明还提供一种基于忆阻器的文本情感检测方法,包括:构建文本情感检测系统,对构建的文本情感检测系统进行训练和测试,输入待检测文本至训练完成的文本情感检测系统,文本情感检测系统输出情感检测结果。

31、本发明提供的一种基于忆阻器的文本情感检测系统及方法,主要贡献在于:

32、1、提出了一个软件和硬件协同设计的文本情感检测系统(称为mteds),实现了网络模型mla-dscn的硬件部署,通过将系统中的线性映射和矩阵乘法操作采用忆阻交叉阵列构建,而其余电路模块也采用cmos技术组建。与传统的计算架构(gpu)相比,本发明所设计的硬件方案具有更低的功耗,同时减少了因内存和计算单元分离而造成的额外电路面积开销;

33、2、提出了一个名为mla-dscn的轻量级网络模型来实现文本情感检测任务,通过将深度分离卷积模块融合到网络中,改进后的网络模型mla-dscn不仅可以关注输入文本信息的全局信息,还可以提高其在局部层面的信息提取能力,在不牺牲精度的前提下,将网络参数的数量降低了3倍。

- 还没有人留言评论。精彩留言会获得点赞!