基于几何结构感知的内窥镜混合现实导航方法与流程

本发明属于混合显示导航领域,具体说是一种基于几何结构感知的内窥镜混合现实导航方法。

背景技术:

1、内窥镜检查可以看到x射线不能显示的病变。虚拟现实技术可以把原本在现实世界的一定时间空间范围内很难体验到实体信息,通过模拟仿真后再叠加到现实世界被人类感官所感知。目前,虽然混合现实技术为手术操作提供了极大的便利,但是仍旧无法将术前三维信息与实际操作中的视野信息同步。因此,采用虚实结合的混合现实技术可以有效解决上述问题。通过三维重建和空间映射模型,将虚拟的三维模型与合成图像进行虚实结合,为操作者提供更加真实的三维信息,方便更好的开展三维规划,提高操作的准确度和安全性。

2、现有内窥镜图像三维重构方法通过神经网络模型对内窥镜图像的当前帧进行深度估计并获取局部点云,通过扶镜机器人正运动学建模求解每一帧图像对应的相机位姿,实现点云拼接获取全局点云。该三维重建方法获得相机位姿的过程需要大量数学运算,很难适用于软组织变化的特点,点云更新过程很难满足实时性需求。现有内窥镜导航配准方法通过采集图像获取内窥镜的位置,利用光学导航设备进行坐标配准。该配准方法采用的外部光学导航设备不能获取到内窥镜的位置,因此很难应用于介入型内窥镜的混合现实导航。

技术实现思路

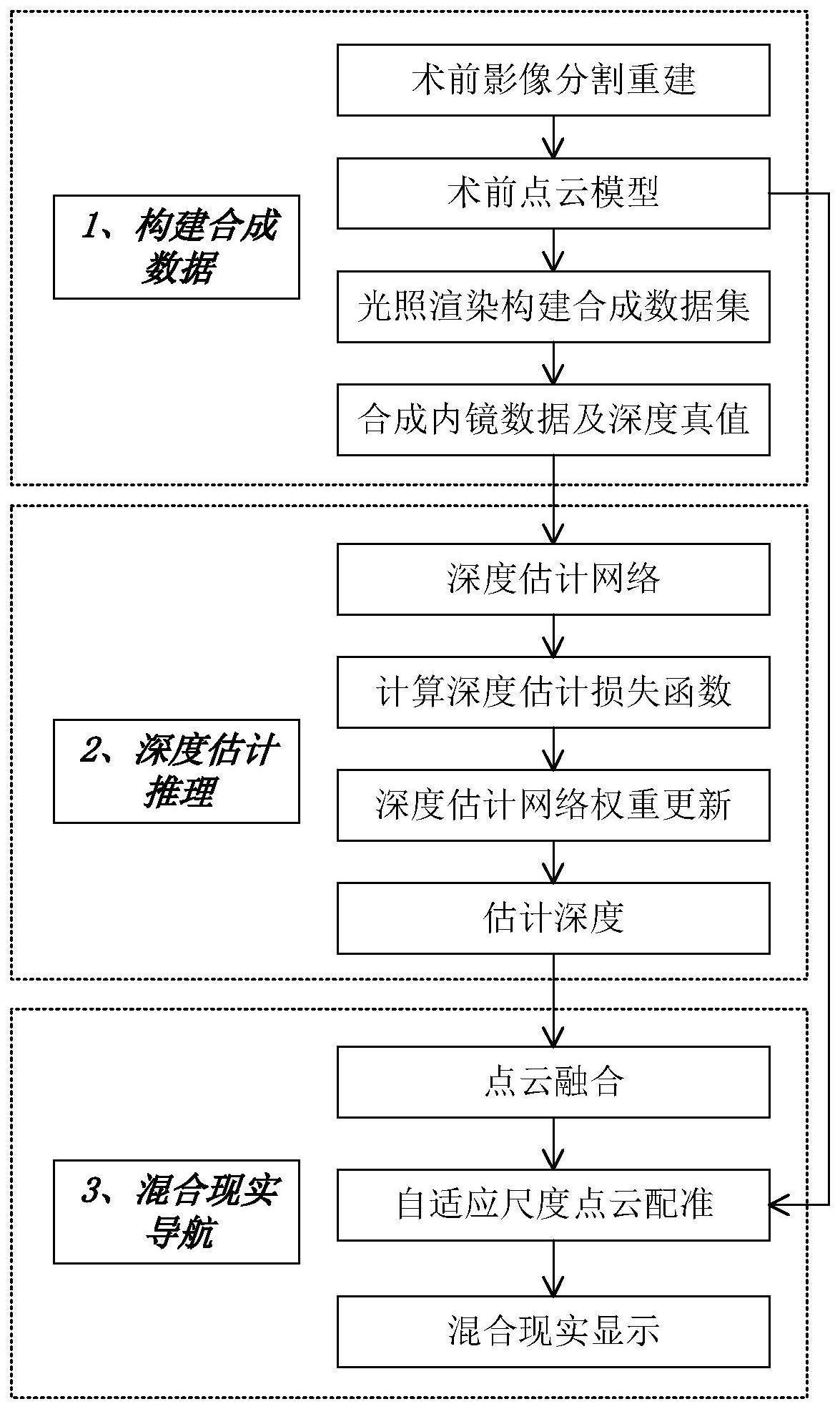

1、本发明提出了一种基于几何结构感知的单目内窥镜深度学习网络,用于内窥镜混合现实导航。首先,构建了一套用于训练神经网络合成数据集,用于深度估计训练;其次,将估计深度与重投影生成组织表面的三维形状;最后,通过自适应尺度配准方法将术前ct重建的三维模型与合成内镜图像的组织表面形状进行配准,生成混合现实导航模型。克服了现有方法中,由于内窥镜下组织纹理稀疏、内窥镜光照不稳定条件下内窥镜三维重建不准确的问题。

2、本发明为实现上述目的所采用的技术方案是:

3、基于几何结构感知的内窥镜混合现实导航方法,包括以下步骤:

4、构建内窥镜数据集;

5、构建并训练深度估计网络,通过训练好的深度估计网络对内窥镜数据集中的数据进行深度估计;

6、将估计出的内窥镜深度数据进行重投影,完成到内窥镜连续帧的点云;

7、通过自适应尺度的点云配准方法将内窥镜数据集中的腔道点云模型与合成数据重建的点云进行自适应尺度的配准,得到配准后的点云模型;

8、通过混合现实技术对配准后的点云模型进行可视化显示。

9、所述构建内窥镜数据集,包括以下步骤:

10、通过数据库获取人体腔道ct影像,并对其进行分割重建,得到重建后的腔道点云模型;

11、模拟内窥镜成像过程,迭代地对通道进行渲染,生成多个数据集的子集,对每个子集使用不同的颜色、纹理和光照强度,得到内窥镜的合成rgb图像与其对应的深度真值。

12、通过编码器-解码器结构构建所述深度估计网络,其中:所述编码器网络的主干为resnet18网络,并通过空间注意力模块对编码器网络进行修改,所述解码器网络由上采样卷积形成,在编码器网络和解码器网络之间的每个尺度的特征映射中建立跳过连接。

13、所述编码器网络为:

14、z=f(x,xt)g(x)

15、

16、其中,z表示块操作,g、θ、均表示最大池之后的卷积,ψ、σrelu分别表示卷积运算和relu激活函数,x∈rn×c×h×w表示输入数据,即合成rgb图像,其中,r表示实数集,n表示数量,c表示通道数,h表示高度,w表示宽度,输出f表示x上的像素级关系。

17、所述解码器网络为:

18、f=φ(z)+x

19、其中,φ表示上采样操作,f表示解码器输出。

20、通过构建几何结构感知的深度估计损失函数,对深度估计网络进行训练,包括以下步骤:

21、计算预测深度和地面真相的直接l1损失ldepth:

22、

23、其中,表示合成数据中的真值,表示深度的估计值;

24、计算边缘的梯度损失lgrad:

25、

26、其中,和分别表示对x和y方向求梯度;

27、计算由深度图生成的曲面法线的余弦相似性损失lnormal:

28、

29、其中,和表示预测深度和地面真相的正态值,<·,·>表示向量的内积;

30、计算平滑损失lsmooth:

31、

32、其中,表示对第i帧图像进行梯度运算;

33、深度估计网络的的总损函数ld为:

34、ld=λdepth(ldepth+lgrad+lnormal)+λsmoothlsmooth

35、其中,λdepth与λsmooth表示对应权重。

36、所述自适应尺度的点云配准方法,具体为:计算腔道点云模型和重建的全局点云之间的位置关系,作为比例因子,通过将比例因子直接集成到最小二乘问题中,得到旋转与平移矩阵以及腔道点云模型和重建的全局点云配准的尺度缩放因子。

37、通过最小化函数e(s,t),对平移t和统一比例因子s进行优化:

38、

39、其中,p表示腔道点云模型,q表示重建的全局点云,s∈r,t=[t0,t1,t2]∈r3×1;

40、即:

41、

42、其中,c和d表示系数,

43、基于几何结构感知的内窥镜混合现实导航系统,包括:

44、数据集构建模块,用于构建内窥镜数据集;

45、深度估计网络构建模块,用于构建并训练深度估计网络,通过训练好的深度估计网络对内窥镜数据集中的数据进行深度估计;

46、点云匹配模块,用于将估计出的内窥镜深度数据进行重投影,完成到内窥镜连续帧的点云;通过自适应尺度的点云配准方法将内窥镜数据集中的腔道点云模型与合成数据重建的点云进行自适应尺度的配准,得到配准后的点云模型;

47、可视化导航模块,用于通过混合现实技术对配准后的点云模型进行可视化显示。

48、一种计算机可读存储介质,所述存储介质上存储有计算机程序,当所述计算机程序被处理器执行时,实现所述的基于几何结构感知的内窥镜混合现实导航方法。

49、本发明具有以下有益效果及优点:

50、本发明提出一种适用于内窥镜场景的三维重建方法,而无需额外的双目内窥镜、电磁导航或者光学导航设备。形成可局部点云更新的全局点云模型,并与术前三维重建模型进行自适应尺度配准,实现混合现实导航显示。

技术特征:

1.基于几何结构感知的内窥镜混合现实导航方法,其特征在于,包括以下步骤:

2.根据权利要求1所述的基于几何结构感知的内窥镜混合现实导航方法,其特征在于,所述构建内窥镜数据集,包括以下步骤:

3.根据权利要求1所述的基于几何结构感知的内窥镜混合现实导航方法,其特征在于,通过编码器-解码器结构构建所述深度估计网络,其中:所述编码器网络的主干为resnet18网络,并通过空间注意力模块对编码器网络进行修改,所述解码器网络由上采样卷积形成,在编码器网络和解码器网络之间的每个尺度的特征映射中建立跳过连接。

4.根据权利要求3所述的基于几何结构感知的内窥镜混合现实导航方法,其特征在于,所述编码器网络为:

5.根据权利要求3所述的基于几何结构感知的内窥镜混合现实导航方法,其特征在于,所述解码器网络为:

6.根据权利要求1所述的基于几何结构感知的内窥镜混合现实导航方法,其特征在于,通过构建几何结构感知的深度估计损失函数,对深度估计网络进行训练,包括以下步骤:

7.根据权利要求1所述的基于几何结构感知的内窥镜混合现实导航方法,其特征在于,所述自适应尺度的点云配准方法,具体为:计算腔道点云模型和重建的全局点云之间的位置关系,作为比例因子,通过将比例因子直接集成到最小二乘问题中,得到旋转与平移矩阵以及腔道点云模型和重建的全局点云配准的尺度缩放因子。

8.根据权利要求7所述的基于几何结构感知的内窥镜混合现实导航方法,其特征在于,通过最小化函数e(s,t),对平移t和统一比例因子s进行优化:

9.基于几何结构感知的内窥镜混合现实导航系统,其特征在于,包括:

10.一种计算机可读存储介质,其特征在于,所述存储介质上存储有计算机程序,当所述计算机程序被处理器执行时,实现如权利要求1-8任一项所述的基于几何结构感知的内窥镜混合现实导航方法。

技术总结

本发明属于混合显示导航领域,具体说是一种基于几何结构感知的内窥镜混合现实导航方法。包括以下步骤:构建内窥镜数据集;构建并训练深度估计网络,通过训练好的深度估计网络对内窥镜数据集中的数据进行深度估计;将估计出的内窥镜深度数据进行重投影,完成到内窥镜连续帧的点云;通过自适应尺度的点云配准方法将内窥镜数据集中的腔道点云模型与合成数据重建的全局点云进行自适应尺度的配准,得到配准后的点云模型;通过混合现实技术对配准后的点云模型进行可视化显示。本发明无需额外的双目内窥镜、电磁导航或者光学导航设备。

技术研发人员:请求不公布姓名

受保护的技术使用者:沈阳术驰医疗科技有限公司

技术研发日:

技术公布日:2024/1/13

- 还没有人留言评论。精彩留言会获得点赞!