一种多相机无人系统的目标检测方法

本发明涉及图像检测,具体而言,涉及一种多相机无人系统的目标检测方法。

背景技术:

1、近些年来,随着科学技术的发展,移动机器人逐渐进入现代社会生活,并开始在工业、农业、医疗、生活等领域发挥越来越重要的作用。例如,家用机器人已经开始进入家庭和办公室,用于替代人类从事清扫、洗刷、安保等工作;配备有医疗诊断专家系统的医疗机器人,能够有效的帮助医生进行一系列的医疗诊断和辅助治疗,在有效的缓解医疗资源紧张的问题下推动医疗信息化的发展。

2、随着机器人市场的急速扩张和人工智能领域的发展,基于移动机器人的各类目标检测、识别或追踪技术也得到越来越多的研究者的关注。这其中,采用单个相机工作的系统受制于自身的硬件约束,如视频分辨率、传输问题等,尤其是其视野范围的限制,导致传统的获取视频图像技术无法满足对数据数量与质量的需求;相比之下,多相机协同工作可以弥补单个相机在工作时的局限性,但是存在多相机无人系统进行运动目标检测时,单相机视角受限,无法提供对目标的准确认知的问题。

3、为此提出一种多相机无人系统的目标检测方法,以解决上述提出的问题。

技术实现思路

1、本发明旨在提供一种多相机无人系统的目标检测方法,以解决或改善多相机无人系统进行运动目标检测时,单个相机获取到的信息十分有限,无法提供对目标的准确认知的问题。

2、有鉴于此,本发明的第一方面在于提供一种多相机无人系统的目标检测方法。

3、本发明的第二方面在于提供一种多相机无人系统。

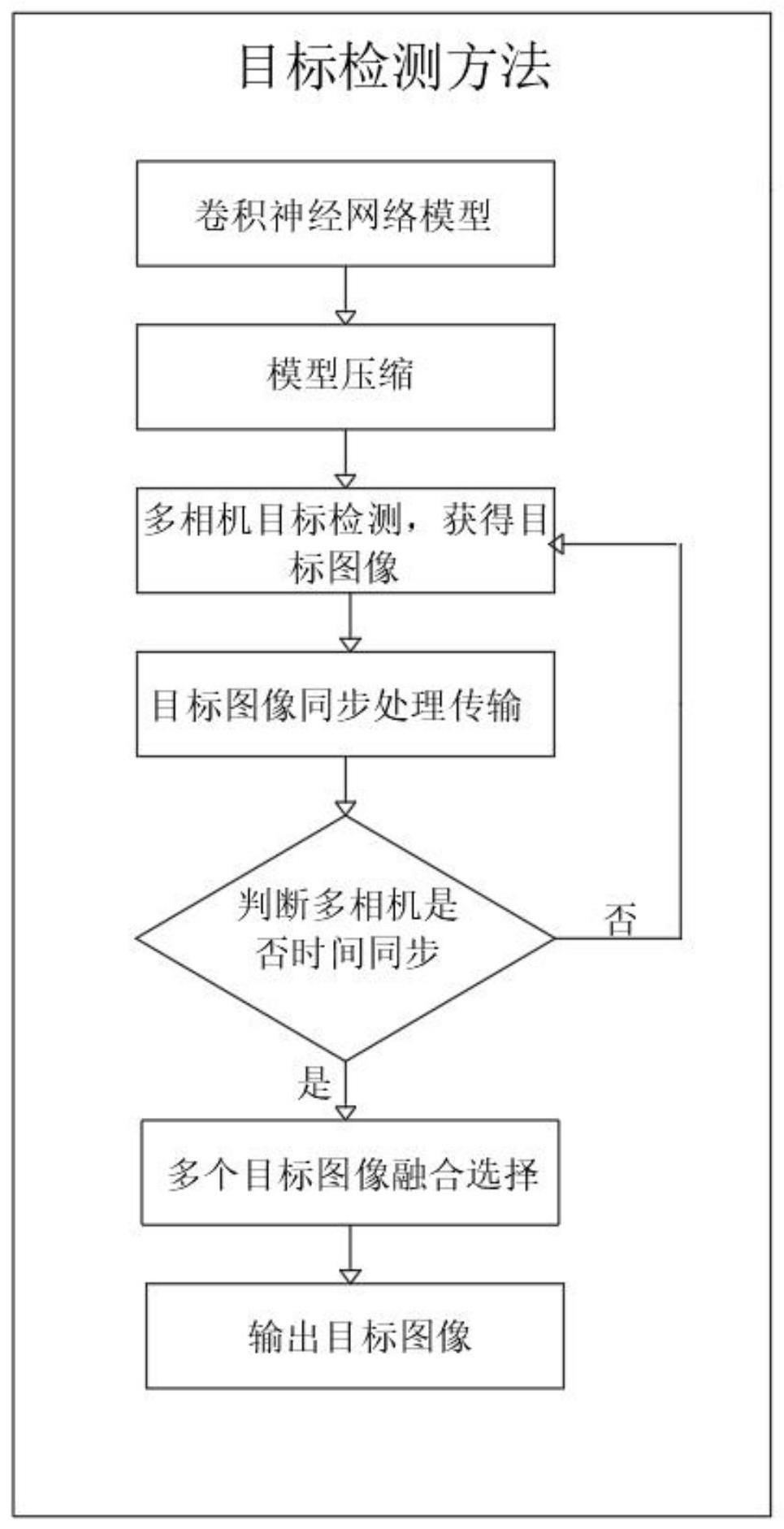

4、本发明的第一方面提供了一种多相机无人系统的目标检测方法,包括如下步骤:s1,创建具有四个特征尺度的卷积神经网络模型,并进行压缩,以降低所述卷积神经网络模型在无人系统的内存占用;s2,在所述无人系统与目标的相对运动过程中,通过压缩后的卷积神经网络模型基于多个相机同时进行目标检测,分别获得带有置信度的目标图像;s3,对同一时刻下所有的目标图像和置信度进行融合,并输出融合后的目标图像;其中,所述置信度为目标图像中的目标是检测的目标的概率。

5、本发明提供的一种多相机无人系统的目标检测方法,能够获得多个视角的信息,由于传统单个相机的工作模式大多是定点拍摄,导致视角固定,因此获取到的单视角信息无法提供对目标的准确认知,而在本专利的无人系统在球形钢体上多个位置上分别安装不同方向和视角的相机,能够获得相同目标的不同视角的信息,能够弥补单个相机相对角度变化时丢失的正面信息,也对遮挡问题提供了有效的解决途径;

6、扩大了观测范围,相比单个相机受制于自身视角范围,多个相机提供的视野信息会更丰富,并且使用多个空间位置不同的相机来采集视角不同的图像和视频,通过组合获取更丰富的不同维度和尺度的场景信息,获得更大的视角范围和更符合实际视觉效果的图像,在执行运动目标检测等任务时相比单相机系统具有明显优势;

7、并考虑实际的硬件部署条件,对卷积神经网络模型进行压缩,以见底模型在无人系统中内存占用大小,设计多相机同步及数据融合算法,融合多相机数据以获得最终的检测结果,保证球形系统进行目标检测任务的实时性和可靠性;

8、对具有四个特征尺度的卷积神经网络模型进行模型压缩,由于球形无人多相机系统平台的能力限制,其搭载的机载处理器的计算能力有限,而基于深度学习的目标检测算法虽然相对于传统的目标检测,在目标检测精度和速率方面都有很大的提升;但是,深度学习算法在运算资源有限且条件复杂的机载平台上移植时,必须要考虑运算资源占用的问题,因此,需要对目标检测算法进行优化,对神经网络模型进行轻量化处理,对模型进行压缩以减少参数量,在精度下降不大的情况下提高检测速度,以更好地适应机载平台硬件的特殊需求,完成目标检测任务;

9、对多相机同步及数据融合,融合多相机数据以获得最终的检测结果。对于多相机无人系统而言,协同多个相机进行目标检测能够获得多个不同视角的信息,为了更好的完成目标检测任务,需要对多个相机的数据经过特定算法进行融合处理,要对多相机提供的多源数据进行合理的支配与使用,以获取单个相机相对角度变化时丢失的目标的正面信息,得到当前时刻准确的目标检测结果。因此,针对球形无人多相机系统采用多相机同步及数据融合,能够提高目标检测的精度与可信度,并增加系统的容错能力。

10、另外,根据本发明的实施例提供的技术方案还可以具有如下附加技术特征:

11、上述任一技术方案中,所述s1中压缩的步骤,具体包括:在所述卷积神经网络模型中的卷积层和激活层之间添加bn层,并进行归一化处理;将归一化中的参数作为所述卷积神经网络模型的筛选参数,对所述卷积神经网络模型进行通道剪裁。

12、在该技术方案中,卷积神经网络模型随着网络深度的增加容易出现梯度爆炸和梯度消失的情况,而在卷积神经网络模型中的卷积层和激活层之间引入bn层进行归一化可以加快收敛速度,加快模型训练的速度,训练神经网络模型时,会根据训练过程中的损失函数是否收敛到一个足够小的数值,来判断模型是否完成训练,从而提高神经网络的泛化能力;

13、模型压缩具体方法为通道剪枝,模型中存在大量冗余参数,而过度参数化会导致卷积神经网络在预测目标时占用较多内存空间,降低检测速度,在使用数据集训练神经网络的过程中,采用通道剪枝的方法去除多余的网络参数、节点和权重连接,使网络结构更加精简;通道剪枝不是对个别权重进行修剪,而是对网络结构的一部分做剪枝或稀疏化。

14、具体地,首先是制作训练所用的目标数据集,利用数据集进行基础训练;然后设置学习率,对网络进行稀疏化训练,网络中许多缩放因子会趋近于零;之后进行通道剪枝,对缩放因子进行排序,并设置剪枝率,剪掉值较小的缩放因子对应的通道;最后根据剪枝前后的模型精度变化情况,决定是否使用再训练进行微调,这样就可以得到压缩后更加紧凑的卷积神经网络模型。

15、上述任一技术方案中,所述归一化处理采用下述公式进行:其中,zin为给bn层的输入值,由卷积层输出、zout为bn层的输出值,并输入到激活层、μ为当前小批量数据的平均值、σ为当前小批量数据的标准差、γ为归一化中缩放参数、β为归一化中平移参数、对输入进行归一化得到的值、ε为引入的偏差量。

16、在该技术方案中,通过归一化可将网络的输出规范为均值和方差相同的数据分布,解决每次迭代训练时由于数据分布不同导致的网络训练速度降低的问题;并且引入平移和缩放参数,来还原被归一化之前网络已经学习到的数据特征。

17、上述任一技术方案中,所述通道剪裁的步骤,具体包括:对所述卷积神经网络模型的每个通道进行稀疏化训练,并获取γ变化后的数值;设置筛选阈值并将变化后的γ作为筛选参数;将所有筛选参数低于筛选阈值的通道进行裁剪,并移除与被裁剪通道相连的神经元。

18、在该技术方案中,压缩模型时,以bn层的参数作为缩放因子,在每个通道进行稀疏化训练后,神经网络模型中的很多缩放因子会趋近于0,稀疏训练前后各通道因子的变化情况如图2所示。而后设置全局阈值为0.85,对近似为0的缩放因子剪裁通道,并移除其所有连接和相应的权重,这样可以去除85%的低比例因子,减少网络参数和相关的计算操作,节省运行时的内存占用。

19、上述任一技术方案中,所述卷积神经网络模型包括:特征提取网络,以及所述卷积神经网络模型的四个特征尺度分别为:13*13、26*26和52*52的基础特征尺度,以及104*104的新增特征尺度。

20、在该技术方案中,通过darknet53特征提取网络对输入图像提取特征,得到不同大小的特征图,其中,低层的特征语义信息比较少,但是目标位置信息准确,而高层的特征语义信息比较丰富,但是目标位置信息比较粗略,考虑到无人系统在进行目标检测任务时对小目标的检测需求,在yolov3的基础上增加了第四个特征层尺度。

21、上述任一技术方案中,所述的通过压缩后的卷积神经网络模型基于多个相机同时进行目标检测的步骤,具体包括:多个相机同时对目标拍摄视频,并获取视频中每一帧的相机图像;对同一时刻下的相机图像提取特征,获得每个相机图像的四个尺度的特征图;对四个尺度的特征图进行融合,以获得每个相机图像对应的带有置信度的目标图像。

22、在该技术方案中,球形系统的多个相机通过基于多尺度融合的卷积神经网络检测目标,由于多相机无人系统在协同多相机进行目标检测时,需要同时满足检测实时性以及对目标的检测精度的要求,而相对于传统的基于滑动窗口的目标检测,基于深度学习、卷积神经网络的目标检测使用选择性搜索算法产生候选区域提取特征进行分类和定位,在目标检测精度和速率方面都有提升。因此在one-stage目标检测算法yolov3的基础上,通过特征金字塔增加第四个尺度的特征层,即为104*104,进行多尺度融合,以提升算法对小目标的检测能力,实现小尺寸特征图检测大尺寸物体,而大尺寸特征图检测小尺寸物体。

23、上述任一技术方案中,所述的对同一时刻下的相机图像提取特征,获得每个相机图像的四个尺度的特征图的步骤,具体包括:在每个相机上,卷积神经网络模型的特征提取网络通过卷积操作获得13*13、26*26、52*52和104*104的特征图;复制52*52的特征图并进行二倍上采样,再对104*104的特征图进行张量拼接,以更新104*104的特征图。

24、在该技术方案中,首先将darknet-53网络去掉平均池化层和全连接层之后输出的52*52的特征图进行二倍上采样,使其输出的特征尺度由52*52提升至104*104,而后将其与骨干网络中提取到的104*104的特征图进行concat融合,以此获取更大的特征图进行小目标检测。

25、上述任一技术方案中,所述的对同一时刻下所有的目标图像和置信度进行融合的步骤,具体包括:对目标图像及其对应的置信度按照所述无人系统的中央处理系统的时间进行同步处理;根据ros平台的时间戳判断目标图像是否符合位于同一时刻,若符合则在同一时刻下保留置信度最大的目标图像,若不合符则删除当前时刻的数据并返回s1。

26、在该技术方案中,多相机同步要求的是不同相机的图像序列对于采集的起始时间有统一的对应关系,若无法实现同步,在后续的处理中就会导致误判现象,相机的同步主要是在多个相机之间建立起对应于时间的同步的图像采集系统;采用时间同步法,且具体:在进行运动目标检测时,对检测图像和结果数据按照中央处理系统的时间来进行传输和处理。并基于ros平台时间戳近似对齐的方法,进行多个相机是否同步的判断,实现多相机系统统一作业,完成运动目标检测识别的任务;

27、在对多相机的检测结果进行融合处理时,考虑到机载处理器的性能以及检测实时性与可靠性的要求,采用了基于决策级的数据融合方法,对获取到的各相机的结果数据进行综合决策,得出最终的判决结果,提高系统的容错性和可靠性,使其顺利完成任务;

28、对多相机无人系统中多个相机提供的多视角图像进行获取,通过基于多尺度融合的卷积神经网络检测目标,并将检测结果发送至数据接收节点。其次,数据接收节点接收到各相机的数据后,先进行同步判断,如果各相机同步,则进入到数据选择环节,否则继续等待下一时刻的数据。最后,在判定各相机同步后,根据其置信度结果进行数据融合与筛选,选择置信度最高的相机画面作为当前时刻目标检测的最终结果。

29、具体地,考虑到多相机无人系统的结构及设备性能,在多相机同步及数据融合时,采取了基于时间的近似同步方法,以及基于决策级的数据融合方法,以满足系统执行目标检测任务时对检测精度与速度的要求。

30、本发明的第二方面提供了一种多相机无人系统,所述无人系统能够进行滚动或航行,且无人系统包括:多个相互贴合固定的四旋翼无人机驱动模块,以组成球形钢体,且所述四旋翼无人机驱动模块为镂空设置;所述四旋翼无人机驱动模块包括:设置于所述球形钢体内部的旋翼、任务计算机、相机和惯性测量装置;其中,所述无人系统用于实施如第一方面中任一技术方案所述的一种多相机无人系统的目标检测方法。

31、本发明提供的一种多相机无人系统,由多个四旋翼无人机驱动模块构成,每一个单独的子模块上均安装有任务计算机、机载相机和惯性测量装置等设备,在拼合为球形滚动状态时,可将六个子模块视为一个统一的携带有六个摄像头的刚体。通过对无人机的控制、感知、规划的算法,能够实现复杂环境下无人机的自主定位、目标识别以及路径规划。

32、上述任一技术方案中,所述相机设置在所述四旋翼无人机驱动模块远离所述球形钢体中心的一端内壁,且位于所述内壁的边缘。

33、本发明与现有技术相比所具有的有益效果:

34、能够获得多个视角的信息,由于传统单个相机的工作模式大多是定点拍摄,导致视角固定,因此获取到的单视角信息无法提供对目标的准确认知,而在本专利的无人系统在球形钢体上多个位置上分别安装不同方向和视角的相机,能够获得相同目标的不同视角的信息,能够弥补单个相机相对角度变化时丢失的正面信息,也对遮挡问题提供了有效的解决途径;

35、扩大了观测范围,相比单个相机受制于自身视角范围,多个相机提供的视野信息会更丰富,并且使用多个空间位置不同的相机来采集视角不同的图像和视频,通过组合获取更丰富的不同维度和尺度的场景信息,获得更大的视角范围和更符合实际视觉效果的图像,在执行运动目标检测等任务时相比单相机系统具有明显优势。

36、根据本发明的实施例的附加方面和优点将在下面的描述部分中变得明显,或通过根据本发明的实施例的实践了解到。

- 还没有人留言评论。精彩留言会获得点赞!