一种基于注意力机制的等变弱监督语义分割方法

本发明涉及计算机视觉领域,具体是一种基于注意力机制的等变弱监督语义分割方法。

背景技术:

1、语义分割是计算机视觉领域一项基础性和关键性的任务,它旨在对图像进行像素级分类预测。近年来,随着深度学习的高速发展,语义分割模型不断优化,其性能取得了巨大进步,促进了智能驾驶、智慧安防、卫星遥感影像、医学图像分析等领域的发展。然而,语义分割需要大量的人工对其每个像素进行标注,这不仅昂贵还耗时。因此,许多工作开始倾向于采用弱监督语义分割(wsss),它通过弱监督方式,例如边界框、涂鸦和图像级分类标签,解决全监督语义分割需要人工逐像素进行标注的问题。而我们的研究就是关注图像级分类标签的弱监督语义分割。

2、据以前的研究工作所知,大多数图像级分类标签的弱监督语义分割,都是使用类激活图来生成初始伪标签。然而,类激活图通常只突出对象最具有辨别力的区域,并在背景区域中错误地激活,这可以分别概括为欠激活和过度激活;同时,当通过仿射变换增强图像时,生成的类激活图不一致。

技术实现思路

1、本发明的目的是针对现有技术中存在的不足,而提出一种基于注意力机制的等变弱监督语义分割方法,这种方法减少了人工标注所耗费的大量人力和物力,分割结果准确性高。

2、实现本发明目的的技术方案是:

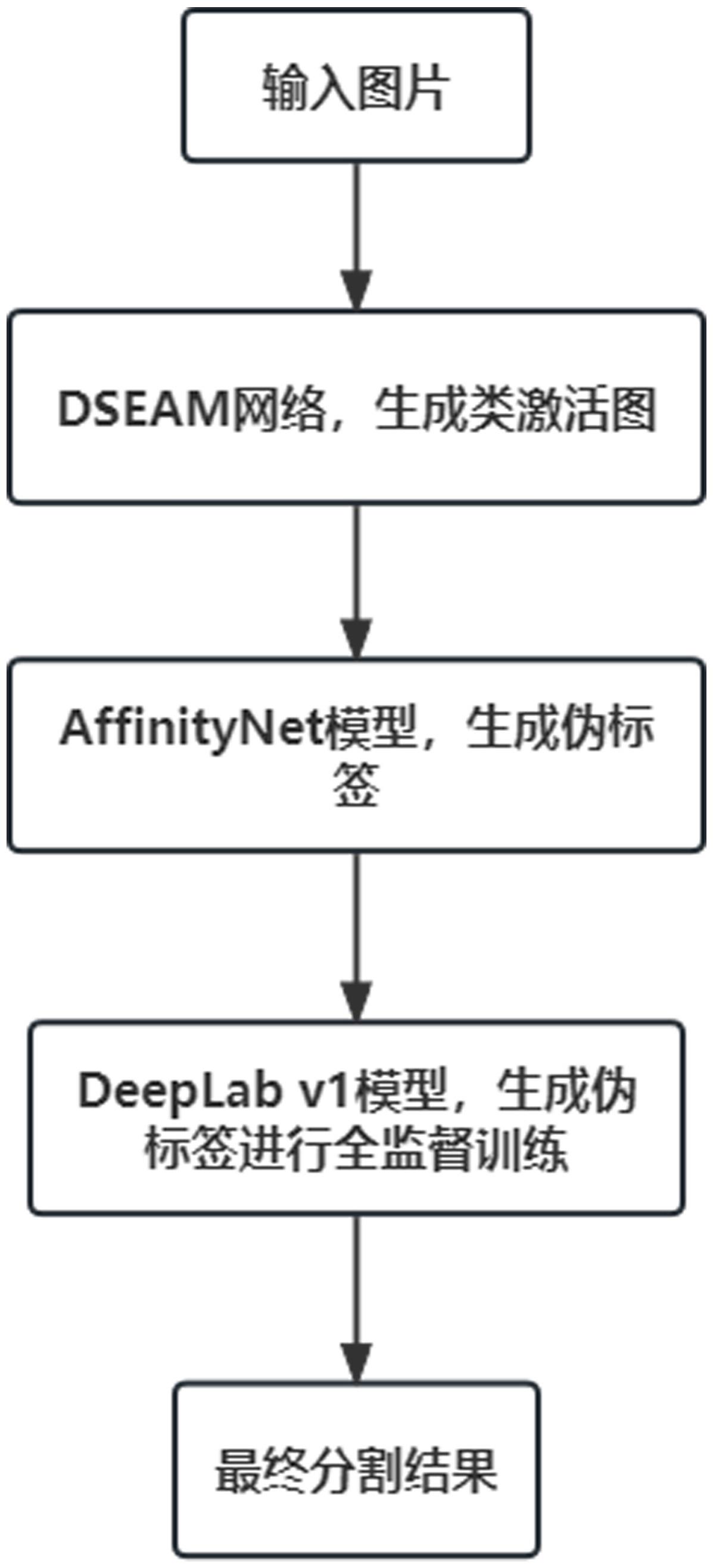

3、一种基于注意力机制的等变弱监督语义分割方法,包括步骤如下:

4、步骤1生成类激活图:

5、1.1将图片输入到拆除了relu层的resnet38分类网络中提取特征;

6、1.2再通过csm模块对重要但容易被忽略的特征即次要特征进行提取;

7、1.3接着提取的特征输入到cam中得到类激活图,记为输出1;

8、1.4将resnet38分类网络第四层和第五层的输出特征进行融合,然后将融合后的特征输入到像素相关模块pcm中对类激活图进一步捕获和修正,得到输出2;

9、1.5将图片进行缩放作为输入,并对其进行与步骤1.1-步骤1.4相同的操作作为补偿监督,得到输出3、输出4;

10、1.6最后,利用三个损失函数对得到的输出1、输出2、输出3和输出4进行调节,获得优化的类激活图;其中步骤1.1-步骤1.6为提出的dseam网络;步骤2将生成的类激活图输入到affinitynet模型中进一步细化,获得伪标签;

11、步骤3使用全监督方式即deeplab v1模型对步骤2生成的伪标签进行训练,其中deeplab v1模型中的vggnet网络替换为resnet网络,deeplab v1模型得到的预测结果作为最终分割结果。

12、所述步骤1.2中csm模块包括通道注意力模块和空间注意力模块;

13、先将输入特征送入通道注意力模块,在通道维度增强次要特征并抑制最敏感和最不敏感的特征,然后将输入通道注意力模块前的特征与经通道注意力模块的特征进行相乘,以实现在通道维度进行次要特征激活结果;记为输出特征1;再将输出特征1输入到空间注意力模块,对经通道维度增强的次要特征在空间维度上进行调整,同时对次要特征进行进一步的激活提取;接着将得到的输出与输出特征1相乘,得到增强后的次要特征;随后,使用relu激活函数提高对特征的敏感性,从而提高提取的准确性;最终得到经过csm模块的最终结果,其过程表示为:

14、

15、其中,f表示分类网络的输出,ca表示通道注意力模块,sa表示空间注意力模块,δ表示relu函数,表示逐元素乘法;

16、通道注意力模块能帮助主干网络在通道维度提取语义分割任务所需的区域,先将特征通过最大池化层和平均池化层提取增强其次要特征,后经全连接网络得到的输出进行补充调整,最后将得到的两个输出融合sigmoid激活得到增强的次要特征,具体操作表示为:

17、

18、其中,f为分类网络的输出,avg为平均池化,max表示最大池化,mlp为全连接层,表示sigmoid函数;

19、空间注意力模块能帮助主干网络提取空间维度语义分割任务所需的区域,输入特征先通过最大池化层和平均池化层进行次要特征区域激活,再将其进行融合卷积,以在空间维度进行特征重新提取,最后通过sigmoid激活得到输出,具体操作表示为:

20、

21、其中,f为分类网络的输出,avg为平均池化,max为最大池化,表示sigmoid函数,c7×7表示滤波器为7×7的卷积。

22、所述像素相关模块是自我注意力机制的核心部分,通过在网络末端加入像素相关模块,在等变正则化的监督下进行训练和修正,使用余弦距离来评估像素间特征相似度,同时以归一化特征空间中的内积来计算当前像素与其他像素之间的亲和力关系,relu激活相似性以抑制负值,最终cam是原始cam具有标准化相似性的加权总和,该过程可以表示为:

23、

24、所述步骤1.6中三个损失函数包括分类损失、等变正则化和交叉等变正则化,网络采用图像级分类标签作为弱监督标签信息,根据cam网络架构,在网络末端添加全局平均池化层获得对图像的分类预测向量z,和分别表示经过仿射变换网络两个分支的原始cam输出,y0和yt分别代表由pcm修正的两个分支的输出,分类损失lcls表示如下:

25、

26、

27、其中c-1表示除背景外的类别数,lcls表示单分支的多标签分类损失,z0和zt分别表示仿射变换网络两个分支的全局平均池化层聚合的预测向量;

28、等变正则化损失指图像经过仿射变换后生成的cam与原图像的cam保持相同的变换规则,保证等变性,等变损失ler表示如下:

29、

30、其中a表示仿射变换函数;

31、交叉等变正则化损失是指pcm的输出由孪生网络另一分支的cam输出进行监督,不仅能避免pcm的输出陷入局部最优解,还能避免在pcm修正过程中cam退化,交叉等变正则化损失lecr表示如下:

32、

33、网络的损失函数l表示:

34、l=lcls+ler+lecr (9)。

35、本技术方案与现有技术相比,具有以下有益效果:

36、本技术方案的方法仅需使用图像级别的标签就可以完成语义分割任务,极大减少了人工标注所耗费的大量人力和物力,与现有的弱监督语义分割方法相比,本方法分割结果更加准确。

技术特征:

1.一种基于注意力机制的等变弱监督语义分割方法,其特征在于,包括步骤如下:

2.根据权利要求1基于注意力机制的等变弱监督语义分割方法,其特征在于,所述步骤1.2中csm模块包括通道注意力模块和空间注意力模块;

3.根据权利要求1基于注意力机制的等变弱监督语义分割方法,其特征在于,所述像素相关模块pcm是自我注意力机制的核心部分,通过在网络末端加入像素相关模块,在等变正则化的监督下进行训练和修正,使用余弦距离来评估像素间特征相似度,同时以归一化特征空间中的内积来计算当前像素与其他像素之间的亲和力关系,relu激活相似性以抑制负值,最终cam是原始cam具有标准化相似性的加权总和,该过程表示为:

4.根据权利要求1基于注意力机制的等变弱监督语义分割方法,其特征在于,所述步骤1.6中三个损失函数包括分类损失、等变正则化和交叉等变正则化,网络采用图像级分类标签作为弱监督标签信息,根据cam网络架构,在网络末端添加全局平均池化层获得对图像的分类预测向量z,和分别表示经过仿射变换网络两个分支的原始cam输出,y0和yt分别代表由像素相关模块修正的两个分支的输出,分类损失lcls表示如下:

技术总结

本发明公开了一种基于注意力机制的等变弱监督语义分割方法,包括步骤如下:步骤1生成类激活图;步骤2将生成的类激活图输入到AffinityNet模型中进一步细化,获得伪标签;步骤3使用全监督方式即DeepLab v1模型对生成的伪标签进行训练,其中将DeepLab v1模型中的VGGNet网络替换为Resnet网络,DeepLab v1模型得到的预测结果作为最终分割结果。这种方法减少了人工标注所耗费的大量人力和物力,分割结果准确性高。

技术研发人员:刘建明,郑钊豪,黄光轮,张明和,甘镇

受保护的技术使用者:桂林电子科技大学

技术研发日:

技术公布日:2024/1/14

- 还没有人留言评论。精彩留言会获得点赞!