一种基于联邦学习的个性化交通标志判别方法

本发明属于图像识别领域,尤其涉及一种基于联邦学习的个性化交通标志判别方法。

背景技术:

1、随着互联网高潮的到来和无线网络的普及,网络边缘设备的数量及其本身产生的数据量在极速增长。车联网(iov)作为物联网中的一个重要场景,逐步走入人们的视野。英特尔的首席执行官brian krzanich曾表示:“数据是自动驾驶未来的新动力”。传统的机器学习的技术主要是通过将所有数据上传到中央服务器上统一进行处理。然而随着车联网场景中的车辆本身的数据量极速的增长,这种传统的机器学习方式存在三个缺点:用户隐私数据泄露:传统机器学习将数据上传至中央服务器再进行统一处理,极大的增加了车辆隐私数据泄露的风险,进而对车主本人造成难以预知的安全隐患;不同车辆的算力不均:不同厂家的车辆搭载了不同厂商的芯片如:nvidiadriveorin、mobileyeeyeq5、晓龙ride等,由于这些芯片的最大算力不同使得不同车辆之间的计算速度不均,导致在并行计算时算力充足的车辆需要等待算力不足的车辆计算完毕再聚合统一,严重影响通信效率;高时延的传输:由于车辆本地数据量的增加,其传输时延也必然增加,不满足车联网场景下的低时延需求。因此,相比于传统的学习方式,联邦学习的训练模式更适用于在大数据量的车联网环境中。

2、联邦学习是由谷歌在2016年率先提出的概念,做到了在保障数据隐私与安全及合法合规的基础上,实现数据共享,共同建模。其核心思想是在多个客户端共同参与模型训练时,不需要进行客户端数据流转的前提下,仅通过与服务器交互模型中间参数进行模型的联合训练,客户端的数据可以不出本地。这种方式实现数据隐私保护和数据共享分析的平衡,即“数据可用不可见”的数据应用模式。mcmahan设计了fedavg框架,并通过实验表明联邦学习的可行性,fedavg能够有效防止数据泄漏,保护数据的隐私安全。fedavg是联邦学习的原始框架,尽管可以处理一些轻微的非独立同分布的数据,但通信开销问题和异质性问题仍有待完善。尤其是在面对各个客户端数据非独立同分布并拥有不同的算力系统的时候,其表现的更加明显。针对这类问题,提出了各种解决方案,如基于交替方向乘法器(admm)的安全数据协调和联合计算程序等,然而这些方法大多只考虑到其中一方面并且计算与通信代价很高。针对这一挑战,一种可行的方法是设计一种个性化联邦学习算法。与其他方法相比具有明显的轻量级优势。目前,个性化联邦学习方法工作主要包括两类:(1)对本地模型进行优化,使其更加靠近与全局模型;(2)各个客户端本地自主的学习个性化模型,并在本地保留其特有的模型结构。然而,上述两类工作都是注重单一方向的优化,没能双向优化,这往往会在一些特定场景中表现不良。

3、同时,现有的网络模型复杂度较高。因为车载算力系统的性能通常较低,所以复杂的网络模型应用于车载算力系统进行交通标志判别会消耗大量的时间,并且也会消耗车载算力系统的大量性能,使车载算力系统的其他功能受到影响。各个用户的数据分布是不一样的,且其数据量的区别也很大。以往的设定各个客户端的数据是独立同分布这一假设是不切实际的。数据分布的不同与数据量的大小差异会对模型聚合带来强烈的负面影响,并且会严重浪费车载算力系统的算力。各个车载算力系统的算力是不尽相同的。因此如果统一计算轮次,则会导致通信的高延迟,不符合车联网这一动态场景。因此需要考虑拥有不同算力的客户端如何均衡其计算与模型性能。

技术实现思路

1、发明目的:为了解决背景技术中存在的问题,本发明的目的在于提供一种基于联邦学习的个性化交通标志判别方法。能够在保证客户端数据隐私安全的前提下,减少客户端的计算量,降低通信压力,提高通信效率。

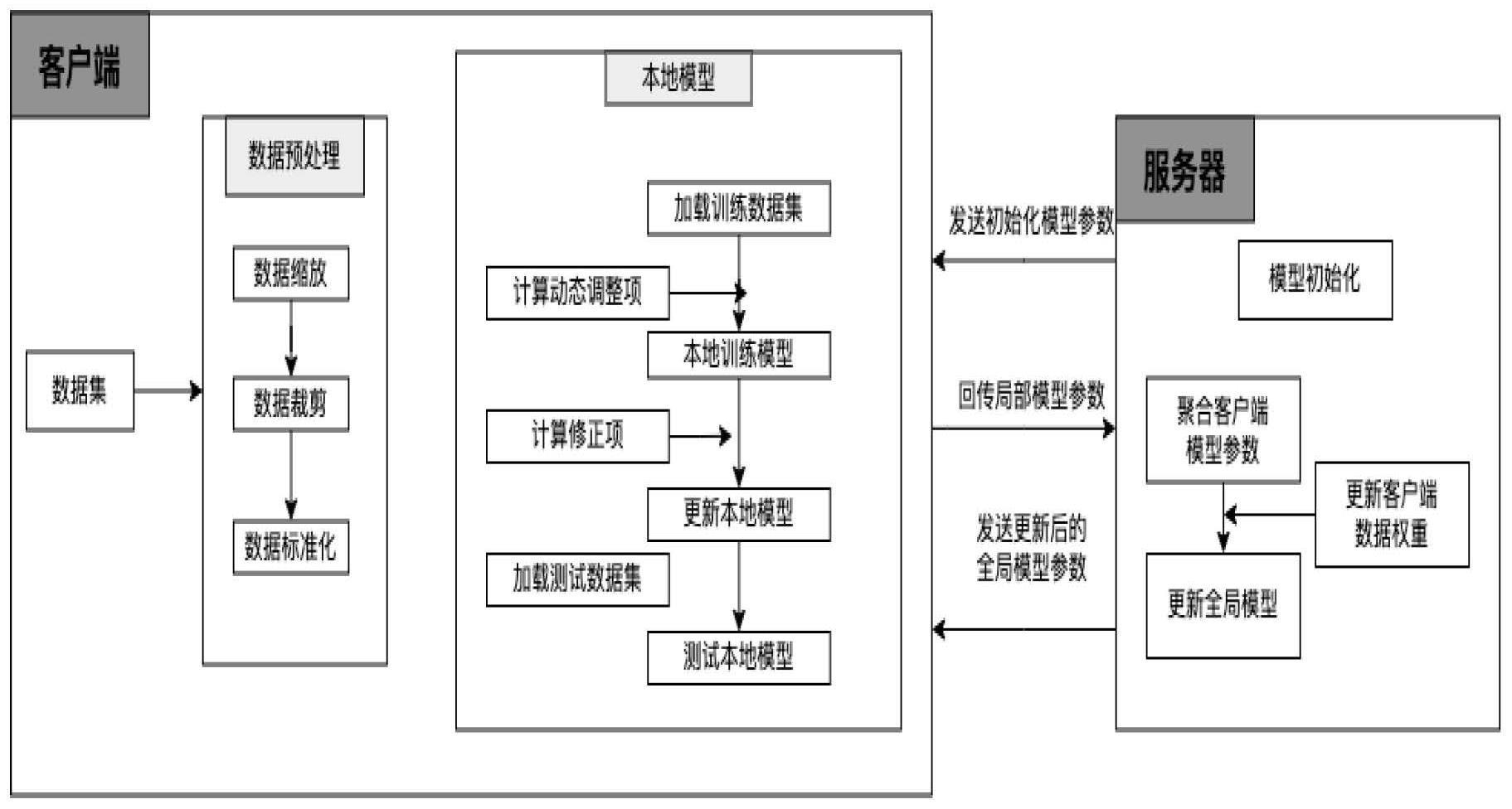

2、技术方案:本发明的一种基于联邦学习的个性化交通标志判别方法,其特征在于,包括如下步骤:

3、步骤1、在服务器设置预训练的初始化模型参数,将初始化模型参数发送至各个客户端;

4、步骤2、在各个客户端接收来自服务器端的初始化模型参数,利用初始化模型参数搭建模型,基于联邦学习算法对模型进行优化;

5、步骤3、获取个性化交通标志图片,并在各个客户端对个性化交通标志图片进行预处理;

6、步骤4、以预处理后的个性化交通标志图片作为输入,以图片类别作为输出,在客户端训练模型,基于客户端算力等级动态校准项设定计算轮次,在计算时加入修正项,利用梯度信息更新修正项,获得本地模型参数;

7、步骤5、服务器聚合各个客户端的本地模型参数后发至各个客户端;

8、步骤6、各个客户端接收到服务器聚合后的本地模型参数,将其加载进本地模型;

9、步骤7、根据梯度信息与修正项更新本地模型参数并判断训练是否达到预计目标或最大轮数,若没有,则返回步骤4继续训练模型,直到达到迭代次数输出模型,获得训练后的模型,并应用训练后的模型判别个性化交通标志。

10、进一步的,步骤2具体包括如下步骤:

11、步骤2.1、使用lenet5卷积神经网络搭建模型;

12、步骤2.2、初始化lenet5卷积神经网络模型的架构、设置损失函数和超参数,选择个性化联邦学习算法作为优化器,学习率设为0.005。

13、进一步的,所述超参数设置具体为:将本地批量大小设为32,本地迭代最大次数为20,本地模型松弛度为0.1,全局迭代次数为10,客户端数量为100,客户端采样比0.2。

14、进一步的,所述个性化联邦学习算法的目标是得到一个最小化损失的模型,其数学形式如公式(1)和(2):

15、

16、

17、其中,其中f(w)表示服务器模型的损失,fi(w)是客户端本地的损失函数,在服务器模型中,n是客户端数量,dn是当前客户端的数据量的大小,服务器根据各个客户端的数据量比例进行模型聚合,在客户端本地,在其计算损失函数时加入一项修正项其具体描述见公式(3):

18、

19、修正项通过迭代记录以往的梯度信息来保证模型更新时不会偏离于初始值。其中为当前客户端的当前梯度信息,为当前客户端的上一轮的梯度信息,为以往的批次信息。

20、进一步的,步骤3具体包括如下步骤:

21、步骤3.1、客户端对大小不同的交通标志的图片宽高缩放至64×64,然后对64×64大小的图片从中心裁剪至大小为32×32,最终保证所有的图片大小均是32×32;

22、步骤3.2、客户端对图片进行标准归一化处理,标准归一化如公式(4)所示:

23、

24、其中,将输入样本数据减去均值数据,并将结果除以标准差以获得标准归一化后的结果。

25、逐通道的对图像进行标准归一化,使得均值变为0,标准差变为1,使图片的每个元素在[-1,1]范围内。

26、进一步的,步骤3中,所述个性化交通标志图片是通过belgiumts和gtsrb数据集中采集获得。

27、进一步的,步骤4具体包括如下步骤:

28、步骤4.1、将各个客户端根据其本地算力大小分为四个等级,一次设有l0---l3四个算力等级,其算力大小依次减弱,客户端根据算力等级动态调整其本地迭代次数,最大不超过20次。然后各个客户端接收一个来自服务器的模型,在本地进行预训练,利用训练结果初始化修正项;

29、步骤4.2、遵循fedavg的算法步骤,首先本地循环训练时,会通过算力等级l来设置本地训练最大轮数,在客户端本地达到预期结果或最大轮数时,会自动结束训练;在每轮训练中,首先随机抽取样本并计算样本梯度信息,在拥有梯度信息后会对梯度进行信息裁剪,并利用梯度信息更新修正项;

30、步骤4.3、客户端发送本地模型参数给服务器。

31、进一步的,步骤5中服务器聚合各个客户端的本地模型参数,聚合方式如公式(1):

32、

33、其中,dn是各个客户端持有的数据集总数,d为所有客户端持有的数据集的总和,n为当前参与模型聚合的客户端总数,聚合后再下发至下轮参与训练的客户端。

34、有益效果:与现有技术相比,本发明具有如下显著优点:

35、(1)本发明使用的是结合aide和dane两种分布式方法的修正项与lenet5卷积神经网络。

36、由于目前的车载系统算力的性能较低,现有的网络模型复杂度较高,复杂的网络模型与大量的计算会消耗车载系统的大量性能和耗费大量的时间,而使用修正项与lenet5卷积神经网络可以在使用相对简单的七层网络结构情况下,通过修正项可以在相同的计算轮次中达到更优的精度以减轻各个客户端的计算,节省模型更新时间。

37、(2)本发明使用的是具有动态调整项的个性化联邦学习。

38、各个用户的车载算力系统不一样,导致其性能具有一定的差异。现有的大部分算法没有考虑到这一情况意味着对于相同计算需求,性能差的客户端会需要更多的时间来更新,从而增加了整体的时间损耗。因此,将动态调整项加入个性化联邦学习中,通过依据各个客户端的算力对其本地计算轮次进行动态设定,在几乎不影响精度的情况下减轻算力不足的客户端的计算压力,提高客户端与服务器之间的通信效率。

39、(3)本发明对联邦学习的各个客户端的更新过程加入新的修正项,此修正项结合了分布式方法dane和aide,通过修正项让客户端更新时参考全局模型更新方向,学习到全局模型的经验,使得各个客户端在本地更新的时候不会偏离全局模型的方向,从而减少了客户端不同的数据分布对模型聚合造成的扰动现象。除此之外,还需要设置一个能够让参与客户端根据其自身算力大小动态调整本地计算轮次的动态调整项,从而使得各个客户端模型根据其本地算力来进行相应的本地计算。通过这两种方法,能够在保证客户端数据隐私安全的前提下,减少客户端的计算量,降低通信压力,提高通信效率。最后得到一个适应各个用户算力与数据分布的交通标志判别模型。

- 还没有人留言评论。精彩留言会获得点赞!