语音交互方法、装置、设备及存储介质与流程

本技术涉及人工智能,特别涉及一种语音交互方法、装置、设备及存储介质。

背景技术:

1、随着人工智能技术的发展,智能语音交互迅速普及。其中,智能语音交互是基于语音输入的新一代交互模式,在多种应用场景下赋予设备“能听、会说、懂你”式的人机交互体验,使得人们可以通过询问设备来获取答案。

2、在语音交互过程中,如何确保语音交互质量非常重要。这是因为,设备输出答案是否准确会严重影响人机交互体验。倘若设备足够智能化,那么高概率会输出与用户期望匹配的答案。而若设备缺乏智能性,则输出答案的准确性将大幅降低。因此,如何实现更为智能的语音交互目前是本领域的一个讨论热点。

技术实现思路

1、本技术实施例提供了一种语音交互方法、装置、设备及存储介质,能够提高语音交互质量。所述技术方案如下:

2、一方面,提供了一种语音交互方法,所述方法包括:

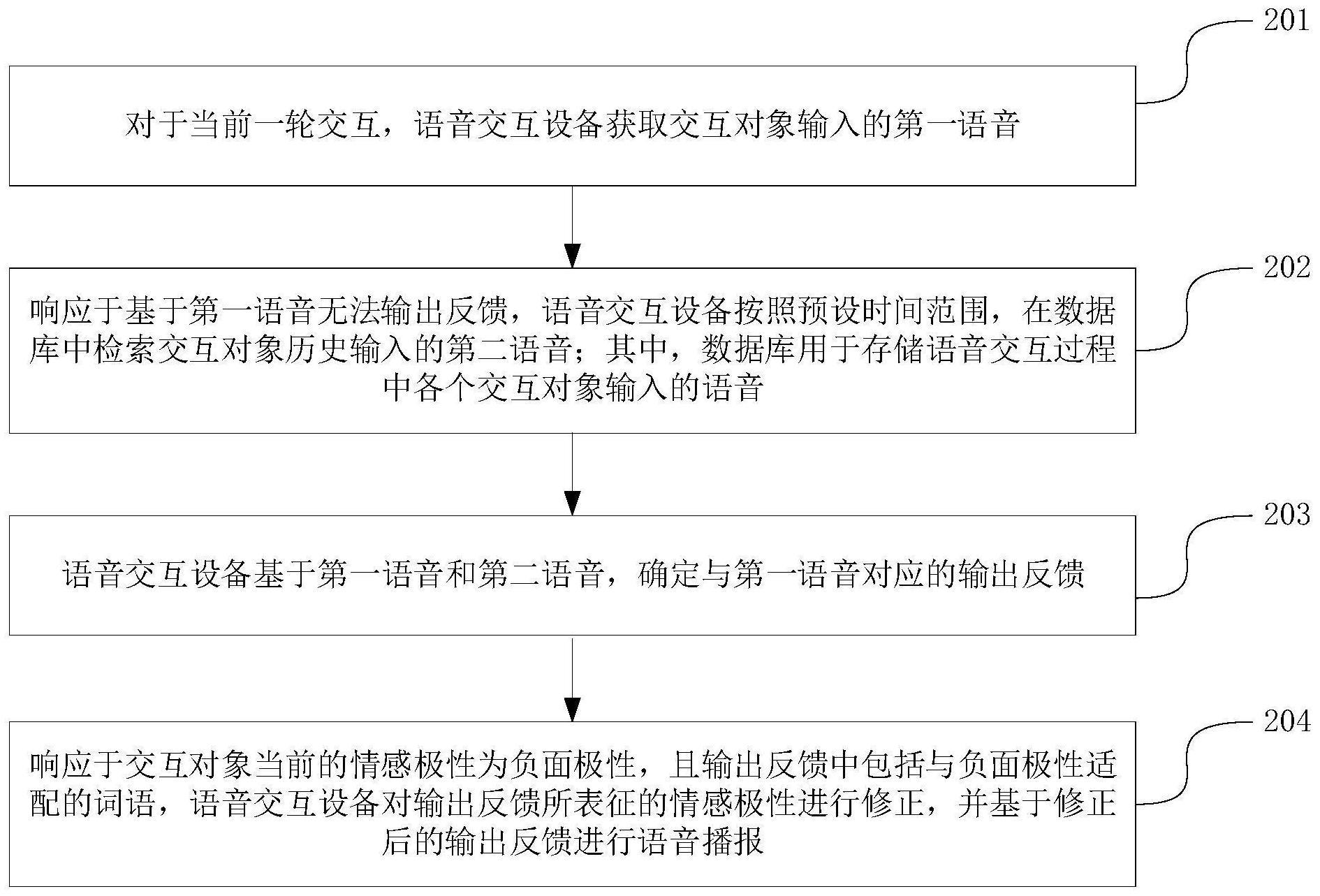

3、对于当前一轮交互,获取交互对象输入的第一语音;

4、响应于基于所述第一语音无法输出反馈,按照预设时间范围,在数据库中检索所述交互对象历史输入的第二语音;其中,所述数据库用于存储语音交互过程中各个交互对象输入的语音;

5、基于所述第一语音和所述第二语音,确定与所述第一语音对应的输出反馈;

6、响应于所述交互对象当前的情感极性为负面极性,且所述输出反馈中包括与所述负面极性适配的词语,则对所述输出反馈所表征的情感极性进行修正,并基于修正后的输出反馈进行语音播报。

7、在一种可能的实现方式中,所述对所述输出反馈所表征的情感极性进行修正,包括:

8、获取所述第一语音和所述第二语音的语义理解结果;

9、在词典中检索与所述语义理解结果适配且情感极性为正面极性的词语;

10、将与所述负面极性适配的词语替换为情感极性为所述正面极性的词语,得到所述修正后的输出反馈。

11、在一种可能的实现方式中,所述基于修正后的输出反馈进行语音播报,包括:

12、基于所述第一语音和第二语音,对所述交互对象进行属性分析,得到所述交互对象的属性特征;

13、基于所述第一语音,对所述交互对象当前所处的场景类型进行识别,得到场景类型;

14、基于所述交互对象当前的情感极性、所述场景类型、所述交互对象的属性特征中的至少一项,确定播报音量和播报声音类型;

15、按照确定的播报音量和播报声音类型,基于所述修正后的输出反馈进行语音播报。

16、在一种可能的实现方式中,所述基于所述第一语音和所述第二语音,确定与所述第一语音对应的输出反馈,包括:

17、按照所述第二语音的识别文本在前、所述第一语音的识别文本在后的顺序,对所述第一语音的识别文本和所述第二语音的识别文本进行拼接;

18、基于自然语言理解模型和知识库,对拼接文本进行语义理解,得到语义理解结果;

19、生成与所述语义理解结果适配且采用自然语言形式表述的输出反馈。

20、在一种可能的实现方式中,所述数据库用于对应存储各个交互对象的声纹模板与语音交互过程中的输入语音;所述按照预设时间范围,在数据库中检索所述交互对象历史输入的第二语音,包括:

21、基于所述交互对象的声纹模板,在所述数据库中检索所述交互对象在所述预设时间范围内输入的历史语音;

22、响应于所述历史语音的条数为多条,将所述历史语音中输入时间距离当前最近的n条语音作为所述第二语音;或,将所述历史语音中与所述第一语音归属于同一主题的语音作为所述第二语音;其中,n为正整数;

23、在一种可能的实现方式中,所述方法还包括:

24、在输出声纹录入指令后,获取所述交互对象的预设时长语音;

25、对所述预设时长语音进行声纹特征提取,得到原始声纹特征;

26、基于所述预设时长语音,分别对所述交互对象进行属性分析、状态分析和语速分析,得到所述交互对象的属性特征、状态特征和语速特征;

27、对所述原始声纹特征、所述交互对象的属性特征、状态特征和语速特征进行特征融合,得到所述交互对象的声纹模板。

28、在一种可能的实现方式中,所述方法还包括:

29、基于与当前识别场景匹配的语音识别模型,对所述第一语音进行语音识别;其中,识别场景包括第一识别场景和第二识别场景,所述第一识别场景的识别距离大于第二识别场景的识别距离;

30、基于目标语言模型对得到的识别文本进行文本情感分析,得到所述交互对象当前的情感极性;

31、其中,所述目标语言模型是基于训练语料对预训练模型进行再训练得到的。

32、在一种可能的实现方式中,所述方法还包括:

33、响应于在所述数据库中未检索到所述交互对象历史输入的第二语音,将所述第一语音存储至所述数据库;

34、响应于所述数据库中存储的语音的数据量超过预设阈值,按照先进先出的规则进行数据删除。

35、另一方面,提供了一种语音交互装置,所述装置包括:

36、获取模块,被配置为对于当前一轮交互,获取交互对象输入的第一语音;

37、检索模块,被配置为响应于基于所述第一语音无法输出反馈,按照预设时间范围,在数据库中检索所述交互对象历史输入的第二语音;其中,所述数据库用于存储语音交互过程中各个交互对象输入的语音;

38、生成模块,被配置为基于所述第一语音和所述第二语音,确定与所述第一语音对应的输出反馈;

39、修正模块,被配置为响应于所述交互对象当前的情感极性为负面极性,且所述输出反馈中包括与所述负面极性适配的词语,则对所述输出反馈所表征的情感极性进行修正;

40、输出模块,被配置为基于修正后的输出反馈进行语音播报。

41、在一种可能的实现方式中,所述修正模块,被配置为:

42、获取所述第一语音和所述第二语音的语义理解结果;

43、在词典中检索与所述语义理解结果适配且情感极性为正面极性的词语;

44、将与所述负面极性适配的词语替换为情感极性为所述正面极性的词语,得到所述修正后的输出反馈。

45、在一种可能的实现方式中,所述输出模块,被配置为:

46、基于所述第一语音和第二语音,对所述交互对象进行属性分析,得到所述交互对象的属性特征;

47、基于所述第一语音,对所述交互对象当前所处的场景类型进行识别,得到场景类型;

48、基于所述交互对象当前的情感极性、所述场景类型、所述交互对象的属性特征中的至少一项,确定播报音量和播报声音类型;

49、按照确定的播报音量和播报声音类型,基于所述修正后的输出反馈进行语音播报。

50、在一种可能的实现方式中,所述生成模块,被配置为:

51、按照所述第二语音的识别文本在前、所述第一语音的识别文本在后的顺序,对所述第一语音的识别文本和所述第二语音的识别文本进行拼接;

52、基于自然语言理解模型和知识库,对拼接文本进行语义理解,得到语义理解结果;

53、生成与所述语义理解结果适配且采用自然语言形式表述的输出反馈。

54、在一种可能的实现方式中,所述数据库用于对应存储各个交互对象的声纹模板与语音交互过程中的输入语音;所述检索模块,被配置为:

55、基于所述交互对象的声纹模板,在所述数据库中检索所述交互对象在所述预设时间范围内输入的历史语音;

56、响应于所述历史语音的条数为多条,将所述历史语音中输入时间距离当前最近的n条语音作为所述第二语音;或,将所述历史语音中与所述第一语音归属于同一主题的语音作为所述第二语音;其中,n为正整数;

57、在一种可能的实现方式中,所述获取模块,还被配置为:

58、在输出声纹录入指令后,获取所述交互对象的预设时长语音;

59、对所述预设时长语音进行声纹特征提取,得到原始声纹特征;

60、基于所述预设时长语音,分别对所述交互对象进行属性分析、状态分析和语速分析,得到所述交互对象的属性特征、状态特征和语速特征;

61、对所述原始声纹特征、所述交互对象的属性特征、状态特征和语速特征进行特征融合,得到所述交互对象的声纹模板。

62、在一种可能的实现方式中,所述装置还包括:

63、分析模块,被配置为基于与当前识别场景匹配的语音识别模型,对所述第一语音进行语音识别;其中,识别场景包括第一识别场景和第二识别场景,所述第一识别场景的识别距离大于第二识别场景的识别距离;

64、基于目标语言模型对得到的识别文本进行文本情感分析,得到所述交互对象当前的情感极性;

65、其中,所述目标语言模型是基于训练语料对预训练模型进行再训练得到的。

66、在一种可能的实现方式中,所述装置还包括:

67、处理模块,被配置为响应于在所述数据库中未检索到所述交互对象历史输入的第二语音,将所述第一语音存储至所述数据库;响应于所述数据库中存储的语音的数据量超过预设阈值,按照先进先出的规则进行数据删除。

68、另一方面,提供了一种计算机设备,所述设备包括处理器和存储器,所述存储器中存储有至少一条程序代码,所述至少一条程序代码由所述处理器加载并执行以实现上述的语音交互方法。

69、另一方面,提供了一种计算机可读存储介质,所述存储介质中存储有至少一条程序代码,所述至少一条程序代码由处理器加载并执行以实现上述的语音交互方法。

70、另一方面,提供了一种计算机程序产品或计算机程序,该计算机程序产品或计算机程序包括计算机程序代码,该计算机程序代码存储在计算机可读存储介质中,计算机设备的处理器从计算机可读存储介质读取该计算机程序代码,处理器执行该计算机程序代码,使得该计算机设备执行上述的语音交互方法。

71、本技术实施例基于上下文联系和情绪判断实现了更为智能的语音交互,确保了语音交互质量。详细来说,对于当前一轮交互,在获取到交互对象本轮输入的语音后,如果基于本轮输入的语音无法输出反馈,则会按照预设时间范围,在数据库中检索交互对象历史输入的语音;其中,这个数据库用于存储语音交互过程中各个交互对象输入的语音;进而基于本轮输入的语音和历史输入的语音,来确定本轮的输出反馈。由于该方案基于上下文联系来生成输出反馈,因此还能够适用于问答是具有上下文的语音交互场景,避免了无法输出或输出答案准确性过低的问题。

72、另外,为了确保人机交互体验,本技术还会结合情绪识别结果来对输出反馈进行修正。即,响应于交互对象当前的情感极性为负面极性,且输出反馈中包括与负面极性适配的词语,则还会对输出反馈所表征的情感极性进行修正,并基于修正后的输出反馈进行语音播报。

73、综上所述,该种语音交互方案能够高概率输出与用户期望匹配的答案,较为智能化,人机交互体验好。

- 还没有人留言评论。精彩留言会获得点赞!