一种吊物下站人违规行为的检测方法及系统与流程

本技术涉及违规行为检测领域,尤其涉及一种吊物下站人违规行为的检测方法及系统。

背景技术:

1、传统的双目测距方法,使用点对点的特征匹配,其匹配速度较慢且随着距离的增加,左右相机的共同视场逐渐变少,匹配受到环境的影响,最终的测量的距离误差会变大。随着人工智能的发展,使用深度学习方法检测图像特征的应用受到各行各业的关注。目前已有使用关键点检测网络模型定位双目摄像头中的目标位置的方法,但是这类方法对于远距离物体的检测精度有待提高。

技术实现思路

1、本技术提供一种吊物下站人违规行为的检测方法及系统,以至少解决远距离物体的检测精度不高的技术问题。

2、本技术第一方面实施例提出一种吊物下站人违规行为的检测方法,所述方法包括:

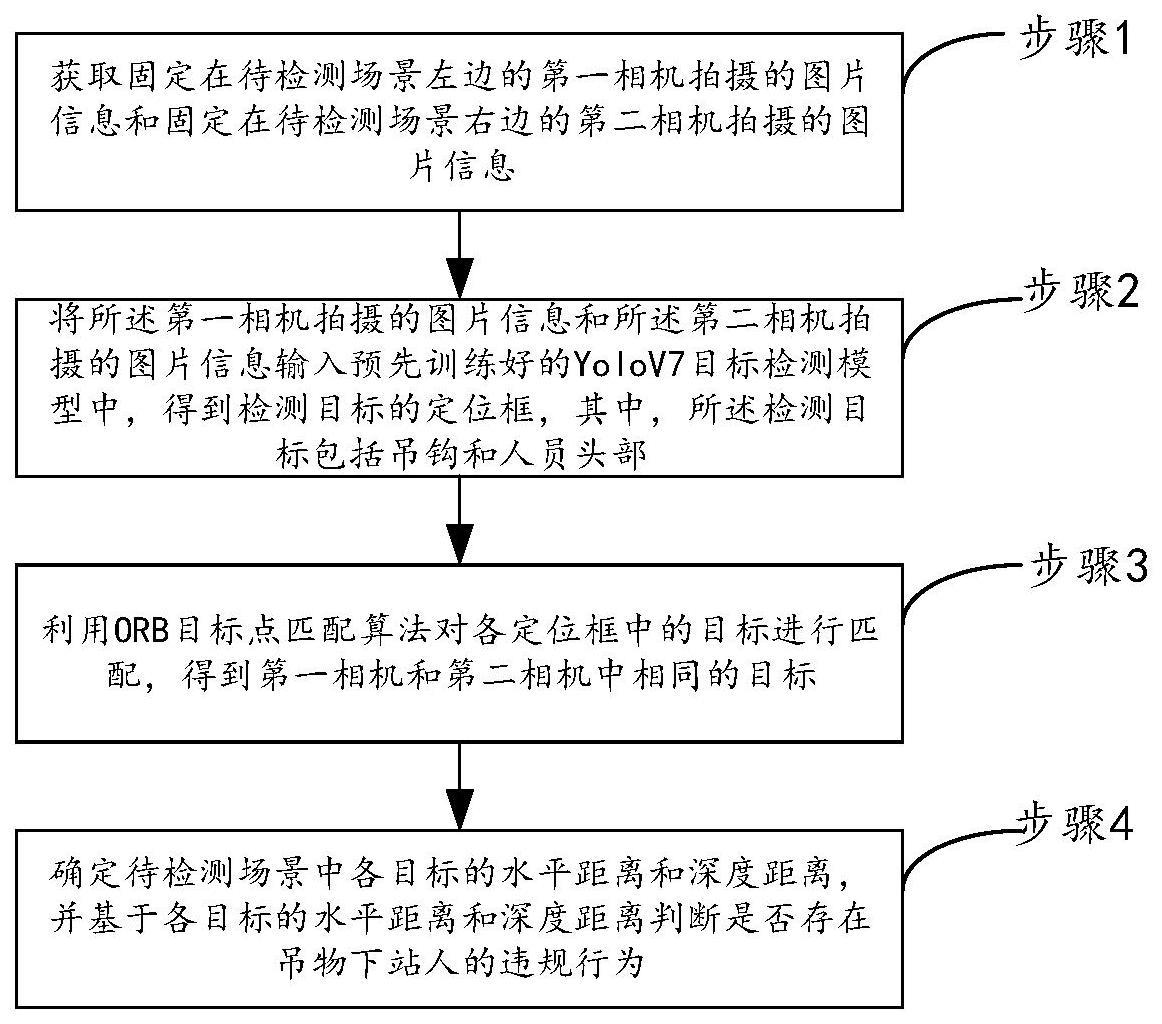

3、步骤1:获取固定在待检测场景左边的第一相机拍摄的图片信息和固定在待检测场景右边的第二相机拍摄的图片信息;

4、步骤2:将所述第一相机拍摄的图片信息和所述第二相机拍摄的图片信息输入预先训练好的yo lov7目标检测模型中,得到检测目标的定位框,其中,所述检测目标包括吊钩和人员头部;

5、步骤3:利用orb目标点匹配算法对各定位框中的目标进行匹配,得到第一相机和第二相机中相同的目标;

6、步骤4:确定待检测场景中各目标的水平距离和深度距离,并基于各目标的水平距离和深度距离判断是否存在吊物下站人的违规行为;

7、其中,所述第一相机与所述第二相机平行放置。

8、优选的,所述yo lov7目标检测模型的训练过程包括:

9、获取预设时段内各时刻第一相机拍摄的图片信息和第二相机拍摄的图片信息;

10、对各所述图片信息中的人员头部和吊钩进行标注,并对标注后的图片进行预处理;

11、将预处理后的图片信息输入初始的yo lov7网络模型中,将分类损失、定位损失和置信度损失的总体损失作为模型的损失函数,利用自适应矩阵估计adam优化算法对所述模型进行训练,得到训练好的yo lov7目标检测模型。

12、优选的,所述步骤3之前还包括:

13、基于所述检测目标的定位框判断人员与吊钩在水平方向上是否有交集,若无交集,则判断无吊物下站人违规行为,否则进入步骤3。

14、进一步的,所述利用orb目标点匹配算法对各定位框中的目标进行匹配,得到第一相机和第二相机中相同的目标,包括:

15、将各定位框中的目标提取出来,并转化为灰度目标图像;

16、确定第一相机中各目标图像的各描述子和第二相机中各目标图像的各描述子;

17、分别确定所述第一相机中各目标图像的各描述子与第二相机中各目标图像的各描述子的欧氏距离;

18、基于所述第一相机中各目标图像的各描述子与第二相机中各目标图像的各描述子的欧氏距离及预设的欧式距离阈值,进行第一相机和第二相机中相同目标的匹配。

19、进一步的,所述确定待检测场景中各目标的水平距离和深度距离,包括:

20、确定各个目标在第一相机拍摄的图片中的像素坐标、在第二相机拍摄的图片中的像素坐标;

21、基于各个目标在第一相机拍摄的图片中的像素坐标、在第二相机拍摄的图片中的像素坐标,计算各个目标的视觉差距离;

22、分别根据所述各个目标的视觉差距离,并利用三角测量法分别确定各目标的水平距离和深度距离。

23、进一步的,所述基于各目标的水平距离和深度距离判断是否存在吊物下站人的违规行为,包括:

24、基于各目标的水平距离和深度距离,确定吊钩和人员头部在平面上的欧式距离,判断所述欧式距离是否在阈值范围内,若是,则判断存在吊物下站人违规行为,否则判断无吊物下站人违规行为。

25、本技术第二方面实施例提出一种吊物下站人违规行为的检测系统,所述系统包括:

26、获取模块,用于获取固定在待检测场景左边的第一相机拍摄的图片信息和固定在待检测场景右边的第二相机拍摄的图片信息;

27、定位模块,用于将所述第一相机拍摄的图片信息和所述第二相机拍摄的图片信息输入预先训练好的yo lov7目标检测模型中,得到检测目标的定位框,其中,所述检测目标包括吊钩和人员头部;

28、匹配模块,用于利用orb目标点匹配算法对各定位框中的目标进行匹配,得到第一相机和第二相机中相同的目标;

29、第一判断模块,用于确定待检测场景中各目标的水平距离和深度距离,并基于各目标的水平距离和深度距离判断是否存在吊物下站人的违规行为;

30、其中,所述第一相机与所述第二相机平行放置。

31、优选的,所述系统还包括:第二判断模块;

32、所述第二判断模块,用于利用orb目标点匹配算法对各定位框中的目标进行匹配,得到第一相机和第二相机中相同的目标之前,基于所述检测目标的定位框判断人员与吊钩在水平方向上是否有交集,若无交集,则判断无吊物下站人违规行为。

33、进一步的,所述匹配模块,包括:

34、转化单元,用于将各定位框中的目标提取出来,并转化为灰度目标图像;

35、第一确定单元,用于确定第一相机中各目标图像的各描述子和第二相机中各目标图像的各描述子;

36、第二确定单元,用于分别确定所述第一相机中各目标图像的各描述子与第二相机中各目标图像的各描述子的欧氏距离;

37、匹配单元,用于基于所述第一相机中各目标图像的各描述子与第二相机中各目标图像的各描述子的欧氏距离及预设的欧式距离阈值,进行第一相机和第二相机中相同目标的匹配。

38、进一步的,所述第一判断模块,包括:

39、第三确定单元,用于确定各个目标在第一相机拍摄的图片中的像素坐标、在第二相机拍摄的图片中的像素坐标;

40、计算单元,用于基于各个目标在第一相机拍摄的图片中的像素坐标、在第二相机拍摄的图片中的像素坐标,计算各个目标的视觉差距离;

41、第四确定单元,用于分别根据所述各个目标的视觉差距离,并利用三角测量法分别确定各目标的水平距离和深度距离;

42、判断单元,用于基于各目标的水平距离和深度距离,确定吊钩和人员头部在平面上的欧式距离,判断所述欧式距离是否在阈值范围内,若是,则判断存在吊物下站人违规行为,否则判断无吊物下站人违规行为。

43、本技术的实施例提供的技术方案至少带来以下有益效果:

44、本技术提出了一种吊物下站人违规行为的检测方法及系统,其中,所述方法包括:步骤1:获取固定在待检测场景左边的第一相机拍摄的图片信息和固定在待检测场景右边的第二相机拍摄的图片信息;步骤2:将所述第一相机拍摄的图片信息和所述第二相机拍摄的图片信息输入预先训练好的yolov7目标检测模型中,得到检测目标的定位框,其中,所述检测目标包括吊钩和人员头部;步骤3:利用orb目标点匹配算法对各定位框中的目标进行匹配,得到第一相机和第二相机中相同的目标;步骤4:确定待检测场景中各目标的水平距离和深度距离,并基于各目标的水平距离和深度距离判断是否存在吊物下站人的违规行为;其中,所述第一相机与所述第二相机平行放置。本技术提出的技术方案,提高了远距离的小目标检测的准确率。

45、本技术附加的方面以及优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本技术的实践了解到。

- 还没有人留言评论。精彩留言会获得点赞!