一种融合面部肌信息处理的手语识别方法及其系统

本发明涉及手语识别,具体为一种融合面部肌信息处理的手语识别方法及其系统。

背景技术:

1、手语是一种通过手势和身体动作表达意思的交流方式,常常被聋哑人士使用。手语可以有不同的形式和变化,包括美国手语,英国手语等。手语也可以作为一种辅助通讯工具,在教育、医疗等领域得到广泛应用。

2、除了在特定的社群中使用,手语在全球范围内也受到越来越多人的关注和学习。对于普通人来说,学习手语不仅可以帮助我们更好地理解聋哑人士的需求和心声,也可以提高我们的跨文化交际能力,让我们更加开放和包容不同的人群。

3、但在现有的手语识别的方式中,依然面临诸多问题。

4、比如说,手语识别技术在实际应用中面临着精度不高的问题。尤其是在复杂的背景下,例如嘈杂的环境或光线不足的情况下,手语识别很容易受到干扰和误判,导致手语识别的翻译不准确;

5、还比如说,现有的手语识别翻译仅仅是考虑到对手势动作的识别,没有将识别人的面部表情与手势动作进行综合分析,缺少对面部表情和头部姿态信息的分析,导致识别精度低,出错率高,无法准确表达出聋哑人的情感,进而导致手语沟通的效率不佳,给用户带来极大的不便。

6、为了解决上述缺陷,现提供一种技术方案。

技术实现思路

1、本发明的目的就在于解决现有的手语识别的方式中,无法保证手语识别翻译的精度,缺少对面部表情信息的分析,导致识别精度低,出错率高,无法准确表达出聋哑人的情感,进而导致手语沟通的效率不佳,给用户带来极大的不便的问题,通过将面部状态信息与手语表达信息以及影响其手语表达的影响程度信息进行整合分析,以此来提高手语识别的精准度,从而来降低手语识别的出错率,并准确表达出聋哑人员的情感及手语沟通的效率,给用户带来方便,而提出一种融合面部肌信息处理的手语识别方法及其系统。

2、本发明的目的可以通过以下技术方案实现:一种融合面部肌信息处理的手语识别方法,包括以下步骤:

3、步骤一:采集目标识别人的手部参数信息、面部参数信息、影响因素信息;

4、步骤二:对目标识别人的手部参数信息进行监测,由此对目标识别人的手部状态进行分析;

5、步骤三:对目标识别人的面部参数信息进行监测,由此对目标识别人的面部状态进行分析;

6、步骤四:对目标识别人的手语表达的影响因素信息进行监测,由此对目标识别人的手语表达的影响程度进行分析;

7、步骤五:对目标识别人的手部状态、面部状态及手语表达的影响程度进行综合分析,由此得到目标识别人的最终手语表达示意信息,并通过输出终端对目标识别人的最终手语表达示意信息进行显示说明。

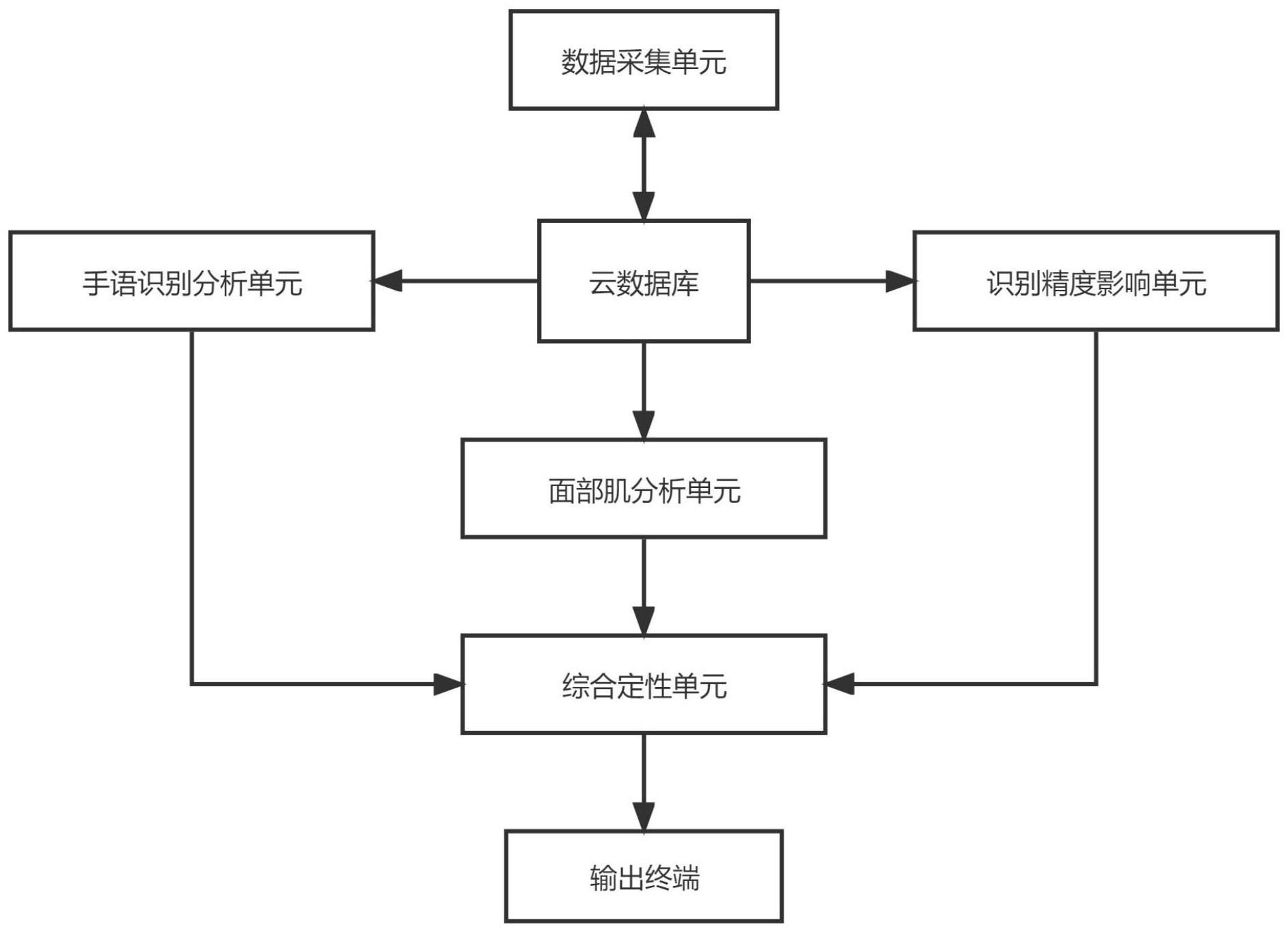

8、一种融合面部肌信息处理的手语识别系统,包括:数据采集单元、云数据库、手语识别分析单元、识别精度影响单元、面部肌分析单元、综合定性单元和输出终端;

9、所述数据采集单元用于采集目标识别人的手部参数信息、面部参数信息、影响因素信息,并将其均发送至云数据库中进行存储;

10、所述手语识别分析单元用于对目标识别人的手部参数信息进行监测,由此对目标识别人的手部状态进行分析;

11、所述面部肌分析单元用于对目标识别人的面部参数信息进行监测,由此对目标识别人的面部状态进行分析;

12、所述识别精度影响单元用于对目标识别人的手语表达的影响因素信息进行监测,由此对目标识别人的手语表达的影响程度进行分析;

13、所述综合定性单元用于对目标识别人的手部状态、面部状态及手语表达的影响程度进行综合分析;

14、所述云数据库用于存储目标识别人的手部轮廓概括示意表,存储目标识别人的第一面部表情判定表,存储目标识别人的第二面部表情判别表,存储目标识别人的影响程度数据表,存储目标识别人的手语表达信息判定表。

15、优选的,所述对目标识别人的手部参数信息进行监测及其手部状态进行分析,其具体过程如下:

16、实时监测目标识别人的手部动作,同时对目标识别人的每个手部动作图像进行记录,并提取每个手部动作图像的轮廓值,并将各手部动作图像的轮廓值与存储在云数据库中的手部轮廓概括示意表进行对照匹配分析,由此得到目标识别人的每个手部动作的初步示意数据值,且得到的目标识别人的每个手部动作图像的轮廓值均对应一个初步示意数据值;

17、依据得到的目标识别人的每个手部动作图像,并提取每个手部动作图像的手势颜色值和亮度值,并将其分别标定为gcvi和lgi,并将其进行归一化分析,依据设定的公式sdvi=δ1×gcvi+δ2×lgi,由此得到目标识别人的每个手部动作的第二示意数据值sdvi,其中,i表示为手部动作图像的个数,且i=1,2,3……n,δ1和δ2分别为手势颜色值和亮度值的归一因子,且δ1和δ2均为大于0的自然数;

18、将目标识别人的每个手部动作的初步示意数据值与第二示意数据值进行综合分析,依据设定的公式由此得到目标识别人的手部综合示意数据值,其中,cbxi表示为目标识别人的每个手部动作的初步示意数据值zhs,γ1和γ2分别为初步示意数据值与第二示意数据值的修正因子系数,且γ1和γ2均为大于0的自然数。

19、优选的,所述对目标识别人的面部参数信息进行监测,其具体监测过程如下:

20、实时监测目标识别人的面部动作,且面部动作包括皱眉、抬头、张嘴、噘嘴、眨眼、拱鼻等,且记录目标识别人的每个面部动作的动作强度和持续时间,并将其分别标定为strj和durj,并将其进行公式分析,依据设定的公式由此得到目标识别人的面部表情系数fep,其中,j表示为面部动作的类型数,且j=1,2,3……m,g1和g2分别为动作强度和持续时间的修正因子系数,且g1和g2均为大于0的自然数;

21、实时监测目标识别人的各面部动作,并在每个面部动作选取k个面部特征点,由此获取对应面部动作的各面部特征点的位移值和肌肉活动值,并将其分别标定为disjk和actjk,依据公式由此得到目标识别人的各面部动作的面肌特征系数facj,其中,e1和e2分别为位移值和肌肉活动值的修正因子系数,且e1和e2均为大于0的自然数;

22、将目标识别人的所有面部动作的面肌特征系数进行求和分析,依据公式由此得到目标识别人的面部肌感系数fmp。

23、优选的,所述对目标识别人的面部状态进行分析,其具体分析过程如下:

24、将目标识别人的面部表情系数和面部肌感系数分别与存储在云数据库中的第一面部表情判定表、第二面部表情判别表进行对照匹配分析;

25、由此得到目标识别人的第一面部反馈值、第二面部反馈值,且得到的每个目标识别人的面部表情系数均对应一个第一面部反馈值,得到的每个目标识别人的面部肌感系数均对应一个第二面部反馈值;

26、将目标识别人的第一面部反馈值和第二面部反馈值进行均值分析,由此得到目标识别人的面部综合示意数据值。

27、优选地,所述对目标识别人的手语表达的影响因素信息进行监测,其具体监测过程如下:

28、获取目标识别人所处的噪声值和振动值,并将其分别标定为zsl和zdl,并将其进行公式化分析,依据设定的公式由此得到目标识别人的手语表达的环境影响值hx,其中,λ1和λ2分别为噪声值和振动值的误差因子系数,λ1和λ2均为大于0的自然数;

29、获取目标识别人所处的空间状态,并将目标识别人所处的空间状态等量划分n个子空间,获取n个子空间的光照强度值,并将n个子空间的光照强度值进行均值处理,依据公式由此得到目标识别人的手语表达的光照条件值gzx*。

30、优选地,所述对目标识别人的手语表达的影响程度进行分析,其具体分析过程如下:

31、获取目标识别人的手语表达的影响因素信息中的环境影响值、光照条件值、遮挡量值、数据质量和姿势多样值,并将五项数据进行公式化分析,依据设定的公式efc=ρ1×hx+ρ2×gzx*+ρ3×zdl+ρ4×qul+ρ5×fzl,由此得到目标识别人的手语表达的影响系数efc,其中,zdl表示遮挡量值,qul表示数据质量,fzl表示姿势多样值,而遮挡量值指的是手部姿势被其他物体遮挡的面积大小的数据值,ρ1、ρ2、ρ3、ρ4和ρ5分别为环境影响值、光照条件值、遮挡量值、数据质量和姿势多样值的权重因子系数,且ρ1、ρ2、ρ3、ρ4和ρ5均为大于0的自然数;

32、将目标识别人的手语表达的影响系数与存储在云数据库中的影响程度数据表进行对照匹配分析,由此得到目标识别人的手语表达的影响程度值,并将其记作ω,且得到的每个目标识别人的手语表达的影响系数均对应一个影响程度值。

33、优选地,所述对目标识别人的手部状态、面部状态及手语表达的影响程度进行综合分析,其具体分析步骤如下:

34、获取目标识别人的手部综合示意数据值、面部综合示意数据值和影响程度值,并将其进行公式分析,依据设定的公式show=ξ×(zhs+zfs)×(1-ω),由此得到目标识别人的手语最终反馈值show,其中,zfs表示为目标识别人的面部综合示意数据值,ξ为转化因子;

35、将目标识别人的手语最终反馈值与存储在云数据库中的手语表达信息判定表进行对照匹配分析,由此得到目标识别人的最终手语表达示意信息,且得到的每个目标识别人的手语最终反馈值均对应一个最终手语表达示意信息。

36、本发明的有益效果:

37、本发明,通过数据特征提取、轮廓数据比对和归一化分析的方式,对目标识别人的手部参数信息进行了明确输出,并以此为基础,通过数据综合分析的方式,又进一步明确了目标识别人的手部状态信息;

38、又通过公式计算和数据求和的方式,分别明确了目标识别人的面部参数信息,并结合数据转化、均值计算的方式,综合输出了目标识别人的面部状态信息;

39、通过数据标定以及公式计算和综合分析的方式,将影响目标识别人手语表达准确的影响程度进行了准确的分析,并为实现目标识别人的手语准确表达提供了强有力的数据支撑;

40、并采用数据综合分析的方式将目标识别人的手部综合示意数据值、面部综合示意数据值和影响程度值进行汇总分析,并结合数据库比对的方式,实现了对目标识别人的手语表达信息的准确反馈;

41、通过将面部状态信息与手语表达信息以及影响其手语表达的影响程度信息进行整合分析,以此来提高手语识别的精准度,从而来降低手语识别的出错率,并准确表达出聋哑人员的情感及手语沟通的效率,给用户带来方便。

- 还没有人留言评论。精彩留言会获得点赞!