人脸动画生成网络的训练方法、人脸动画生成方法及装置与流程

本技术实施例涉及机器学习,具体而言,涉及一种人脸动画生成网络的训练方法、人脸动画生成方法及装置。

背景技术:

1、近年来,虚拟人技术中数字人、虚拟形象的开发逐渐成为了新兴的技术议题,除了用于虚拟真人类形象,数字人的开发技术也能让角色表情更加生动,并且与观众互动。传统的虚拟人动画生成需要以下三个步骤:1、虚拟人建模,2、虚拟人绑定,3、虚拟人驱动。在进行虚拟人动画生成时,首先需要有数字人资产即虚拟人建模,当有了数字人资产后,在数字人资产上设置关键点并设置蒙皮系数同时采集表情进行权重解算后完成虚拟人绑定,最后通过真人驱动关键点并且通过蒙皮系数解算后通过变形动画方式驱动数字人,这种方法会耗费大量人力物力,且每个数字资产不可重用,因此使得数字人资产无法实现工业化生产。

2、随着神经网络的兴起,神经网络的泛化性、通用性为虚拟人的动画制作带来了便利条件,神经网络驱动数字人目前主要有两种方式实现:一种是逐顶点驱动,另一种是采用隐变量驱动。采用顶点驱动的方式在理论上虽然能够更精细的驱动数字人,但是目前高仿真数字人可能需要几十万顶点来进行建模,在实际神经网络实现中无法准确地实现几十万顶点的驱动,因此通常采用隐变量来驱动数字人,采用隐变量可以更加精确的表征数字人,但由于隐变量的不可解释性,使得数字人的驱动无法预测,通常需要进行反向工程将其反编译成图像等特征。

3、针对上述的问题,目前尚未提出有效的解决方案。

技术实现思路

1、本技术实施例提供了一种人脸动画生成网络的训练方法、人脸动画生成方法及装置,以至少解决相关技术中无法精细刻画生成人脸对应的动画图像的技术问题。

2、根据本技术的一个实施例,提供了一种人脸动画生成网络的训练方法,该方法包括:获取多个训练样本图像,并确定每个训练样本图像对应的样本标签信息;对于任一训练样本图像,确定训练样本图像对应的第一隐变量和第一特征点,其中,第一隐变量用于表征训练样本图像中人脸的几何信息和纹理信息,第一特征点用于表征训练样本图像中人脸区域的第一语义信息;将第一隐变量和第一特征点输入初始网络,得到初始网络输出的第一人脸动画图像,其中,初始网络用于依据第一隐变量和第一特征点确定训练样本图像的第一整体特征,并依据第一整体特征进行体渲染得到第一人脸动画图像;依据第一人脸动画图像和训练样本图像对应的样本标签信息构建目标损失函数;利用多个训练样本图像对初始网络进行迭代训练,其中,通过收敛目标损失函数的方式调整初始网络的网络参数,得到人脸动画生成网络。

3、在一个示例性实施例中,获取多个训练样本图像,包括:从第一视频数据集中筛选出多个第一视频,其中,第一视频数据集中的视频均为人脸说话视频,第一视频的人脸帧图像中包括有目标数量的第一特征点;过滤多个第一视频中清晰度不符合预设条件的第一视频;将保留的第一视频中的人脸帧图像作为训练样本图像。

4、在一个示例性实施例中,将保留的第一视频中的人脸帧图像作为训练样本图像,包括:对每个保留的第一视频中的人脸帧图像进行预处理,其中,预处理包括:对于每帧人脸帧图像,以人脸为中心,截取预设大小区域的图像作为训练样本图像。

5、在一个示例性实施例中,确定训练样本图像对应的第一隐变量和第一特征点,包括:利用预训练的反演推理网络确定训练样本图像对应的第一隐变量;利用预训练的特征点提取网络确定训练样本图像对应的第一特征点。

6、在一个示例性实施例中,在将第一隐变量和第一特征点输入初始网络之前,构建初始网络,其中,初始网络中至少包括:变量融合子网络、仿射变换子网络、转换编码子网络和三维解码子网络。

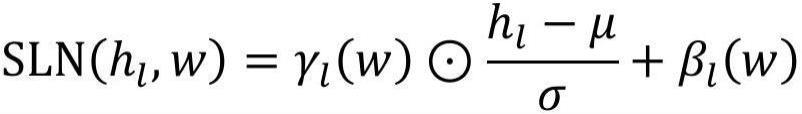

7、在一个示例性实施例中,将第一隐变量和第一特征点输入初始网络,得到第一人脸动画图像,包括:将第一隐变量和第一特征点输入变量融合子网络进行融合,得到包括有人脸几何、纹理、语义信息的第二隐变量;将第二隐变量输入仿射变换子网络进行仿射变换,得到目标空间下的第一特征变量,其中,仿射变换包括尺度变换和平移变换;将第一特征变量输入转换编码子网络进行编码转换,得到训练样本图像的第一整体特征;将第一整体特征转换为训练样本图像的第一三维空间特征;将第一三维空间特征输入三维解码子网络进行解耦,得到训练样本图像对应的第一体素信息、第一颜色信息和第二语义信息;依据第一体素信息、第一颜色信息和第二语义信息进行体渲染,得到第一人脸动画图像。

8、在一个示例性实施例中,将第一整体特征转换为训练样本图像的第一三维空间特征,包括:将第一整体特征分为三个平面的第一子特征;通过加和的方式对三个第一子特征进行空间特征融合,得到训练样本图像的第一三维空间特征。

9、在一个示例性实施例中,第二语义信息用于表征人脸区域信息,其中,人脸区域包括以下至少之一:皮肤、左眉毛、右眉毛、左耳、右耳、嘴部、上嘴唇、下嘴唇、头发、帽子、脖子、左眼、右眼、鼻子、眼镜。

10、在一个示例性实施例中,依据第一体素信息、第一颜色信息和第二语义信息进行体渲染,得到第一人脸动画图像,包括:依据第一体素信息和第一颜色信息进行体渲染,得到第一图像渲染结果;依据第一体素信息和第二语义信息进行体渲染,得到第一语义渲染结果;依据第一图像渲染结果和第一语义渲染结果生成第一人脸动画图像。

11、在一个示例性实施例中,确定每个训练样本图像对应的样本标签信息,包括:对于每个训练样本图像,分别确定训练样本图像对应的语义图像信息和训练样本图像的第一像素信息;将训练样本图像的语义图像信息、第一像素信息和第一特征点的信息作为训练样本图像的样本标签信息。

12、在一个示例性实施例中,依据第一人脸动画图像和训练样本图像对应的样本标签信息构建目标损失函数,包括:确定第一人脸动画图像的第二像素信息,并利用特征点提取网络确定第一人脸动画图像对应的第二特征点的信息;依据第一语义渲染结果和语义图像信息构建语义损失函数;依据第二特征点的信息和第一特征点的信息构建特征点损失函数;依据第二像素信息和第一像素信息构建像素损失函数;依据语义损失函数、特征点损失函数和像素损失函数确定目标损失函数。

13、在一个示例性实施例中,依据语义损失函数、特征点损失函数和像素损失函数确定目标损失函数,包括:分别确定语义损失函数、特征点损失函数和像素损失函数对应的权重值;依据权重值对语义损失函数、特征点损失函数和像素损失函数进行加权求和,得到目标损失函数。

14、在一个示例性实施例中,利用多个训练样本图像对初始网络进行迭代训练,包括:确定训练批次规模,并确定目标优化器和初始学习率;将训练批次规模的训练样本图像依次输入初始网络,并依据目标优化器和初始学习率对初始网络进行迭代训练。

15、在一个示例性实施例中,在得到人脸动画生成网络之后,从第二视频数据集中筛选出多个第二视频,其中,第二视频数据集中的视频均为唇读视频,第二视频的人脸帧图像中包括有目标数量的第一特征点;过滤多个第二视频中清晰度不符合预设条件的第二视频,将保留的第二视频中的人脸帧图像作为测试样本图像;利用测试样本图像对人脸动画生成网络进行测试。

16、根据本技术的另一个实施例,提供了一种人脸动画生成方法,包括:获取目标对象的目标人脸图像;确定目标人脸图像对应的第三隐变量和第三特征点,其中,第三隐变量用于表征目标人脸图像中人脸的几何信息和纹理信息,第三特征点用于表征目标人脸图像中人脸区域的第三语义信息;将第三隐变量和第三特征点输入人脸动画生成网络,得到人脸动画生成网络输出的第二人脸动画图像,其中,人脸动画生成网络是依据上述的人脸动画生成网络的训练方法训练得到的。

17、在一个示例性实施例中,确定目标人脸图像对应的第三隐变量和第三特征点,包括:利用预训练的反演推理网络确定目标人脸图像对应的第三隐变量;利用预训练的特征点提取网络确定目标人脸图像对应的第三特征点。

18、在一个示例性实施例中,将第三隐变量和第三特征点输入人脸动画生成网络,得到人脸动画生成网络输出的第二人脸动画图像,包括:将第三隐变量和第三特征点输入人脸动画生成网络中的变量融合子网络进行融合,得到包括有人脸几何、纹理、语义信息的第四隐变量;将第四隐变量输入人脸动画生成网络中的仿射变换子网络进行仿射变换,得到目标空间下的第二特征变量,其中,仿射变换包括尺度变换和平移变换;将第二特征变量输入人脸动画生成网络中的转换编码子网络进行编码转换,得到目标人脸图像的第二整体特征;将第二整体特征转换为目标人脸图像的第二三维空间特征;将第二三维空间特征输入人脸动画生成网络中的三维解码子网络进行解耦,得到目标人脸图像对应的第二体素信息、第二颜色信息和第四语义信息;依据第二体素信息、第二颜色信息和第四语义信息进行体渲染,得到第二人脸动画图像。

19、在一个示例性实施例中,将第二整体特征转换为目标人脸图像的第二三维空间特征,包括:将第二整体特征分为三个平面的第二子特征;通过加和的方式对三个第二子特征进行空间特征融合,得到目标人脸图像的第二三维空间特征。

20、在一个示例性实施例中,依据第二体素信息、第二颜色信息和第四语义信息进行体渲染,得到第二人脸动画图像,包括:依据第二体素信息和第二颜色信息进行体渲染,得到第二图像渲染结果;依据第二体素信息和第四语义信息进行体渲染,得到第二语义渲染结果;依据第二图像渲染结果和第二语义渲染结果生成第二人脸动画图像。

21、根据本技术的另一个实施例,提供了一种人脸动画生成网络的训练装置,包括:第一获取模块,用于获取多个训练样本图像,并确定每个训练样本图像对应的样本标签信息;第一确定模块,用于对于任一训练样本图像,确定训练样本图像对应的第一隐变量和第一特征点,其中,第一隐变量用于表征训练样本图像中人脸的几何信息和纹理信息,第一特征点用于表征训练样本图像中人脸区域的第一语义信息;处理模块,用于将第一隐变量和第一特征点输入初始网络,得到第一人脸动画图像,其中,初始网络用于依据第一隐变量和第一特征点确定训练样本图像的第一整体特征,并依据第一整体特征进行体渲染得到第一人脸动画图像;构建模块,用于依据第一人脸动画图像和训练样本图像对应的样本标签信息构建目标损失函数;训练模块,用于利用多个训练样本图像对初始网络进行迭代训练,其中,通过收敛目标损失函数的方式调整初始网络的网络参数,得到人脸动画生成网络。

22、根据本技术的另一个实施例,提供了一种人脸动画生成装置,包括:第二获取模块,用于获取目标对象的目标人脸图像;第二确定模块,用于确定目标人脸图像对应的第三隐变量和第三特征点,其中,第三隐变量用于表征目标人脸图像中人脸的几何信息和纹理信息,第三特征点用于表征目标人脸图像中人脸区域的第三语义信息;生成模块,用于将第三隐变量和第三特征点输入人脸动画生成网络,得到人脸动画生成网络输出的第二人脸动画图像,其中,人脸动画生成网络是依据上述的人脸动画生成网络的训练方法训练得到的。

23、根据本技术的另一个实施例,还提供了一种计算机可读存储介质,计算机可读存储介质中存储有计算机程序,其中,计算机程序被处理器执行时实现上述的人脸动画生成网络的训练方法或人脸动画生成方法的步骤。

24、根据本技术的另一个实施例,还提供了一种电子设备,其特征在于,包括:存储器和处理器,其中,存储器中存储有计算机程序,处理器被配置为通过计算机程序执行上述的人脸动画生成网络的训练方法或人脸动画生成方法的步骤。

25、在本技术实施例中,通过将表征人脸几何、纹理信息的隐变量和表征人脸区域语义信息的显式特征点进行融合,以此得到人脸的整体特征,再对其解耦并进行体渲染,即可得到精细的人脸动画图像;实际应用中,可以实时采集用户人脸图像,当用户说话时,隐变量可能无明显变化,但特征点的位置会发生变化,即本技术方案可以实现依据特征点精细驱动人脸动画图像,有效解决了相关技术中无法精细刻画生成人脸对应的动画图像的技术问题。

- 还没有人留言评论。精彩留言会获得点赞!