一种视盘视杯分割方法及装置、电子设备、介质

本发明属于医学图像分割,尤其涉及一种视盘视杯分割方法及装置、电子设备、介质。

背景技术:

1、青光眼(glaucoma)是一种逐渐损害视神经并威胁不可逆转的视力丧失的眼部疾病。由于青光眼最初是无症状的,直到出现明显的视力丧失,因此早期诊断和治疗对于避免视力丧失至关重要。视神经乳头(optic nerve head,onh)评估是青光眼初级筛查的主要实践技术。然而,人工onh评估需要熟练的临床医生,耗时长,因此不适合大规模筛查。因此,可复制和自动评估方法是非常可取的。临床采用的测量值的典型例子是视盘直径、垂直杯盘比(cup to disc ratio,cdr)和边缘与视盘面积比(rim to disk area ratio,rdar)。其中,cdr是临床医生最常用的,它是通过垂直杯直径与垂直椎间盘直径的比值计算的。一般来说,较高的cdr(大于0.7)表示较高的风险青光眼,反之亦然。因此,准确分割视盘(opticdisc,od)和视杯(optic cup,oc)对于cdr计算至关重要。

2、随着深度神经网络(deep neural networks,dnn)的发展,基于卷积的深度学习方法在自然图像分割和医学图像分割方面取得了很大的成就,其具有精度高与泛化性强的优点。但上述方法都会受到感受野的限制,无法充分考虑到全局信息。而且这些方法假设训练和测试样本是从相同的分布中采样的。然而,不同视网膜眼底图像数据集之间的域偏移确实很常见。这种分布漂移会导致模型的分割性能下降。

技术实现思路

1、本技术实施例的目的是为了解决上述现有技术中存在的精度低、数据集分布漂移导致模型的分割性能下降的问题,提供一种视盘视杯分割方法及装置、电子设备、介质。

2、根据本技术实施例的第一方面,提供一种基于域自适应与transformer结合的视盘视杯分割方法,包括:

3、步骤s11:获取源域眼底图像和目标域眼底图像,其中所述源域眼底图像带有分割标签和第一分类标签,所述目标域眼底图像带有第二分类标签;

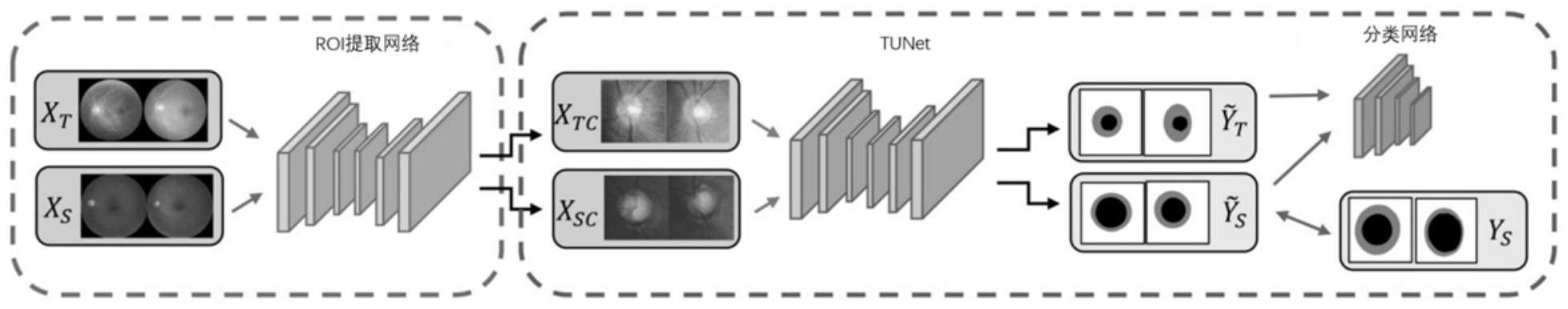

4、步骤s12:获取预训练的roi提取网络,利用所述roi提取网络从所述源域眼底图像和目标域眼底图像提取roi区域,得到源域roi区域图像和目标域roi区域图像;

5、步骤s13:将所述源域roi区域图像和目标域roi区域图像输入分割网络,得到源域分割图像和目标域分割图像,根据所述分割标签得到所述源域分割图像的预测分割损失;

6、步骤s14:将所述源域分割图像和目标域分割图像输入分类网络,得到源域分类结果、目标域分类结果,根据所述第一分类标签和第二分类标签得到所述源域分割图像和所述目标域分割图像的预测分类损失;

7、步骤s15:根据所述预测分割损失和所述预测分类损失,进行所述分割网络的参数更新,根据所述预测分类损失进行所述分类网络的参数更新;

8、步骤s16:重复步骤s13~s15,直至所述预测分割损失和所述预测分类损失趋于稳定;

9、步骤s17:获取待分割眼底图像,将所述待分割眼底图像输入roi提取网络中,得到视盘粗提取结果,将所述视盘粗提取结果输入所述分割网络,得到视盘分割结果,将所述视盘分割结果输入所述分类网络,得到所述待分割眼底图像为青光眼眼底图像的概率。

10、进一步地,所述roi提取网络遵循u-net结构,包括19个卷积层,使用sigmoid激活函数来生成视盘的概率图,用于视盘区域的粗预测并将预测得到的视盘分割结果映射到原始图像。

11、进一步地,构建tunet作为所述分割网络,所述tunet包括编码器和解码器,所述编码器和解码器共同形成u形架构,且通过跳跃连接在不同分辨率级别进行特征聚合,所述解码器的输出通过softmax激活函数进行分类。

12、进一步地,所述编码器包括线性嵌入层、swin transformer块和patch合并层,所述线性嵌入层用于将所述编码器的输入的特征维度投影到任意维度,转换后的图像块序列通过若干swin transformer块和patch合并层来生成分层特征表示,其中,swintransformer块用于特征表示学习,patch合并层用于降采样和增加维度。

13、进一步地,所述swin transformer块基于移位窗口构建的,每个swintransformer块包括layernorm层、多头自注意力模块、残差连接和具有gelu非线性的2层mlp,在两个连续的swin transformer块中,所述多头自注意力模块分别为基于窗口的多头自注意模块和基于移位窗口的多头自注意模块,则连续的swin transformer块表示为:

14、

15、

16、

17、

18、其中zl-1表示swin transformer块的输入特征,和zl分别表示第l个swintransformer块中基于窗口的多头自注意模块和mlp模块的输出特征;和zl+1则分别表示第l+1块swin transformer中基于移位窗口的多头自注意模块和mlp模块的输出特征。

19、进一步地,所述基于窗口的多头自注意模块和基于移位窗口的多头自注意模块分别使用规则和移位窗口分区在每个窗口中计算自注意力:先将查询向量q和键向量k点乘,再除以键向量k的维度的平方根,得到查询向量q的分数矩阵,并加上相对位置偏差,最后通过softmax函数将分数矩阵归一化得到权重矩阵,再乘以值向量v即得到一个子空间的注意力向量:

20、

21、其中分别是查询向量、键向量和值向量,m2是窗口中的图像块的数量,d表示查询向量或键向量的维度,b取自偏置矩阵

22、进一步地,采用resnet-18作为所述分类网络,所述分类网络接收分割网络的输出结果作为输入并进行卷积计算,输出分类的概率。

23、根据本技术实施例的第二方面,提供一种基于域自适应与transformer结合的视盘视杯分割装置,包括:

24、获取模块,用于获取源域眼底图像和目标域眼底图像,其中所述源域眼底图像带有分割标签和第一分类标签,所述目标域眼底图像带有第二分类标签;

25、提取模块,用于获取预训练的roi提取网络,利用所述roi提取网络从所述源域眼底图像和目标域眼底图像提取roi区域,得到源域roi区域图像和目标域roi区域图像;

26、分割模块,用于将所述源域roi区域图像和目标域roi区域图像输入分割网络,得到源域分割图像和目标域分割图像,根据所述分割标签得到所述源域分类结果的预测分割损失;

27、分类模块,用于将所述源域分割图像和目标域分割图像输入分类网络,得到源域分类结果、目标域分类结果,根据所述第一分类标签和第二分类标签得到所述源域分割图像和所述目标域分割图像的预测分类损失;

28、训练模块,用于根据所述预测分割损失和所述预测分类损失,进行所述分割网络的训练,根据所述预测分类损失进行所述分类网络的训练;

29、重复模块,用于重复分割模块至训练模块的操作,直至所述预测分割损失和所述预测分类损失趋于稳定;

30、推理模块,用于获取待分割眼底图像,将所述待分割眼底图像输入roi提取网络中,得到视盘粗提取结果,将所述视盘粗提取结果输入所述分割网络,得到视盘分割结果,将所述视盘分割结果输入所述分类网络,得到所述待分割眼底图像为青光眼眼底图像的概率。

31、根据本技术实施例的第三方面,提供一种电子设备,包括:

32、一个或多个处理器;

33、存储器,用于存储一个或多个程序;

34、当所述一个或多个程序被所述一个或多个处理器执行,使得所述一个或多个处理器实现如第一方面所述的方法。

35、根据本技术实施例的第四方面,提供一种计算机可读存储介质,其上存储有计算机指令,该指令被处理器执行时实现如第一方面所述方法的步骤。

36、本技术的实施例提供的技术方案可以包括以下有益效果:

37、由上述实施例可知,本技术对源域的眼底图像同时进行分类和分割训练以利用图像级和像素级标签提供的互补反馈,对源域和目标域的眼底图像进行分类训练,来降低源域和目标域之间的距离。本技术采用了基于transformer的自注意力机制以及域自适应技术,所以克服了视杯视盘分割中由于视杯所占眼底图像面积小而导致的分割精度低以及由于眼底相机的不同或者拍摄环境的不同导致的得到的眼底图像会存在颜色、纹理等光学性质不同从而对模型预测结果产生较大影响的问题,进而实现对多种不同风格的眼底图像都可以获得高精度的视杯视盘分割结果。

38、应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,并不能限制本技术。

- 还没有人留言评论。精彩留言会获得点赞!