一种基于上下文感知边缘增强的遥感图像超分辨率方法

本发明属于遥感图像处理领域,特别是涉及一种基于上下文感知边缘增强的遥感图像超分辨率方法。

背景技术:

1、随着遥感图像应用技术的发展,遥感图像广泛应用于目标检测、产量预测、变化检测等领域。由于遥感图像在采集过程中受硬件设备限制以及云、雾等自然环境干扰,这些因素会导致采集到的遥感图像退化严重与实际场景严重不符。而自然图像不会遇到这些问题,因此自然图像超分辨算法在处理遥感图像时表现不佳。低质量的遥感图像会严重影响后续实际应用的结果,因此,针对遥感图像的超分辨率算法在近年来受到广泛的关注。

2、在现有的技术中,已有很多超分辨率算法使用神经网络学习成对的低分辨率图像和高分辨率图像之间的对应关系,但其仅将峰值信噪比作为网络的优化目标,这会导致生成的图像过于光滑,与机器分析与人眼观看的需求不一致。此外,一些研究工作为了得到更加真实的重建图像,将对抗生成网络引入了超分辨率领域。但由于缺乏针对高频信息的约束以及遥感图像退化严重,基于对抗生成网络的超分辨率方法会导致生成的高频细节与实际情况不一致。

技术实现思路

1、本发明的目的在于克服上述现有工作的缺点,提供了一种基于上下文感知边缘增强的遥感图像超分辨率方法,该方法能够有效提高对低分辨率遥感图像的重建效果,使超分辨率图像兼顾人眼感知与机器视觉应用。

2、本发明采用如下技术方案来实现的:

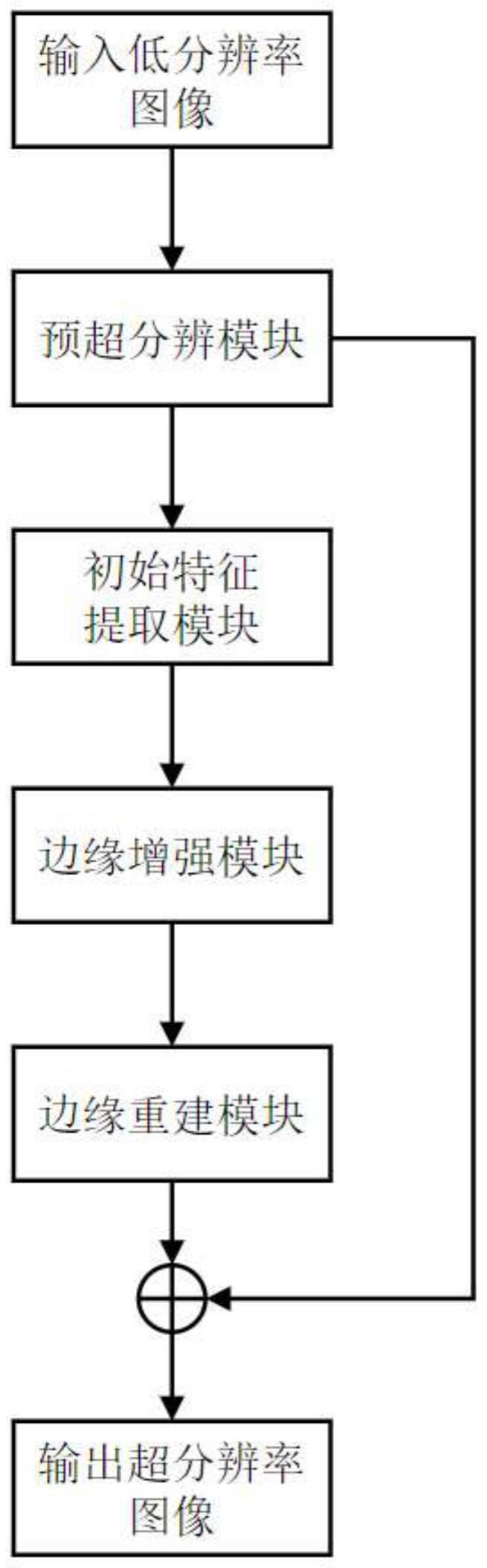

3、一种基于上下文感知边缘增强的遥感图像超分辨率方法,包括以下步骤:

4、1)待处理的低分辨率图像输入到初始特征提取模块,首先使用预超分辨率模块进行处理,以生成预超分辨率图像;

5、2)将预超分辨率图像分别输入到边缘和上下文语义特征提取层,获得相应的两种类型的多尺度特征;

6、3)将两种类型的多尺度特征输入到边缘增强模块,首先由双向边缘特征融合模块和双向上下文特征融合模块对其进行双向加权融合,同时使用上下文边缘信息交换模块在边缘分支与上下文分支之间进行信息交换;

7、4)将经过多个边缘增强模块迭代增强后的多尺度边缘特征输入到边缘重建模块进行边缘聚合重建;

8、5)将预超分辨率图像中的模糊边缘替换为聚合重建得到的增强边缘,以获得具有精细和准确边缘的超分辨率重建图像;

9、6)使用vgg鉴别器对超分辨率重建图像进行真实性判断;

10、7)分别计算像素损失、特征损失、对抗损失以及边缘损失,并根据损失函数进行反向梯度传播,优化网络参数。

11、本发明进一步的改进在于,步骤1)中,在处理低分辨率图像以生成超分辨率图像之前,使用预超分辨率模块以提供准确的信息。

12、本发明进一步的改进在于,步骤2)中,提取多尺度边缘特征与上下文语义特征的卷积层,使其能够适应遥感图像中各种物体的大小;其中,上下文语义特征是由卷积网络在预超分辨率图像上提取得到的,边缘特征是由卷积网络在预超分辨率图像经过了拉普拉斯算子运算得到的边缘图上提取得到的。

13、本发明进一步的改进在于,步骤3)中,在双向边缘特征融合模块和双向上下文特征融合模块中结合了自顶向下和自底向上的方法,将位置信息引入到融合特征中,使得融合特征同时具备语义信息和位置信息;第i+1个双向边缘特征融合模块输出的边缘特征为其中为具有最小尺寸的特征,由第i个双向边缘特征融合模块输出的边缘特征表示为:

14、

15、其中,resize(·)表示使用插值操作使张量的维度保持一致;w1和w2是两个可学习的权重向量,代表着两个不同尺度特征的重要性;∈是一个用于增加模型训练稳定性的数值,其值被设为1×10-6,lrelu(·)代表leakyrelu激活函数。

16、本发明进一步的改进在于,步骤3)中,上下文语义特征与边缘特征的信息交流的过程表示为:

17、

18、

19、其中,与分别代表信息交流前的上下文语义特征与边缘特征,和分别代表信息交流后的上下文语义特征与边缘特征,代表逐元素相乘运算,conv(·)代表3×3卷积运算,lrelu(·)代表leakyrelu激活函数。

20、本发明进一步的改进在于,步骤4)中,边缘重建模块通过特征整合、坐标注意力机制、特征融合三部分,聚合多尺度边缘特征并重建出增强后的边缘图像;设fr=[fr1,fr2,fr3]表示具有不同尺度的残差连接的输出特征;多尺度特征首先被调整到与目标超分辨率图像相同的形状,然后拼接在一起形成一个统一的特征fm,这个过程表示为:

21、

22、fm=concat(fr1,r2(fr2),r4(fr3))

23、其中,concat(·)表示在通道维度上进行张量拼接操作;r2(·)和r4(·)分别表示2×和4×的上采样操作,在进行尺寸缩放操作之后,三个特征将保持在一个相同的特征维度中,即fr1,r2(fr2),r4(fr3)∈r4h×4w×c,其中h和w分别表示低分辨率图像的长度和宽度,c表示特征的输出通道数;输出的特征张量fm∈r4h×4w×3c先输入到坐标注意力机制中更准确地定位和识别感兴趣的目标,使模型自适应学习不同通道对于重建物体的重要性信息,以及在整幅图像中感知物体空间坐标的能力;坐标注意力机制的输出张量将通过特征融合网络,该网络由三个卷积层组成,分别具有卷积核尺寸为1×1、3×3和1×1的卷积层,对于每个卷积层的输出特征,都跟随使用了一个leakyrelu激活层以提高模型的非线性拟合能力;边缘重建模块将增强后的多尺度特征融合为一体并生成增强边缘图e*,这个计算过程表述如下:

24、e*=fs(ca(fm))

25、其中,ca(·)表示通道注意力模块,fs(·)表示特征融合模块。

26、本发明进一步的改进在于,步骤5)中,将预超分图像中含有噪声的边缘ipre替换为重建后的边缘图e*,使得最终的超分辨率图像能够反映不同尺度的物体和不同类别物体所具有的真实边缘,该过程表示为:

27、isr=ipre+e*-l(ipre)。

28、本发明进一步的改进在于,步骤7)中,像素损失特征损失和对抗损失分别表示为:

29、

30、

31、

32、其中,isr代表网络的输出超分辨率图像,ihr代表实际对应的参考高分辨率图像,φl(·)表示vgg19网络的第l层,ωl表示第l层对应的权重系数;g(·)和d(·)分别表示生成器网络和鉴别器网络,d(·)用于计算输入是真实存在的高分辨率图像还是通过超分辨网络生成的超分辨图像的概率;为了加强生成图像过程中对于高频分量的约束,从而增强重建图像与真实图像的边缘也保持一致性,边缘损失函数表示为:

33、

34、最终,生成器网络的总损失函数由以下公式给出:

35、

36、其中,α、β、γ表示针对每个损失函数设计的权重参数,其作用是为了平衡各损失函数的量级。

37、本发明至少具有以下有益的技术效果:

38、本发明提供的基于上下文感知边缘增强的遥感图像超分辨率方法,在具体操作时,首先将待处理的低分辨率图像输入到初始特征提取模块,首先使用预超分辨率模块进行处理,以生成预超分辨率图像,预超分辨率模块可以重建除边缘外的大部分区域,将预超分辨率图像分别输入到边缘和上下文语义特征提取层,获得相应的两种类型的多尺度特征。进一步,将两种类型的多尺度特征输入到边缘增强模块,首先由双向边缘特征融合模块和双向上下文特征融合模块对其进行双向加权融合,同时使用上下文边缘信息交换模块在边缘分支与上下文分支之间进行信息交换,将经过多个边缘增强模块迭代增强后的多尺度边缘特征输入到边缘重建模块进行边缘聚合重建。最后使用vgg鉴别器网络对超分辨率重建图像进行真实性判断,并使用超分辨率图像和高分辨率图像分别计算像素损失、特征损失、对抗损失以及边缘损失,并根据损失函数进行反向梯度传播,优化网络参数。

39、进一步,本发明中的针对人眼视觉和机器视觉分析的遥感图像超分辨率框架,遥感图像通常包含大量不同尺度、形状和复杂空间关系的物体。因此,遥感图像具有高度丰富的上下文语义特征。然而,在遥感图像复杂的退化过程中,上下文语义特征会受到严重影响。ceegan进行上下文语义特征和边缘特征之间的信息交换,将上下文特征融入到图像中,旨在尽可能地恢复生成的超分辨率图像中的纹理信息。两种类型的特征相辅相成,以满足人类视觉习惯和机器视觉应用的需求。

40、进一步,本发明中的基于上下文引导的边缘增强模块,为了增强边缘细节模糊的图像,我们在边缘特征增强模块中探索并集成了多尺度边缘特征和上下文语义特征。高层上下文语义特征有利于指导边缘特征的提取和增强。因此,我们保持上下文语义和边缘分支之间的信息交互,以帮助边缘分支理解图像中的高级语义信息。此外,我们融合了边缘特征增强模块增强的多尺度特征,并通过边缘恢复模块重建边缘图。

41、进一步,本发明中的一种边缘损失函数,通过在边缘域加入对超分辨率图像和高分辨率图像的约束,生成将模型的注意力从像素域扩展到边缘域,使生成的图像更加真实并保留重要的边缘细节。

42、综上所述,本发明提供一种基于上下文感知边缘增强的遥感图像超分辨率方法。本发明针对现有超分辨率方法无法准确恢复物体边缘的问题,建立了一个边缘增强模块,通过双向加权融合的方法来增强特征,同时设计了上下文语义特征与边缘特征的信息交流模块使用上下文语义特征指导边缘特征,最后使用边缘恢复模块融合由边缘特征增强模块增强的多尺度边缘特征,重构精细的边缘图。针对现有损失函数仅在像素域对生成图像进行约束的问题,设计了一个边缘损失函数来约束生成的超分辨率图像和高分辨率图像在边缘域上的相似性。从整体上来看,本发明可以取得更加符合人眼视觉习惯的图像,并且具有良好的实际应用价值。

- 还没有人留言评论。精彩留言会获得点赞!