主题挖掘方法、装置、电子设备及存储介质与流程

本发明涉及人工智能,尤其涉及一种主题挖掘方法、装置、电子设备及存储介质。

背景技术:

1、随着信息数量爆炸式的增长,依靠人工的方式难以实现对全部文本信息高效阅读和理解,对文本信息进行主题挖掘,可以提高阅读和理解文本信息的效率。

2、现有技术中,可以利用基于深度学习构建的主题模型,对文本信息进行主题挖掘,获得上述文本信息中的主题和/或每一主题的主题关键词。

3、但是,基于上述主题模型挖掘得到的主题和主题关键词通常稀疏性不强。因此,如何确保主题挖掘的准确性和全面性的基础上,增强挖掘得到的主题和/或主题关键词的稀疏性,是本领域亟待解决的技术问题。

技术实现思路

1、本发明提供一种主题挖掘方法、装置、电子设备及存储介质,用以解决现有技术中基于深度学习构建的主题模型挖掘得到的主题和主题关键词通常稀疏性不强的缺陷,实现在确保主题挖掘的准确性和全面性的基础上,增强挖掘得到的主题和/或主题关键词的稀疏性。

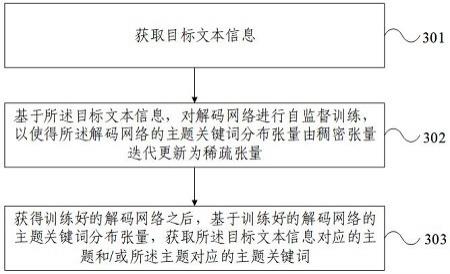

2、本发明提供一种主题挖掘方法,包括:

3、获取目标文本信息;

4、基于所述目标文本信息,对解码网络进行自监督训练,以使得所述解码网络的主题关键词分布张量由稠密张量迭代更新为稀疏张量;

5、获得训练好的解码网络之后,基于训练好的解码网络的主题关键词分布张量,获取所述目标文本信息对应的主题和/或所述主题对应的主题关键词;

6、其中,所述解码网络基于预训练语言模型构建。

7、根据本发明提供的一种主题挖掘方法,所述解码网络,包括:初始化模块以及向量转换模块;

8、所述基于所述目标文本信息,对解码网络进行自监督训练,包括:

9、获得所述初始化模块输出的所述解码网络的模型参数,所述模型参数包括主题关键词分布张量,所述初始化模块用于初始化所述解码网络的模型参数;

10、将所述解码网络的主题关键词分布张量输入所述向量转换模块,获取所述向量转换模块输出的所述解码网络对应的加权主题关键词上下文表示向量;

11、基于所述目标文本信息和所述加权主题关键词上下文表示向量,计算所述解码网络的损失函数的取值;

12、在所述损失函数的取值未收敛的情况下,更新所述解码网络的模型参数,并重复上述计算所述解码网络的损失函数的取值的步骤,直至所述损失函数的取值收敛,获得训练好的解码网络。

13、根据本发明提供的一种主题挖掘方法,所述向量转换模块,包括:稀疏单元、文本化单元以及加权单元;

14、所述将所述解码网络的主题关键词分布张量输入所述向量转换模块,所述向量转换模块输出的所述解码网络对应的加权主题关键词上下文表示向量,包括:

15、将所述解码网络的主题关键词分布张量输入所述稀疏单元,由所述稀疏单元对所述解码网络的主题关键词分布张量进行稀疏化处理,进而获得所述稀疏单元输出的稀疏化后的主题关键词分布张量;

16、将所述稀疏化后的主题关键词分布张量输入文本化单元,由所述文本化单元对所述稀疏化后的主题关键词分布张量进行文本化,获得主题关键词序列之后,基于所述主题关键词序列生成所述主题关键词序列的上下文表示张量,进而获得所述文本化单元输出的主题关键词序列的上下文表示张量;

17、将所述稀疏化后的主题关键词分布张量和所述主题关键词序列的上下文表示张量输入所述加权单元,由所述加权单元基于所述稀疏化后的主题关键词分布张量,对所述主题关键词序列的上下文表示张量进行加权处理,进而获得所述加权单元输出的加权主题关键词上下文表示向量。

18、根据本发明提供的一种主题挖掘方法,所述稀疏单元对所述解码网络的主题关键词分布张量进行稀疏化处理的具体步骤包括:

19、基于所述解码网络的主题关键词分布张量,按照出现频率由高到低的顺序,对每一主题对应的各主题关键词进行降序排序,获取每一主题对应的主题关键词序列;

20、基于每一主题对应的主题关键词序列,确定每一主题对应的各主题关键词中排名前目标数量的主题关键词以及所述排名前目标数量的主题关键词的索引位置;

21、基于每一主题对应的各主题关键词中排名前目标数量的主题关键词以及所述排名前目标数量的主题关键词的索引位置,按照稀疏张量的非零元素坐标表示格式,对所述解码网络的主题关键词分布张量进行稀疏化处理,获得稀疏化后的主题关键词分布张量。

22、根据本发明提供的一种主题挖掘方法,所述文本化单元,包括:第一预训练语言模型;

23、所述文本化单元基于所述主题关键词序列生成所述主题关键词序列的上下文表示张量的具体步骤包括:

24、将所述主题关键词序列输入第一预训练语言模型;

25、获取所述第一预训练语言模型输出的所述主题关键词序列的上下文表示张量。

26、根据本发明提供的一种主题挖掘方法,所述第一预训练语言模型包括transfomer模型、sentence-bert模型和bert-base模型中的任意一种。

27、根据本发明提供的一种主题挖掘方法,所述加权单元基于所述稀疏化后的主题关键词分布张量,对所述主题关键词序列的上下文表示张量进行加权处理的具体步骤,包括:

28、基于所述稀疏化后的主题关键词分布张量,获取主题关键词的归一化权重张量;

29、计算所述主题关键词的归一化权重张量与所述主题关键词序列的上下文表示张量的乘积,获得所述主题关键词的归一化权重张量与所述主题关键词序列的上下文表示张量的乘积结果之后,消除所述主题关键词的归一化权重张量与所述主题关键词序列的上下文表示张量的乘积结果中的冗余维度,获得所述加权主题关键词上下文表示向量。

30、根据本发明提供的一种主题挖掘方法,所述基于所述目标文本信息和所述加权主题关键词上下文表示向量,计算所述解码网络的损失函数的取值,包括:

31、对所述目标文本信息进行文本转换,将所述目标文本信息转换为词项编号序列;

32、将所述词项编号序列输入第二预训练语言模型,获取所述第二预训练语言模型输出的所述目标文本信息的文本向量;

33、将所述文本向量分别输入第一线性网络和第二线性网络,获取所述第一线性网络输出的所述目标文本信息均值向量和所述第二线性网络输出的所述目标文本信息的方差向量;

34、对所述均值向量和所述方差向量进行重参数化和归一化计算之后,获得所述目标文本信息归一化后的主题成分向量;

35、基于所述目标文本信息归一化后的主题成分向量、所述均值向量、所述方差向量和所述加权主题关键词上下文表示向量,计算所述解码网络的损失函数的取值。

36、根据本发明提供的一种主题挖掘方法,在所述基于所述目标文本信息归一化后的主题成分向量、所述均值向量、所述方差向量和所述加权主题关键词上下文表示向量,计算所述解码网络的损失函数的取值之前,所述方法还包括:

37、对所述目标文本信息进行词袋化处理,获取所述目标文本信息的词袋化表示向量;

38、所述基于所述目标文本信息归一化后的主题成分向量、所述均值向量、所述方差向量和所述加权主题关键词上下文表示向量,计算所述解码网络的损失函数的取值,包括:

39、基于所述目标文本信息归一化后的主题成分向量和所述加权主题关键词上下文表示向量,对所述目标文本信息的词袋表示向量进行重构,获得所述目标文本信息重构后的词袋表示向量;

40、基于所述均值向量、所述方差向量、所述目标文本信息的词袋表示向量以及所述目标文本信息重构后的词袋表示向量,计算所述损失函数的取值。

41、根据本发明提供的一种主题挖掘方法,所述基于所述目标文本信息归一化后的主题成分向量和所述加权主题关键词上下文表示向量,对所述目标文本信息的词袋表示向量进行重构,获得所述目标文本信息重构后的词袋表示向量,包括:

42、将所述加权主题关键词上下文表示向量输入多层感知机神经网络模型,获取所述多层感知机神经网络模型输出的计算结果;

43、计算所述计算结果与所述目标文本信息归一化后的主题成分向量的乘积,作为所述目标文本信息重构后的词袋表示向量。

44、根据本发明提供的一种主题挖掘方法,所述解码网络的损失函数包括重构损失函数和正则化损失函数;

45、所述基于所述均值向量、所述方差向量、所述目标文本信息的词袋表示向量以及所述目标文本信息重构后的词袋表示向量,计算所述损失函数的取值,包括:

46、基于所述目标文本信息的词袋表示向量和所述目标文本信息重构后的词袋表示向量,计算所述正则化损失函数的取值,基于所述均值向量和所述方差向量,计算所述重构损失函数的取值;

47、计算所述正则化损失函数的取值与目标权重的乘积,获得所述正则化损失函数的取值与第一目标权重的乘积结果之后,计算所述正则化损失函数的取值与目标权重的乘积结果与所述重构损失函数的取值之和,作为所述解码网络的损失函数的取值。

48、根据本发明提供的一种主题挖掘方法,所述第一目标权重基于循环退火策略动态调整。

49、根据本发明提供的一种主题挖掘方法,所述第二预训练语言模型,包括:sentence-bert模型。

50、根据本发明提供的一种主题挖掘方法,所述基于所述目标文本信息归一化后的主题成分向量、所述均值向量、所述方差向量和所述加权主题关键词上下文表示向量,计算所述解码网络的损失函数的取值,包括:

51、基于所述目标文本信息归一化后的主题成分向量和所述加权主题关键词上下文表示向量,对所述目标文本信息的文本向量进行重构,获得所述目标文本信息重构后的文本向量;

52、基于所述均值向量、所述方差向量、所述目标文本信息的文本向量以及所述目标文本信息重构后的文本向量,计算所述损失函数的取值。

53、根据本发明提供的一种主题挖掘方法,所述解码网络的损失函数包括重构损失函数和正则化损失函数;

54、所述基于所述均值向量、所述方差向量、所述目标文本信息的文本向量以及所述目标文本信息重构后的文本向量,计算所述损失函数的取值,包括:

55、基于所述目标文本信息的文本向量以及所述目标文本信息重构后的文本向量,计算所述正则化损失函数的取值,基于所述均值向量和所述方差向量,计算所述重构损失函数的取值;

56、计算所述正则化损失函数的取值与目标权重的乘积,获得所述正则化损失函数的取值与第二目标权重的乘积结果之后,计算所述正则化损失函数的取值与目标权重的乘积结果与所述重构损失函数的取值之和,作为所述解码网络的损失函数的取值。

57、根据本发明提供的一种主题挖掘方法,所述第二目标权重基于循环退火策略动态调整。

58、根据本发明提供的一种主题挖掘方法,所述获取目标文本信息,包括:

59、获取原始文本信息;

60、对所述原始文本信息进行数据处理,剔除所述原始文本信息中的异常信息,获得所述目标文本信息,所述数据处理包括拼写检查、词性分析以及拼写纠错中的至少一种。

61、本发明还提供一种主题挖掘装置,包括:

62、文本获取模块,用于获取目标文本信息;

63、模型训练模块,用于基于所述目标文本信息,对解码网络进行自监督训练,以使得所述解码网络的主题关键词分布张量由稠密张量迭代更新为稀疏张量;

64、主题挖掘模块,用于获得训练好的解码网络之后,基于训练好的解码网络的主题关键词分布张量,获取所述目标文本信息对应的主题和/或所述主题对应的主题关键词;

65、其中,所述解码网络基于预训练语言模型构建。

66、本发明还提供一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现如上述任一种所述主题挖掘方法。

67、本发明还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现如上述任一种所述主题挖掘方法。

68、本发明还提供一种计算机程序产品,包括计算机程序,所述计算机程序被处理器执行时实现如上述任一种所述主题挖掘方法。

69、本发明提供的主题挖掘方法、装置、电子设备及存储介质,通过基于目标文本信息对解码网络进行自监督训练,获得训练好地解码网络之后,基于训练好的解码网络的模型参数,获取目标文本信息中的主题对应的主题关键词,能在确保主题挖掘的准确性和全面性的基础上,基于上述解码网络挖掘得到稀疏性更强的主题和/或主题关键词,上述解码网络能替换并迁移到其他主题模型中,能在提高主题模型的可解释性的同时,提高主题模型运行、计算和存储的效率。

- 还没有人留言评论。精彩留言会获得点赞!