一种将重建和修复联合并行的结构指导图像修复方法

本发明涉及图像修复,特别涉及一种将重建和修复联合并行的结构指导图像修复方法。

背景技术:

1、图像修复是计算机视觉领域中的一个重要任务,旨在修复损坏、褪色和含噪的图像。以合理逼真的内容和正确的上下文语意填充图像的孔洞区域,使之全景还原,提升画面质感。

2、图像修复的早期方法可分为基于扩散的方法和基于块的方法。基于扩散的方法是利用图像中已知的像素信息来推断未知区域的像素值。这种方法在处理较大的缺失区域或复杂的图像结构时,难以准确地恢复缺失的细节信息。基于块的方法是将图像分割成块,首先从待修补区域的边界上选取一个像素点,同时以该点为中心,根据图像的纹理特征,选取大小合适的纹理块,然后在待修补区域的周围寻找与之最相近的纹理匹配块来替代该纹理块。然而,当关键区域和重要结构缺损时,这种方法不再适用。

3、利用图像结构特征指导图像修复,是近年来在深度学习技术广泛应用背景下出现的新方法。应用该方法可以在缺失区域内生成合理的内容。现有的基于结构特征的图像修复方法大致分为两类:非结构指导修复方法和结构指导修复方法。非结构指导修复方法包括单阶段修复网络和多阶段修复网络,内含多个修复阶段和子网络。网络在训练时需要按照特定的顺序执行,增加了整个网络的复杂度和训练难度,也限制了网络和适应性的灵活性。在实际应用中,多阶段网络还会导致训练过程中错误的累积和传播,影响最终的修复结果。结构指导修复方法主要是通过图像的抽象结构特征指导图像修复。这类方法大多选择先修复图像的结构,再依靠完整的结构特征修复图像。网络设计为单方向单路结构,存在的问题是图像的修复效果过于依赖结构信息。如果图像的结构存在噪声或边缘不明显,则无法准确地修复缺失的区域。

4、本发明基于深度学习机制,提出一种图像平滑结构指导图像修复的网络,网络由图像平滑结构提取网络ns和图像修复网络ninp并行组成。其中ns网络由膨胀卷积组成,ninp网络由残差门卷积组成。图像平滑结构的生成内容不直接作为下一级网络的输入,只为网络的解码层提供指导信息。该网络能够避免训练过程中错误信息的累积和传播,降低网络的复杂度和训练难度。不同于之前先重建结构再重建图像的方法,而是结构与图像重建同步进行,使得图像修复结果不再依赖图像结构信息,也不会因为图像结构中存在噪声或模糊而受到影响。能够更有效地恢复图像缺损内容。

技术实现思路

1、本发明目的就在于为了解决上述的问题,而提供一种将重建和修复联合并行的结构指导图像修复方法。

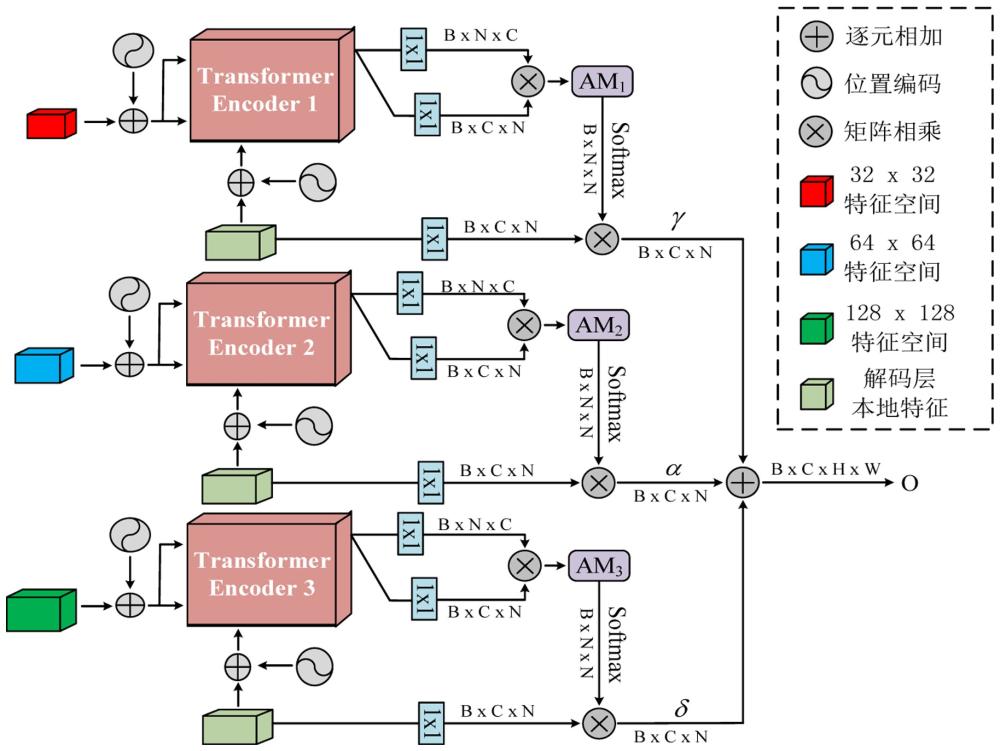

2、为实现上述目的,本发明采取的技术方案为:所述平滑结构网络,由网络ns和网络ninp并行组成,ns网络由膨胀卷积组成,ninp网络由残差门卷积组成,ns网络的目标是重建受损图像的平滑结构,ninp网络的目标是修复受损图像的全文信息,同时,为了能够学习到结构和纹理细节之间的依赖关系,提出一种多尺度特征指导模块,利用多尺度特征指导模块获得的多尺度空间特征信息,指导ninp网络完成对孔洞图像的填充;

3、其中,ns网络主要以生成缺损图像的完整平滑结构为目标,ns网络的目标函数是图像重建损失函数,重建损失我们采用平均绝对误差损失函数计算修复结果与真实值之间的差异,损失函数表达式如下所示:

4、

5、

6、

7、其中,i表示对应图像的三个尺度,分别是32×32,64×64和256×256,igs(i)表示原始完整图像的平滑结构,isout(i)表示ns网络的生成结果,m表示二进制掩码(mask=1),lshole表示孔洞区域的图像重建损失,lsvalid表示非缺损区域的图像重建损失,lsrec表示ns网络的重建总损失,λrec为平衡因子,

8、网络ninp的目标是生成上下文语义一致、色彩纹理完整的图像,ninp网络的损失函数设置包括重建损失、对抗损失、风格损失和感知损失,重建损失设置与ns网络相类似,如下式所示:

9、

10、

11、

12、其中,lhole表示图像孔洞区域的重建损失,lvalid表示图像非孔洞区域的重建损失,ig(i)表示原始图像,iout(i)表示修复网络的生成结果,m表示二进制掩码(mask=1),lrec表示修复网络的重建总损失,

13、使用mfg模块对结构特征和受损图像特征之间的联系进行建模,并对ninp网络的解码层进行指导。

14、进一步地,网络ninp中的对抗损失采用lsgan方法,使生成器产生更真实的结果,降低了梯度消失或梯度爆炸的风险,从而提高模型的稳定性和生成效果,对抗损失定义如下:

15、

16、

17、其中,ld为判别器对抗损失,lg为生成器对抗损失,d表示判别器,eig表示真实图像的概率密度函数,eiout表示修复网络生成图像的概率密度函数,ig表示原始图像,iout表示修复网络的生成结果。

18、进一步地,网络ninp中还设有感知损失和风格损失,使用训练好的vgg-16网络对图像进行特征提取,在空间特征中计算两者的损失,通过对图像语义信息和纹理特征的比较,感知损失能够有效的衡量生成图像和真实值之间的差异,进而优化生成模型,感知损失和风格损失定义如下:

19、

20、

21、其中,lper表示感知损失,lstyle表示风格损失,fi表示预先训练好的vgg-16网络中第i层特征图,gi表示格莱姆矩阵,代表了特征之间的协方差矩阵以及每种特征之间的相关性,综合上述,图像全文修复网络ninp的总损失为:

22、l=lrec+λgld+λglg+λplper+lstyle (11)

23、其中,λg和λp都为平衡因子。

24、进一步地,平滑结构网络的具体实现步骤如下:

25、s1:在受损图像重建过程中,网络ns对图像做全变分平滑处理,提取图像的结构信息,其包含了原图像中的边缘、纹理、形状、颜色和亮度等多元信息;

26、s2:在训练过程中,ns网络对ninp网络的指导通过mfg模块实现,mfg模块的输入包含三个不同维度的多特征空间,特征空间尺寸分别为32×32、64×64和128×128,特征空间由ns网络解码层的完整平滑结构图像特征和ninp网络编码层的受损图像特征融合而成,平滑结构图像经过平滑、滤波和细节模糊处理后更易于分析,比原始受损图像更容易修复;

27、s3:将相同尺寸的完整结构图像和缺损图像进行匹配,通过mfg模块对两种特征信息进行建模并建立联系,特征均衡后的信息根据不同卷积层尺度传播到ninp网络的解码层;

28、s4:在深度学习中,不同感受野可以捕捉不同尺度的特征信息,其中,较小的感受野适合捕捉局部细节信息,较大的感受野能够捕捉范围更广的上下文信息,不同感受野的设置有助于模型全面地理解数据特征,保证重建后的图像上下文语义一致。

29、与现有技术相比,本发明具有如下有益效果:

30、本发明中的网络能够避免训练过程中错误信息的累积和传播,降低网络的复杂度和训练难度,不同于之前先重建结构再重建图像的方法,而是结构与图像重建同步进行,使得图像修复结果不再依赖图像结构信息,也不会因为图像结构中存在噪声或模糊而受到影响。能够更有效地恢复图像缺损内容。

- 还没有人留言评论。精彩留言会获得点赞!