基于RGB图像的机器人6D抓取姿态估计方法及系统

本发明属于机器人抓取领域,更具体地,涉及一种基于rgb图像的机器人6d抓取姿态估计方法及系统。

背景技术:

1、工业机器人是现代制造业的重要自动化设备,在生产线上主要承担物料的搬运工作,目前在生产线上工作的搬运工业机器人大都是通过示教或预编程对其进行操作的,这会导致生产线柔性较差,因此,人们开展了大量针对于机器人视觉抓取的研究。在机器人抓取的问题中,物体相对于机器人的姿态是非常关键的,它直接决定了机器人能否准确抓取目标物体。姿态估计按网络的输入可以分为rgb图像和rgbd图像,二者的区别是:是否包含有深度信息,包含深度信息会使估计更准确,但rgb相机成本更低,应用更广泛,因此研究用于rgb图像的姿态估计方法是非常重要的。

2、目前,对于物体的姿态估计研究有许多方案,例如:专利cn114119753a面向机械臂抓取的透明物体6d姿态估计方法,使用了rgb、边缘、深度图像三个输入,嵌入自注意力机制融合其特征并提取关键点;专利cn109215080a提出了一种基于深度学习迭代匹配的6d姿态估计网络训练方法,使用rgb图像作为输入,多次迭代求取关键点。现有设计中有较多使用了关键点热图的方案,例如:专利cn114842085a一种全场景车辆姿态估计方法,引入swintransformer作为主干网络,基于图像分割的结果转换为位置编码问题。但上述方法的姿态估计结果无法达到高精度。

技术实现思路

1、针对现有技术的以上缺陷或改进需求,本发明提供了一种基于rgb图像的机器人6d抓取姿态估计方法及系统,其目的在于,通过准确确定物体姿态,提高机器人对目标物体的抓取精度。

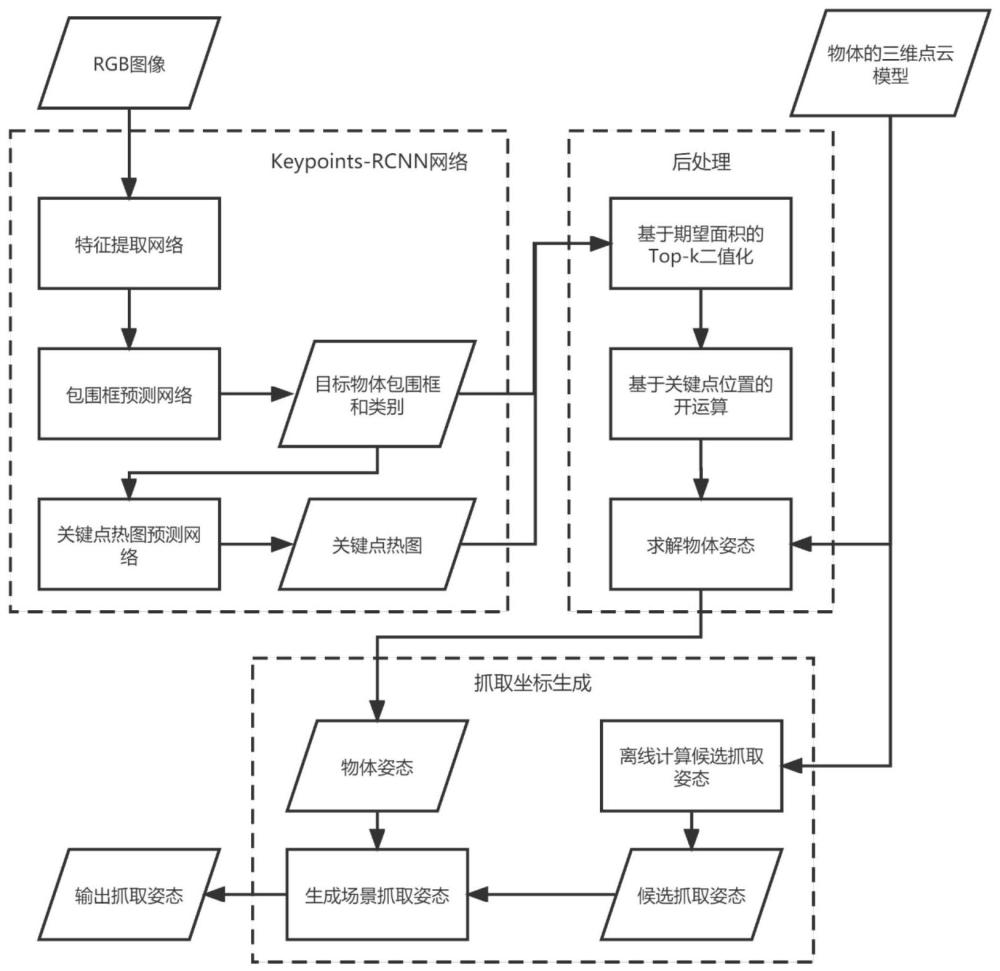

2、为实现上述目的,按照本发明的第一方面,提出了一种基于rgb图像的机器人6d抓取姿态估计方法,包括如下步骤:

3、获取目标物体的rgb图像和三维点云模型,通过关键点热图预测模型获取区域热图和偏移热图;所述关键点热图预测模型包括区域提取主干、分类预测分支、区域预测分支和偏移预测分支,其中:

4、所述区域提取主干用于从rgb图像中提取特征图;所述分类预测分支用于基于特征图,确定目标物类别并预测包围框,进而根据包围框确定局部特征图;所述区域预测分支用于基于局部特征图中的长距离特征,确定其中各个像素点属于关键点的概率,得到区域热图,所述关键点预先在物体的三维点云模型中选取;所述偏移预测分支用于基于局部特征图中的长距离特征,确定其中各个像素点相对关键点的偏移坐标,得到偏移热图;

5、对区域热图进行二值化,并通过二值化后的区域热图对偏移热图进行过滤,得到关键点相对于区域热图的坐标,进而确定关键点相对rgb图像的坐标;基于关键点相对rgb图像的坐标,得到物体在相机坐标系下的姿态;然后基于相机坐标系到世界坐标系的变换矩阵,得到物体在世界坐标系下的姿态;

6、基于物体在世界坐标系下的姿态,确定机器人的抓取姿态,实现机器人对目标物体的抓取。

7、作为进一步优选的,通过top-k二值化方法进行对区域热图的二值化:

8、将区域热图中像素的输出值从大到小排序,选取其中前k个像素点,将该k个像素点置1,其他像素点置0,完成对区域热图的二值化;k值的确定方法为:以区域热图中输出值最大的像素点为圆心,预设r为半径画圆,以该圆位于区域热图范围内的面积为k;所述输出值指像素点属于关键点的概率。

9、作为进一步优选的,通过二值化后的区域热图对偏移热图进行过滤,得到关键点相对区域热图的坐标,包括如下步骤:

10、(1)通过3×3十字结构单元对区域进行腐蚀,腐蚀后剩下的区域为的补集区域记为初始时,迭代次数i=1,迭代初值的确定方法为:对于二值化后的区域热图,选取的像素点区域为初始区域

11、(2)根据区域结合偏移热图计算关键点位置并计算面积所述面积指以为圆心,预设半径画圆,该圆在区域热图内的面积;

12、(3)依距离膨胀,在内选择离最近的n个点置1,得到区域其中

13、(4)判断与的重合程度,当重合程度满足标准时,停止迭代,输出此时的即为关键点相对区域热图的坐标;否则,令i=i+1,并回到步骤(1)。

14、作为进一步优选的,步骤(2)中,关键点位置的计算方式为:

15、

16、其中,p是内的像素坐标,是在像素p处预测的偏移值,其根据偏移热图确定;指腐蚀后剩下的区域中像素点个数。

17、作为进一步优选的,通过预获取的训练集对keypoints-rcnn网络进行训练,将训练好的keypoints-rcnn网络作为关键点热图预测模型;训练时,根据分类预测分支确定的目标物类别进行分类训练,即针对不同的目标物类别,对应训练不同的区域预测分支和偏移预测分支。

18、作为进一步优选的,对keypoints-rcnn网络进行训练时,损失函数l为:

19、l=lrpn+lcr+lhm+lofst

20、其中,lrpn,lcr,lhm,lofst分别为区域提取主干、分类预测分支、区域预测分支和偏移预测分支的损失函数;

21、区域预测分支的损失函数lhm为d(f1)区域的交叉熵均值和fc区域的交叉熵均值相加;d(f1)为正例近邻区域,fc为其他区域,fc=f1-d(f1),f1为真值为1的区域;

22、偏移预测分支的损失函数lofst=lofst_comp+lofst_syn;lofst_comp为分量损失,用于衡量区域f1内各个点的偏移预测值与偏移真值的误差,采用均方差函数;lofst_syn为合成损失,用于衡量总体的系统误差,采用huber损失函数。

23、作为进一步优选的,基于物体在世界坐标系下的姿态,确定机器人的抓取姿态,包括如下步骤:

24、预获取候选抓取姿态集合,基于机器人的运动范围以及非目标物体的干涉,对候选抓取姿态集合中抓取姿态进行排除;然后基于物体在世界坐标系下的姿态,对剩余的抓取姿态进行评估,确定最终的机器人抓取姿态。

25、作为进一步优选的,基于物体在世界坐标系下的姿态,对剩余的抓取姿态进行评估,包括如下步骤:

26、对剩余的每个抓取姿态:根据物体在世界坐标系下的姿态以及该抓取姿态确定计算夹持接触点的中心点坐标;进而计算物体重力关于该中心点的力矩;

27、对比各抓取姿态对应的力矩,选取其中力矩最小的抓取姿态作为最终的机器人抓取姿态。

28、按照本发明的第二方面,提供了一种基于rgb图像的机器人6d抓取姿态估计系统,其包括处理器,所述处理器用于执行上述基于rgb图像的机器人6d抓取姿态估计方法。

29、按照本发明的第三方面,提供了一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现上述基于rgb图像的机器人6d抓取姿态估计方法。

30、总体而言,通过本发明所构思的以上技术方案与现有技术相比,主要具备以下的技术优点:

31、1.本发明设计了一种关键点热图预测模型,将区域+偏移的方法运用于物体的姿态估计,进而对区域热图和偏移热图的后处理得到物体姿态,提高了机器人对目标物体的抓取精度。

32、2.本发明提出了一种解析关键点热图的后处理方法,包含了基于期望面积的top-k方法和基于关键点位置的开运算,其综合了关键点区域热图和偏移热图的信息,提升了关键点位置估计的准确性。

33、3.在训练keypoints-rcnn网络时,对于区域预测的损失函数,提升了真值邻域的权重,使网络专注于预测区域边界的准确性;对于偏移预测的损失函数,增加了合成损失,减少预测偏移的恒定误差。

34、4.在生成抓取姿态时,基于物体点云模型,预先离线查找物体在各个方向上的稳定的抓取姿态作为候选姿态,然后在线计算过程中对场景环境进行过滤,运算速度较快,最终输出抓取姿态,可兼顾抓取姿态的准确性和实时性。

- 还没有人留言评论。精彩留言会获得点赞!