基于图模型表征的空间非合作目标语义模型构建方法和系统

本发明涉及模型构建,具体地,涉及一种基于图模型表征的空间非合作目标语义模型构建方法和系统。

背景技术:

1、空间非合作目标被认为是无法建立通讯,无法实现控制的空间目标,对空间目标的感知很大程度上依赖大量的观测结果与目前现有的数据库进行比对实现的,在面对数据库中不存在的目标时,则需要根据观测结果扩充数据库。

2、专利文献cn106874942a(申请号:cn201710044816.8)公开了一种基于正则表达式语义的目标模型快速构建方法,属于机器视觉与模式识别领域。首先对被识别物体所在图像进行预处理,以提高特征提取的质量,其后通过harris特征检测算法提取出图像目标的局部特征,最后通过引申定义的正则表达语义,结合定义好的图像素材库描述出被识别物的目标匹配模型。然而该专利无法解决目前存在的技术问题。

3、因此从通过可见光信息的观测中获取目标的结构构成信息十分重要,而本发明旨在基于目标识别、语义分割、单目6d位姿估计深度学习方法对空间非合作目标飞行器构建一个能够表征其结构组成的语义模型。

技术实现思路

1、针对现有技术中的缺陷,本发明的目的是提供一种基于图模型表征的空间非合作目标语义模型构建方法和系统。

2、根据本发明提供的基于图模型表征的空间非合作目标语义模型构建方法,包括:

3、步骤1:通过目标本体的3d边界框顶点识别,确定目标本体的空间象限;

4、步骤2:根据目标识别深度学习模型所识别得到的各种载荷在图像上的位置信息,估计各载荷归属于各目标本体空间象限的可能性;

5、步骤3:形成单视角下的目标语义模型,并使用无向图进行描述,形成目标语义模型无向图;

6、步骤4:基于图匹配的方法,将各个视图观测得到的目标语义模型无向图进行统合,形成一个在多视图下具有一致性的目标语义模型。

7、优选的,所述步骤2包括:将目标本体的空间区域划分成与长方体六个面对应的六个空间象限,并对部件识别结果进行语义分割,计算目标部件所在的像素区域与六个空间象限之间的重合率以及该区域在几何上的可见性,从而确定目标部件在六个空间象限内的归属可能性。

8、优选的,所述步骤3包括:

9、步骤3.1:建立目标的空间描述图,将目标本体作为中心节点,并设置周边与其相连的六个节点代表以本体中心为原点的六个空间朝向,成为非合作目标构型的空间象限节点,其中相邻的两个空间象限节点之间以边相连;

10、步骤3.2:对于某一帧图像,通过部件识别算法所检测到的部组件经过空间位置的解算,归属到各个空间象限节点上,以部件类型代表的部件节点与所属的空间象限节点以边相连,形成包含部组件信息的目标语义模型的图描述;

11、步骤3.3:对序列图像进行检测,重复部组件空间位置解算,归属到各个空间象限节点上,得到目标语义模型的图描述的序列。

12、优选的,在构建图模型时对关键载荷所代表的节点施加特殊性和唯一性,具体为:对一部分视角中所识别到的具有代表性的部件,将图模型中表示空间象限的节点与其对应的载荷节点建立唯一对应关系,消除针对一个非合作目标的空间结构检测在多视图之间的差异性,从而实现对不同观测视角下得到的图模型中具有代表性的部件节点进行预匹配,保留在预匹配过程中带有奇异性或者不确定性的观测结果。

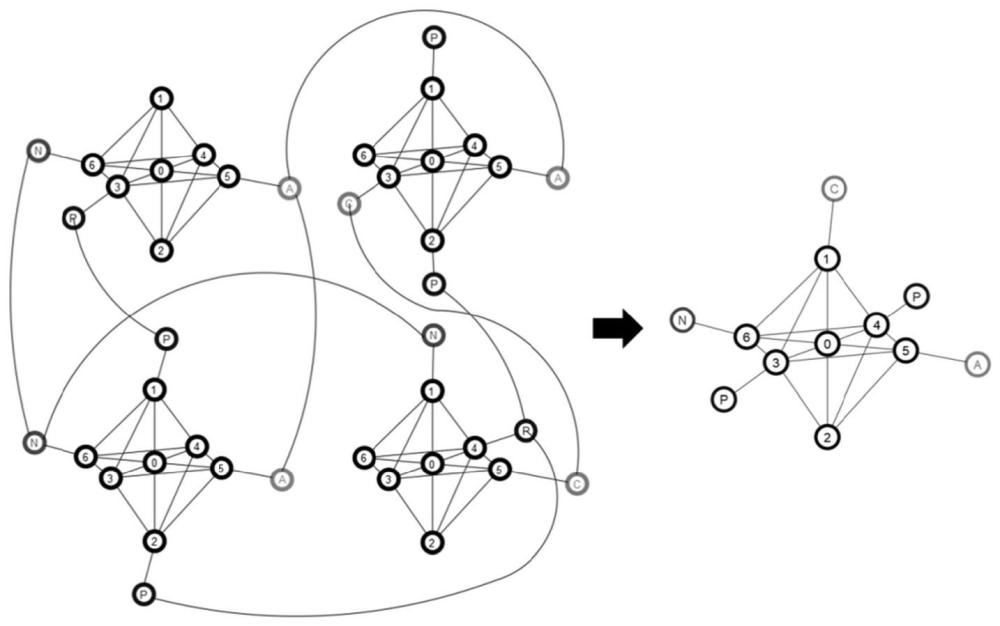

13、优选的,对各视图的目标语义图模型进行图匹配,实现多视图观测结果的融合,具体为:

14、图匹配基于节点的相似性和边的相似性开展,对于部件节点,其本身表述包含部件类型和识别置信度,同时考虑到与该部件节点直连的空间象限节点相邻和相对的其余空间象限节点的信息,对各项信息赋予相应权重;在匹配过程中,采用非精确图匹配,寻找能够使的节点相似度和边相似度之和最大化的一个优化问题;

15、给定两个图g1={p1,q1,g1,h1},g2={p2,q2,g2,h2},其中p表示节点的特征;q表示边的特征;g、h表示节点和边的对应关系;定义两个关联矩阵kp、kq,表示两幅图节点和节点之间以及边和边之间的相似度,使得图匹配问题转化成寻找两幅图之间最优的匹配关系,使得节点间的相似度和边之间的相似度之和最大,表达式为:

16、

17、其中,第一项表示匹配节点之间的相似度之和;第二项表示匹配边之间的相似度之和;x表示两幅图节点之间的匹配关系,表示图g1中的第i1个节点和图g2中的第i2匹配,节点之间的匹配关系满足一一对应的约束;表示图g1中的第c1条边由节点i1为始;表示图g1中的第c1条边由节点j1为终;和组合起来表示节点和边的对应关系,表示图g1中的第c1条边由节点i1指向节点j1,表示图g1中的第c1条边由节点i1不指向节点j1;

18、采用24次枚举的方式进行两幅图模型之间的匹配度计算,并得到jgm(x)最大的结果,从而得到合适的匹配关系,最终形成相对完整的目标语义模型。

19、根据本发明提供的基于图模型表征的空间非合作目标语义模型构建系统,包括:

20、模块m1:通过目标本体的3d边界框顶点识别,确定目标本体的空间象限;

21、模块m2:根据目标识别深度学习模型所识别得到的各种载荷在图像上的位置信息,估计各载荷归属于各目标本体空间象限的可能性;

22、模块m3:形成单视角下的目标语义模型,并使用无向图进行描述,形成目标语义模型无向图;

23、模块m4:基于图匹配的方法,将各个视图观测得到的目标语义模型无向图进行统合,形成一个在多视图下具有一致性的目标语义模型。

24、优选的,所述模块m2包括:将目标本体的空间区域划分成与长方体六个面对应的六个空间象限,并对部件识别结果进行语义分割,计算目标部件所在的像素区域与六个空间象限之间的重合率以及该区域在几何上的可见性,从而确定目标部件在六个空间象限内的归属可能性。

25、优选的,所述模块m3包括:

26、模块m3.1:建立目标的空间描述图,将目标本体作为中心节点,并设置周边与其相连的六个节点代表以本体中心为原点的六个空间朝向,成为非合作目标构型的空间象限节点,其中相邻的两个空间象限节点之间以边相连;

27、模块m3.2:对于某一帧图像,通过部件识别算法所检测到的部组件经过空间位置的解算,归属到各个空间象限节点上,以部件类型代表的部件节点与所属的空间象限节点以边相连,形成包含部组件信息的目标语义模型的图描述;

28、模块m3.3:对序列图像进行检测,重复部组件空间位置解算,归属到各个空间象限节点上,得到目标语义模型的图描述的序列。

29、优选的,在构建图模型时对关键载荷所代表的节点施加特殊性和唯一性,具体为:对一部分视角中所识别到的具有代表性的部件,将图模型中表示空间象限的节点与其对应的载荷节点建立唯一对应关系,消除针对一个非合作目标的空间结构检测在多视图之间的差异性,从而实现对不同观测视角下得到的图模型中具有代表性的部件节点进行预匹配,保留在预匹配过程中带有奇异性或者不确定性的观测结果。

30、优选的,对各视图的目标语义图模型进行图匹配,实现多视图观测结果的融合,具体为:

31、图匹配基于节点的相似性和边的相似性开展,对于部件节点,其本身表述包含部件类型和识别置信度,同时考虑到与该部件节点直连的空间象限节点相邻和相对的其余空间象限节点的信息,对各项信息赋予相应权重;在匹配过程中,采用非精确图匹配,寻找能够使的节点相似度和边相似度之和最大化的一个优化问题;

32、给定两个图g1={p1,q1,g1,h1},g2={p2,q2,g2,h2},其中p表示节点的特征;q表示边的特征;g、h表示节点和边的对应关系;定义两个关联矩阵kp、kq,表示两幅图节点和节点之间以及边和边之间的相似度,使得图匹配问题转化成寻找两幅图之间最优的匹配关系,使得节点间的相似度和边之间的相似度之和最大,表达式为:

33、

34、其中,第一项表示匹配节点之间的相似度之和;第二项表示匹配边之间的相似度之和;x表示两幅图节点之间的匹配关系,表示图g1中的第i1个节点和图g2中的第i2匹配,节点之间的匹配关系满足一一对应的约束;表示图g1中的第c1条边由节点i1为始;表示图g1中的第c1条边由节点j1为终;和组合起来表示节点和边的对应关系,表示图g1中的第c1条边由节点i1指向节点j1,表示图g1中的第c1条边由节点i1不指向节点j1;

35、采用24次枚举的方式进行两幅图模型之间的匹配度计算,并得到jgm(x)最大的结果,从而得到合适的匹配关系,最终形成相对完整的目标语义模型。

36、与现有技术相比,本发明具有如下的有益效果:

37、1)本发明采用图模型来表征多视图下通过多种视觉算法推理得到的目标结构组成,形成了紧凑的目标语义模型表达;

38、2)本发明结合空间目标常见结构的领域知识,通过部分具有代表性的载荷对图模型中表示空间象限的节点与其对应的载荷节点建立唯一对应关系,消除了针对一个非合作目标的空间结构检测在多视图之间的差异性;

39、3)本发明通过图匹配的方式对各视角下的非完整目标结构图模型进行融合,解决了离散视角下目标信息难对齐的问题。

- 还没有人留言评论。精彩留言会获得点赞!