一种基于速度预测和图像重建的多目标跟踪方法及装置

本技术涉及无人驾驶,尤其是涉及一种基于速度预测和图像重建的多目标跟踪方法及装置。

背景技术:

1、在自动驾驶场景下的多目标跟踪任务中,现有的多目标跟踪模型通常受到以下几个问题的干扰:

2、形态变化带来的干扰:当车辆在拐弯或者超车运动时,会因为相机角度的变化导致下一帧物体相对于上一帧发生较大姿态变化,此时物体的特征以及形状会导致它的特征发生改变,给跟踪目标带来困难。

3、尺度变化带来的干扰:当目标车辆由远到近或者由近到远运动时,目标的大小尺度发生较大变化,而跟踪框不能及时的改变大小,从而会将背景内容包含在内或者只能检测到目标的一部分,因此进一步导致跟踪目标的特征不准确造成模型精度下降。

4、遮挡与消失带来的干扰:目标因为运动可能会发生被遮挡甚至在画面中消失的情况;在目标遮挡或消失的情况下,由于缺乏长时间的上下文信息,容易将遮挡物误判为目标或导致目标丢失。遮挡物的特征可能会取代目标的特征,成为后续帧的匹配特征,从而进一步导致对后续帧的误判。

技术实现思路

1、有鉴于此,本技术提出了一种基于速度预测和图像重建的多目标跟踪方法及装置,该方法利用视频序列帧预测物体运动速度并融合速度进行图像重建,以解决多目标跟踪任务中行人与车辆遮挡以及位移过大问题的方法。

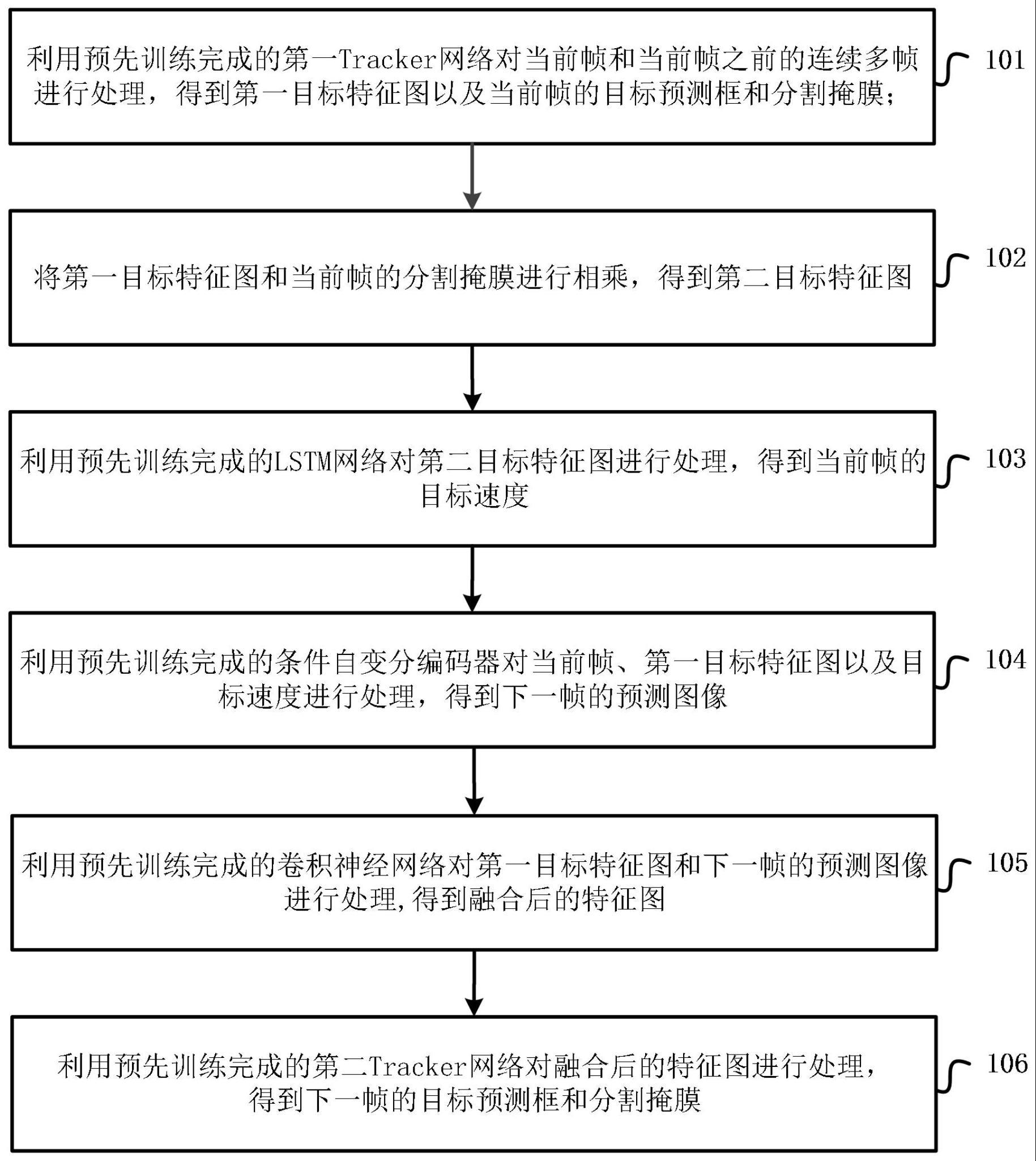

2、第一方面,本技术实施例提供了一种基于速度预测和图像重建的多目标跟踪方法,包括:

3、利用预先训练完成的第一tracker网络对当前帧和当前帧之前的连续多帧进行处理,得到第一目标特征图以及当前帧的目标预测框和分割掩膜;

4、将第一目标特征图和当前帧的分割掩膜进行相乘,得到第二目标特征图;

5、利用预先训练完成的lstm网络对第二目标特征图进行处理,得到当前帧的目标速度;

6、利用预先训练完成的条件自变分编码器对当前帧、第一目标特征图以及目标速度进行处理,得到下一帧的预测图像;

7、利用预先训练完成的卷积神经网络对第一目标特征图和下一帧的预测图像进行处理,得到融合后的特征图;

8、利用预先训练完成的第二tracker网络对融合后的特征图进行处理,得到下一帧的目标预测框和分割掩膜。

9、进一步地,所述方法还包括:对第一tracker网络和lstm网络进行联合训练的步骤。

10、进一步地,对第一tracker网络和lstm网络进行联合训练的步骤,包括:

11、获取第一训练数据集,包括多帧来自视频样本的连续图像以及每帧图像的目标真实速度;

12、从多帧来自视频样本的连续图像中获取m帧连续图像样本,将第m帧作为当前样本帧;

13、利用第一tracker网络对当前样本帧和当前样本帧之前的连续多帧进行处理,得到第一目标特征图样本以及当前样本帧的目标预测框和分割掩膜;

14、将第一目标特征图样本和当前样本帧的分割掩膜进行相乘,得到第二目标特征图样本;

15、利用lstm网络对第二目标特征图样本进行处理,得到当前样本帧的目标预测速度;

16、利用当前样本帧的目标预测速度与目标真实速度,计算第一损失函数;

17、利用第一损失函数更新第一tracker网络和lstm网络的参数。

18、进一步地,所述条件自变分编码器包括编码器和解码器;

19、利用预先训练完成的编码器对当前帧、第一目标特征图以及目标速度进行处理,得到下一帧的预测图像;包括:

20、利用预先训练完成的编码器对当前帧、第一目标特征图以及目标速度进行处理,得到一个依靠当前帧信息采样的隐变量;

21、利用预先训练完成的解码器对隐变量、第一目标特征图以及目标速度进行处理,得到下一帧的预测图像。

22、进一步地,所述方法还包括:

23、获取第二训练数据集,包括多帧来自视频样本的连续图像;

24、从多帧来自视频样本的连续图像中获取m+1帧连续图像样本,将第m帧作为当前样本帧;

25、利用预先训练完成的第一tracker网络对当前样本帧和当前样本帧之前的连续多帧进行处理,得到第一目标特征图样本以及当前样本帧的目标预测框和分割掩膜;

26、将第一目标特征图样本和当前样本帧的分割掩膜进行相乘,得到第二目标特征图样本;

27、利用预先训练完成的lstm网络对第二目标特征图样本进行处理,得到当前样本帧的目标速度;

28、利用编码器对当前样本帧、第一目标特征图样本以及当前样本帧的目标速度进行处理,得到一个依靠当前样本帧信息采样的隐变量;

29、利用解码器对隐变量、第一目标特征图样本以及当前样本帧的目标速度进行处理,得到下一样本帧的预测图像;

30、利用下一样本帧的预测图像和第m+1帧样本,计算条件自变分编码器的第二损失函数;

31、利用第二损失函数更新编码器和解码器的参数。

32、进一步地,所述方法还包括:对卷积神经网络和第二tracker网络进行联合训练的步骤。

33、进一步地,对卷积神经网络和第二tracker网络进行联合训练的步骤,包括:

34、获取第三训练数据集,包括:多帧来自视频样本的连续图像,每张图像标注了目标真实框、道路边界框、可驾驶区域和车道;

35、从第三训练数据集中获取m帧连续图像样本,将第m帧作为当前样本帧;

36、利用预先训练完成的第一tracker网络对m帧连续图像样本进行处理,得到第一目标特征图样本以及当前样本帧的目标预测框和分割掩膜;

37、将第一目标特征图样本和当前样本帧的分割掩膜进行相乘,得到第二目标特征图样本;

38、利用预先训练完成的lstm网络对第二目标特征图样本进行处理,得到当前样本帧的目标速度;

39、利用预先训练完成的条件自变分编码器对当前样本帧、第一目标特征图样本以及当前样本帧的目标速度进行处理,得到第m+1帧的预测图像;

40、利用卷积神经网络对第一目标特征图样本和第m+1帧的预测图像进行处理,得到融合后的特征图样本;

41、利用tracker网络对融合后的特征图样本进行处理,得到第m+1帧的目标预测框和分割掩膜;

42、利用第m+1帧的目标预测框和第m+1帧的目标真实框,计算第三损失函数;

43、利用第三损失函数更新卷积神经网络和第二tracker网络的参数。

44、第二方面,本技术实施例提供了一种基于速度预测和图像重建的多目标跟踪装置,包括:

45、第一跟踪单元,用于利用预先训练完成的第一tracker网络对当前帧和当前帧之前的连续多帧进行处理,得到第一目标特征图以及当前帧的目标预测框和分割掩膜;

46、第一处理单元,用于将第一目标特征图和当前帧的分割掩膜进行相乘,得到第二目标特征图;

47、第二处理单元,用于利用预先训练完成的lstm网络对第二目标特征图进行处理,得到当前帧的目标速度;

48、图像重建单元,用于利用预先训练完成的条件自变分编码器对当前帧、第一目标特征图以及目标速度进行处理,得到下一帧的预测图像;

49、融合单元,用于利用预先训练完成的卷积神经网络对第一目标特征图和下一帧的预测图像进行处理,得到融合后的特征图;

50、第二跟踪单元,用于利用预先训练完成的第二tracker网络对融合后的特征图进行处理,得到下一帧的目标预测框和分割掩膜。

51、第三方面,本技术实施例提供了一种电子设备,包括:存储器、处理器和存储在所述存储器上并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现本技术实施例的方法。

52、第四方面,本技术实施例提供了一种计算机可读存储介质,其特征在于,所述计算机可读存储介质存储有计算机指令,所述计算机指令被处理器执行时实现本技术实施例的方法。

53、本技术解决了多目标跟踪任务中行人与车辆遮挡以及位移过大导致的跟踪精度下降的问题。

- 还没有人留言评论。精彩留言会获得点赞!