一种基于多模态数据的零部件检测与定位方法及装置

本发明涉及目标识别领域,具体涉及一种基于多模态数据的零部件检测与定位方法及装置。

背景技术:

1、目标检测是计算机视觉领域的一个重要任务,旨在识别和定位图像或视频中感兴趣的目标物体。目前,常见的目标检测算法主要使用与检测任务相关的单模态图像作为训练数据。这些方法在通常情况下都能取得不错的效果,尤其是在光照条件良好、目标清晰可见的环境下。然而,仅使用单一模态的数据在复杂环境下的检测效果仍存在限制,比如在光照不足、雾霾、或者存在其他视觉干扰因素较强的情况下,这些模型的性能往往会大打折扣。例如,rgb图像对光照的变化较为敏感,其在光照条件良好时可以提供丰富的颜色和纹理等视觉信息,但在夜间或光照不足的情况下则容易出现细节丢失,导致目标物体的边缘与特征不明确,进而难以提供充足的信息来进行目标检测任务。综上所述,传统的基于单一模态数据的目标检测算法虽然在某些场景下可以取得较好的检测效果,但却无法完全满足复杂环境下的检测性能需求。

技术实现思路

1、本发明的目的在于提供一种基于多模态数据的零部件检测与定位方法及装置,提高在制造符合性检查的复杂场景下零部件检测的准确性和鲁棒性,同时对零部件进行三维空间精准定位。

2、实现本发明目的的技术解决方案为:

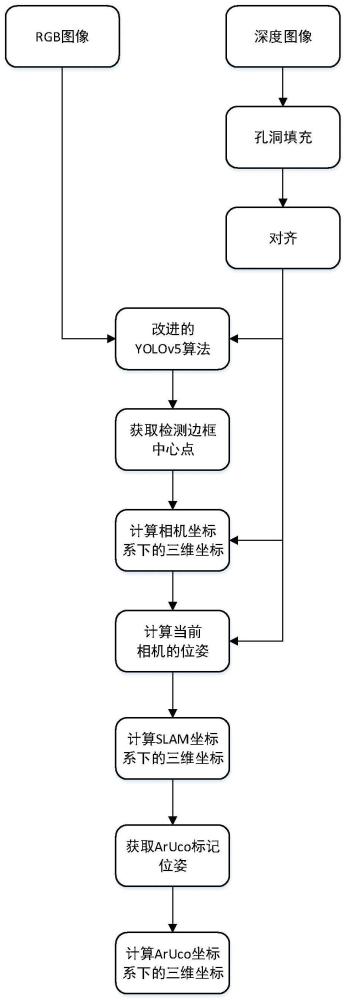

3、一种基于多模态数据的零部件检测与定位方法,包括步骤:

4、获取零部件的rgb图像与深度图像;

5、图像预处理,对深度图像进行孔洞填充处理,并将深度图像与rgb图像进行对齐;

6、将深度图像与rgb图像作为yolov5网络的输入,对零部件进行目标检测;

7、设定标志物,基于目标检测数据对零部件进行三维空间定位,获取零部件的位置。

8、进一步地,所述rgb图像与深度图像通过相机采集。

9、进一步地,所述yolov5网络输入的深度图像与rgb图像采用高度与宽度均为640的像素。

10、进一步地,所述yolov5网络扩展了cspdarknet53骨干网络,包括2个并行的特征提取层,分别对深度图像与rgb图像进行特征提取。

11、进一步地,所述yolov5网络的特征提取层后面增加特征融合层,将rgb图像的特征图与深度图像的特征图进行拼接融合,并使用1×1卷积操作将拼接后的特征图通道数量减半。

12、进一步地,所述拼接融合后的特征图为:

13、

14、其中,frgbd(ci)表示第ci个输出通道学习到的特征图,frgb(k)表示第k个rgb特征图,fd(j)表示第j个深度特征图,n表示在融合前rgb图像特征的通道数,m表示在融合前深度特征的通道数。

15、进一步地,所述yolov5网络的输出包括分类目标、检测边框位置与置信度。

16、进一步地,所述基于目标检测数据对零部件进行三维空间定位具体包括:

17、基于yolov5网络输出的检测边框位置与预处理后的深度图像,获取零部件在相机坐标系下的三维坐标pc为:

18、

19、其中,x,y,z表示相机坐标系下的三维坐标;u和v表示像素坐标系下零部件中心点的横纵坐标;cu和cv表示中心像素坐标;d表示像素深度;fc表示相机的焦距;

20、通过当前相机的位姿,计算得到slam世界坐标系中零部件的空间坐标psw,

21、psw=rswcpc+tswc

22、其中,rswc和tswc是从相机坐标系到slam世界坐标系的旋转矩阵和平移矩阵;

23、基于标志物,将slam坐标系与大地坐标系对齐,计算两者空间差值δr和δt,

24、

25、其中,raruco和taruco是现实世界中aruco标记的旋转矩阵和平移矩阵,在系统中被定义为现实世界的坐标原点。paruco_in_slam和taruco_in_slam是slam世界坐标系中aruco的旋转矩阵和平移矩阵;

26、基于空间差值δr和δt,计算大地坐标系中零部件相对于标志物的空间位置pw,pw=δrpsw+δt。

27、进一步地,所述标志物通过aruco标记。

28、一种使用所述的基于多模态数据的零部件检测与定位方法的装置,包括图像采集模块、图像预处理模块、目标检测模块和目标定位模块,其中,所述图像采集模块用于获取零部件的rgb图像与深度图像,所述图像预处理模块用于对深度图像进行孔洞填充处理,并将深度图像与rgb图像进行对齐,所述目标检测模块采用yolov5网络,将深度图像与rgb图像作为yolov5网络的输入,对零部件进行目标检测;所述目标定位模块基于目标检测数据对零部件进行三维空间定位,获取零部件的位置。

29、与现有技术相比,本发明具有积极的效果:本发明使用融合rgb图像与深度图像两种不同模态的神经网络算法,更全面地描述零部件的特征,提高在制造符合性检查的复杂场景下零部件检测的准确性和鲁棒性,同时对零部件进行三维空间精准定位;当rgb图像的特征受光照强度和方向的影响时,深度图像信息可以帮助克服光照变化和复杂背景对零部件检测的影响,提高了模型的准确率、召回率与平均精度均值;本方法可以基于检测后输出的零部件2d边框中心点与对齐后的深度图像,对零部件进行三维空间定位。

技术特征:

1.一种基于多模态数据的零部件检测与定位方法,其特征在于,包括步骤:

2.根据权利要求1所述的基于多模态数据的零部件检测与定位方法,其特征在于,所述rgb图像与深度图像通过相机采集。

3.根据权利要求1所述的基于多模态数据的零部件检测与定位方法,其特征在于,所述yolov5网络输入的深度图像与rgb图像采用高度与宽度均为640的像素。

4.根据权利要求1所述的基于多模态数据的零部件检测与定位方法,其特征在于,所述yolov5网络包括2个并行的特征提取层,分别对深度图像与rgb图像进行特征提取。

5.根据权利要求4所述的基于多模态数据的零部件检测与定位方法,其特征在于,所述yolov5网络的特征提取层后面增加特征融合层,将rgb图像的特征图与深度图像的特征图进行拼接融合,并使用1×1卷积操作将拼接后的特征图通道数量减半。

6.根据权利要求5所述的基于多模态数据的零部件检测与定位方法,其特征在于,所述拼接融合后的特征图为:

7.根据权利要求6所述的基于多模态数据的零部件检测与定位方法,其特征在于,所述yolov5网络的输出包括分类目标、检测边框位置与置信度。

8.根据权利要求7所述的基于多模态数据的零部件检测与定位方法,其特征在于,所述基于目标检测数据对零部件进行三维空间定位具体包括:

9.根据权利要求8所述的基于多模态数据的零部件检测与定位方法,其特征在于,所述标志物通过aruco标记。

10.一种使用权利要求1-9任一所述的基于多模态数据的零部件检测与定位方法的装置,其特征在于,包括图像采集模块、图像预处理模块、目标检测模块和目标定位模块,其中,所述图像采集模块用于获取零部件的rgb图像与深度图像,所述图像预处理模块用于对深度图像进行孔洞填充处理,并将深度图像与rgb图像进行对齐,所述目标检测模块采用yolov5网络,将深度图像与rgb图像作为yolov5网络的输入,对零部件进行目标检测;所述目标定位模块基于目标检测数据对零部件进行三维空间定位,获取零部件的位置。

技术总结

本发明提供一种基于多模态数据的零部件检测与定位方法及装置,该方法在基于增强现实的制造符合性检查系统中使用融合RGB图像与深度图像的多模态神经网络算法,分别对RGB图像与深度图像进行特征提取并融合,最后利用二维检测结果与深度信息对零部件进行三维空间定位。本方法提高了零部件检测算法在光照不足等复杂环境下的鲁棒性,并提高了模型的准确率、召回率与平均精度均值。同时,本方法可以基于检测后输出的零部件2D边框中心点与对齐后的深度图像,对零部件进行三维空间定位。

技术研发人员:李蔚清,王浩宇

受保护的技术使用者:南京理工大学

技术研发日:

技术公布日:2024/3/5

- 还没有人留言评论。精彩留言会获得点赞!