一种基于深度相机的多模态语义分割方法及系统

本发明属于计算机视觉领域,特别涉及一种基于深度相机的多模态语义分割方法及系统。

背景技术:

1、语义分割是计算机视觉中一个基本而永恒的问题,可以看作是一个多标签分类问题,重点是为每个像素分配一个类别标签。当前语义分割的大多数研究都只关注于彩色图像,根据彩色图像信息给出的模型可判断不同颜色和纹理的物体,但因为没有几何信息,缺乏对物体位置和空间关系的了解,很难区分具有相似颜色和纹理的实例和上下文。

2、彩色图像和深度图像存在显著差异,二者表现着不同的特征,一些研究直接将互补的深度数据输入到现有的彩色图像语义分割框架中,或者简单地集成两种模式,结果导致分割性能更差。另外深度数据包含测量的不确定性,存在噪声。现有数据集提供的深度数据主要是通过time-of-flight技术或结构光相机采集的,如kinect、asusxtion和realsense等。由于物体材料的不同和距离测量范围的限制,深度数据的测量普遍存在噪声,即采集的深度图像存在空洞。在室外场景中噪声更加明显,将包含噪声的深度图像用于模型训练测试中,将导致分割效果不理想。

3、随着计算机视觉技术的发展,多模态语义分割技术在许多领域中得到了广泛的应用。然而,现有的多模态语义分割方法往往依赖于大量的标注数据,这在实际应用中往往难以获取。此外,现有的多模态语义分割方法往往无法有效地处理复杂的场景,例如存在遮挡、光照变化等情况。

4、针对上述问题,一种基于深度相机的多模态语义分割方法及系统应运而生。该方法通过利用深度相机获取的深度信息,结合现有的多模态语义分割方法,可以有效地处理复杂的场景,并且不需要大量的标注数据。此外,该方法还可以通过学习深度相机的内在特征,进一步提高语义分割的准确性。

5、在具体实现上,该方法首先通过深度相机获取深度图像和rgb图像,然后将这两张图像输入到多模态语义分割模型中。在模型训练过程中,该方法利用深度相机的内在特征,通过自适应学习的方式,进一步提高语义分割的准确性。在模型测试过程中,该方法可以有效地处理复杂的场景,并且不需要大量的标注数据。

6、因此,现在亟需一种基于深度相机的多模态语义分割方法及系统。

技术实现思路

1、本发明提出一种基于深度相机的多模态语义分割方法及系统,解决了现有技术中在通过机器视觉进行深度图像处理时,其处理精度差,无法准确进行的实时数据处理的问题。

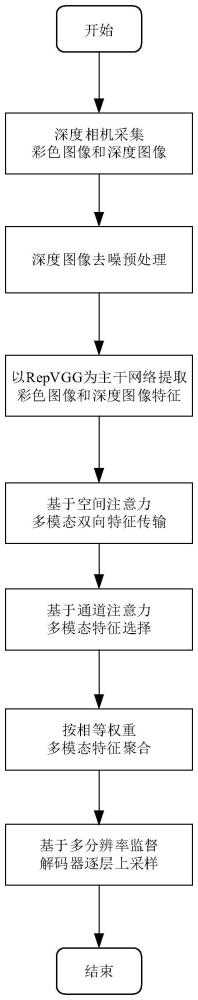

2、本发明的技术方案是这样实现的:一种基于深度相机的多模态语义分割方法,所述方法包括如下步骤:

3、深度相机在使用前进行内外参校准,确保相机能够准确获取彩色图像和深度图像;

4、采用快速深度补全方法对深度图像进行空洞补全,减少深度图像的空洞噪声;

5、将彩色图像和去噪后的深度图像按照相同分辨率输入到编码器的两个主干网络中,分别对两种模态进行特征提取,主干网络均选择repvgg;

6、在主干网络每一层中分别对彩色图像和深度图像进行特征提取,提取的相应模态特征传递到每层主干网络后的多模态融合模块中;

7、在多模态融合模块中,先进行基于空间维度的双向特征传输,将其中任一种模态在空间推导出的空间注意图应用于另一种模态中,然后在通道维度借助通道注意力选择特征通道判断出重要特征,再将彩色图像特征图和深度图像特征图权重按相同权重相加,使用relu函数将特征图进行非线性化处理,并传递给下一层彩色图像编码器;

8、将最后一个多模态融合模块输出的特征图与跳跃连接得到的主干网络下采样特征图结合,经解码器卷积和上采样操作逐步恢复为输入分辨率,结合多分辨率监督策略,每经过一个解码模块都会生成对应分辨率的分割结果。

9、本发明提出一种基于基于深度相机的多模态语义分割方法及系统。由搭载传统彩色摄像头和深度传感器的深度相机采集图像,将深度图像利用快速深度补全方法进行深度补全,减少深度图像中的空洞噪声。然后将彩色图像和深度图像分别输入各自模态的主干网络中,使用repvgg作为主干网络,共分为5层。对于每一层主干网络提取得到的彩色图像特征和深度图像特征,都将其放入多模态融合模块中。多模态融合模块分为基于空间维度的双向特征传输、通道维度的特征选择以及多模态特征聚合三个部分,得到的跨模态信息会被下一层的彩色图像编码器继续进行特征提取,而深度图像的特征信息采用上一层深度图像编码器的特征提取结果。主干网络的每一层后都设置多模态融合模块。最后的解码器主要包含三个解码模块,每个解码模块包含卷积、双线性上采样和跳跃连接。跳跃连接用于接收主干网络中相应分辨率的下采样特征,从而获取更详细的细粒度信息。结合多分辨率监督策略,三个解码模块都输出对应分辨率的分割结果,并为此设置三个辅助损失,与输入分辨率分割结果的损失相加作为最终的分割损失。

10、作为一优选的实施方式,其中深度相机选择intel的realsense深度相机,realsense深度相机通过红外光发射器和红外光接收器进行基于红外光的三维成像。

11、作为一优选的实施方式,在采用快速深度补全方法进行预处理时,首先对深度图像的深度值取反,随后使用形态学闭运算,补全其中的低于设定直径空洞,随后使用膨胀运算,将高于设定直径的空洞进行补全,依次向上补洞,将深度图像的上方空洞补全后,使用中值滤波去除噪声,并搭配高斯滤波进行平滑操作,最后再取反得到深度值。

12、作为一优选的实施方式,所述多模态融合模块采用对称方式设计,包括基于空间注意力的多模态双向特征传输、基于通道注意力的多模态特征选择和多模态特征聚合。

13、作为一优选的实施方式,所述基于空间注意力的多模态双向特征传输通过使用空间注意力提高模型对不同空间位置的关注程度,将一种模态推导出的空间注意特征应用于另一种模态。

14、作为一优选的实施方式,所述基于通道注意力的多模态特征选择,通过使用通道注意力选择特定特征所在的通道,从而获取特定特征。

15、作为一优选的实施方式,所述多模态特征聚合通过将通道注意力输出的深度图像通道特征与彩色图像通道特征按照相同权重大小相加,综合利用多模态信息,平衡模态贡献,再使用relu激活函数对其做非线性处理,使模型拟合非线性函数,加速模型训练。

16、一种基于深度相机的多模态语义分割系统,包括深度相机、编码器、主干网络、多模态融合模块以及基于多分辨率监督策略的解码器;

17、所述深度相机内置红外光发射器和红外光接收器,红外光发射器发射红外光束,光束照射到物体上反射至红外光接收器内,红外光接收器将反射光转换为电信号,通过计算发射和接收的时间差,进而计算出物体的深度信息;

18、所述编码器包括两个部分,包含对彩色图像和深度图像起特征提取作用的主干网络和对不同模态信息融合的多模态融合模块;

19、所述主干网络以repvgg为主干网络,主干网络内包含5个repvgg块,repvgg中采用vgg-style的结构,repvgg块通过卷积、批量归一化和relu激活函数来构建,并在在训练时使用多路径拓扑结构,在测试时采用单路径拓扑结构;

20、所述多模态融合模块采用对称方式设计,包括基于空间注意力的多模态双向特征传输、基于通道注意力的多模态特征选择和多模态特征聚合;

21、所述基于多分辨率监督策略的解码器包含三个解码模块,每个解码模块包含3×3conv、双线性上采样和跳跃连接,其中3×3conv用来组合相邻特征,双线性上采样通过对输入特征图进行插值来增加分辨率,跳跃连接用于接收主干网络下采样特征,即主干网络下采样的特征图用1×1conv映射为解码模块的相同数量通道,并按照逐元素相加方式添加到解码模块的特征图中。

22、采用了上述技术方案后,本发明的有益效果是:本发明公开了一种基于深度相机的多模态语义分割方法及系统。以深度相机为采集平台,先对深度图像去噪预处理,然后将彩色图像和深度图像输入到以repvgg为主干网络中做特征提取,再通过多模态融合模块,包括空间维度上的多模态双向特征传输、通道维度上的多模态特征选择以及按相同权重大小的多模态特征聚合。经过主干网络特征提取和多模态融合的跨模态特征图,在解码器中会被逐层上采样,结合多分辨率监督策略,在不同分辨率上进行监督训练。该方法在nyudv2数据集、cityscapes-with-depth数据集和自建的校园道路数据集均取得良好的分割效果,与同类方法相比,在不增加参数量和计算量的前提下,提升了分割精度,对室内外场景均适用,可应用于机器人导航、盲人导航和自动驾驶等领域。

- 还没有人留言评论。精彩留言会获得点赞!