一种多视角体表标记点融合方法、装置、设备及介质与流程

本发明涉及物体建模,尤其涉及一种快速多视角体表标记点融合方法、装置、设备及介质。

背景技术:

1、在机器人辅助按摩理疗的场景中,对于需要按摩的人体部位,需要在人体表面使用特制的标记进行粘贴,之后通过拍摄图像进行识别处理,以实现直观友好的交互式定位功能。同时,由于需要对人体进行大范围超180度的完整曲面感知理解,因此一般采用多视角拍摄。

2、现有采用多视角拍摄时,由于人体存在超过180度,导致同一标记物会在一个以上个视角图像中出现,需要对多视角中重复出现的标记物进行融合去重。

技术实现思路

1、本发明提供一种快速多视角体表标记点融合方法、装置、设备及介质,其主要目的在于提升物体建模的质量。

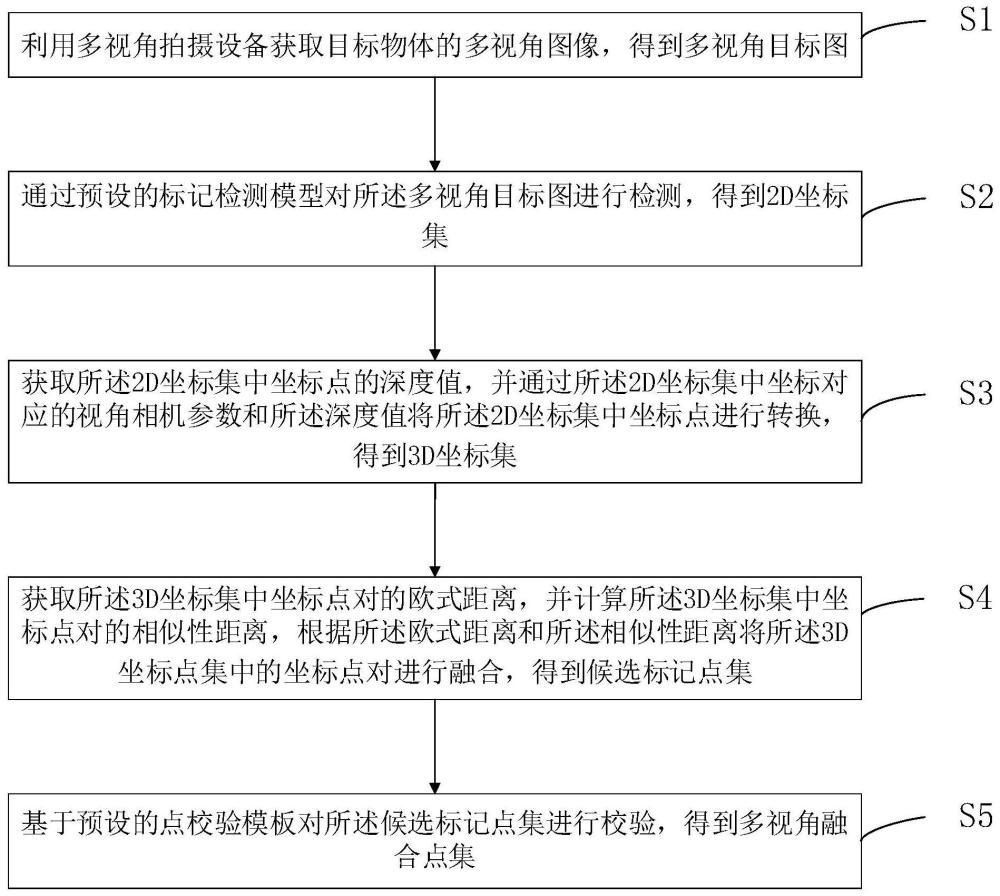

2、为实现上述目的,本发明提供的一种快速多视角体表标记点融合方法,包括:

3、利用多视角拍摄设备获取目标物体的多视角图像,得到多视角目标图;

4、通过预设的标记检测模型对所述多视角目标图进行检测,得到2d坐标集;

5、获取所述2d坐标集中坐标点的深度值,并通过所述2d坐标集中坐标对应的视角相机参数和所述深度值将所述2d坐标集中坐标点进行转换,得到3d坐标集;

6、获取所述3d坐标集中坐标点对的欧式距离,并计算所述3d坐标集中坐标点对的相似性距离,根据所述欧式距离和所述相似性距离将所述3d坐标点集中的坐标点对进行融合,得到候选标记点集;

7、基于预设的点校验模板对所述候选标记点集进行校验,得到多视角融合点集。

8、可选地,所述计算所述3d坐标集中坐标点对的相似性距离,包括:

9、获取所述3d坐标集中的任意一对坐标点对作为目标点对,并查询所述目标点对中两个3d点的图像区域,得到第一局部图像和第二局部图像;

10、通过预设的特征点检测算法对所述第一局部图像和第二局部图像进行特征检测,得到第一图特征点和第二图特征点;

11、利用所述特征点检测算法的特征描述子计算所述第一图特征点和第二图特征点中所有检测到的特征点的特征向量;

12、在所述第一局部图像和第二局部图像间进行特征向量匹配,得到两幅局部图像间的匹配点对;

13、将所述第一局部图像和第二局部图像重新投影至3d空间,得到3d匹配点对,并计算所述3d匹配点对间的空间距离;

14、若所述匹配点对的数目小于预设数目,则将所述空间距离设置为无穷大,并将所述空间距离作为所述相似性距离;

15、若所述匹配点对的数目大于或等于所述预设数目,则计算所述3d点集中所有3d点对空间距离均值,并将所述空间距离均值作为所述相似性距离。

16、可选地,所述根据所述欧式距离和所述相似性距离将所述3d坐标点集中的坐标点对进行融合,得到候选标记点集,包括:

17、获取所述欧式距离对应的距离阈值,得到第一距离阈值;

18、获取所述相似性距离对应的距离阈值,得到第二距离阈值;

19、当所述欧式距离小于所述第一距离阈值且所述相似性距离小于所述第二距离阈值时,将所述3d坐标点集中对应的坐标点对进行融合,得到所述候选标记点集。

20、可选地,所述基于预设的点校验模板对所述候选标记点集进行校验,得到多视角融合点集,包括:

21、基于所述点校验模板获取多个单维度模板,并获取多个所述单维度模板的方向向量和所属标签,得到多个单维方向向量和单维所属标签;

22、对所述候选标记点集中的标记点进行排序,得到点排序队列,并获取所述点排序队列前端预设数目的坐标点,得到筛选候选点集;

23、从多个所述单维方向向量中选择一个单维方向向量作为目标方向向量,并将所述筛选候选点集中的坐标点投影到所述目标方向向量,得到筛选方向向量点集;

24、根据所述筛选方向向量点集在所述目标方向向量的顺序进行排序,得到向量点排序队列,并统计向量点在所述向量点排序队列中的排序顺序;

25、根据所述排序顺序统计所述向量点排序队列中每个坐标点的单维所属标签,得到目标标签,并根据所述目标标签和所述向量点排序队列对所述候选标记点集中的坐标点进行筛选,得到所述多视角融合点集。

26、可选地,所述通过预设的标记检测模型对所述多视角目标图进行检测,得到2d坐标集之前,所述方法还包括:

27、通过爬虫获取互联网上已公开的携带标记的图片或从预设图片存储库中获取携带标记的图片,得到标记图片集;

28、对所述标记图片集中的标记图片进行标注,得到标注图片集;

29、通过所述标注图片集中的标注图片对预设的卷积神经网络进行训练,得到标记检测模型。

30、可选地,所述通过所述2d坐标集中坐标对应的视角相机参数和所述深度值将所述2d坐标集中坐标点进行转换,得到3d坐标集,包括:

31、获取所述视角相机参数中的内参矩阵和外参矩阵,得到相机内参矩阵和相机外参矩阵;

32、通过所述相机内参矩阵将所述深度值变换为对应的3d坐标,得到初始3d坐标集;

33、利用所述相机外参矩阵将所述初始3d坐标集中的3d坐标变换至统一的基坐标空间,得到3d坐标集。

34、可选地,所述利用多视角拍摄设备获取目标物体的多视角图像,得到多视角目标图,包括:

35、基于预设的图片拍摄计划为所述视角拍摄设备设置拍摄视角;

36、根据所述拍摄视角,利用所述多视角拍摄设备拍摄目标物体的多视角图像,得到所述多视角目标图。

37、为了解决上述问题,本发明还提供一种快速多视角体表标记点融合装置,所述装置包括:

38、坐标获取模块,用于利用多视角拍摄设备获取目标物体的多视角图像,得到多视角目标图;通过预设的标记检测模型对所述多视角目标图进行检测,得到2d坐标集;

39、坐标转换模块,用于获取所述2d坐标集中坐标点的深度值,并通过所述2d坐标集中坐标对应的视角相机参数和所述深度值将所述2d坐标集中坐标点进行转换,得到3d坐标集;

40、坐标融合模块,用于获取所述3d坐标集中坐标点对的欧式距离,并计算所述3d坐标集中坐标点对的相似性距离,根据所述欧式距离和所述相似性距离将所述3d坐标点集中的坐标点对进行融合,得到候选标记点集;

41、坐标校验模块,用于基于预设的点校验模板对所述候选标记点集进行校验,得到多视角融合点集。

42、为了解决上述问题,本发明还提供一种电子设备,所述电子设备包括:

43、至少一个处理器;以及,

44、与所述至少一个处理器通信连接的存储器;其中,

45、所述存储器存储有可被所述至少一个处理器执行的计算机程序,所述计算机程序被所述至少一个处理器执行,以使所述至少一个处理器能够执行如上所述的快速多视角体表标记点融合方法。

46、为了解决上述问题,本发明还提供一种计算机可读存储介质,包括存储数据区和存储程序区,存储数据区存储创建的数据,存储程序区存储有计算机程序;其中,所述计算机程序被处理器执行时实现如上所述的快速多视角体表标记点融合方法。

47、本发明实施例利用多视角拍摄设备获取目标物体的多视角图像,得到多视角目标图,之后通过预设的标记检测模型对多视角目标图进行检测,得到2d坐标集,实现标识物二维坐标点的获取,然后获取2d坐标集中坐标点的深度值,并通过2d坐标集中坐标对应的视角相机参数和深度值将2d坐标集中坐标点进行转换,得到3d坐标集,达到获取标识物三维坐标点的目的,之后获取3d坐标集中坐标点的欧式距离和相似性距离,并进行融合,得到候选标记点集,最后基于预设的点校验模板对候选标记点集进行校验,得到多视角融合点集,解决了多视角中重复出现的标记物后导致建模不准确的问题。因此本发明提出的快速多视角体表标记点融合方法、装置、电子设备及计算机可读存储介质,可以对多视角中重复出现的标记物进行融合去重,提升根据物体建模得到的模型质量。

- 还没有人留言评论。精彩留言会获得点赞!