一种交互式动态模糊场景恢复的图像视频生成方法及装置与流程

本发明涉及数据处理,尤其涉及一种交互式动态模糊场景恢复的图像视频生成方法。

背景技术:

1、近年来,随着计算机视觉和深度学习技术的飞速发展,图像和视频的处理、恢复和生成技术得到了广泛的研究和应用,特别是在社交媒体、影视制作和游戏行业中,高质量的图像和视频内容生成和编辑变得尤为重要。然而,对于损坏、模糊或不完整的图像和视频的恢复,仍然存在许多挑战。

2、现有技术中,自动图像视频恢复的实现方式为:首先对数据进行预处理,消除噪声、调整对比度;然后使用深度学习模块,对模糊、损坏的图像或视频进行恢复;其次使用语义识别和物体检测模块,对恢复的图像或视频进行处理,确定恢复内容在语义上与原始内容一致;最后通过优化模块,对处理后的图像或数据优化输出,进一步提高图像或视频的质量。现有的实现方法主要限制在于其完全自动化的处理流程,缺乏对用户需求和偏好的灵活适应,因此,无法为恢复过程提供直接的指导或参考,导致恢复效果与实际需求不符。

3、有鉴于此,如何提供一种交互式的动态模糊场景恢复的图像视频生成方法,允许用户直接与系统交互,引导图像或视频内容的恢复,并实现更为满意和逼真的效果,成为亟需解决的问题。

技术实现思路

1、本发明提供一种交互式动态模糊场景恢复的图像视频生成方法,一种交互式动态模糊场景恢复的图像视频生成装置,一种电子设备,以及一种计算机可读存储介质,用以至少提供一种交互式的动态模糊场景恢复的图像视频生成方法,允许用户直接与系统交互,引导图像或视频内容的恢复,并实现更为满意和逼真的效果。

2、根据本发明实施例的第一方面,提供一种交互式动态模糊场景恢复的图像视频生成方法,所述方法包括:

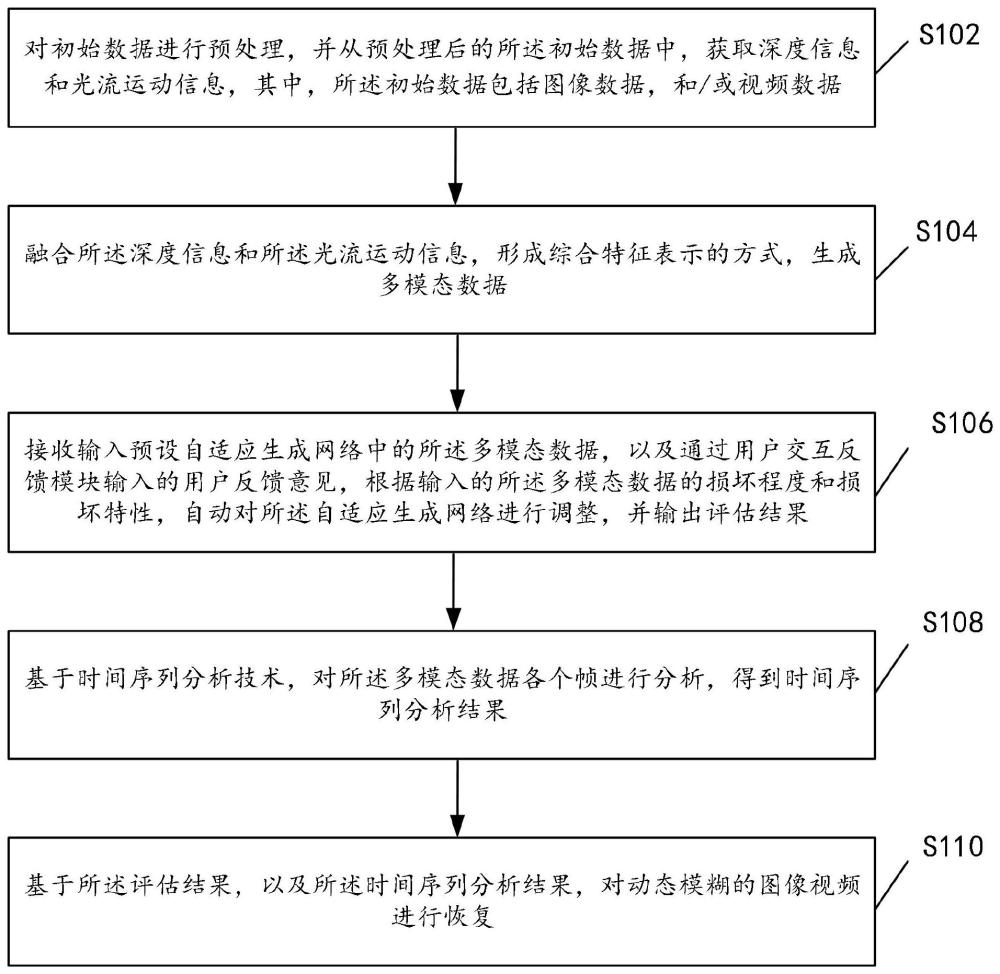

3、对初始数据进行预处理,并从预处理后的所述初始数据中,获取深度信息和光流运动信息,其中,所述初始数据包括图像数据,和/或视频数据;

4、融合所述深度信息和所述光流运动信息,形成综合特征表示的方式,生成多模态数据;

5、接收输入预设自适应生成网络中的所述多模态数据,以及通过用户交互反馈模块输入的用户反馈意见,根据输入的所述多模态数据的损坏程度和损坏特性,自动对所述自适应生成网络进行调整,并输出评估结果,其中,所述评估结果为判别器对生成器生成图像的真实性进行的评估;

6、基于时间序列分析技术,对所述多模态数据各个帧进行分析,得到时间序列分析结果;

7、基于所述评估结果,以及所述时间序列分析结果,对动态模糊的图像视频进行恢复。

8、根据本发明实施例的第二方面,提供一种交互式动态模糊场景恢复的图像视频生成装置,所述装置包括:

9、获取模块,被配置为对初始数据进行预处理,并从预处理后的所述初始数据中,获取深度信息和光流运动信息,其中,所述初始数据包括图像数据,和/或视频数据;

10、融合模块,被配置为融合所述深度信息和所述光流运动信息,形成综合特征表示的方式,生成多模态数据;

11、输出模块,被配置为接收输入预设自适应生成网络中的所述多模态数据,以及通过用户交互反馈模块输入的用户反馈意见,根据输入的所述多模态数据的损坏程度和损坏特性,自动对所述自适应生成网络进行调整,并输出评估结果,其中,所述评估结果为判别器对生成器生成图像的真实性进行的评估;

12、分析模块,被配置为基于时间序列分析技术,对所述多模态数据各个帧进行分析,得到时间序列分析结果;

13、恢复模块,被配置为基于所述评估结果,以及所述时间序列分析结果,对动态模糊的图像视频进行恢复。

14、根据本说明书实施例的第三方面,提供一种电子设备,包括:存储器、处理器及存储在所述存储器上并可在所述处理器上运行的计算机程序,所述计算机程序被所述处理器执行时实现如本说明书实施例第一方面所述的交互式动态模糊场景恢复的图像视频生成方法的步骤。

15、根据本说明书实施例的第四方面,提供一种计算机可读存储介质,所述计算机可读存储介质上存储有信息传递的实现程序,所述程序被处理器执行时实现如本说明书实施例第一方面所述的交互式动态模糊场景恢复的图像视频生成方法的步骤。

16、根据本说明书实施例提供的一种交互式动态模糊场景恢复的图像视频生成方法:首先对初始数据进行预处理,并从预处理后的所述初始数据中,获取深度信息和光流运动信息,其中,所述初始数据包括图像数据,和/或视频数据;然后融合所述深度信息和所述光流运动信息,形成综合特征表示的方式,生成多模态数据;其次接收输入预设自适应生成网络中的所述多模态数据,以及通过用户交互反馈模块输入的用户反馈意见,根据输入的所述多模态数据的损坏程度和损坏特性,自动对所述自适应生成网络进行调整,并输出评估结果,其中,所述评估结果为判别器对生成器生成图像的真实性进行的评估;再其次基于时间序列分析技术,对所述多模态数据各个帧进行分析,得到时间序列分析结果;最后基于所述评估结果,以及所述时间序列分析结果,对动态模糊的图像视频进行恢复。

17、应用本说明书实施例提供的方法,通过融合获取的深度信息和光流运动信息,得到多模态数据,用于动态模糊场景的分析和恢复,不仅提高了对动态场景深度和光流运动的特征识别能力,也增强了处理复杂场景的能力;通过损坏感知机制确定的图像损坏类型和损坏程度,对自适应生成网络进行调整,能够提供更为精准和细致的恢复结果;用户交互模块的引入极大地增强了恢复过程的灵活性和用户参与度,使得最终的恢复结果能够符合用户的实际需求和偏好,提供用户的使用体验感。

18、上述说明仅是本申请技术方案的概述,为了能够更清楚了解本申请的技术手段,而可依照说明书的内容予以实施,并且为了让本申请的上述和其它目的、特征和优点能够更明显易懂,以下特举本申请的具体实施方式。

技术特征:

1.一种交互式动态模糊场景恢复的图像视频生成方法,其特征在于,包括:

2.根据权利要求1所述的方法,其特征在于,所述从预处理后的所述初始数据中,获取深度信息和光流运动信息,包括:从预处理后的所述初始数据中,获取深度信息:

3.根据权利要求1或2所述的方法,其特征在于,所述从预处理后的所述初始数据中,获取深度信息和光流运动信息,包括:从预处理后的所述初始数据中,获取光流运动信息:

4.根据权利要求1所述的方法,其特征在于,采用如下方式构建所述自适应特征网络:

5.根据权利要求4所述的方法,其特征在于,所述采用深度学习网络架构的生成器生成图像,包括:

6.根据权利要求4所述的方法,其特征在于,所述根据所述生成图像的损坏程度和损坏特性,自动调整所述自适应生成网络的深度和宽度,包括:

7.根据权利要求1所述的方法,其特征在于,所述基于时间序列分析技术,对所述多模态数据各个帧进行分析,得到时间序列分析结果,包括:

8.根据权利要求1所述的方法,其特征在于,所述通过用户交互反馈模块输入的用户反馈意见,包括:

9.根据权利要求1所述的方法,其特征在于,所述方法,还包括:

10.一种交互式动态模糊场景恢复的图像视频生成装置,其特征在于,包括:

技术总结

本发明涉及一种交互式动态模糊场景恢复的图像视频生成方法,包括:对初始数据进行预处理,并从预处理后的初始数据中,获取深度信息和光流运动信息;融合深度信息和光流运动信息,形成综合特征表示的方式,生成多模态数据;接收输入预设自适应生成网络中的多模态数据,以及通过用户交互反馈模块输入的用户反馈意见,根据输入的多模态数据的损坏程度和损坏特性,自动对自适应生成网络进行调整,并输出评估结果;基于时间序列分析技术,对多模态数据各个帧进行分析,得到时间序列分析结果;基于评估结果,以及时间序列分析结果,对动态模糊的图像视频进行恢复,实现在充分考虑用户的需求和偏好的情况下,实现高质量、实时性强的图像和视频恢复效果。

技术研发人员:邵俊,李京南,范潇尹

受保护的技术使用者:赛昇数字经济研究中心(深圳)有限公司

技术研发日:

技术公布日:2024/3/17

- 还没有人留言评论。精彩留言会获得点赞!