基于图像平均的人工智能图像识别对抗攻击方法及系统

本发明涉及计算机视觉,特别涉及一种基于图像平均的人工智能图像识别对抗攻击方法及系统。

背景技术:

1、近年来,深度神经网络(deep neural networks,dnn)在计算机视觉领域取得了相当大的成功,例如图像分类、人脸识别和目标检测等。然而,深度神经网络已经被证明容易受到对抗样本的攻击,这些对抗样本是通过在干净图像中添加人类不易察觉的扰动而精心制作的。此外,对抗样本具有一定的迁移性,即针对替代模型生成的对抗样本也可以迁移攻击成功目标模型,这进一步凸显了对抗样本的威胁性。没那么糟糕的是,攻击性能强的对抗样本可以用来评估测试模型的鲁棒性以及作为对抗训练的输入来改善模型的鲁棒性,因此对抗样本的生成,也称对抗攻击,受到了越来越多的关注与研究。

2、利用对抗样本的可迁移性,基于迁移的攻击能够在无需了解模型信息的情况下实现高效的黑盒攻击,这使得它们更加的实用和灵活。一般情况下,对抗攻击可分为白盒攻击和黑盒攻击。白盒设置下,攻击者了解神经网络的结构、参数和训练数据等全部信息,而这在实际场景中很难实现。为了克服这一限制,人们探索出了黑盒攻击。黑盒攻击大致可分为基于查询的攻击和基于迁移的攻击。相比基于查询的攻击,基于迁移的攻击由于不需要查询网络,具有更优的隐蔽性,受到了极大关注,例如,mi-fgsm动量迭代快速梯度符号算法,首次将动量项引入到迭代版本的快速梯度符号方法(iterative fast gradient signmethod,i-fgsm)中来稳定梯度方向,进而生成更具迁移性的对抗样本;ni-fgsm算法,采用nesterov加速梯度,进一步提升了对抗样本的可迁移性;vmi-fgsm算法,采用方差调优的方式来寻找更稳定的梯度更新方向,进而大幅提高了对抗攻击的成功率;pgd投影梯度下降算法,利用惩罚梯度范数(penelizing gradient norm,pgn)进行攻击,实现了迁移性的大幅提升。然而,如何提高对抗样本的迁移性以进行有效的黑盒攻击仍然有待进一步研究。从对抗样本迁移性与模型泛化性类似的角度出发,神经网络训练中常采用的数据增强技术也被广泛用于增强对抗迁移性,例如,dim在对抗攻击中采用多样化输入的方式,减轻了过拟合,提升了对抗迁移性;sim利用多幅缩放图像来优化对抗扰动,有效提高了对抗样本的攻击成功率;admix利用混合了一组从其他类别随机采样的图像来增强对抗攻击过程;频谱模拟攻击(ssa)在频域调整图像来模拟更多样化的替代模型,从而制作更具迁移性的对抗样本。还有一些方法从特征破坏的角度来提升对抗样本的迁移性,例如,fda对目标层特征进行无差别破坏,从而来生成更具迁移性的对抗样本;fia在中间层中最小化加权特征映射,以破坏主导模型分类的重要对象感知特征;naa通过更准确的神经元重要性估计进行特征级攻击,以此来实现更好的对抗迁移性被称为特征破坏方法。

3、上述的现有方法通过优化梯度、变换输入图像、抑制图像积极特征的方式来改进对抗攻击过程,增强了对抗样本的迁移性。然而,这些方法重点关注的是攻击过程中的输入、梯度以及特征等,而缺少对输出的对抗样本的关注,忽视了对抗样本自身的作用。为此,本案方案重点关注迁移攻击生成的对抗样本。通常,获取强迁移性对抗样本的过程包括两个步骤:(1)微调超参数在代理模型上生成多批次对抗样本,(2)选择在白盒和黑盒模型上综合表现最好的那批次对抗样本,丢弃其余的。然而,在上述获取强对抗样本的过程中,会有许多次优的对抗样本被丢弃,浪费了生成对抗样本消耗的内存资源和计算成本。

技术实现思路

1、为此,本发明提供一种基于图像平均的人工智能图像识别对抗攻击方法及系统,解决现有对抗样本生成算法中迁移性差、攻击成功率低的问题。

2、按照本发明所提供的设计方案,一方面,提供一种基于图像平均的人工智能图像识别对抗攻击方法,包含:

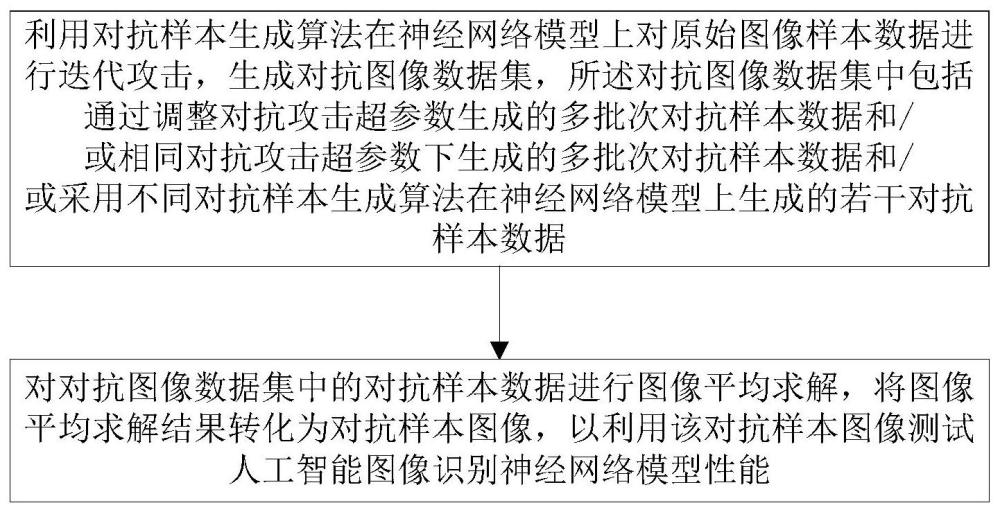

3、利用对抗样本生成算法在神经网络模型上对原始图像样本数据进行迭代攻击,生成对抗图像数据集,所述对抗图像数据集中包括通过调整对抗攻击超参数生成的多批次对抗样本数据和/或相同对抗攻击超参数下生成的多批次对抗样本数据和/或采用不同对抗样本生成算法在神经网络模型上生成的若干对抗样本数据;

4、对对抗图像数据集中的对抗样本数据进行图像平均求解,将图像平均求解结果转化为对抗样本图像,以利用该对抗样本图像测试人工智能图像识别神经网络模型性能。

5、作为本发明基于图像平均的人工智能图像识别对抗攻击方法,进一步地,利用对抗样本生成算法在神经网络模型上对原始图像样本数据进行迭代攻击,包含:

6、设置迭代攻击的最大迭代轮次;

7、在所述累积迭代轮次为t、且t为大于1并小于最大迭代轮次的情况下,根据t次迭代中对抗样本和梯度值,获取t+1迭代轮次的对抗样本,使用无穷范数对对抗样本进行限制,直至满足最大迭代轮次。

8、作为本发明基于图像平均的人工智能图像识别对抗攻击方法,进一步地,使用无穷范数对对抗样本进行限制,包含:

9、使用clip函数将t+1迭代轮次的对抗样本约束在原始图像样本数据的ε邻域内。

10、作为本发明基于图像平均的人工智能图像识别对抗攻击方法,进一步地,通过调整对抗攻击超参数生成多批次对抗样本数据,包含:

11、基于原始图像样本数据并通过多次微调超参数生成多批次对抗样本数据。

12、作为本发明基于图像平均的人工智能图像识别对抗攻击方法,进一步地,在相同对抗攻击超参数下生成多批次对抗样本数据,包含:

13、在相同的超参数设置下,基于原始图像样本数据随机生成多次对抗样本数据。

14、作为本发明基于图像平均的人工智能图像识别对抗攻击方法,进一步地,采用不同对抗样本生成算法在神经网络模型上生成的若干对抗样本数据,包含:

15、针对目标神经网络模型,利用基于梯度稳定优化的对抗样本生成算法、和基于输入转换数据增强的对抗样本生成算法以及基于特征破坏的对抗样本生成算法对应生成若干对抗样本数据,其中,基于梯度稳定优化的对抗样本算法包含但不限于:mi-fgsm算法和ni-fgsm算法,基于输入转换数据增强的对抗样本生成算法包含但不限于:sim尺度不变攻击算法和admix混合攻击算法,基于特征破坏的对抗样本生成算法包含不限于:fia特征重要性感知攻击算法和naa神经元归因攻击算法。

16、作为本发明基于图像平均的人工智能图像识别对抗攻击方法,进一步地,对对抗图像数据集中的对抗样本数据进行图像平均求解,包含:

17、首先,将对抗样本数据进行图像预处理,获取并以图像列表形式存储用于数学运算的数字化图像表示,其中,图像预处理包括归一化、图像采样和图像量化;

18、然后,从图像列表中依次选取各数字化图像表示并相加,通过将相加结果除以图像列表中数字化图像表示的总数目来执行图像平均求解。

19、进一步地,本发明还提供一种基于图像平均的人工智能图像识别对抗攻击系统,包含:迭代攻击模块和图像平均模块,其中,

20、迭代攻击模块,用于利用对抗样本生成算法在神经网络模型上对原始图像样本数据进行迭代攻击,生成对抗图像数据集,所述对抗图像数据集中包括通过调整对抗攻击超参数生成的多批次对抗样本数据和/或相同对抗攻击超参数下生成的多批次对抗样本数据和/或采用不同对抗样本生成算法在神经网络模型上生成的若干对抗样本数据;

21、图像平均模块,用于对对抗图像数据集中的对抗样本数据进行图像平均求解,将图像平均求解结果转化为对抗样本图像,以利用该对抗样本图像测试人工智能图像识别神经网络模型性能。

22、本发明的有益效果:

23、本发明通过对生成的对抗样本进行图像平均,可充分利用了超参数实验生成的多批次次优的对抗样本,实现了“变废为宝”,对这些多批次生成的对抗样本进行图像平均,,在几乎不会产生额外对抗攻击时间和计算开销的前提下,不仅提升了对抗样本的迁移性和攻击成功率,同时也提升了对抗样本的图像质量。而且可与现有对抗攻击算法正交相结合,以生成攻击性能更强的对抗样本,实现模型测试中更高的攻击成功率,能够用于评估并提升图像分类、人脸识别和目标检测等目标神经网络模型的鲁棒性,具有较好的应用前景。

- 还没有人留言评论。精彩留言会获得点赞!