基于门控图神经网络的机器人操作关系检测方法及系统

本发明属于人工智能领域,具体涉及一种基于门控图神经网络的机器人操作关系检测方法及系统。

背景技术:

1、探索物体之间的关系并给出正确的操作顺序对于机器人操作至关重要。然而,以前的大多数方法仅对成对物体之间的关系进行独立建模,忽略了它们之间存在的交互作用,这可能会在复杂场景中产生冗余或缺失关系,例如在多对象叠加和部分遮挡的场景中。

2、如附图3(a)所示,一个苹果和一个杯子放在一本书上,如果要抓取这本书,机器人需要先移开苹果和杯子。如果机器人不理解物体之间存在的关系,直接抓取书就可能损坏其他物体。如附图3(b),机器人想要抓取杯子需要移开和它有相互关系的其它物体,即先移开苹果。在多物体堆叠和部分遮挡等复杂场景下,精确识别对象之间的关系对获取最优的操作顺序尤为重要,这对机器人而言仍然是一个挑战。然而,目前大多数视觉操作关系检测方法往往只对对象对之间的关系进行独立建模,忽略了整个图像场景的全局上下文信息。生成的操作关系树或图容易出现冗余或缺失边的问题。因此,这些方法不能灵活地应用于杂乱对象的环境中。例如,遥控器被附图3(b)中的苹果部分遮挡。人类很容易发现苹果和遥控器之间没有堆叠关系,但机器人却没有。因此,机器推理时会产生冗余边。图中的另一个示例图3(c)显示对象对之间的缺少边。由于两个螺丝刀的边界框之间的距离较大,且堆叠面积较小,因此机器会认为两个螺丝刀之间的联系不存在。此外,现有一些方法中的图结构是固定的,在推理过程中,原始图结构中的错误会累积。

技术实现思路

1、本发明的目的在于克服上述不足,提供一种基于门控图神经网络的机器人操作关系检测方法及系统,该方法部署在机器人上,建立了满足实时要求的目标抓取系统,并实现了最先进的性能。

2、为了达到上述目的,本发明采用如下技术方案:

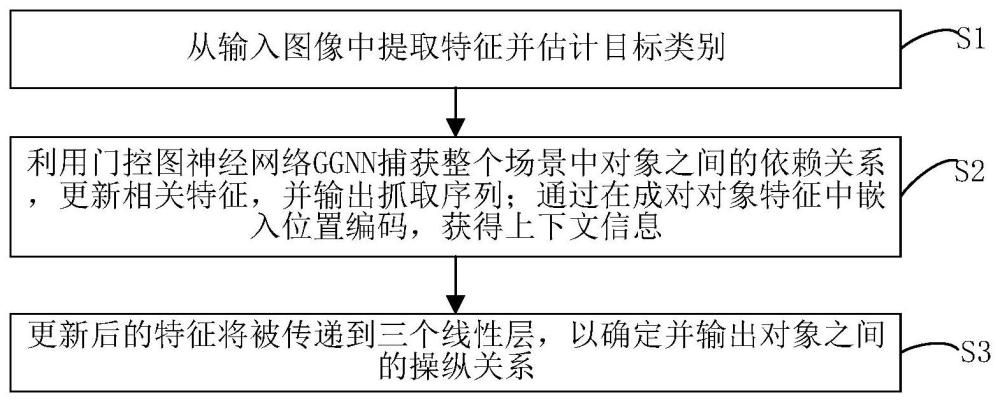

3、本发明第一方面是提供一种基于门控图神经网络的机器人操作关系检测方法,包括:

4、从输入图像中提取特征并估计目标类别;

5、利用门控图神经网络ggnn捕获整个场景中对象之间的依赖关系,更新相关特征,并输出抓取序列;通过在成对对象特征中嵌入位置编码,获得上下文信息;

6、更新后的特征将被传递到三个线性层,以确定并输出对象之间的操纵关系。

7、作为本发明进一步改进,所述从输入图像中提取特征并估计目标类别,包括:

8、以rgb图像为输入,通过特征提取器获取图中物体的特征,其中,场景中的所有对象类别和边界框都通过目标检测方法faster r-cnn进行检测并提取特征。

9、作为本发明进一步改进,所述利用门控图神经网络ggnn捕获整个场景中对象之间的依赖关系,更新相关特征,包括:

10、对于每个获得的对象对,使用联合区域裁剪提取的特征;通过对象对池获取成对物体之间的特征;

11、将得到的成对特征放入门控图神经网络ggnn中,以更新三元组特征;

12、更新后的特征将被传递到三个线性层,用于以确定并输出对象之间的操纵关系。

13、作为本发明进一步改进,所述通过对象对池获取成对物体之间的特征,包括:

14、采用faster r-cnn作为目标检测器来定位和检测场景中出现的目标物体;vgg16和resnet101用作主干网络,分别来提取特征。

15、作为本发明进一步改进,所述通过在成对对象特征中嵌入位置编码,包括:

16、门控图神经网络ggnn表达建模场景中所有对象对之间的关系,节点输入是每对对象的特征及其并集的特征向量;

17、将输入的特征嵌入到位置编码中;每个输入节点添加相应的位置编码,使用正弦和余弦函数表示绝对位置,并通过两个函数的乘积获得相对位置;其位置编码的具体公式示意如下:

18、

19、

20、其中pos表示位置索引,i表示维度。

21、作为本发明进一步改进,所述门控图神经网络ggnn中,使用全连接模式来设置门控图神经网络ggnn节点之间的连接;对于门控图神经网络ggnn中的每个节点,首先需要初始化节点i的隐层向量表示为:

22、

23、其中,yi表示第i对对象,表示其对应的原始特征向量,是线性层的参数,f表示校正线性单元函数;

24、采用全连接层的聚合函数,在更新图中的每个节点的特征时,从图中的所有其他节点收集信息,聚合全局上下文信息;用xti表示除节点i以外的所有其他节点的融合特征,则图网络中的更新过程计算如下:

25、

26、其中wa是线性信息聚合函数的参数,表示t-1步时节点j的隐藏层特征向量;

27、使用门递归单元作为信息传播函数,用来进行图中节点的长期信息传递,使模型能够充分集成图结构中不同节点的特征,引入了重置门和更新门,从而修改循环神经网络中隐藏状态的计算方式;gru的输入是当前步骤的向量和上一时刻的隐藏层特征向量通过以下更新公式获得节点当前时刻的隐藏层状态:

28、

29、

30、

31、

32、其中σ表示sigmod激活函数,w和u是门递归单元gru的相关参数,表示步骤t中节点i的隐藏层向量;

33、对于每个图中的节点i,其初始隐藏层特征向量和gru输出的隐藏层特征向量将被串联,所连接的向量将被发送到线性层和relu激活层以获得最终向量yi,具体表示为:

34、

35、其中,f表示relu激活函数,wy是线性层的参数。

36、作为本发明进一步改进,以确定并输出对象之间的操纵关系,包括:

37、输入是经过门控图神经网络更新后得到的特征yi,第i个对象和第j个对象之间的三元组的最终表示是yi=[oi;oj;oij];在特征yi上应用三个线性层来确定成对物体的类别和它们之间的关系,并选择多类交叉熵函数作为视觉操作关系预测的损失函数,其表示如下:

38、

39、其中,ri是数据集中标注的正确值,是机器人视觉操作关系的预测结果。

40、本发明第二方面是提供一种基于门控图神经网络的机器人操作关系检测系统,包括:

41、特征提取模块,用于从输入图像中提取特征并估计目标类别;

42、特征更新模块,用于利用门控图神经网络ggnn捕获整个场景中对象之间的依赖关系,更新相关特征,并输出抓取序列;通过在成对对象特征中嵌入位置编码,获得上下文信息;

43、关系输出模块,用于更新后的特征将被传递到三个线性层,以确定并输出对象之间的操纵关系。

44、本发明第三方面是提供一种电子设备,包括存储器、处理器以及存储在所述存储器中并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现所述基于门控图神经网络的机器人操作关系检测方法。

45、本发明第四方面是提供一种计算机可读存储介质,所述计算机可读存储介质存储有计算机程序,所述计算机程序被处理器执行时实现所述基于门控图神经网络的机器人操作关系检测方法。

46、与现有技术比,本发明具有如下优点:

47、本发明方法采用视觉操作关系检测的门控图神经网络(ggnn),它可以有效地捕获整个场景中对象之间的上下文信息,更新相关特征,并输出抓取序列。并通过位置编码用于嵌入成对对象特征,这有助于模型捕获输入数据的序列信息,并减少关系推理中的错误结果。本发明的方法在数据集vmrd和regrad上进行训练,部署在机器人上,建立了满足实时要求的目标抓取系统,并实现了最先进的性能。

- 还没有人留言评论。精彩留言会获得点赞!