一种图像多尺度特征融合匹配方法及系统

本发明涉及图像配准,更具体的涉及一种基于深度学习的图像多尺度特征融合匹配方法及系统。

背景技术:

1、随着信息化时代的快速发展,图像、视频、音频、文本等异构数据每天都在以惊人的速度增长。针对这些包含丰富视觉信息的海量图片,如何在这些浩瀚的图像库中方便、快速、准确地查询并检索到用户所需的或感兴趣的图像,如今是一个亟待解决的问题。前期大部分的图像是采用手工标注的方式来建立索引,存在着效率低,主观性等等缺陷。深度学习技术可以很好的应用在遥感图像配准的技术领域,可以极大的加快遥感图像匹配的速度,并减少大量的计算资源,同时在图像检测和图像匹配等方面的研究也起到了重要作用,传统的深度学习超分辨率方法通常需要以高分辨率的图像作为训练数据集,该方法虽然能够有效提高图像的分辨率,但却难以补全图像中缺失的图像信息。

2、传统的图像检索的方法主要包括基于文本的图像检索tbir和基于内容的图像检索cbir。其中,tbir要求图像上传者对图像进行给出必要的标注,系统按照标注对图像进行存储索引,搜索引擎通过检索技术查找出和用户提供的关键字相近的图像。但由于此种方法完全没有考虑图像内容的本身,过度依赖于用户提供或者采集来的关键词,所以图像检索结果的正确性无法保证。cbir是通过提取图像的底层特征,并用图像特征间的相似性来得到最终结果,但是这种传统方法仅仅提取的是图像的低层特征,具有输入数据的底层特征和高层语义信息之间的不一致性和差异性的问题,通过卷积神经网络提取具有语义特征的高层特征,但对图像的关注区域无法判断,造成的检索结果准确度不是很高。传统的遥感图像匹配过程是以人为设计的描述符并计算遥感图像间的仿射关系,来进行图像匹配,需要大量的计算资源和计算时间。

3、综上,现有技术中的遥感图像匹配过程是以人为设计的描述符并计算遥感图像间的仿射关系,由于人为设计的描述符主观性强,无法具体的描述一个特征,无法对遥感图像多尺度特征进行细致的描述,且需要大量的计算资源和计算时间,导致遥感图像匹配时间长、准确率低。

技术实现思路

1、针对上述领域中存在的问题,本发明提出了一种图像多尺度特征融合匹配方法及系统,能够解决现有技术中的遥感图像匹配过程是以人为设计的描述符并计算遥感图像间的仿射关系,由于人为设计的描述符主观性强,无法具体的描述一个特征,且需要大量的计算资源和计算时间,无法对遥感图像多尺度特征进行细致的描述,导致遥感图像匹配时间长、准确率低的技术问题。

2、为解决上述技术问题,本发明公开了一种图像多尺度特征融合匹配方法,包括以下步骤:

3、对获取的待匹配的遥感图像数据进行拆分,均分成多组待匹配的遥感图像数据;

4、对多组待匹配的遥感图像数据的rgb图像进行相位一致性提取;根据相位一致性,计算遥感图像的边缘特征,并以此计算相位角度特征;

5、将相位角度特征通过批量矩阵乘法bmm进行多尺度融合,生成一组待匹配遥感图像的k特征、q特征和v特征;通过多注意力机制将q特征作为主干特征,并将k特征和v特征作为关键特征进行融合,获得自注意力特征;根据自注意力特征、k特征和v特征,对应获得该组待匹配遥感图像的自注意力、k特征和v特征预测的仿射矩阵;

6、通过仿射矩阵,对待匹配遥感图像进行多尺度描述。

7、优选地,还包括根据预测的仿射矩阵与仿射矩阵的真实值,计算损失函数并加权求和,获得加权后的损失函数;根据加权后的损失函数,确定待匹配的遥感图像的匹配程度。

8、优选地,所述计算遥感图像的边缘特征,包括以下步骤:

9、获取的待匹配的遥感图像数据为谷歌地图数据集,整个数据集包含9000对已经标定好的匹配对,每张待匹配的遥感图像的维度为1080×1080×3;

10、将标定好的图像输入深度学习网络,对图像进行双缝线性插值下采样,将图像尺寸变为480×480×3;

11、对标定好的图像进行拆分,将图像平分为4份,每一份的尺寸为240×240×3;

12、使用resnext101预训练网络,对多组待匹配的遥感图像数据的rgb图像进行特征提取,输入张量的尺寸为k×3×240×240,k输入张量的层数;输出张量的尺寸为k×1024×15×15;将该输出张量特征命名为特征1,该resnext101预训练网络在两张待匹配遥感图像中是共享参数的;

13、使用相位一致性进行特征提取,获得遥感图像的边缘特征;

14、在相位一致性中的最大矩m和最小矩m的基础上,通过公式(1)刻画图像中的关键边缘信息;

15、

16、式中,one是与最大矩m维度一致,且为数据全为1的矩阵;k1和k2为可调变量,调节边缘信息的平滑程度;e为边缘特征;取k1=150,k2=0.1。

17、优选地,所述相位角度特征的计算,包括以下步骤:

18、使用最大矩和最小矩进行特征提取,获取遥感图形的相位角度特征,并将相位角度换算到x轴和y轴上,结合边缘特征形成维度为3×240×240的相位角度和边缘特征图,即第一层为边缘特征,第二层和第三层均为相位角度特征;

19、对于相位角度和边缘特征图,使用cnn网络对特征进行卷积,将相位角度和边缘特征图计算到与特征1同一张量尺寸上;

20、cnn网络输入张量的尺寸为k×3×240×240,k为输入张量特征的层数;输出张量特征的尺寸为k×1024×15×15,将该输出张量特征命名为特征2,该cnn网络同样在两张待匹配遥感图像中是共享参数的。

21、优选地,所述生成一组待匹配遥感图像的k特征、q特征和v特征,包括以下步骤:

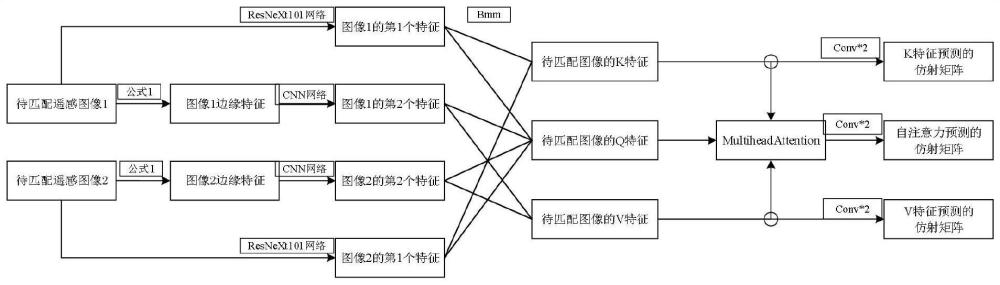

22、定义待匹配的遥感图像的匹配对为图像a和图像b,以图像a的第一个特征和图像b的第一个特征为依据,通过批量矩阵乘法bmm将两个特征维度为k×1024×15×15的特征图进行降维,变为k×1024×225;

23、将图像b的第一个特征转置并相乘,得到维度为k×225×225的融合特征,再次改变维度,重新变为k×225×15×15;

24、通过bmm,图像a的第一个特征和图像b的第一个特征生成了k特征;图像a的第二个特征和图像b的第二个特征生成了v特征;图像a的第一个特征、图像a的第二个特征、图像b的第一个特征和图像b的第二个特征共同生成了q特征。

25、优选地,所述对应获得该组待匹配遥感图像的自注意力、k特征和v特征预测的仿射矩阵,包括以下步骤:

26、使用多注意力机制,对生成待匹配遥感图像的k特征、q特征和v特征进行融合;

27、注意力机制需要使用线性的输入,将图像特征维度改为线性,设置图像特征尺寸为k×225×225,通过自注意力网络后,将图像特征维度重新改为k×225×15×15;

28、在通过多注意力机制后,使用两层conv卷积网络对融合后的特征进行处理,使用全连接层获得预测的关键量,对应得到自注意力预测的仿射矩阵、k特征预测的仿射矩阵和v特征预测的仿射矩阵。

29、优选地,所述对待匹配的遥感图像进行多尺度特征描述,包括以下步骤:

30、仿射变换包括缩放、角度和平移,缩放、角度和平移中的各变量按照式(2)组合成随机仿射矩阵,模拟图像间的仿射变换:

31、

32、式中,affine是仿射矩阵、缩放scale的定义范围为[0.5,2],代表图像可以代表图像可以缩小至原尺寸的0.5倍或放大至原尺寸的2倍;角度angle为弧度制,范围为平移代表平移的比例,包括tx和ty,其范围分别为[-1.5,1.5],分别表示在x轴和y轴上的平移;如果tx=2,代表其在x轴正方向上移动了整个图像的宽度,代表与原图没有重合部分;

33、使用同一个仿射矩阵,对目标图像和目标图像的边缘特征图进行仿射变换,对待匹配遥感图像进行多尺度描述。

34、优选地,所述确定待匹配的遥感图像的匹配程度,包括以下步骤:

35、获得的预测的关键量分别为scalep,anglep,txp和typ;将生成的预测的关键量scalep,anglep,txp和typ再次使用式(2),还原仿射矩阵θp,对应得到自注意力预测的仿射矩阵、k特征预测的仿射矩阵和v特征预测的仿射矩阵的预测值;

36、分别获得自注意力预测的仿射矩阵、k特征预测的仿射矩阵和v特征预测的仿射矩阵的损失函数:

37、

38、式中,θp代表预测值,θt代表真实值,l(θp,θt)代表预测值和真实值之间的损失;(xi,yj)是在图像中选取的一组点集,该点集是固定的,每隔20个像素取一个点,n为所取的点集的总数;代表使用预测的仿射矩阵对该点集进行仿射,代表使用真实值对该点集进行仿射,计算的损失函数为计算所取的n组点集的欧式距离并取平均;

39、使用式(3)计算自注意力预测的仿射矩阵、k特征预测的仿射矩阵和v特征预测的仿射矩阵与仿射矩阵的真实值之间的差异;

40、根据获得的自注意力预测的仿射矩阵、k特征预测的仿射矩阵和v特征预测的仿射矩阵的的损失函数,通过式(4)进行加权叠加进一步计算,得到加权后的损失函数为:

41、l=αlk(θp,θt)+βlm(θp,θt)+λlv(θp,θt) (4)

42、式中,α、β和λ为权重参数,取α=0.2,β=0.2和λ=0.6;

43、加权后的损失函数l取值越小,说明损失越小,代表遥感图像的匹配程度越高。

44、优选地,还包括一种图像多尺度特征融合匹配系统,包括:

45、图像获取模块,用于获取待匹配的遥感图像数据;

46、图像多尺度特征描述模块,用于对获取的待匹配的遥感图像数据进行拆分,均分成多组待匹配的遥感图像数据;对多组待匹配的遥感图像数据的rgb图像进行相位一致性提取;根据相位一致性,计算遥感图像的边缘特征,并以此计算相位角度特征;

47、图像匹配模块,用于将相位角度特征通过批量矩阵乘法bmm进行多尺度融合,生成一组待匹配遥感图像的k特征、q特征和v特征;通过多注意力机制将q特征作为主干特征,并将k特征和v特征作为关键特征进行融合,获得自注意力特征;根据自注意力特征、k特征和v特征,对应获得该组待匹配遥感图像的自注意力、k特征和v特征预测的仿射矩阵;通过仿射矩阵,对待匹配遥感图像进行多尺度描述。

48、与现有技术相比,本发明具有如下有益效果:

49、本发明将获取的待匹配的遥感图像数据均分成多组待匹配的遥感图像数据,可以解决缓解遥感图像数据不足的问题,提高网络训练的精度;使得提取的图像的边缘特征和相位角度特征更加精准,从而提高图像多尺度描述的准确性;通过注意力机制,将获得的相位角度特征进行多尺度融合,可以直接获得多个特征的仿射矩阵。本技术与现有技术相比,不需要人为设计描述符进行多尺度特征描述,本技术能够直接获得遥感图像间的仿射关系,极大的加快遥感图像匹配的速度;通过仿射矩阵可以直接对待匹配遥感图像进行多尺度描述,提高图像匹配的准确率。

- 还没有人留言评论。精彩留言会获得点赞!