视频目标分割方法、系统、电子设备及存储介质与流程

本发明涉及计算机视觉,尤其涉及一种视频目标分割方法、系统、电子设备及存储介质。

背景技术:

1、无监督视频目标分割任务旨在没有任何人工干预和任何先验信息提示的前提下,完全由算法本身去决定要分割视频中的哪些目标,这些目标一般都是视频中运动最为显著的前景目标。

2、受到拍摄条件的影响,视频往往会呈现帧率过高或过低、相机抖动、目标遮挡以及光照不断变化等特点,带来目标运动过快或者运动不显著、目标外观形变较大、目标本身与周围环境在颜色形状上较相似等情况,增加了无监督视频目标分割任务的难度。相关技术主要依靠人工设计的特征对运动目标信息进行提取,如边缘信息和显著信息等容易提取到的先验性特征。然而,在面对复杂多样且千变万化的现实场景时,相关技术算法将无法很好地适应和泛化,鲁棒性较差,导致视频数据中目标分割的准确性不足。

3、因此,现在亟需一种视频目标分割方法、系统、电子设备及存储介质来解决上述问题。

技术实现思路

1、针对现有技术存在的问题,本发明提供一种视频目标分割方法、系统、电子设备及存储介质。

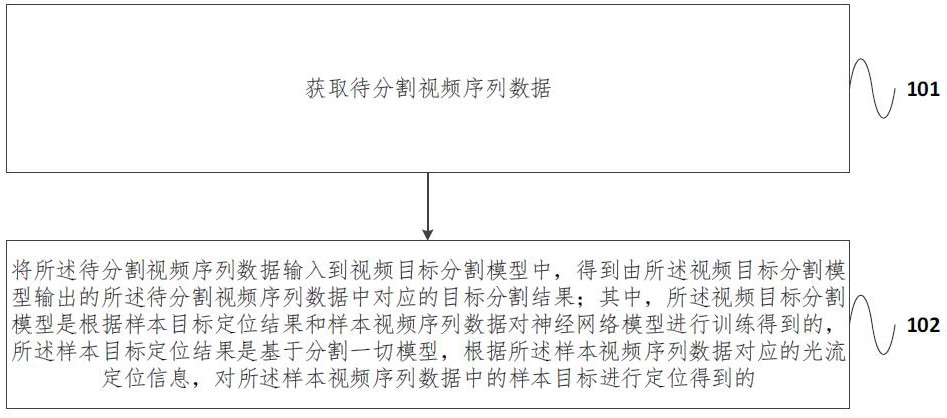

2、本发明提供一种视频目标分割方法,包括:

3、获取待分割视频序列数据;

4、将所述待分割视频序列数据输入到视频目标分割模型中,得到由所述视频目标分割模型输出的所述待分割视频序列数据中对应的目标分割结果;

5、其中,所述视频目标分割模型是根据样本目标定位结果和样本视频序列数据对神经网络模型进行训练得到的,所述样本目标定位结果是基于分割一切模型,根据所述样本视频序列数据对应的光流定位信息,对所述样本视频序列数据中的样本目标进行定位得到的。

6、根据本发明提供的一种视频目标分割方法,所述视频目标分割模型通过以下步骤训练得到:

7、获取所述样本视频序列数据对应的多个光流图;

8、提取各个所述光流图中的目标连通区域;

9、根据所述目标连通区域,获取所述样本视频序列数据对应的所述光流定位信息;

10、基于所述分割一切模型,对所述样本视频序列数据和所述光流定位信息进行编解码处理,得到所述样本视频序列数据对应的所述样本目标定位结果;

11、通过所述样本视频序列数据和所述样本视频序列数据对应的所述样本目标定位结果,对细化分割模型进行训练,得到所述视频目标分割模型,其中,所述细化分割模型是基于混合转换器mit构建得到的。

12、根据本发明提供的一种视频目标分割方法,所述获取所述样本视频序列数据对应的多个光流图,包括:

13、对所述样本视频序列数据中相邻两帧视频图像进行光流图像估计,获取所述样本视频序列数据对应的多个所述光流图;

14、或,对所述样本视频序列数据中预设间隔帧数的两帧视频图像进行光流图像估计,获取所述样本视频序列数据对应的多个所述光流图。

15、根据本发明提供的一种视频目标分割方法,所述提取各个所述光流图中的目标连通区域,包括:

16、基于所有所述光流图,计算各个所述光流图中每个像素点对应的全局显著性值;

17、基于各个所述光流图对应的灰度图的边缘信息,得到各个所述灰度图中的区域约束矩形框;

18、根据所述全局显著性值和预设显著性阈值,确定各个所述光流图中由目标像素点构成的多个待定连通区域;

19、基于所述区域约束矩形框,在对应的多个所述待定连通区域中确定显著性连通区域;

20、基于所述显著性连通区域的区域分值从高到低的顺序,对各个所述光流图中的所述显著性连通区域进行排序,并根据排序结果,将各个所述光流图中前 k个区域分值对应的所述显著性连通区域作为目标连通区域,其中,所述区域分值是根据所述显著性连通区域的尺寸信息计算得到的。

21、根据本发明提供的一种视频目标分割方法,所述根据所述目标连通区域,获取所述样本视频序列数据对应的所述光流定位信息,包括:

22、根据所述目标连通区域的像素信息,确定各个所述光流图对应的定位点坐标信息;

23、根据各个所述光流图中所有所述目标连通区域对应的目标外接矩形,得到各个所述光流图对应的目标外接矩形框坐标信息;

24、根据所述定位点坐标信息和所述目标外接矩形框坐标信息,得到所述样本视频序列数据对应的所述光流定位信息。

25、根据本发明提供的一种视频目标分割方法,所述基于所有所述光流图,计算各个所述光流图中每个像素点对应的全局显著性值,包括:

26、对所有所述光流图进行求平均操作,得到所有所述光流图对应的像素平均值;

27、根据各个所述光流图与所述像素平均值之间的差值,计算各个所述光流图中每个像素点对应的全局显著性值。

28、根据本发明提供的一种视频目标分割方法,所述基于各个所述光流图对应的灰度图的边缘信息,得到各个所述灰度图中的区域约束矩形框,包括:

29、将各个所述光流图转换为对应的灰度图;

30、通过canny算法,对各个所述灰度图进行边缘提取处理,得到各个所述灰度图中的边缘信息;

31、构建各个所述灰度图中所述边缘信息对应的外接矩形框,得到各个所述灰度图中的所述区域约束矩形框。

32、根据本发明提供的一种视频目标分割方法,所述根据所述全局显著性值和预设显著性阈值,确定各个所述光流图中由目标像素点构成的多个待定连通区域,包括:

33、获取各个所述光流图中的最大全局显著性值和全局显著性平均值;

34、根据所述最大全局显著性值和所述全局显著性平均值,确定各个所述光流图对应的所述预设显著性阈值;

35、基于各个所述光流图对应的所述预设显著性阈值,将各个所述光流图中所述全局显著性值大于或等于对应的所述预设显著性阈值的像素点作为目标像素点,将各个所述光流图中所述全局显著性值小于对应的所述预设显著性阈值的像素点的像素作为非目标像素点;

36、通过所述目标像素点,构建各个所述光流图中的多个所述待定连通区域。

37、根据本发明提供的一种视频目标分割方法,所述基于所述区域约束矩形框,在对应的多个所述待定连通区域中确定显著性连通区域,包括:

38、将处于所述灰度图中所述区域约束矩形框范围内的所述待定连通区域确定为所述显著性连通区域。

39、根据本发明提供的一种视频目标分割方法,所述方法还包括:

40、获取第一尺寸信息和第二尺寸信息,其中,所述第一尺寸信息为所述显著性连通区域的外接矩形框对应的坐标信息,所述第二尺寸信息为所述光流图的尺寸信息;

41、根据所述显著性连通区域中所述目标像素点的数量、所述第一尺寸信息和所述第二尺寸信息,计算得到所述显著性连通区域的所述区域分值。

42、根据本发明提供的一种视频目标分割方法,所述根据所述目标连通区域的像素信息,确定各个所述光流图对应的定位点坐标信息,包括:

43、将所述目标连通区域中各个所述目标像素点的横坐标进行求和处理,得到横坐标求和结果;

44、根据所述横坐标求和结果与所述目标连通区域中所述目标像素点的数量之间的比值,得到重心横坐标信息;

45、将所述目标连通区域中各个所述目标像素点的纵坐标进行求和处理,得到纵坐标求和结果;

46、根据所述纵坐标求和结果与所述目标连通区域中所述目标像素点的数量之间的比值,得到重心纵坐标信息;

47、根据所述重心横坐标信息和所述重心纵坐标信息,得到所述光流图的所述定位点坐标信息。

48、根据本发明提供的一种视频目标分割方法,所述根据所述定位点坐标信息和所述目标外接矩形框坐标信息,得到所述样本视频序列数据对应的所述光流定位信息,包括:

49、基于光流定位公式,根据所述定位点坐标信息和所述目标外接矩形框坐标信息,计算得到所述样本视频序列数据对应的所述光流定位信息,其中,所述光流定位公式为:

50、;

51、;

52、;

53、;

54、;

55、;

56、;

57、;

58、其中,表示所述光流定位信息,为所述目标外接矩形框坐标信息,为所述定位点坐标信息,表示求取各个所述光流图中 k个所述目标连通区域各自对应的所述定位点坐标信息和各个所述光流图中所有所述目标连通区域对应的所述目标外接矩形框坐标信息的操作,表示保留各个所述光流图中区域分值从高到低的前 k个所述显著性连通区域作为所述目标连通区域的操作,表示所述区域约束矩形框,表示通过所述区域约束矩形框在对应的多个所述待定连通区域中确定得到的所述显著性连通区域,表示对各个所述光流图中所有所述显著性连通区域进行打分的操作,表示所述预设显著性阈值,表示由所述目标像素点构建得到的多个所述待定连通区域, d表示所述全局显著性值,表示所述最大全局显著性值,表示所述全局显著性平均值,表示权重系数,表示绘制矩形框的操作,表示将所述光流图转换为所述灰度图的操作,表示通过canny算法对所述灰度图进行边缘提取处理,表示所述光流图,表示求平均操作,表示在通道维度进行求和操作, h表示所述光流图的高度信息, w表示所述光流图的宽度信息,表示所述显著性连通区域的外接矩形框的左上角坐标信息,表示所述显著性连通区域的外接矩形框的右下角坐标信息, n表示所述显著性连通区域中所述目标像素点的数量。

59、根据本发明提供的一种视频目标分割方法,所述基于所述分割一切模型,对所述样本视频序列数据和所述光流定位信息进行编解码处理,得到所述样本视频序列数据对应的所述样本目标定位结果,包括:

60、通过所述分割一切模型的图片编码器,对所述样本视频序列数据进行编码,得到所述样本视频序列数据中各个视频帧对应的样本图片特征;

61、通过所述分割一切模型的提示编码器,对所述光流定位信息进行编码,得到提示特征向量;

62、将所述样本图片特征和所述提示特征向量输入至所述分割一切模型的解码器,基于解码器公式进行解码,得到所述样本视频序列数据对应的所述样本目标定位结果。

63、根据本发明提供的一种视频目标分割方法,所述解码器公式为:

64、;

65、;

66、;

67、其中,表示所述样本目标定位结果,表示所述样本图片特征,表示提示特征向量,表示可学习向量,表示拼接操作,表示自注意力操作,表示解码操作,表示所述提示编码器,为所述目标外接矩形框坐标信息,为所述定位点坐标信息,表示所述图片编码器;表示所述样本视频序列数据,。

68、根据本发明提供的一种视频目标分割方法,所述通过所述样本视频序列数据和所述样本视频序列数据对应的所述样本目标定位结果,对细化分割模型进行训练,得到所述视频目标分割模型,包括:

69、将所述样本视频序列数据和所述样本视频序列数据对应的所述样本目标定位结果输入到所述细化分割模型,得到所述样本视频序列数据中的样本分割预测结果;

70、根据所述样本视频序列数据对应的样本分割真实结果与所述样本分割预测结果之间的差异,计算损失值,若所述损失值满足预设阈值,得到所述视频目标分割模型。

71、根据本发明提供的一种视频目标分割方法,在所述将所述样本视频序列数据和所述样本视频序列数据对应的所述样本目标定位结果输入到所述细化分割模型之后,所述方法还包括:

72、基于所述细化分割模型中的多层转换器块,得到由各层转换器块输出的所述样本视频序列数据在不同分辨率下对应的特征张量;

73、将不同分辨率的特征张量分别与对应的所述样本目标定位结果进行逐元素相乘操作,得到定位引导后的特征张量;

74、基于所述细化分割模型中的残差跳跃连接分支,获取残差跳跃连接特征张量,所述残差跳跃连接特征张量为当前层转换器块的前一层转换器块对应的特征张量;

75、基于特征融合公式,将当前层转换器块对应的特征张量、所述定位引导后的特征张量和所述残差跳跃连接特征张量进行拼接操作,得到融合后的特征张量;

76、基于解码预测公式,根据每一层转换器块对应的所述融合后的特征张量进行掩码预测,得到所述样本视频序列数据中的样本分割预测结果。

77、根据本发明提供的一种视频目标分割方法,所述特征融合公式为:

78、;

79、;

80、;

81、其中,表示采样操作,表示前一层转换器块对应的特征张量,表示定位引导后的特征张量,表示样本目标定位结果,表示当前层转换器块对应的特征张量,表示拼接操作,表示融合后的特征张量。

82、根据本发明提供的一种视频目标分割方法,所述解码预测公式为:

83、;

84、其中,表示样本分割预测结果,表示上采样操作,表示最后一层转换器输出的融合后的特征张量。

85、本发明还提供一种视频目标分割系统,包括:

86、视频数据获取模块,用于获取待分割视频序列数据;

87、目标分割模块,用于将所述待分割视频序列数据输入到视频目标分割模型中,得到由所述视频目标分割模型输出的所述待分割视频序列数据中对应的目标分割结果;

88、其中,所述视频目标分割模型是根据样本目标定位结果和样本视频序列数据对神经网络模型进行训练得到的,所述样本目标定位结果是基于分割一切模型,根据所述样本视频序列数据对应的光流定位信息,对所述样本视频序列数据中的样本目标进行定位得到的。

89、本发明还提供一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现如上述任一种所述视频目标分割方法。

90、本发明还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现如上述任一种所述视频目标分割方法。

91、本发明提供的视频目标分割方法、系统、电子设备及存储介质,基于分割一切模型,根据样本视频序列数据对应的光流定位信息,对样本视频序列数据中的样本目标进行定位,进而通过得到的样本目标定位结果和样本视频序列数据对神经网络模型进行训练,从而通过训练得到的视频目标分割模型对视频序列数据进行目标分割,得到更为准确的目标分割结果,提高了无监督视频目标分割在复杂场景下的可靠性、鲁棒性和抗噪性。

- 还没有人留言评论。精彩留言会获得点赞!