一种可见光与红外图像下无人机检测方法

本发明属于计算机视觉,尤其涉及一种可见光与红外图像下无人机检测方法。

背景技术:

1、无人驾驶飞行器可以在没有人类飞行员的情况下远程操作或配备任务程序。近年来,无人机技术由于其多样化的信息和通信技术应用而变得非常流行。此外,无人机已成为科学研究的关键实体。自20世纪初以来,无人机一直存在,主要部署在危险环境中,因为它们体积小,易于操作,并且能够取代人类的存在。最近,由商业公司生产的小型无人机在商业和民用环境中无处不在。无人机目前被用于各种应用,如探测、搜索和救援行动、交通和天气监测、航空摄影、精准农业等等。小型无人机的出现降低了生产成本,为普通大众提供了更实惠的设备。通过低成本的开发套件,可以轻松地在网上购买或组装,重量不到20公斤的小型无人机迅速普及。然而,无人机的广泛可用性为市场和科学发展带来了新的机遇和挑战。虽然无人机有一些优点,比如航空摄影或测绘,但同时带来了安全性和隐私问题。此外,缺乏统一的行业标准和法规导致许多无人机在没有监管的情况下运行,引起空中交通管制的重大关注,并对关键基础设施构成潜在威胁。对无人机目标的有效检测可以帮助预防潜在的危险事故,保护社会及人们的隐私。因此,无人机检测是非常重要的。尽管是必不可少的,但在有效检测无人机方面存在各种挑战。目前,小型无人机的检测方法主要有两种:雷达检测和视觉检测。由于无人机的材料、尺寸、形状和最大飞行速度的差异,它们表现出不同的雷达散射和多普勒特性,使得雷达检测效率低下。另一方面,视觉检测是一种比雷达检测更可靠、更经济的选择。然而,基于单一可见光模态的视觉检测在一些极端环境中可能是不够的,例如黑暗或大雾。因此,在可见光和红外模式之间切换已成为主流的无人机视觉检测解决方案。红外摄像机探测物体发出的热量,使它们能够在完全黑暗的环境中“看到”,这是可见光摄像机无法做到的。此外,它们创建的图像不受照明条件(如阴影,眩光或背光)的影响,使其适合监测具有挑战性的环境。然而由于红外和可见光模式的差异很大,大多数单模态无人机检测算法不能有效地适应当前的监控设备。基于图像的目标检测是计算机视觉中的一项关键任务。主流的视觉目标检测算法可以分为两类。一是单阶段目标检测算法。这些算法不依赖于候选帧,直接预测类别和位置数据以在一次检测中产生最终结果。第二类是两阶段目标检测算法。这些算法在第一阶段产生候选帧,然后在第二阶段对目标进行分类和回归。这类算法虽然精度较高,但检测速度更快,不能够满足无人机检测的实时性要求。

技术实现思路

1、为解决上述技术问题,本发明提出了一种可见光与红外图像下无人机检测方法,根据rgb和tir模式之间的实质性差异动态调整卷积核参数,最大限度的利用图像中的有效信息,提高无人机在不同模态下的检测精度。

2、为实现上述目的,本发明提供了一种可见光与红外图像下无人机检测方法,包括:

3、获得可见光与红外图像的rgb-t目标检测数据集,对所述目标检测数据集进行预训练,获取tir图像数据集;

4、基于所述tir图像数据集,通过多模态无人机检测与训练法获得基于m-dyconv的csp-block权重;

5、对目标区域进行图像采集,获取可见光和红外图像;

6、将所述可见光和红外图像输入所述csp-block权重,生成相应的不同尺度的特征图;

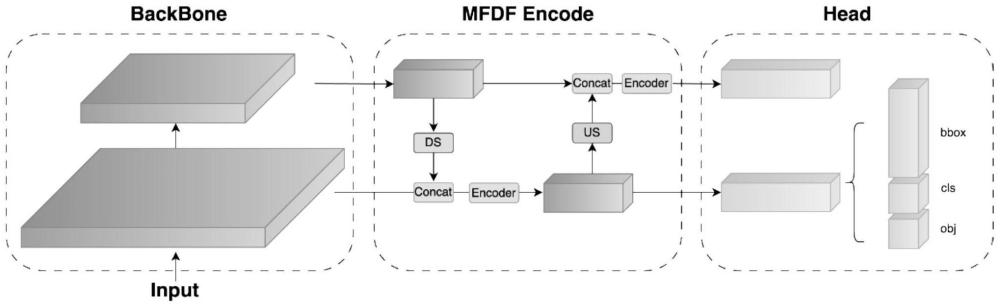

7、将所述不同尺度的特征图输入多尺度特征动态融合编码器mfdf进行融合,生成融合特征图;

8、将所述融合特征图输入到预测头进行处理,获取预测信息,所述预测信息包括无人机的位置和大小。

9、可选的,通过多模态无人机检测预训练法获得基于m-dyconv的csp-block权重的方法包括:将生成的红外数据集与标签匹配,每个图像都应有对应的标注文件,标注文件应包含目标的类别和边界框坐标;将数据集输入到模型中检测目标,根据标签进行梯度下降调整算法参数。

10、可选的,对目标区域进行图像采集,获取可见光和红外图像的方法包括:需要确定采集范围并选择可见光和红外传感器设备进行安装,启动设备后,进行数据采集获取可见光和红外图像。

11、可选的,将所述可见光和红外图像输入所述csp-block权重,生成相应的不同尺度的特征图的方法包括:加载预训练的权重,可见光或红外图像作为输入,并将其通过模型进行前向传播;在此过程中,图像将经过csp-block权重,通过提取csp-block的输出获得不同尺度的特征图。

12、可选的,将所述不同尺度的特征图输入多尺度特征动态融合编码器mfdf进行融合,生成融合特征图的方法包括:多尺度特征动态融合编码器的工作可以用下式表示:

13、x=concat(xs,xd)

14、式中,concat表示通道维数中两个特征张量的拼接,xs和xs分别表示骨干网络的浅特征和深特征。然后,输入特征x经过重复编码器的处理,其中每个编码器由两个剩余子块组成。第一个子块是包含多尺寸动态卷积模块的关键组件,该模块可以表示为:

15、x1=mdc1×1(norm(x))

16、x3=mdc3×3(norm(x))

17、x5=mdc5×5(norm(x))

18、y=concat(x1,x3,x5)

19、其中norm(·)表示层归一化。mdc*×*(·)表示多尺度动态卷积模块。第二个子块主要包括非线性激活的两层mlp。

20、z=σ(norm(y)w1)w2+y

21、其中,w1∈rc×rc,w2∈rrc×c为根据展开比r建立的mlp的可学习参数,σ(·)表示gelu激活函数。gelu激活函数可表示为:

22、

23、式中,φ(x)为x的高斯正态分布的累积函数,μ和σ为正态分布的均值和标准差,由于上式不能直接计算,因此gelu函数表示为:

24、gelu(x)=x*σ(1.702x)

25、式中σ(·)为sigmoid函数。

26、可选的,对所述目标检测数据集进行预训练的方法包括:将rgb图像转换为热图像涉及到为给定图像中不同类别的对象分配不同的灰度值;利用已有的rgb数据集提供补充注释信息,包括位置和类别详细信息,增强图像转换工作的效率;将独特的热成像特征和注释的rgb数据集结合起来,将rgb图像转换为tir图像。

27、可选的,所述多尺度特征动态融合编码器的工作方法为:

28、x=concat(xs,xd)

29、式中,concat表示通道维数中两个特征张量的拼接,xs和xs分别表示骨干网络的浅特征和深特征。

30、可选的,所述rgb图像转化为热图像的过程具体包括以下步骤:

31、相同像素位置的r、g、b通道的数值取平均值,然后映射为灰度值,将rgb图像转换为灰度图像;

32、使用较小的超参数来乘以背景图像,区分tir图像中的目标和背景。

33、可选的,将rgb图像转换为tir图像,计算如下:

34、

35、其中,i(x,y)代表生成的预训练图像像素的值,x与y代表位置,ir、ig、ib代表原图像中的红绿蓝三个通道。

36、本发明技术效果:本发明公开了一种可见光与红外图像下无人机检测方法,根据rgb和tir模式之间的实质性差异动态调整卷积核参数,最大限度的利用图像中的有效信息,提高无人机在不同模态下的检测精度;利用多尺度动态卷积增强对目标特征的关注,提高了骨干网特征提取的利用率;通过补偿红外图像数据集的缺乏和低数据量相关的过拟合问题来提高模型的精度。

- 还没有人留言评论。精彩留言会获得点赞!