基于超网络和层级别协作图聚合的个性化联邦学习方法

本发明涉及机器学习领域,特别涉及一种基于超网络和层级别协作图聚合的个性化联邦学习方法。

背景技术:

1、联邦学习是在保护隐私数据的前提下对客户端进行协同训练的方法,其基本思想是用模型参数代替本地数据进行传输。个性化联邦学习针对客户端数据分布的统计异构性(non-iid(non - independent identically distribution,非独立同分布)问题)进行了针对性设计,其核心在于根据客户端本地数据的特性学习多个本地模型,主要包括以下几种类型:例如基于正则化、基于模型解耦、基于个性化参数聚合等。其中,基于个性化参数聚合的联邦学习方法可以为每个客户端学习专属的个性化模型,该个性化模型由服务器端对特定于客户端的参数选择并进行加权聚合得到。

2、fedla作为捕捉客户端之间协作关系的技术方案,该方法利用超网络生成特定于客户端的聚合参数并进行层级别的参数聚合,同时通过优化超网络参数和客户端特征嵌入来自适应调节聚合参数。fedla的超网络由dnn构成,其共用了3层全连接网络,并由不同的全连接层为每个模型参数层生成不同的聚合权重,由此,通过fedla特性则会带来以下问题:(1)只依靠优化结果捕捉客户端协作关系,效果依赖于特征嵌入和超网络中众多参数的优化结果,实际性能难以保证;(2)由于共用一部分基础层,难以表示聚合权重在层之间差异较大的情况,不够灵活;(3)超网络参数的体量较大,在服务器端的额外存储空间等资源占用较多。

3、综上,可以看出捕捉客户端协作关系是一个复杂的问题,分析其原因,需要综合考虑更多因素,如客户端的选择策略、与其他协作客户端合作程度、协作客户端之间内部的差异等。

4、相关技术中,一般对客户端协作的建模不够完善,大多数方法只关注了部分协作因素,例如fedamp进行了带有注意消息传递机制的个性化聚合,但是该方法在客户端级别(将模型视为一个整体)进行聚合,个性化模型的作用是与本地模型进行正则化;fedala用权重参数矩阵学习本地模型和全局模型的协作关系,然而全局模型结合了所有参与客户端的信息,没有进行细致的客户端选择,因此全局模型中的信息并不全是有效的;fedpac计算了客户端本地模型的特征质心,通过衡量特征质心的相似性来选择协作客户端,然而其在通讯过程中引入了特征质心这一额外数据,存在一定的隐私风险。

5、因此,相关技术会存在以下弊端:(1)没有很好的建模并捕捉客户端协作关系,客户端协作不够灵活可靠;(2)为了更好的捕捉客户端协作关系而引入额外通讯数据,存在一定隐私风险;(3)只考虑了全局模型和本地模型的信息交互,没有进行一定的客户端选择;(4)只考虑客户端之间的整体关系,没有考虑层级别的协作关系;(5)现有技术在架构设计上共有模块居多,难以表征不同层之间的客户端选择差异性,亟需解决。

技术实现思路

1、本发明提供一种基于超网络和层级别协作图聚合的个性化联邦学习方法,以解决基于个性化参数聚合的联邦学习方法在选择客户端进行协作时不够灵活的问题。

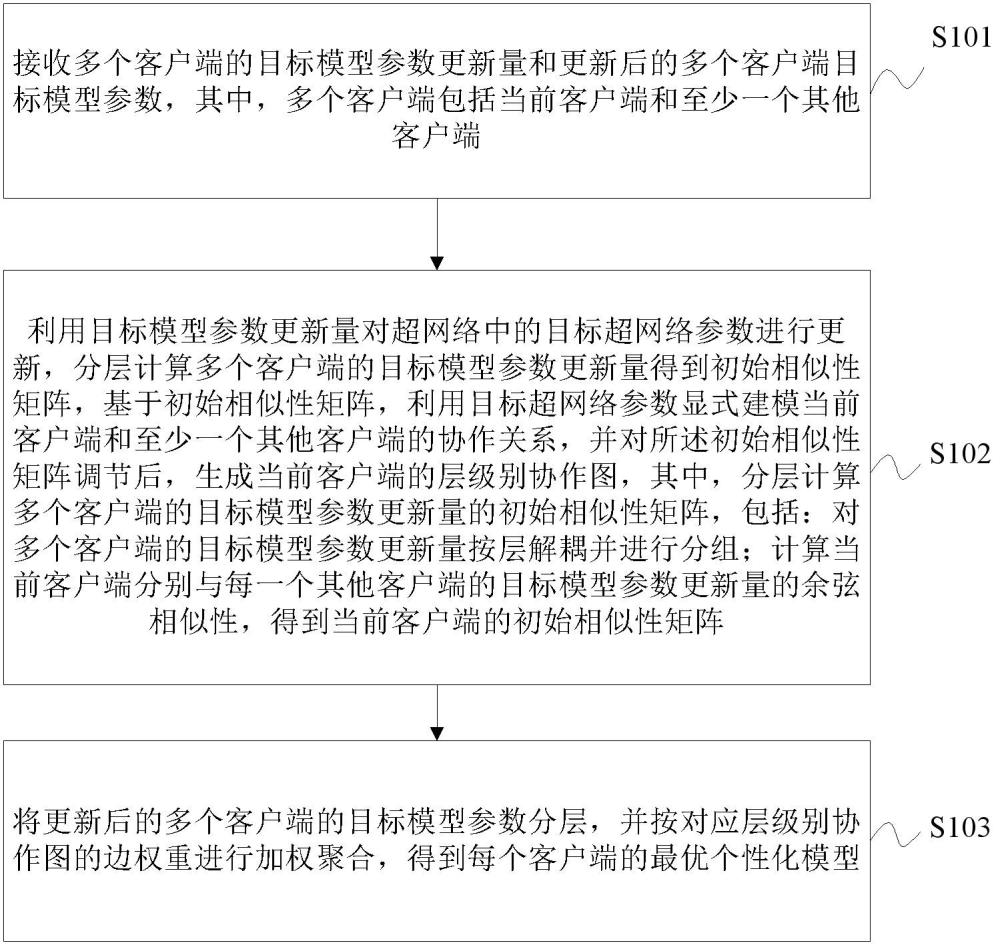

2、本发明第一方面实施例提供一种基于超网络和层级别协作图聚合的个性化联邦学习方法,包括以下步骤:

3、接收多个客户端的目标模型参数更新量和更新后的多个客户端目标模型参数,其中,所述多个客户端包括当前客户端和至少一个其他客户端;

4、利用所述目标模型参数更新量对超网络中的目标超网络参数进行更新,分层计算所述多个客户端的目标模型参数更新量得到初始相似性矩阵,基于所述初始相似性矩阵,利用所述目标超网络参数显式建模当前客户端和至少一个其他客户端的协作关系,并对所述初始相似性矩阵调节后,生成所述当前客户端的层级别协作图;以及

5、将所述更新后的多个客户端目标模型参数分层,并按对应层级别协作图的边权重进行加权聚合,得到每个客户端的最优个性化模型。

6、根据本发明的一个实施例,所述分层计算所述多个客户端的目标模型参数更新量的初始相似性矩阵,包括:

7、对所述多个客户端的目标模型参数更新量按层解耦并进行分组;

8、计算所述当前客户端分别与每一个其他客户端的目标模型参数更新量的余弦相似性,得到所述当前客户端的初始相似性矩阵。

9、根据本发明的一个实施例,所述基于所述初始相似性矩阵,利用所述目标超网络参数显式建模当前客户端和至少一个其他客户端的协作关系,并对所述初始相似性矩阵调节后,生成所述当前客户端的层级别协作图,包括:

10、基于所述初始相似性矩阵并利用所述目标超网络参数显式建模当前客户端和至少一个其他客户端的协作关系,表征所述当前客户端分别与每一个其他客户端的协作差异性和协作程度;

11、利用所述目标超网络参数调节所述初始相似性矩阵,得到所述当前客户端分别与每一个其他客户端的协作权重,并对所述协作权重进行归一化处理,得到所述当前客户端分别与每一个其他客户端的聚合权重,并根据所述聚合权重捕捉所述当前客户端分别与每一个其他客户端的协作关系;

12、根据所述目标超网络参数对所述协作关系进行调节,并基于调节后的协作关系生成所述当前客户端的层级别协作图。

13、根据本发明的一个实施例,所述将所述更新后的多个客户端的模型参数分层,并按对应层级别协作图的边权重进行加权聚合,得到所述每个客户端的最优个性化模型,还包括:

14、将所述更新后的多个客户端目标模型参数分层,以分层后的目标模型参数作为节点特征,并按对应层级别协作图的边权重进行图上的加权聚合,得到所述每个客户端对应的个性化模型,并输出所述至少一个在验证集上的测评结果;

15、根据所述至少一个在验证集上的测评结果确定所述每个客户端的最优个性化模型。

16、根据本发明的一个实施例,在根据所述至少一个在验证集上的测评结果确定所述每个客户端的最优个性化模型之前,还包括:

17、获取所述多个客户端的当前迭代次数;

18、判断所述当前迭代次数是否满足预设迭代次数;

19、若所述当前迭代次数不满足所述预设迭代次数,则重新执行所述接收所述多个客户端的目标模型参数更新量的步骤。

20、根据本发明实施例的基于超网络和层级别协作图聚合的个性化联邦学习方法,接收多个客户端的目标模型参数更新量和更新后的多个客户端目标模型参数,并对超网络中的目标超网络参数进行自适应更新,分层计算多个客户端的目标模型参数更新量得到初始相似性矩阵,并利用目标超网络参数显式建模多个客户端的协作关系,进而生成层级别协作图,将更新后的多个客户端的目标模型参数分层,并按对应层级别协作图边权重进行加权聚合,得到每个客户端的最优个性化模型。由此,有效缓解了基于个性化参数聚合的联邦学习方法在选择客户端进行协作时不够灵活的问题,通过超网络构建客户端协作意图,并为每个客户端学习个性化聚合的模型,同时为模型的每一层建模并捕捉客户端之间的协作关系,提高了客户端协作的灵活性,从而提升个性化联邦学习的性能。

21、本发明第二方面实施例提供一种基于超网络和层级别协作图聚合的个性化联邦学习装置,包括:

22、接收模块,用于接收多个客户端的目标模型参数更新量和更新后的多个客户端目标模型参数,其中,所述多个客户端包括当前客户端和至少一个其他客户端;

23、生成模块,用于利用所述目标模型参数更新量对超网络中的目标超网络参数进行更新,分层计算所述多个客户端的目标模型参数更新量得到初始相似性矩阵,基于所述初始相似性矩阵,利用所述目标超网络参数显式建模当前客户端和至少一个其他客户端的协作关系,并对所述初始相似性矩阵调节后,生成所述当前客户端的层级别协作图;以及

24、协作图聚合模块,用于将所述更新后的多个客户端目标模型参数分层,并按对应层级别协作图的边权重进行加权聚合,得到所述每个客户端的最优个性化模型。

25、根据本发明的一个实施例,所述生成模块,具体用于:

26、对所述多个客户端的目标模型参数更新量按层解耦并进行分组;

27、计算所述当前客户端分别与每一个其他客户端的目标模型参数更新量的余弦相似性,得到所述当前客户端的初始相似性矩阵。

28、根据本发明的一个实施例,所述生成模块,具体用于:

29、基于所述初始相似性矩阵并利用所述目标超网络参数显式建模当前客户端和至少一个其他客户端的协作关系,表征所述当前客户端分别与每一个其他客户端的协作差异性和协作权程度;

30、利用所述目标超网络参数调节所述初始相似性矩阵,得到所述当前客户端分别与每一个其他客户端的协作权重,并对所述协作权重进行归一化处理,得到所述当前客户端分别与每一个其他客户端的聚合权重,并根据所述聚合权重捕捉所述当前客户端分别与每一个其他客户端的协作关系;

31、根据所述目标超网络参数对所述协作关系进行调节,并基于调节后的协作关系生成所述当前客户端的层级别协作图。

32、根据本发明的一个实施例,所述协作图聚合模块,还用于:

33、将所述更新后的多个客户端目标模型参数分层,以分层后的目标模型参数作为节点特征,并按对应层级别协作图的边权重进行图上的加权聚合,得到所述每个客户端对应的个性化模型,并输出至少一个在验证集上的测评结果;

34、根据所述至少一个在验证集上的评结果确定所述每个客户端的最优个性化模型。

35、根据本发明的一个实施例,在根据所述至少一个在验证集上的测评结果确定所述每个客户端的最优个性化模型之前,所述协作图聚合模块,还用于:

36、获取所述多个客户端的当前迭代次数;

37、判断所述当前迭代次数是否满足预设迭代次数;

38、若所述当前迭代次数不满足所述预设迭代次数,则重新执行所述接收所述多个客户端的目标模型参数更新量的步骤。

39、根据本发明实施例的基于超网络和层级别协作图聚合的个性化联邦学习装置,接收多个客户端的目标模型参数更新量和更新后的多个客户端目标模型参数,并对超网络中的目标超网络参数进行自适应更新,分层计算多个客户端的目标模型参数更新量得到初始相似性矩阵,并利用目标超网络参数显式建模多个客户端的协作关系,进而生成层级别协作图,将更新后的多个客户端的目标模型参数分层,并按对应层级别协作图边权重进行加权聚合,得到每个客户端的最优个性化模型。由此,有效缓解了基于个性化参数聚合的联邦学习方法在选择客户端进行协作时不够灵活的问题,通过超网络构建客户端协作意图,并为每个客户端学习个性化聚合的模型,同时为模型的每一层建模并捕捉客户端之间的协作关系,提高了客户端协作的灵活性,从而提升个性化联邦学习的性能。

40、本发明第三方面实施例提供一种服务器,包括:存储器、处理器及存储在所述存储器上并可在所述处理器上运行的计算机程序,所述处理器执行所述程序,以实现如上述实施例所述的基于超网络和层级别协作图聚合的个性化联邦学习方法。

41、本发明第四方面实施例提供一种计算机可读存储介质,其上存储有计算机程序,该程序被处理器执行,以用于实现如上述实施例所述的基于超网络和层级别协作图聚合的个性化联邦学习方法。

42、本发明附加的方面和优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本发明的实践了解到。

- 还没有人留言评论。精彩留言会获得点赞!