预训练模型的训练方法、装置和计算机设备与流程

本技术涉及人工智能,特别是涉及一种预训练模型的训练方法、装置、计算机设备、存储介质和计算机程序产品。

背景技术:

1、随着网络视频内容的指数级增长,视频与文本相结合的形式已经逐渐成为当今信息传播的核心媒介。在这些融合了生动视觉与深度文字描述的多媒体资源中,蕴含着无比丰富的信息内涵,如何高效利用大规模多模态数据资源成为深度学习领域的研究焦点。强大的预训练模型可以解决这一难题,预训练模型能够优化任务模型的性能,还能够减少针对不同应用场景进行反复迭代的需求。

2、然而,相关技术中,视频与文本的预训练模型表达能力不强,对视频、文本内容的理解和处理能力较弱。

技术实现思路

1、基于此,有必要针对上述技术问题,提供一种能够视频文本理解力和表达力的预训练模型的训练方法、装置、计算机设备、计算机可读存储介质和计算机程序产品。

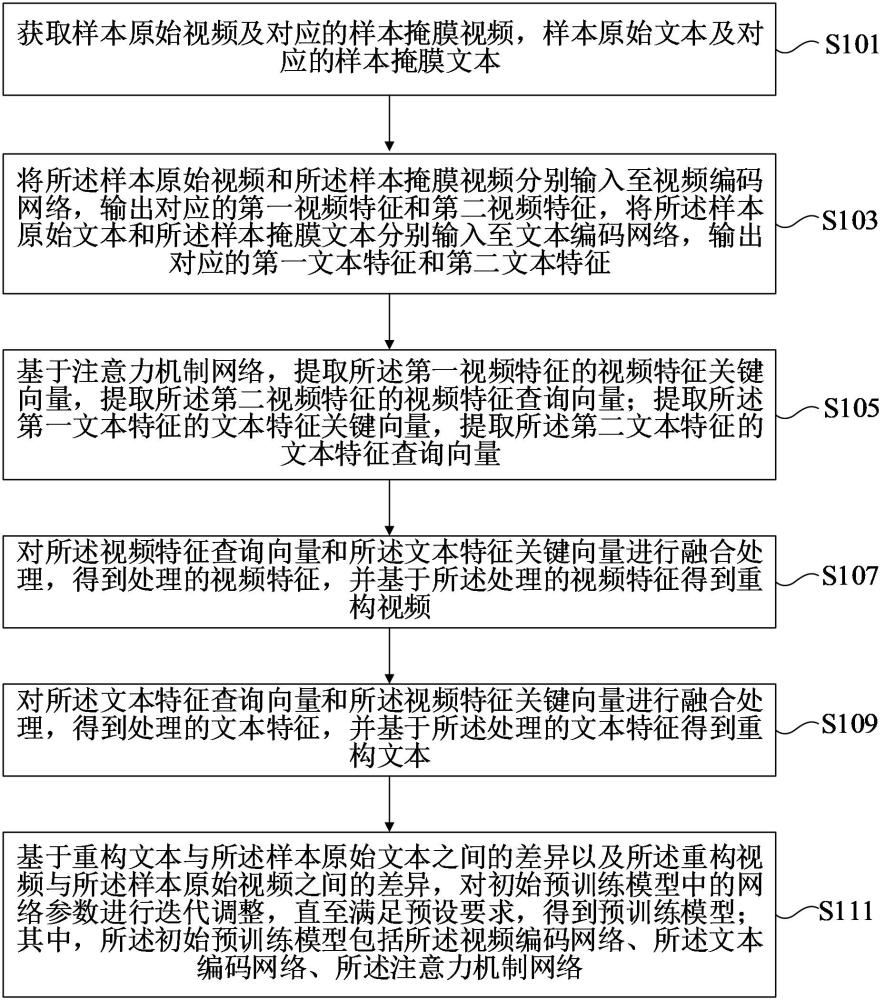

2、第一方面,本技术提供了一种预训练模型的训练方法。所述方法包括:

3、获取样本原始视频及对应的样本掩膜视频,样本原始文本及对应的样本掩膜文本;

4、将所述样本原始视频和所述样本掩膜视频分别输入至视频编码网络,输出对应的第一视频特征和第二视频特征,将所述样本原始文本和所述样本掩膜文本分别输入至文本编码网络,输出对应的第一文本特征和第二文本特征;

5、基于注意力机制网络,提取所述第一视频特征的视频特征关键向量,提取所述第二视频特征的视频特征查询向量;提取所述第一文本特征的文本特征关键向量,提取所述第二文本特征的文本特征查询向量;

6、对所述视频特征查询向量和所述文本特征关键向量进行融合处理,得到处理的视频特征,并基于所述处理的视频特征得到重构视频;

7、对所述文本特征查询向量和所述视频特征关键向量进行融合处理,得到处理的文本特征,并基于所述处理的文本特征得到重构文本;

8、基于重构文本与所述样本原始文本之间的差异以及所述重构视频与所述样本原始视频之间的差异,对初始预训练模型中的网络参数进行迭代调整,直至满足预设要求,得到预训练模型;其中,所述初始预训练模型包括所述视频编码网络、所述文本编码网络、所述注意力机制网络。

9、第二方面,本技术提供了一种视频分类方法,所述方法包括:

10、获取待分类的视频;

11、将所述视频输入至视频分类模型,输出所述视频的类别;其中,所述视频分类模型包括对初始视频分类模型进行网络参数调整后获得,其中,所述初始视频分类模型包括如本公开实施例任一项所述的方法训练的预训练模型以及分类器网络。

12、第三方面,本技术提供了一种视频检索方法,所述方法包括:

13、获取待检索的视频;

14、将所述视频输入至视频特征提取模型,输出对应的视频特征;其中,所述视频特征提取模型基于本公开实施例任一项所述的方法训练的预训练模型进行网络参数调整后获得;

15、从预设的视频特征集合中确定与所述视频特征项匹配的目标视频特征,确定与所述目标视频特征相匹配的目标视频作为检索结果。

16、第四方面,本技术还提供了一种预训练模型的训练装置,所述装置包括:

17、第一获取模块,用于获取样本原始视频及对应的样本掩膜视频,样本原始文本及对应的样本掩膜文本;

18、第一特征提取模块,用于将所述样本原始视频和所述样本掩膜视频分别输入至视频编码网络,输出对应的第一视频特征和第二视频特征,将所述样本原始文本和所述样本掩膜文本分别输入至文本编码网络,输出对应的第一文本特征和第二文本特征;

19、第二特征提取模块,用于基于注意力机制网络,提取所述第一视频特征的视频特征关键向量,提取所述第二视频特征的视频特征查询向量;提取所述第一文本特征的文本特征关键向量,提取所述第二文本特征的文本特征查询向量;

20、第一特征融合模块,用于对所述视频特征查询向量和所述文本特征关键向量进行融合处理,得到处理的视频特征,并基于所述处理的视频特征得到重构视频;

21、第二特征融合模块,用于对所述文本特征查询向量和所述视频特征关键向量进行融合处理,得到处理的文本特征,并基于所述处理的文本特征得到重构文本;

22、生成模块,用于基于重构文本与所述样本原始文本之间的差异以及所述重构视频与所述样本原始视频之间的差异,对初始预训练模型中的网络参数进行迭代调整,直至满足预设要求,得到预训练模型;其中,所述初始预训练模型包括所述视频编码网络、所述文本编码网络、所述注意力机制网络。

23、在其中一个实施例中,所述文本特征关键向量可以包括文本特征键向量和文本特征数值向量,所述第一特征融合模块还用于:

24、获取所述视频特征查询向量与所述文本特征键向量之间的相似度;

25、基于所述视频特征查询向量与所述文本特征键向量之间的相似度,对所述文本特征数值向量进行加权处理,得到处理的视频特征。

26、在其中一个实施例中,所述视频特征关键向量可以包括视频特征键向量和视频特征数值向量,所述第二特征融合模块还用于:

27、获取所述文本特征查询向量与所述视频特征键向量之间的相似度;

28、基于所述文本特征查询向量与所述视频特征键向量之间的相似度,对所述视频特征数值向量进行加权处理,得到处理的文本特征。

29、在其中一个实施例中,所述第一获取模块还用于:

30、获取样本原始视频及预设的掩膜矩阵;其中,所述掩膜矩阵包括像素在时间维度、空间维度对应的取值数据;

31、基于所述掩膜矩阵,对所述样本原始视频进行掩膜处理,得到样本掩膜视频。

32、在其中一个实施例中,所述第一获取模块还用于:

33、获取样本原始文本,并对所述样本原始文本进行分词处理,得到所述样本原始文本对应的词语集合;

34、从所述词语集合中获取词语及对应的屏蔽状态;其中,所述掩膜状态包括替换为预设标识、替换为其他词语以及保持不变;

35、基于所述词语对应的屏蔽状态,对所述词语进行掩膜处理,直至所述词语集合中所有的词语处理完毕,得到样本掩膜文本。

36、在其中一个实施例中,所述第一特征提取模块还用于:

37、基于视频编码网络,对所述样本原始视频进行分块处理,得到处理的视频块;

38、对所述处理的视频块进行下采样的特征提取,得到初始视频特征;

39、对所述初始视频特征再次进行下采样的特征提取,得到中间视频特征,对所述中间视频特征继续进行下采样的特征提取,直到满足预设要求,得到第一视频特征。

40、在其中一个实施例中,所述第一特征提取模块还用于:

41、基于窗口注意力机制网络提取所述处理的视频块的特征,得到第一视频特征;

42、基于局部注意力机制网络提取所述处理的视频块的特征,得到第二视频特征;其中,所述局部注意力机制网络的特征提取区域与所述窗口注意力机制网络的特征提取区域不同;

43、对所述第一视频特征和所述第二视频特征进行融合处理,得到中间视频特征。

44、在其中一个实施例中,所述第二特征提取模块还用于:

45、基于文本编码网络,对所述样本原始文本进行分词处理,得到处理的词语;

46、获取所述词语的位置信息,对所述位置信息进行编码,得到位置编码向量;

47、提取所述词语及对应位置编码向量的特征,得到第一文本特征。

48、在其中一个实施例中,所述第一特征融合模块还用于:

49、对所述处理的视频特征和所述第一视频特征进行融合处理,得到融合的视频特征;

50、将所述融合的视频特征输入至视频解码器网络,输出得到重构视频。

51、在其中一个实施例中,所述第二特征融合模块还用于:

52、对所述处理的文本特征和所述第一文本特征进行融合处理,得到融合的文本特征;

53、将所述融合的文本特征输入至文本解码器网络,输出得到重构文本。

54、在其中一个实施例中,所述生成模块还用于:

55、基于所述重构文本与所述样本原始文本之间的差异,确定文本损失;

56、基于所述重构视频与所述样本原始视频之间的差异,确定视频损失;

57、对所述文本损失和所述视频损失进行加权融合处理,得到联合损失;

58、基于所述联合损失,对初始预训练模型中的网络参数进行迭代调整。

59、在其中一个实施例中,所述生成模块还用于:

60、获取所述重构文本与所述样本原始文本之间的相似距离;

61、对所述相似距离进行正则化处理,得到文本损失。

62、第五方面,本技术还提供了一种视频分类装置,所述装置包括:

63、第二获取模块,用于获取待分类的视频;

64、分类模块,用于将所述视频输入至视频分类模型,输出所述视频的类别;其中,所述视频分类模型包括对初始视频分类模型进行网络参数调整后获得,其中,所述初始视频分类模型包括如本公开实施例中任一项所述的方法训练的预训练模型以及分类器网络。

65、第六方面,本技术提供一种视频检索装置,所述装置包括:

66、第三获取模块,用于获取待检索的视频;

67、检索模块,用于将所述视频输入至视频特征提取模型,输出对应的视频特征;其中,其中,所述视频特征提取模型基于本公开实施例任一项所述的方法训练的预训练模型进行网络参数调整后获得;

68、检索结果生成模块,用于从预设的视频特征集合中确定与所述视频特征项匹配的目标视频特征,确定与所述目标视频特征相匹配的目标视频作为检索结果。

69、第七方面,本技术还提供了一种计算机设备。所述计算机设备包括存储器和处理器,所述存储器存储有计算机程序,所述处理器执行所述计算机程序时实现本公开实施例中任一项所述的方法的步骤。

70、第八方面,本技术还提供了一种计算机可读存储介质。所述计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现本公开实施例中任一项所述的方法的步骤。

71、第九方面,本技术还提供了一种计算机程序产品。所述计算机程序产品,包括计算机程序,该计算机程序被处理器执行时实现本公开实施例中任一项所述的方法的步骤。

72、上述预训练模型的训练方法、装置、计算机设备、存储介质和计算机程序产品,通过对所述视频特征查询向量和所述文本特征关键向量进行融合处理,得到处理的视频特征,从而处理的视频特征包含了文本到视频的信息流动,有利于预训练模型深度理解视频内在的结构和语义,引导预训练模型捕捉视频动态特征。相应地,对所述文本特征查询向量和所述视频特征关键向量进行融合处理,从而处理的文本特征包含了视频到文本的信息流动,有利于预训练模型提炼和强化对文本信息的理解能力。进一步地,处理的视频特征中,视频特征查询向量来源于对样本掩膜视频的特征提取,文本特征数值向量和文本特征键向量来源于对原始文本的特征提取,其中,原始文本没有进行掩膜,包含更完整的文本信息,从而可以向处理的视频特征提供更全面的信息。相应地,处理的文本特征中,文本特征查询向量来源于对样本掩膜文本的特征提取,视频特征数值向量和视频特征键向量来源于对原始视频的特征提取,其中,原始视频没有进行掩膜,包含更完整的视频信息,从而可以向处理的文本特征提供更全面的信息。提高了预训练模型对视频、文本的理解力和表达力。此外,样本掩膜视频和样本掩膜文本的使用,有助于提高了预训练模型的抗噪能力。

- 还没有人留言评论。精彩留言会获得点赞!