一种基于骨骼和轮廓特征融合的步态识别方法

1.本发明属于计算机视觉领域,尤其涉及一种基于骨骼和轮廓特征融合的步态识别方法。

背景技术:

2.步态识别通常是指根据行人行走时的步态来识别来行人的过程,是计算机视觉领域一个重要的研究和应用方向,广泛应用于场景监控、行人识别等领域的视频分析,具有广阔的应用前景和使用价值。

3.步态识别技术可分为基于模型的方法、基于行人轮廓图的方法、基于步态能量图的方法、基于步态熵图的方法、基于骨骼关键点的方法等类别。

4.基于行人轮廓图的方法是一种常用方法,它通过背景分离或实例分割技术对视频中的行人进行实例提取,生成行人轮廓图,然后通过卷积神经网络对步态特征进行提取和识别;该方法具有较好的识别效果,但在拍摄角度、行人衣着或携带物等发生变化时,识别率会明显下降。

5.基于骨骼关键点的方法是另一种常用方法,它通过姿态估计方法来进行骨骼关键点信息提取,通过对关键点运动变化的识别来实现对行人步态的识别;该方法对行人衣着打扮具有较高的鲁棒性;但是在受遮挡时识别率也会受到严重影响。

6.为了解决步态识别中易受服装、视角和携带物等因素影响识别效果的问题,考虑到多模态特征融合具有鲁棒性强和稳定性好等优点,本发明提出一种多模态特征融合的步态识别方法,先提取行人骨骼关键点特征,以及行人轮廓图特征,再将其送入神经网络,在网络中间进行融合,可实现的基于步态的行人识别;该方法具有识别精度高、鲁棒性强等优点。

技术实现要素:

7.一种基于骨骼和轮廓特征融合的步态识别方法,其特征在于,包括以下步骤。

8.步骤1,采用基于神经网络的姿态估计算法对视频进行处理,得到每帧图像中的行人骨骼关键点位置,包括:基于神经网络的姿态估计算法,采用具有并行的多子网络结构的特征提取模型,使用骨骼关键点的高斯热力图作为标签进行模型训练;最后通过寻找高斯热力图中的峰值点来确定行人骨骼关键点位置。

9.步骤2,使用骨骼关键点位置数据进行计算,生成关键点移动速度、骨骼长度与角度数据;骨骼关键点的位置、速度、骨骼长度与角度统称为骨骼关键点数据。

10.步骤3,通过图卷积神经网络对行人骨骼关键点数据进行特征提取,包括:将骨骼关键点位置、速度、骨骼长度与角度这三组骨骼关键点数据,作为三个输入分别顺序经过批正则化模块、初始化模块、两个带注意力机制的图卷积神经网络模块,进行特征提取;然后在网络的中部进行融合,最后通过一条共享的主干网络,即两个带注意力机

制的图卷积神经网络模块,生成最终的行人骨骼关键点特征图。

11.步骤4,采用基于神经网络的实例分割方法对原始视频数据进行处理,生成行人的轮廓图,包括:采用轻量化的实例分割模型对原始视频中的每一帧进行特征提取,得到相应的行人轮廓图。

12.步骤5,对行人轮廓图进行归一化处理,包括:剪除垂直方向上的多余像素并放缩到合适的尺寸,剪除水平方向上多余的像素得到最终的图片尺寸。

13.步骤6,采用局部轮廓特征提取器对归一化后的行人轮廓图进行特征提取,并使用时间特征聚合注意力模块对其进行特征压缩,包括:时间特征聚合注意力模块通过最大值函数、均值函数和中值函数三种基础函数对输入进行全局特征收集,然后在时间维度上进行复制并将三者拼接到一起;最后通过1*1的卷积进行通道压缩并生成注意力图,得到最终的行人轮廓特征图。

14.步骤7,将行人骨骼关键点特征图和行人轮廓特征图进行拼接,使用分离全连接层和局部注意力机制引导两者融合,生成最终的步态特征。

15.步骤8,使用欧式距离,比对计算生成的步态特征与数据库中的步态特征,选取出距离最小的步态特征对应的行人,作为最终的识别结果。

16.本方法融合了行人轮廓图识别方法和骨骼关键点识别方法的优点,将行人轮廓图特征和骨骼关键点特征送入神经网络,在网络中间进行融合,使得处于携带物、服装、视角等因素影响下的步态识别精度有了显著提升,具有良好的鲁棒性。

附图说明

17.图1为本发明方法的流程示意图。

18.图2为骨骼关键点及其高斯热力图示意图。

19.图3为coco数据集行人关键点分布图。

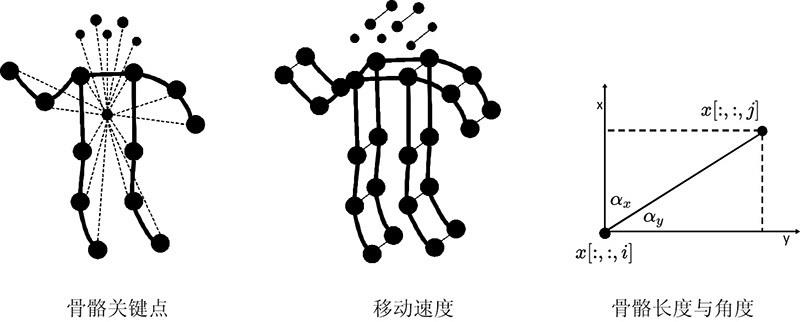

20.图4为骨骼关键点数据包含的三组特征。

21.图5为使用图卷积神经网络提取行人骨骼关键点特征流程示意图。

22.图6为对行人轮廓图进行归一化处理流程示意图。

23.图7为时间特征聚合注意力模块示意图。

具体实施方式

24.为了更加清楚地展示本发明的目的和技术方案,下面将结合具体的实施过程和附图,对本发明的具体实施方式和参数进行更加详细的描述。

25.一种基于骨骼和轮廓特征融合的步态识别方法,如图1所示,包含以下步骤。

26.步骤1,采用基于hrnet的姿态估计算法对视频进行处理,得到每帧图像中的行人骨骼关键点位置。

27.hrnet姿态估计算法,采用具有并行的多子网络结构的特征提取模型,处于最上层分支中的特征图一直保持着高分辨率;使用骨骼关键点的高斯热力图作为标签进行模型训练,网络最终便可生成关键点高斯热力图;最后通过寻找高斯热力图中的峰值点可确定行

人骨骼关键点位置。

28.所述使用骨骼关键点的高斯热力图作为标签是指,根据通过高斯函数在骨骼关键点生成热力图;其灰度可以公式表示为:i(x,y)=exp(-((x-xc)^2+(y-yc)^2)/(2*var^2)),其中,(x,y)表示热力图上一个像素点的位置,(xc,yc)表示关键点的位置,^2表示平方,var表示标准差,在本实施例中设定为3。

29.用灰度表示的骨骼关键点及其高斯热力图的示意图如图2所示。

30.不同的行人关键点数据集标注的行人关键点个数不同,如coco数据集行人关键点有17个,其分布如图3所示。

31.步骤2,使用骨骼关键点位置数据进行计算,生成关键点移动速度、骨骼长度与角度数据,位置、速度、长度与角度这三组特征的示意图如图4所示;其中,将骨骼视为关键点的连线。

32.步骤3,通过图卷积神经网络gcn对行人骨骼关键点数据进行特征提取,其流程如图5上方所示,包括:将骨骼关键点位置、速度、骨骼长度与角度这三组骨骼关键点数据,作为三个输入,分别顺序经过批正则化模块(batch normal)、初始化模块(initial block)、两个带注意力机制的图卷积神经网络(64*48的gcn、48*16的gcn),进行特征提取;然后在网络的中部进行融合,最后经过一条共享的主干网络,即两个带注意力机制的图卷积神经网络(48*64的gcn、64*128的gcn),生成最终的行人骨骼关键点特征图。

33.带注意力机制的图卷积神经网络(gcn)的构成如图5左下方所示。由一个空间图卷积(sgc) 模块、若干个时间维度卷积模块(tc)以及一个注意力机制模块(attention)堆叠而成。

34.步骤4,采用mask rcnn网络对原始视频中的每一帧进行特征提取,得到相应的行人轮廓图。

35.步骤5,对行人轮廓图进行归一化处理,剪除图像垂直方向和水平方向上多余的空白像素点,如图6所示。

36.若最终的图片分辨率为64*44,则先剪除图片中行人头顶上方和脚部下方的多余像素,并将图片缩放到高度44像素。

37.具体操作时,先在水平方向上对所有像素求和,得到第一个非零位置便是上临界点,最后一个非零位置便是下临界点,然后剪除上临界点之上的像素、下临界点以下的像素。

38.剪除垂直方向上的多余像素并放缩到合适的尺寸,以行人躯干中心点为基准,向左右两侧分别裁剪出32个像素点,最终得到输出图片分辨率为64*44。

39.具体操作时,先在垂直方向上对所有像求和,当求和的值等于图像中所有像素和一半时停止,此位置作为行人水平中心点位置,然后从此中心点分别向左右两侧扩展设定的像素个数,并剪除此区域外的像素点。

40.步骤6, 将归一化之后的行人轮廓数据,输入局部轮廓特征提取器进行特征提取,并采用时间特征聚合注意力模块进行特征压缩,得到最终的行人轮廓特征图。

41.局部轮廓特征提取器采用gaitpart 方法中的特征提取器部分。

42.时间特征聚合注意力模块的具体实现方式如图7所示,首先通过最大值函数max

(

·

)、均值函数mean(

·

)、中值函数median(

·

)三种基础函数对输入进行全局特征收集,然后在时间维度上进行复制并将三者拼接到一起;最后通过1*1的卷积进行通道压缩并生成注意力图。

43.基于注意力机制的时间聚合模块从整体上来看采用了残差结构,保持网络结构稳定性的同时提高了网络训练收敛速度。

44.步骤7,将行人骨骼关键点特征图和行人轮廓特征图进行拼接,再通过分离全连接层和局部注意力机制引导两者融合,生成最终的步态特征图。

45.步骤8,使用欧式距离,比对计算生成的步态特征与数据库中的步态特征,选取出距离最小的步态特征对应的行人,作为最终的识别结果。

46.如特征图的尺寸为20*128,则先该特征图拉成一个长度为2560的一维向量,然后再与数据库中所有的特征向量进行欧式距离计算和比对,选取距离最小的特征向量对应的行人作为最终结果。

47.最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其进行限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述实施例所记载的技术方案进行修改,或者对其中部分或者全部技术特征进行等同替换;或者修改各个步骤的使用顺序,而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的范围;本发明各种阈值及范围取值,也会因为装置的具体参数不同而有所改变。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1