基于深度学习的车载乐谱生成方法、装置及存储介质与流程

1.本发明涉及乐谱生成技术领域,尤其涉及一种基于深度学习的车载乐谱生成方法、装置及存储介质。

背景技术:

2.乐谱是一种表示乐曲旋律的基本元素,使用者可以通过印刷或书写在纸张上的乐谱对乐曲进行学习、演奏或传播等。随着科技的快速发展,可以通过技术来自动生成音乐乐谱。随着汽车的普及,汽车在行驶途中,驾驶员或乘客往往都希望听到自己喜欢的歌曲。但是,目前的乐谱生成方法无法结合车主用户的兴趣偏好以及行车数据,导致生成的乐谱与车主用户的相关性较弱,难以获得较好的用户体验。

技术实现要素:

3.本发明所要解决的技术问题在于,提供一种基于深度学习的车载乐谱生成方法、装置及存储介质,采用卷积神经网络根据用户驾驶的个性化数据以及车辆的行车数据生成车辆用户独有的车载乐谱,有效提升用户体验。

4.为了实现上述目的,本发明实施例提供了一种基于深度学习的车载乐谱生成方法,包括:

5.获取车辆的行车数据以及用户的视频数据、语音数据、操作数据;其中,所述行车数据包括速度数据、刹车数据和环境数据;

6.对所述行车数据、所述视频数据、所述语音数据和所述操作数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合;

7.采用卷积神经网络,根据所述视频及操作数据集合分析得到乐谱的曲风,根据所述速度数据集合分析得到乐谱的音阶集合,根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,根据所述语音及环境数据集合分析得到乐谱的音符集合;

8.根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱。

9.作为上述方案的改进,所述对所述行车数据、所述视频数据、所述语音数据和所述操作数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合,具体包括:

10.对所述行车数据、所述视频数据、所述语音数据和所述操作数据的时间进行标注;

11.对标注后的数据进行分类重组,得到与车载乐谱生成相关的视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合。

12.作为上述方案的改进,所述根据所述视频及操作数据集合分析得到乐谱的曲风,具体包括:

13.采用卷积神经网络对所述视频及操作数据集合进行分析,得到每一曲风的分数;

14.对所有曲风的分数进行排名,将排名最高的分数所对应的曲风作为乐谱的曲风。

15.作为上述方案的改进,所述根据所述速度数据集合分析得到乐谱的音阶集合,具体包括:

16.采用卷积神经网络对所述速度数据集合中的速度特征向量进行分析,并按照时间得出对应的音阶集合。

17.作为上述方案的改进,所述根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,具体包括:

18.采用卷积神经网络对所述刹车数据集合中的刹车特征向量进行分析,并按照时间得出对应的节拍及休止符集合。

19.作为上述方案的改进,所述根据所述语音及环境数据集合分析得到乐谱的音符集合,具体包括:

20.采用卷积神经网络对所述语音及环境数据集合中的语音特征向量和环境特征向量进行分析,并按照时间得出对应的音符集合;其中,所述音符包括全音符、二分音符、四分音符、八分音符、十六分音符以及三十二分音符。

21.作为上述方案的改进,所述根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱,具体包括:

22.根据所述音阶集合、所述节拍及休止符集合、所述音符集合以及所述行车数据的时间,生成乐谱集合;

23.若所述节拍及休止符集合中未出现休止符,则根据当前时间生成当前乐谱集合;

24.若所述节拍及休止符集合中出现休止符,则判断所述当前乐谱集合是否符合所述曲风;

25.若符合,则根据所述乐谱集合和所述曲风得到车载乐谱;若不符合,则根据下一时间的音阶集合、节拍及休止符集合和音符集合,得到乐谱集合,返回步骤若所述节拍及休止符集合中未出现休止符,则根据当前时间生成当前乐谱集合。

26.本发明实施例还提供了一种基于深度学习的车载乐谱生成装置,包括:

27.获取模块,用于获取车辆的行车数据以及用户的视频数据、语音数据、操作数据;其中,所述行车数据包括速度数据、刹车数据和环境数据;

28.处理模块,用于对所述行车数据、所述视频数据、所述语音数据和所述操作数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合;

29.分析模块,用于采用卷积神经网络,根据所述视频及操作数据集合分析得到乐谱的曲风,根据所述速度数据集合分析得到乐谱的音阶集合,根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,根据所述语音及环境数据集合分析得到乐谱的音符集合;

30.生成模块,用于根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱。

31.本发明实施例还提供了一种基于深度学习的车载乐谱生成装置,包括处理器、存储器以及存储在所述存储器中且被配置为由所述处理器执行的计算机程序,所述处理器执行所述计算机程序时实现上述任一项所述的基于深度学习的车载乐谱生成方法。

32.本发明实施例还提供了一种计算机可读存储介质,所述计算机可读存储介质包括存储的计算机程序,其中,在所述计算机程序运行时控制所述计算机可读存储介质所在设

备执行上述任一项所述的基于深度学习的车载乐谱生成方法。

33.相对于现有技术,本发明实施例提供的一种基于深度学习的车载乐谱生成方法、装置及存储介质的有益效果在于:通过获取车辆的行车数据以及用户的视频数据、语音数据、操作数据;其中,所述行车数据包括速度数据、刹车数据和环境数据;对所述行车数据、所述视频数据、所述语音数据和所述操作数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合;采用卷积神经网络,根据所述视频及操作数据集合分析得到乐谱的曲风,根据所述速度数据集合分析得到乐谱的音阶集合,根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,根据所述语音及环境数据集合分析得到乐谱的音符集合;根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱。本发明实施例采用卷积神经网络根据用户驾驶的个性化数据以及车辆的行车数据生成车辆用户独有的车载乐谱,有效提升用户体验。

附图说明

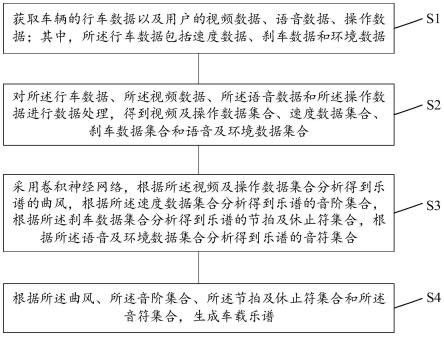

34.图1是本发明提供的一种基于深度学习的车载乐谱生成方法的一个优选实施例的流程示意图;

35.图2是本发明提供的一种基于深度学习的车载乐谱生成方法中硬件结构的示意图;

36.图3是本发明提供的一种基于深度学习的车载乐谱生成方法中卷积神经网络的结构示意图;

37.图4是本发明提供的一种基于深度学习的车载乐谱生成方法中乐谱生成的流程示意图;

38.图5是本发明提供的一种基于深度学习的车载乐谱生成方法的另一个优选实施例的流程示意图;

39.图6是本发明提供的一种基于深度学习的车载乐谱生成装置的一个优选实施例的结构示意图;

40.图7是本发明提供的一种基于深度学习的车载乐谱生成装置的另一个优选实施例的结构示意图。

具体实施方式

41.下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

42.请参阅图1,图1是本发明提供的一种基于深度学习的车载乐谱生成方法的一个优选实施例的流程示意图。所述基于深度学习的车载乐谱生成方法,包括:

43.s1,获取车辆的行车数据以及用户的视频数据、语音数据、操作数据;其中,所述行车数据包括速度数据、刹车数据和环境数据;

44.s2,对所述行车数据、所述视频数据、所述语音数据和所述操作数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合;

45.s3,采用卷积神经网络,根据所述视频及操作数据集合分析得到乐谱的曲风,根据所述速度数据集合分析得到乐谱的音阶集合,根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,根据所述语音及环境数据集合分析得到乐谱的音符集合;

46.s4,根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱。

47.具体的,请参阅图2,图2是本发明提供的一种基于深度学习的车载乐谱生成方法中硬件结构的示意图。本发明实施例的硬件结构包括摄像头、麦克风、车载中控屏、行车传感器、数据采集上传单元以及控制器。其中,摄像头:利用前装摄像头,通过蓝牙或线束连接到中央控制单元总线,可以在中央控制单元的控制下从不同的角度进行拍摄,采集用户的视频数据。

48.麦克风:利用前装或麦克风,通过蓝牙或线束连接到中央控制单元总线,可以在中央控制单元的控制下,采集用户的语音数据。

49.车载中控屏:利用前装中控屏,通过蓝牙或线束连接到中央控制单元总线,可以在中央控制单元的控制下,采集用户在娱乐与学习中的操作数据。

50.行车传感器:通过蓝牙或线束连接到中央控制单元总线,可以在中央控制单元的控制下,采集车辆的行车数据。其中,行车数据包括但不限于速度数据、刹车数据和环境数据。

51.数据采集上传单元:用于接收外设如摄像头、麦克风、车载中控屏、行车传感器的数据并将其上传至控制器。

52.控制器对从外设如摄像头、麦克风、车载中控屏、行车传感器获取的用户的视频数据、语音数据、操作数据以及车辆的行车数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合。采用卷积神经网络对上述数据集合进行分析与训练,根据视频及操作数据集合分析得到乐谱的曲风,根据速度数据集合分析得到乐谱的音阶集合,根据刹车数据集合分析得到乐谱的节拍及休止符集合,根据语音及环境数据集合分析得到乐谱的音符集合。根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱。

53.本发明实施例基于深度学习中的卷积神经网络,将外设如摄像头、麦克风、车载中控屏、行车传感器获取的用户驾驶的个性化数据以及车辆的行车数据进行分析与训练,可准确地判断用户的个性与行为喜好,进而生成车辆用户独有的车载乐谱,有效提升用户体验。

54.作为其中一个可选的实施例,所述s2,对所述行车数据、所述视频数据、所述语音数据和所述操作数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合,具体包括:

55.s201,对所述行车数据、所述视频数据、所述语音数据和所述操作数据的时间进行标注;

56.s202,对标注后的数据进行分类重组,得到与车载乐谱生成相关的视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合。

57.具体的,本发明实施例在用户上车点火启动后,摄像头开始识别用户,为后续数据采集上传及分析确定对应的用户做准备。外设如摄像头、麦克风、车载中控屏、行车传感器

在正常启动后开始采集用户的视频数据、语音数据、操作数据,行车过程中产生的时速、刹车、空调、经纬度等行车数据,数据按照时间t(默认10秒,可根据实际需要进行调整)进行汇总分批上传,每个采集到的数据都带有时间属性t的标注,数据按时间t1,t2...tn分批上传。对标注后的数据进行分类重组,得到与车载乐谱生成相关的视频及操作数据集合[a]、速度数据集合[b]、刹车数据集合[c]和语音及环境数据集合[d]。

[0058]

作为其中一个可选的实施例,所述根据所述视频及操作数据集合分析得到乐谱的曲风,具体包括:

[0059]

采用卷积神经网络对所述视频及操作数据集合进行分析,得到每一曲风的分数;

[0060]

对所有曲风的分数进行排名,将排名最高的分数所对应的曲风作为乐谱的曲风。

[0061]

具体的,本发明实施例中视频及操作数据集合的数据主要采集车主的表情数据,这部分数据主要用于乐谱的标签打分,将用户的喜怒哀乐表情转换为对应的愉快、激昂、忧伤、等维度的乐谱曲风。经卷积神经网络分析后,得到每一曲风的分数。对所有曲风的分数进行排名,将排名最高的分数所对应的曲风作为乐谱的曲风a。

[0062]

作为其中一个可选的实施例,所述根据所述速度数据集合分析得到乐谱的音阶集合,具体包括:

[0063]

采用卷积神经网络对所述速度数据集合中的速度特征向量进行分析,并按照时间得出对应的音阶集合。

[0064]

具体的,本发明实施例中速度数据集合的数据主要采集车辆的车速数据,这部分数据主要用于乐谱音阶的生成。速度特征向量经过卷积神经网络分析后将按时间得出对应的1、2、3、4、5、6、7音阶集合[b]。

[0065]

作为其中一个可选的实施例,所述根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,具体包括:

[0066]

采用卷积神经网络对所述刹车数据集合中的刹车特征向量进行分析,并按照时间得出对应的节拍及休止符集合。

[0067]

具体的,本发明实施例中刹车数据集合的数据主要用于乐谱的节拍和休止符的生成。经过卷积神经网络分析后得出的节拍和休止符集合[c]用于表示整个乐谱的节拍和休止符,跟行车的时间相对应于整个乐谱。

[0068]

作为其中一个可选的实施例,所述根据所述语音及环境数据集合分析得到乐谱的音符集合,具体包括:

[0069]

采用卷积神经网络对所述语音及环境数据集合中的语音特征向量和环境特征向量进行分析,并按照时间得出对应的音符集合;其中,所述音符包括全音符、二分音符、四分音符、八分音符、十六分音符以及三十二分音符。

[0070]

具体的,本发明实施例中语音及环境数据集合主要用于乐谱音符的生成,音符主要分为全音符、二分音符、四分音符、八分音符、十六分音符以及三十二分音符,经卷积神经网络分析后得出对应的音符集合[d]。

[0071]

请参阅图3,图3是本发明提供的一种基于深度学习的车载乐谱生成方法中卷积神经网络的结构示意图。本发明实施例将视频及操作数据集合[a]、速度数据集合[b]、刹车数据集合[c]和语音及环境数据集合[d]在嵌入层将一维的特征向量做一个维度转换的预处理(可以利用word2vec或者one-hot的方式),将其转化为二维的特征矩阵。然后将转化后的

二维特征矩阵放入到卷积层、池化层中进行特征提取。最后在全连接层中获得各个集合清洗后所对应的曲风a、音阶集合[b]、节拍和休止符集合[c]以及音符集合[d]。

[0072]

作为其中一个可选的实施例,所述s4,根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱,具体包括:

[0073]

根据所述音阶集合、所述节拍及休止符集合、所述音符集合以及所述行车数据的时间,生成乐谱集合;

[0074]

若所述节拍及休止符集合中未出现休止符,则根据当前时间生成当前乐谱集合;

[0075]

若所述节拍及休止符集合中出现休止符,则判断所述当前乐谱集合是否符合所述曲风;

[0076]

若符合,则根据所述乐谱集合和所述曲风得到车载乐谱;若不符合,则根据下一时间的音阶集合、节拍及休止符集合和音符集合,得到乐谱集合,返回步骤若所述节拍及休止符集合中未出现休止符,则根据当前时间生成当前乐谱集合。

[0077]

具体的,请参阅图4,图4是本发明提供的一种基于深度学习的车载乐谱生成方法中乐谱生成的流程示意图。本发明实施例根据音阶集合[b]、节拍及休止符集合[c]、音符集合[d]以及行车数据的时间t,生成乐谱集合yt=([b]t+[c]t+[d]t)。若节拍及休止符集合[c]中未出现休止符,则根据当前时间片段[i,j],默认间隔一分钟,生成当前乐谱集合y[i,j]。若节拍及休止符集合[c]中出现休止符,则判断当前乐谱集合y[i,j]是否符合曲风a。若符合,则根据乐谱集合yt和曲风a得到车载乐谱;若不符合,则根据下一时间的音阶集合、节拍及休止符集合和音符集合,得到乐谱集合,返回步骤若节拍及休止符集合中未出现休止符,则根据当前时间生成当前乐谱集合。

[0078]

请参阅图5,图5是本发明提供的一种基于深度学习的车载乐谱生成方法的另一个优选实施例的流程示意图。本发明实施例在用户上车点火启动后,摄像头开始识别用户,采集用户的视频数据。麦克风、车载中控屏、行车传感器在正常启动后开始采集用户的语音数据、操作数据,行车过程中产生的时速、刹车、空调、经纬度等行车数据,并通过数据采集上传单元上传至控制器。控制器在获取上述数据后,通过卷积神经网络对上述数据进行分析学习,得到乐谱的曲风、音阶集合、节拍及休止符集合和音符集合。最后根据曲风、音阶集合、节拍及休止符集合和音符集合,生成车载乐谱。本发明实施例采用卷积神经网络根据用户驾驶的个性化数据以及车辆的行车数据生成车辆用户独有的车载乐谱,有效提升用户体验。

[0079]

相应地,本发明还提供一种基于深度学习的车载乐谱生成装置,能够实现上述实施例中的基于深度学习的车载乐谱生成方法的所有流程。

[0080]

请参阅图6,图6是本发明提供的一种基于深度学习的车载乐谱生成装置的一个优选实施例的结构示意图。所述基于深度学习的车载乐谱生成装置,包括:

[0081]

获取模块601,用于获取车辆的行车数据以及用户的视频数据、语音数据、操作数据;其中,所述行车数据包括速度数据、刹车数据和环境数据;

[0082]

处理模块602,用于对所述行车数据、所述视频数据、所述语音数据和所述操作数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合;

[0083]

分析模块603,用于采用卷积神经网络,根据所述视频及操作数据集合分析得到乐

谱的曲风,根据所述速度数据集合分析得到乐谱的音阶集合,根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,根据所述语音及环境数据集合分析得到乐谱的音符集合;

[0084]

生成模块604,用于根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱。

[0085]

优选地,所述处理模块602具体用于:

[0086]

对所述行车数据、所述视频数据、所述语音数据和所述操作数据的时间进行标注;

[0087]

对标注后的数据进行分类重组,得到与车载乐谱生成相关的视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合。

[0088]

优选地,所述根据所述视频及操作数据集合分析得到乐谱的曲风,具体包括:

[0089]

采用卷积神经网络对所述视频及操作数据集合进行分析,得到每一曲风的分数;

[0090]

对所有曲风的分数进行排名,将排名最高的分数所对应的曲风作为乐谱的曲风。

[0091]

优选地,所述根据所述速度数据集合分析得到乐谱的音阶集合,具体包括:

[0092]

采用卷积神经网络对所述速度数据集合中的速度特征向量进行分析,并按照时间得出对应的音阶集合。

[0093]

优选地,所述根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,具体包括:

[0094]

采用卷积神经网络对所述刹车数据集合中的刹车特征向量进行分析,并按照时间得出对应的节拍及休止符集合。

[0095]

优选地,所述根据所述语音及环境数据集合分析得到乐谱的音符集合,具体包括:

[0096]

采用卷积神经网络对所述语音及环境数据集合中的语音特征向量和环境特征向量进行分析,并按照时间得出对应的音符集合;其中,所述音符包括全音符、二分音符、四分音符、八分音符、十六分音符以及三十二分音符。

[0097]

优选地,所述生成模块604具体用于:

[0098]

根据所述音阶集合、所述节拍及休止符集合、所述音符集合以及所述行车数据的时间,生成乐谱集合;

[0099]

若所述节拍及休止符集合中未出现休止符,则根据当前时间生成当前乐谱集合;

[0100]

若所述节拍及休止符集合中出现休止符,则判断所述当前乐谱集合是否符合所述曲风;

[0101]

若符合,则根据所述乐谱集合和所述曲风得到车载乐谱;若不符合,则根据下一时间的音阶集合、节拍及休止符集合和音符集合,得到乐谱集合,返回步骤若所述节拍及休止符集合中未出现休止符,则根据当前时间生成当前乐谱集合。

[0102]

在具体实施当中,本发明实施例提供的基于深度学习的车载乐谱生成装置的工作原理、控制流程及实现的技术效果,与上述实施例中的基于深度学习的车载乐谱生成方法对应相同,在此不再赘述。

[0103]

请参阅图7,图7是本发明提供的一种基于深度学习的车载乐谱生成装置的另一个优选实施例的结构示意图。所述基于深度学习的车载乐谱生成装置包括处理器701、存储器702以及存储在所述存储器702中且被配置为由所述处理器701执行的计算机程序,所述处理器701执行所述计算机程序时实现上述任一实施例所述的基于深度学习的车载乐谱生成方法。

[0104]

优选地,所述计算机程序可以被分割成一个或多个模块/单元(如计算机程序1、计算机程序2、

……

),所述一个或者多个模块/单元被存储在所述存储器702中,并由所述处理器701执行,以完成本发明。所述一个或多个模块/单元可以是能够完成特定功能的一系列计算机程序指令段,该指令段用于描述所述计算机程序在所述基于深度学习的车载乐谱生成装置中的执行过程。

[0105]

所述处理器701可以是中央处理单元(central processing unit,cpu),还可以是其他通用处理器、数字信号处理器(digital signal processor,dsp)、专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field-programmable gate array,fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等,通用处理器可以是微处理器,或者所述处理器701也可以是任何常规的处理器,所述处理器701是所述基于深度学习的车载乐谱生成装置的控制中心,利用各种接口和线路连接所述基于深度学习的车载乐谱生成装置的各个部分。

[0106]

所述存储器702主要包括程序存储区和数据存储区,其中,程序存储区可存储操作系统、至少一个功能所需的应用程序等,数据存储区可存储相关数据等。此外,所述存储器702可以是高速随机存取存储器,还可以是非易失性存储器,例如插接式硬盘,智能存储卡(smart media card,smc)、安全数字(secure digital,sd)卡和闪存卡(flash card)等,或所述存储器702也可以是其他易失性固态存储器件。

[0107]

需要说明的是,上述基于深度学习的车载乐谱生成装置可包括,但不仅限于,处理器、存储器,本领域技术人员可以理解,图7的结构示意图仅仅是上述基于深度学习的车载乐谱生成装置的示例,并不构成对上述基于深度学习的车载乐谱生成装置的限定,可以包括比图示更多或更少的部件,或者组合某些部件,或者不同的部件。

[0108]

本发明实施例还提供了一种计算机可读存储介质,所述计算机可读存储介质包括存储的计算机程序,其中,在所述计算机程序运行时控制所述计算机可读存储介质所在设备执行上述任一实施例所述的基于深度学习的车载乐谱生成方法。

[0109]

本发明实施例提供了一种基于深度学习的车载乐谱生成方法、装置及存储介质,通过获取车辆的行车数据以及用户的视频数据、语音数据、操作数据;其中,所述行车数据包括速度数据、刹车数据和环境数据;对所述行车数据、所述视频数据、所述语音数据和所述操作数据进行数据处理,得到视频及操作数据集合、速度数据集合、刹车数据集合和语音及环境数据集合;采用卷积神经网络,根据所述视频及操作数据集合分析得到乐谱的曲风,根据所述速度数据集合分析得到乐谱的音阶集合,根据所述刹车数据集合分析得到乐谱的节拍及休止符集合,根据所述语音及环境数据集合分析得到乐谱的音符集合;根据所述曲风、所述音阶集合、所述节拍及休止符集合和所述音符集合,生成车载乐谱。本发明实施例采用卷积神经网络根据用户驾驶的个性化数据以及车辆的行车数据生成车辆用户独有的车载乐谱,有效提升用户体验。

[0110]

需说明的是,以上所描述的系统实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。另外,本发明提供的系统实施例附图中,模块之间的连接关系表示它们之间具有通信连接,具体可以实现为一条或

多条通信总线或信号线。本领域普通技术人员在不付出创造性劳动的情况下,即可以理解并实施。

[0111]

以上所述是本发明的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明原理的前提下,还可以做出若干改进和润饰,这些改进和润饰也视为本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1