一种基于自然语言处理的语义识别方法与流程

本发明涉及语义识别,具体涉及一种基于自然语言处理的语义识别方法。

背景技术:

1、现有对自然语言进行语义识别的方案,包括两个部分,第一部分对语音信号进行去噪,第二部分对去噪语音信号进行语义识别。

2、在对自然语言进行语义识别时,由于语音信号的噪声较多,因此,通常采用小波变换,得到各小波系数,再采用合适的小波阈值筛选小波系数,从而剔除噪声部分,还原语音信号,实现对语音信号的滤波。滤除噪声的关键在于小波阈值,其设置过大,则语音信号中有效成分被滤除,语音失真,其设置过小,则噪声信号滤除效果差。

3、现有小波阈值包括软阈值和硬阈值,但无论软阈值和硬阈值均无法最大程度的保留语音信号中有效成分,存在滤波精度差的问题。

4、现有在对自然语言进行语义识别时,采用cnn-ctc模型对语音信号进行语音识别,cnn网络包括:多层卷积层和多层池化层,通过层层卷积和池化处理,从语音信号中提取深度特征,但是这种方式容易导致特征丢失,存在语义识别精度不高的问题,其中,cnn为卷积神经网络,ctc为分类器。

技术实现思路

1、针对现有技术中的上述不足,本发明提供的一种基于自然语言处理的语义识别方法解决了现有基于自然语言处理的语义识别方法存在语义识别精度不高的问题。

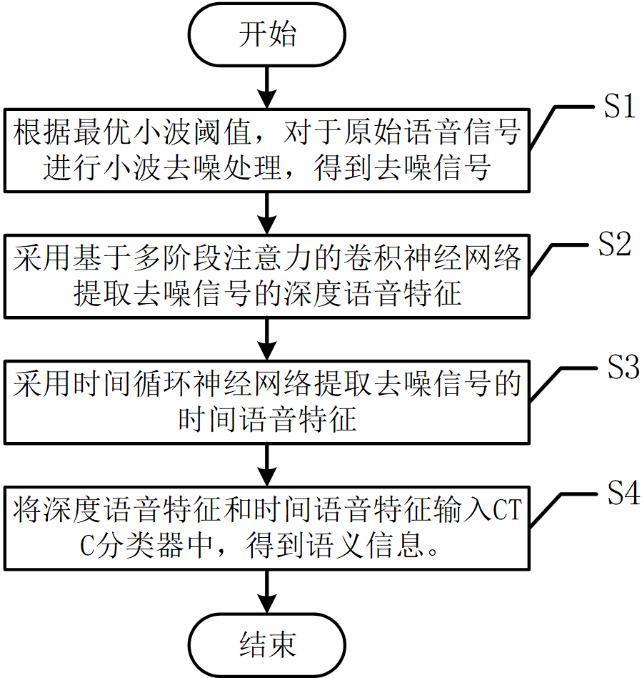

2、为了达到上述发明目的,本发明采用的技术方案为:一种基于自然语言处理的语义识别方法,包括以下步骤:

3、s1、根据最优小波阈值,对于原始语音信号进行小波去噪处理,得到去噪信号;

4、s2、采用基于多阶段注意力的卷积神经网络提取去噪信号的深度语音特征;

5、s3、采用时间循环神经网络提取去噪信号的时间语音特征;

6、s4、将深度语音特征和时间语音特征输入ctc分类器中,得到语义信息。

7、进一步地,所述s1包括以下分步骤:

8、s11、对原始语音信号进行小波变换,得到小波系数;

9、s12、从多个小波阈值中筛选出最优小波阈值;

10、s13、保留高于最优小波阈值的小波系数;

11、s14、对保留的小波系数进行小波反变换操作,得到去噪信号。

12、进一步地,所述s12包括以下分步骤:

13、s121、随机设置多个小波阈值;

14、s122、根据每个小波阈值,去除小于小波阈值的小波系数,得到保留的小波系数;

15、s123、对保留的小波系数进行小波反变换操作,得到去噪测试信号;

16、s124、提取去噪测试信号的特征值,得到测试信号特征向量;

17、s125、提取原始语音信号的特征值,得到原始信号特征向量;

18、s126、根据原始信号特征向量和测试信号特征向量,构建目标函数,在目标函数的目标值最大时对应的小波阈值为最优小波阈值。

19、上述进一步地方案的有益效果为:本发明中随机设置了多个小波系数,对每个小波系数均进行了步骤s122至步骤s125的处理,根据每个小波阈值分别对应的测试信号特征向量和原始信号特征向量,构建各自的目标函数,在目标函数的目标值最大时,该小波阈值为最优小波阈值。本发明中通过小波反变换,得到去噪测试信号,提取去噪测试信号和原始语音信号的特征值,构建特征向量,通过小波处理前后的特征的比较,表达原始语音信号的有效成分的保留程度。

20、进一步地,所述s124中测试信号特征向量中包括:第一特征值和第二特征值;所述s125中原始信号特征向量中包括:第一特征值和第二特征值;

21、所述测试信号特征向量和原始信号特征向量的第一特征值的表达式为:

22、,

23、其中,为第一特征值,为去噪测试信号或原始语音信号的长度,为去噪测试信号或原始语音信号的第个数据;

24、所述测试信号特征向量和原始信号特征向量的第二特征值的表达式为:

25、,

26、其中,为第二特征值。

27、上述进一步地方案的有益效果为:本发明中采用第一特征值体现各个数据与平均值的差距,从而表达整体的数据分布水平,通过三阶中心距与标准差的三次方的比例,体现整体数据的走势。

28、进一步地,所述s126中目标函数的表达式为:

29、,

30、其中,为目标值,为测试信号特征向量的第一特征值,为测试信号特征向量的第二特征值,为原始信号特征向量的第一特征值,为原始信号特征向量的第二特征值。

31、上述进一步地方案的有益效果为:本发明采用余弦相似度,计算原始信号特征向量和测试信号特征向量间的相似程度,相似程度最大时对应的小波阈值为最优小波阈值。

32、进一步地,所述卷积神经网络包括:第一卷积模块、第二卷积模块、第三卷积模块、第一注意力模块、第二注意力模块、第三注意力模块、乘法器m1、乘法器m2和乘法器m3;

33、所述第一卷积模块的输入端与第一注意力模块的输入端连接,并作为卷积神经网络的输入端;所述第一卷积模块的输出端与乘法器m1的第一输入端连接;所述乘法器m1的第二输入端与第一注意力模块的输出端连接,其输出端分别与第二卷积模块的输入端和第二注意力模块的输入端连接;所述乘法器m2的第一输入端与第二卷积模块的输出端连接,其第二输入端与第二注意力模块的输出端连接,其输出端分别与第三卷积模块的输入端和第三注意力模块的输入端连接;所述乘法器m3的第一输入端与第三卷积模块的输出端连接,其第二输入端与第三注意力模块的输出端连接,其输出端作为卷积神经网络的输出端。

34、上述进一步地方案的有益效果为:本发明中的卷积神经网络包括3个注意力模块,在每个卷积模块提取特征后,均会有一个注意力模块对卷积模块输出的特征施加注意力,增强特征的表达,本发明中通过多层施加注意力的方式,对特征自适应的施加注意力,避免特征丢失。

35、进一步地,所述第一注意力模块、第二注意力模块和第三注意力模块均包括:第一卷积层、第二卷积层、最大池化层、平均池化层、第二concat层和注意力输出层;

36、所述第一卷积层的输入端作为第一注意力模块、第二注意力模块或第三注意力模块的输入端,其输出端分别与最大池化层的输入端和平均池化层的输入端连接;所述第二concat层的输入端分别与最大池化层的输出端和平均池化层的输出端连接,其输出端与第二卷积层的输入端连接;所述注意力输出层的输入端与第二卷积层的输出端连接,其输出端作为第一注意力模块、第二注意力模块或第三注意力模块的输出端。

37、上述进一步地方案的有益效果为:本发明中通过最大池化层提取显著特征,通过平均池化层提取均值特征,根据均值特征和显著特征来体现应该对卷积模块输出特征施加的注意力。

38、进一步地,所述注意力输出层的表达式为:

39、,

40、其中,为注意力输出层的输出,为双曲正切激活函数,为第二卷积层输出的第个特征值,为第二卷积层输出的特征值的数量。

41、进一步地,所述卷积神经网络、时间循环神经网络和ctc分类器构成语义识别模型,在训练语义识别模型时,采用的损失函数为:

42、,

43、,

44、其中,为损失函数,为比例系数,为双曲正切激活函数,为第次训练的预测值,为第次训练的真实值,为第次训练的预测值,为第次训练的真实值,为当前训练次数的编号,为临近训练次数的编号,为临近训练总次数。

45、上述进一步地方案的有益效果为:本发明中损失函数包括两部分,一部分是当前次训练的损失情况,另一部分是临近次训练的损失情况,并设置了比例系数,比例系数的大小取决于当前次训练的情况,当前次训练得到真实值与预测值相差较大时,则重点考虑当前次训练情况,当前次训练得到真实值与预测值相差较小时,则重点考虑临近次训练的损失情况,使得在训练过程中,通过损失函数能使得语义识别模型中的参数达到较优的水平,提高语义识别的精度。

46、综上,本发明的有益效果为:本发明中通过最优小波阈值,对原始语音信号进行小波去噪处理,尽可能的保留原始语音信号中有效成分,采用多阶段注意力的卷积神经网络提取去噪信号的深度语音特征,通过多阶段注意力减少特征丢失,并增强特征表达,采用时间循环神经网络提取去噪信号的时间语音特征,ctc分类器处理时间循环神经网络和卷积神经网络提取的特征,本发明通过去噪过程最大程度保留有效语音信号,通过特征提取过程最大程度避免特征丢失,增强特征表达,提高语义识别精度。

- 还没有人留言评论。精彩留言会获得点赞!