一种基于雷视融合的路侧感知方法及系统与流程

本发明涉及路侧感知,尤其涉及一种基于雷视融合的路侧感知方法及系统。

背景技术:

1、在现有技术中,通常基于毫米波雷达和视频摄像机两类传感器的信息进行融合分析,主要分为以下几个步骤:1)传感器标定:对于传感器进行时间同步以及坐标系标定;2)单路数据融合:目前主要两种方法,一种是将毫米波雷达的数据投影到图像像素平面,基于iou(intersection over union,重叠度)、点距离等特征进行度量与匹配;一种是将毫米波雷达和视频摄像机的数据均投影到投影平面,基于点距离、运动轨迹等特征进行度量与匹配。

2、可见,现有技术中一般考虑两种感知设备所感知到的信息,从而对目标区域的感知不够全面,并且一般基于单个平面进行融合,从而导致不同设备间的数据匹配不够精准。

技术实现思路

1、为了解决上述技术问题,本发明实施例提出了一种基于雷视融合的路侧感知方法及系统,能够获取到高精度的路侧感知数据。

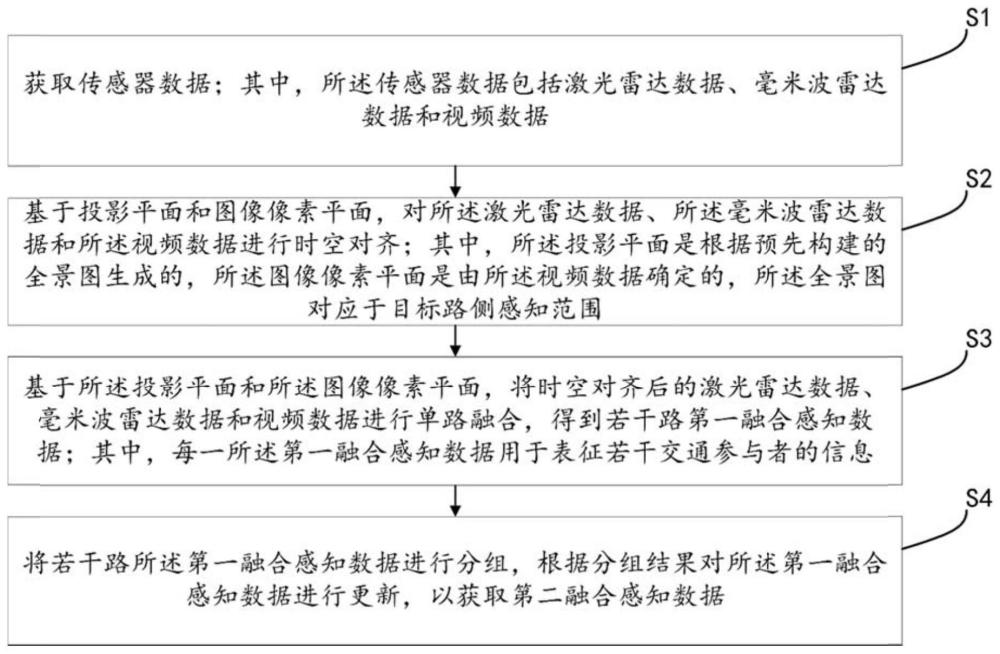

2、为了实现上述目的,本发明实施例提供了一种基于雷视融合的路侧感知方法,包括:

3、获取传感器数据;其中,所述传感器数据包括激光雷达数据、毫米波雷达数据和视频数据;

4、基于投影平面和图像像素平面,对所述激光雷达数据、所述毫米波雷达数据和所述视频数据进行时空对齐;其中,所述投影平面是根据预先构建的全景图生成的,所述图像像素平面是由所述视频数据确定的,所述全景图对应于目标路侧感知范围;

5、基于所述投影平面和所述图像像素平面,将时空对齐后的激光雷达数据、毫米波雷达数据和视频数据进行单路融合,得到若干路第一融合感知数据;其中,每一所述第一融合感知数据用于表征若干交通参与者的信息;

6、将若干路所述第一融合感知数据进行分组,根据分组结果对所述第一融合感知数据进行更新,以获取第二融合感知数据。

7、进一步的,所述激光雷达数据包括多个激光雷达中的每一个的第一单激光雷达数据,所述毫米波雷达数据包括多个毫米波雷达中的每一个的第一单毫米波雷达数据,所述视频数据包括多个摄像机中的每一个所拍摄到的第一视频帧图像;

8、所述多个激光雷达、所述多个毫米波雷达与所述多个摄像机按照预设的匹配关系组成若干路雷视组合,每一路雷视组合是由一激光雷达、一毫米波雷达与一摄像机组成,则所述若干路第一融合感知数据与所述若干路雷视组合一一对应;

9、所述图像像素平面包括与所述多个摄像机所拍摄到的多张第一视频帧图像一一对应的多个单图像像素平面;

10、则,所述基于投影平面和图像像素平面,对所述激光雷达数据、所述毫米波雷达数据和所述视频数据进行时空对齐,包括:

11、基于所述投影平面,分别对各所述第一单激光雷达数据进行第一时空对齐处理,得到多个第二单激光雷达数据;

12、基于所述投影平面,分别对各所述第一单毫米波雷达数据进行第二时空对齐处理,得到多个第二单毫米波雷达数据;

13、基于每一所述雷视组合、每一所述单图像像素平面和所述投影平面,对每一所述第二单激光雷达数据、每一所述第二单毫米波雷达数据和每一所述第一视频帧图像进行第三时空对齐处理,得到每一所述雷视组合对应的单路雷视数据。

14、进一步的,所述基于所述投影平面,分别对各所述第一单激光雷达数据进行第一时空对齐处理,得到多个第二单激光雷达数据,包括:

15、分别将各所述第一单激光雷达数据与所述投影平面进行空间对齐;

16、分别对空间对齐后的各所述第一单激光雷达数据进行网络时间协议校准;

17、对校准后的多个所述第一单激光雷达数据进行时间偏差调优,以获取多个第二单激光雷达数据;

18、所述基于所述投影平面,分别对各所述第一单毫米波雷达数据进行第二时空对齐处理,得到多个第二单毫米波雷达数据,包括:

19、分别将辅助激光雷达数据以及各所述第一单毫米波雷达数据,与所述投影平面进行空间对齐;

20、分别对空间对齐后的所述辅助激光雷达数据以及各所述第一单毫米波雷达数据,进行网络时间协议校准;

21、基于校准后的所述辅助激光雷达数据,对校准后的每一所述第一单毫米波雷达数据进行时间偏差调优,以获取多个第二单毫米波雷达数据中的每一个;

22、所述基于每一所述雷视组合、每一所述单图像像素平面和所述投影平面,对每一所述第二单激光雷达数据、每一所述第二单毫米波雷达数据和每一所述第一视频帧图像进行第三时空对齐处理,得到每一所述雷视组合对应的单路雷视数据,包括:

23、针对每一所述雷视组合,执行如下步骤:

24、基于所述单图像像素平面和所述投影平面,将所述第二单激光雷达数据与所述第一视频帧图像进行空间对齐,以及,将所述第二单毫米波雷达数据与所述第一视频帧图像进行空间对齐;

25、对空间对齐后的所述第二单激光雷达数据、所述第二单毫米波雷达数据和所述第一视频帧图像进行网络时间协议校准及时间偏差调优,以获取这一所述雷视组合对应的单路雷视数据。

26、进一步的,每一所述雷视组合对应的单路雷视数据包括第三单激光雷达数据、第三单毫米波雷达数据和第二视频帧图像;

27、则,所述基于所述投影平面和所述图像像素平面,将时空对齐后的激光雷达数据、毫米波雷达数据和视频数据进行单路融合,得到若干路第一融合感知数据,包括:

28、针对每一所述雷视组合对应的单路雷视数据,执行如下步骤以获取这一所述雷视组合对应的第一融合感知数据:

29、将所述第三单激光雷达数据和所述第三单毫米波雷达数据,均转换到所述第二视频帧图像所在的单图像像素平面,得到携带有雷达数据的第三视频帧图像;对所述第三视频帧图像进行检测,得到若干第一交通参与者位置信息;对通过时序分析进行校准后的所述若干第一交通参与者位置信息,进行相关性计算,得到第一距离矩阵;对所述第一距离矩阵进行匈牙利匹配得到图像平面匹配信息;其中,所述相关性计算包括位置相关性计算及特征相关性计算;

30、将所述第三单激光雷达数据、所述第三单毫米波雷达数据和所述第二视频帧图像,均转换到所述投影平面,并对转换到所述投影平面后得到的数据通过时序分析进行校准,得到投影数据;对所述投影数据进行所述相关性计算,得到第二距离矩阵;对所述第二距离矩阵进行匈牙利匹配得到投影平面匹配信息;其中,所述投影数据携带有若干第二交通参与者位置信息;

31、对所述图像平面匹配信息和所述投影平面匹配信息进行加权计算,得到最终匹配信息;

32、基于所述最终匹配信息、所述单图像像素平面和所述投影平面,计算获取若干轨迹队列成员信息;其中,所述若干轨迹队列成员信息组成所述第一融合感知数据。

33、进一步的,所述基于所述最终匹配信息、所述单图像像素平面和所述投影平面,计算获取若干轨迹队列成员信息,包括:

34、在所述单图像像素平面上,以校准后的所述若干第一交通参与者位置信息作为第一历史队列成员信息,根据所述最终匹配信息对所述第一历史队列成员信息进行所述相关性计算,得到第三距离矩阵;

35、在所述投影平面上,以校准后的所述若干第二交通参与者位置信息作为第二历史队列成员信息,根据所述最终匹配信息对所述第二历史队列成员信息进行所述相关性计算,得到第四距离矩阵;

36、基于所述第三距离矩阵和所述第四距离矩阵,进行轨迹配准得到轨迹配准结果;

37、根据所述轨迹配准结果分别对所述第一历史队列成员信息和所述第二历史队列成员信息进行更新。

38、进一步的,所述根据所述轨迹配准结果分别对所述第一历史队列成员信息和所述第二历史队列成员信息进行更新,包括:

39、在所述单图像像素平面上,根据所述轨迹配准结果,对所述第一历史队列成员信息中类型未确认的第一交通参与者位置信息进行类型更新;

40、根据所述类型更新的结果,在所述投影平面上对所述第二历史队列成员信息中的第二交通参与者位置信息的类型进行更新;

41、在所述投影平面上,根据所述轨迹配准结果,对所述第二历史队列成员信息中的第二交通参与者位置信息进行运动信息更新;

42、根据所述运动信息更新的结果,在所述单图像像素平面上对所述第一历史队列成员信息中的第一交通参与者位置信息的运动信息进行更新。

43、进一步的,所述将若干路所述第一融合感知数据进行分组,根据分组结果对所述第一融合感知数据进行更新,以获取第二融合感知数据,包括:

44、按照两路为一组的原则对若干路所述第一融合感知数据进行分组,得到n组数据组;其中,n为正整数;

45、针对每一组数据组,通过多维id匹配将两路所述第一融合感知数据进行融合,得到一路对应于这一组数据组的第二融合感知数据;

46、以n组数据组所对应的n路第二融合感知数据作为新的若干路所述第一融合感知数据,重复执行以上步骤,直至n小于等于1时得到最终的第二融合感知数据。

47、进一步的,所述针对每一组数据组,通过多维id匹配将两路所述第一融合感知数据进行融合,得到一路对应于这一组数据组的第二融合感知数据,包括:

48、针对每一组数据组中的两路所述第一融合感知数据,执行如下步骤:

49、针对每一所述第一融合感知数据,确定其包含的若干所述交通参与者的多维度id以及运动信息,以构建这一所述第一融合感知数据对应的信息集合;其中,所述多维度id包括所述交通参与者的全局id、激光雷达id、毫米波雷达id和摄像机id;

50、基于两路所述第一融合感知数据所对应的两个所述信息集合s1和s2,计算位置偏差矩阵、轨迹相似度矩阵和类型偏差矩阵,并对所述位置偏差矩阵、轨迹相似度矩阵和类型偏差矩阵进行加权计算,得到加权匹配矩阵;

51、对所述加权匹配矩阵进行匈牙利匹配,得到第一集合、第二集合和第三集合;其中,所述第一集合为s1和s2匹配的集合,所述第二集合为s1未匹配的集合,所述第三集合为s2未匹配的集合;

52、基于所述第一集合、所述第二集合和所述第三集合,对所述轨迹队列成员信息进行更新,以形成一路对应于这一组数据组的第二融合感知数据。

53、进一步的,所述基于所述第一集合、所述第二集合和所述第三集合,对所述轨迹队列成员信息进行更新,以形成一路对应于这一组数据组的第二融合感知数据,包括:

54、遍历所述轨迹队列成员信息中若干所述交通参与者的多维度id;

55、基于所述第一集合和遍历得到的多维度id,确定对所述轨迹队列成员信息执行的第一更新策略;

56、基于所述第二集合、所述第三集合和遍历得到的多维度id,确定对所述轨迹队列成员信息执行的第二更新策略;其中,

57、所述第二更新策略包括:若在遍历得到的多维度id以及所述第一集合中查找到在任一维度下id相同的所述交通参与者,则更新这一所述交通参与者的信息,否则新建这一所述交通参与者的信息;

58、所述第一更新策略包括以下至少一种:

59、若在遍历得到的多维度id以及所述第一集合中查找不到在任一维度下id相同的所述交通参与者,则新建这一所述交通参与者的信息;

60、若在遍历得到的多维度id以及所述第一集合中查找到id相同的所述交通参与者,则更新这一所述交通参与者的信息;

61、若在遍历得到的多维度id以及所述第一集合中查找到在多个维度下id相同的至少两个所述交通参与者,计算至少两个所述交通参与者的相似度,当所述相似度大于等于预设相似度阈值时合并至少两个所述交通参与者。

62、本发明实施例还提供了一种基于雷视融合的路侧感知系统,包括:

63、数据获取模块,用于获取传感器数据;其中,所述传感器数据包括激光雷达数据、毫米波雷达数据和视频数据;

64、时空对齐模块,用于基于投影平面和图像像素平面,对所述激光雷达数据、所述毫米波雷达数据和所述视频数据进行时空对齐;其中,所述投影平面是根据预先构建的全景图生成的,所述图像像素平面是由所述视频数据确定的,所述全景图对应于目标路侧感知范围;

65、单路融合感知模块,用于基于所述投影平面和所述图像像素平面,将时空对齐后的激光雷达数据、毫米波雷达数据和视频数据进行单路融合,得到若干路第一融合感知数据;其中,每一所述第一融合感知数据用于表征若干交通参与者的信息;

66、组分析模块,用于将若干路所述第一融合感知数据进行分组,根据分组结果对所述第一融合感知数据进行更新,以获取第二融合感知数据。

67、综上,本发明实施例具有以下有益效果:

68、第一,能够将激光雷达、毫米波雷达、视频摄像机三种传感器数据进行精准融合,从而充分利用不同传感器的优势,例如激光雷达近距离探测到的精准的3d轮廓,毫米波雷达远距离探测到的位置信息,摄像机数据携带有的外观特征(纹理、颜色等),进而极大地提高了感知范围与感知精度;

69、第二,基于双平面的融合感知,充分考虑非图像像素平面感知范围外的交通参与者情况,同时减少了视频摄像机感知的交通参与者转换到投影平面时,因2d转3d而造成的误差,从而提高交通参与者的匹配准确性;另外,充分利用不同平面的优势,例如在图像像素平面上充分利用细节特征进行分类、在投影平面上充分利用全局信息进行运动信息提取,从而极大地提高了感知精度;

70、第三,提出了基于组分析的多路传感器融合感知框架,并设计了基于多维id匹配方法,使得多路传感器融合感知结果合并形成全局信息,为全路段的交通参与者流量统计、运动轨迹估计、交通事件检测等任务提供精准的感知数据基础。

- 还没有人留言评论。精彩留言会获得点赞!