一种基于计算机视觉的机器人行动轨迹精度测试方法

本发明属于行动机器人测试及图像处理,提出了一种基于计算机视觉的机器人行动轨迹精度测试方法。

背景技术:

1、自主导航行动机器人技术目前在众多行业中应用广泛,尤其在智能制造领域,行动机器人技术在蓬勃发展。自主导航技术是行动机器人智能化中的核心技术,其精度的评估对自主导航技术的发展和机器人产品稳定性和可靠性有着重要意义。传统的机器人精度评估方法使用定点采样,人工位置测量的方式,工作量大且无法做到连续测量,并且测量结果需要频繁与机器人坐标系之间进行坐标转换,不便于连续大规模测量。部分测量使用激光跟踪仪等先进测量设备,可以实现高精度的连续测量,但是激光跟踪仪价格昂贵,且要求操作人员需要经过一定时间的培训才可上手操作,学习成本高,因此并不适合广泛推广。

技术实现思路

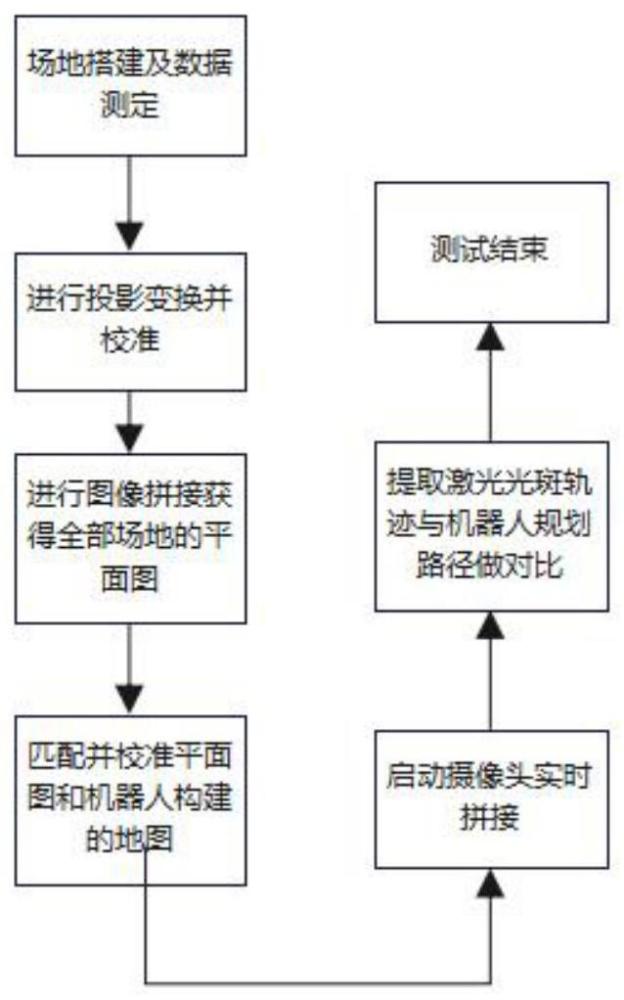

1、本发明的目的在于提供一种高效、方便的基于计算机视觉的机器人行动轨迹精度测试方法,通过计算机视觉技术,利用图像几何变化,图像拼接技术,重构测试场地地图;与机器人建图软件进行地图匹配,记录的实际运动轨迹与机器人的规划路径进行比对,评估其导航和运行精度。

2、为实现上述发明目的,采用如下技术解决方案:一种基于计算机视觉的机器人行动轨迹精度测试方法,其特征在于,包括如下步骤:

3、s1:在测试场地各边的正中心处架设摄像头,并将所有摄像头的架设位姿参数进行记录,将所有摄像头视频信号汇集于一台分析电脑中;

4、s2:根据各个摄像头的物理参数,对摄像头的图像进行几何校准,将因几何投影到摄像头产生投影变换的视频图像,使用投影变换的逆变化恢复为原始平面图像;

5、s3:将所有摄像头的图像经过几何变换后所得平面地图图片,使用图像拼接技术中sift算法进行拼接,并记录所有拼接校准参数c,得到测试场地完整的平面地图;

6、s4:将步骤s3得到的场地平面图与机器人构建的地图进行匹配和校准,获得校准参数;

7、s5:在机器人前端固定一激光笔,激光笔置于机器人前端并让激光束垂直照射到场地上;使用机器人路径规划软件规划当前场地的测试路径,并让机器人从起始位置开始根据指令自动行驶;记录规划路径和机器人在路径规划软件中的实际行驶路径;

8、s6:启动摄像头实时记录,并使用步骤s2,s3中的方法,将摄像头视频图像进行实时投影变换并拼接为当前地图,根据s3得到的拼接校准参数c,对当前实时拼接的图像进行匹配与校准,使得实时图像与s3中的场景平面地图保持一致;并通过亮度阈值的方式提取当前地图图像中的激光光斑,并全程记录光斑的留下的轨迹;

9、s7:机器人根据行进轨迹完成指令动作,将摄像头记录的轨迹信息,并根据s4中得到的校准数据进行补偿,匹配到真实场地的坐标中;

10、s8:将激光光斑的轨迹,与s5中路径规划软件的规划路径进行比较,评估摄像头记录的行驶路径与路径规划软件中的行驶路径。

11、进一步的,所述步骤s1中摄像头的架设位姿参数包括摄像头高度、角度、摄像头镜头参数。

12、进一步的,所述步骤s1中的摄像头数量根据需求设置,所述摄像头镜头参数包括但不限于清晰度、焦距、光圈、图像分辨率、高度、俯仰角、偏航角。

13、进一步的,所述步骤s2中对摄像头的图像进行几何校准的具体步骤为:

14、s21:假设m=t’*i,其中t’为投影变换逆矩阵,m为变换后的场景平面地图,i为摄像头拍摄的原始图像,t’可以使用s1中的已知摄像头位姿参数计算获得,形如(1)式:x和y为变换前的图像中的像素坐标,x′和y′为透视变换后的像素坐标,

15、

16、s22:假设摄像头变换前图像中某点的像素坐标为[u,v],变换后像素坐标系中的某一点坐标为[x,y];

17、s23:从摄像头拍摄的图像中分别寻找四个控制点,并假设这四个控制点的像素坐标分别为[u1,v1],[u2,v2],[u3,v3],[u4,v4],在平面地面坐标系中量测它们的坐标为[x1,y1],[x2,y2],[x3,y3],[x4,y4],获得四组同名点坐标;

18、s24:将上述(1)式的矩阵展开得到下述(2)式表达形式如下,

19、

20、s25:根据四组同名点坐标,调用opencv的函数接口,计算的透视变换矩阵;

21、s26:根据s1中得到的摄像头高度信息,对m进行缩放校准获取逆透视变换的平面地图图像。

22、进一步的,所述步骤s3中使用sift算法进行图像拼接的具体步骤为:

23、s31:对摄像头的焦距以及其他参数进行相同设置,且保证图像之间有20%以上的重叠区域;

24、s32:使用sift算法作为图像拼接的主要方法,当出现因为图像遮挡和背景混乱而产生的无匹配关系的关键点时,采用了lowe’s算法来进一步获取优秀匹配点;

25、s34:将两张图像转换为同一坐标下,使用findhomography函数获取图像1到图像2的投影映射矩阵,并使用warpperspective函数进行图像配准;

26、s35:创建拼接后的图,提前计算图的大小,将图1直接拷贝到配准图2上;

27、s36:使用加权融合进行图像融合,将图像的重叠区域的像素值按一定的权值相加合成新的图像,在重叠部分由前一幅图像慢慢过渡到第二幅图像,使图像拼接后显得更加自然平滑。

28、进一步的,所述步骤s3中的拼接校准参数包括但不限于摄像头内外参数、图像校准矩阵、特征点匹配算法、图像之间的偏移量。

29、进一步的,所述步骤s4中场地平面图与机器人构建的地图进行匹配和校准,具体步骤为:

30、s41:根据s2得到的使用图像拼接获得的场地平面图,以及机器人构建的二维栅格地图;

31、s42:当小车在测试场地的某一位置停留时,在场地平面图的坐标为:

32、s43:将s3机器人构建的地图的二维直角坐标为:

33、s44:获取场地平面图坐标系和机器人构建坐标系的几何变换关系为:pλ=rpt+t,计算出r和t完成坐标系的转换,其中r为旋转矩阵,t为平移矩阵。

34、进一步的,步骤s6中,通过亮度阈值的方式提取当前场景图像中的激光光斑,并纪录轨迹的具体过程是:根据激光光斑高亮度特征或色彩特征,设定一定的激光光斑亮度或色域范围,认定色值在阈值范围内的像素点为激光光斑像素点;将光斑像素点所在场景图像的位置经过换算得到实时运动坐标点;全程实时记录光斑在场景地图中留下的轨迹和轨迹坐标值;其中,轨迹坐标为机器人行动的真实坐标;用此坐标与机器人规划软件的路径坐标进行比对,基于此对比结果评估机器人的真实行动误差。轨迹坐标为机器人行动的真实坐标,用此坐标与机器人规划软件的路径坐标进行比对,基于此对比结果评估机器人的真实行动误差。

35、与现有技术相比,本发明的有益效果为:本发明的方法可以无缝跟踪机器人的全程运行轨迹,自动化程度高,测试全程不需要人工测量和标记,相较于传统测量方式精确度更高,测量成本低。

36、本发明主要利用计算机视觉技术,通过对测试场地的图像重构,并在机器人测试过程中实时追踪机器人的行进轨迹,通过全自动化过程将测试结果与机器人路径规划软件进行比较评估,实现高效的机器人导航精度测试。由于整个测试环境搭建只使用到常规的监控摄像头,因此测试环境的搭建成本低,便于技术推广。

- 还没有人留言评论。精彩留言会获得点赞!