一种人机协同系统多场景控制方法与流程

1.本发明涉及远程协控技术领域,更具体地说,它涉及一种人机协同系统多场景控制方法。

背景技术:

2.随着先进智能技术的发展,各类场合的巡视方式有了更多元化的选择,通过智能化辅助手段解决人工巡视存在的问题是较为普遍的应用方向。

3.目前,轮式或轨道机器人是较为普及的智能巡检设备,但由于技术条件限制,无法在各设备室或各楼层间通行,需要每间设备室均配置一台,造成大量资源浪费,且产生了大量额外的后期维护调试工作负担。上述问题使巡视机器人机动性强的优势无法完全发挥,为运维人员造成大量额外负担,亟需解决。

4.同时由于目前智能设备各系统间不能互相接入,数据不能共享等问题,让资源不能得到充分利用,需要考虑一台智能设备可参与多种场景应用的方式以此提高智能设备的经济效益和社会效益,因此研发一套可供多台智能设备接入的系统以及可以覆盖区域内多场景应用的智能设备迫在眉睫。

技术实现要素:

5.针对现有技术存在的不足,本发明的目的在于提供一种人机协同系统多场景控制方法。

6.为实现上述目的,本发明提供了如下技术方案:一种人机协同系统多场景控制方法,包括以下步骤:s1、选定场景模式阶段,开机点击进入系统面板,于系统面板上选择场景模式,场景模式包括远程协控模式、自主巡航模式和辅助跟随模式;s2、选定工作模块阶段,点击进入任一场景模式后,选定需要操作以及控制的工作模块,根据最终所选定的工作模块完成各个工作模块之间的通信连接,工作模块通信连接完成后绑定场景模式,完成工作任务,工作模块包括成像模块、控制模块和执行模块;s3、场景模式工作阶段,当选择远程协控模式后,其控制方法为,根据执行模块中的视频获取单元实时采集执行模块周边环境的视频数据,视频数据通过通信单元发送至成像模块,由成像模块的成像单元将视频数据投射至用户视觉界面,用户可根据成像模块上的动作传感完成视频数据的画面调整和参数选择,根据控制模块中的各个传感器单元完成执行模块的动作数据获取,动作数据通过通信单元发送至执行模块,由执行模块上的执行电机完成动作数据的实现,当选择辅助跟随模式后,其控制方法为,执行模块和成像模块通过定位单元完成位置绑定,当用户佩戴成像模块后,执行模块由于位置绑定将开启跟随模式,执行模块在与成像模块保持一定距离的同时合理避障,根据成像模块的视频获取单元实时采集用户实时视觉区域,识别视觉区域内的设备,同时采集视觉区域内的视频数据,视频数据和识别数据通过通信单元发送至执行模块,执行模块通过调整方向将执行模块的视角调至与视频数据同一视

角,并根据识别数据调用执行模块上的各类传感器完成识别设备的扫描传感,得到数字化的传感器数据,传感器数据通过通信单元发送至成像模块,成像模块通过内置算法将上述数据转化成可视化图像投射至用户视觉界面,当选择自主巡航模式后,其控制方法为,执行模块根据预置路径完成线路巡检,并通过调用执行模块上的各类传感器完成巡检线路上的设备扫描,完成巡检任务。

7.本发明进一步设置为:成像头盔包括头盔框架、头盔成像屏、头盔陀螺仪、头盔捕捉摄像头、头盔投屏装置、头盔通信装置和头盔控制芯片,头盔成像屏、头盔陀螺仪、头盔捕捉摄像头、头盔投屏装置、头盔通信装置和头盔控制芯片设置于头盔框架上。

8.本发明进一步设置为:控制模块包括控制魔方和控制陀螺,控制魔方包括壳体和设置于壳体内的重力感应装置,壳体上设置有压力传感器、位移传感器和魔方通信单元,控制陀螺包括空心球壳、设置于空心球壳内的悬浮球和用于填充空心球壳的球壳介质,球壳介质包覆于悬浮球外,空心球壳上设置有复位传感器和速度传感器。

9.本发明进一步设置为:执行模块包括机器狗和无人机,机器狗包括机器狗本体、机器狗控制芯片、机器狗通信模块和机器狗摄像头,机器狗摄像头设置于机器狗本体周侧,机器狗控制芯片和机器狗通信模块设置于机器狗本体内部形成的腔室内,无人机包括无人机本体、无人机控制芯片、无人机通信模块和无人机摄像头,无人机摄像头设置于无人机本体周侧,无人机控制芯片和无人机通信模块设置于无人机本体内部形成的腔室内。

10.本发明进一步设置为:场景模式选定为远程协控模式时,成像头盔、控制魔方与机器狗配合控制方法包括以下步骤,步骤s40,信息采集阶段,通过机器狗摄像头实时采集周边环境的视频数据;步骤s50,视频数据接收与传送阶段,机器狗摄像头采集的视频数据传输至成像头盔后,通过头盔投屏装置进行投射,用户通过成像头盔观测机器狗正前方的环境信息,当用户头戴成像头盔进行转动时,通过成像头盔上的头盔陀螺仪获取人体头部转动角度,将转动角度通过通信单元传送至机器狗控制芯片上,由机器狗控制芯片控制机器狗头部转动,同步人体头部的转动角度,以此来完成视频画面的旋转和调整;步骤s60,控制魔方控制机器狗阶段,通过控制魔方上设置的压力传感器获取手指施压的压力值,压力值与机器狗速度成正比,通过位移传感器获取控制魔方与之接触平面上的位移方向与位移距离,位移方向与位移距离与机器狗的位移方向与位移距离成正比,通过触控传感器获取手指的触控动作,触控动作用于触发机器狗执行特定动作。

11.本发明进一步设置为:场景模式选定为远程协控模式时,成像头盔、控制陀螺与机器狗配合控制方法包括以下步骤,步骤s41,信息采集阶段,此步骤与步骤s40相同;步骤s51,视频数据接收与传送阶段,此步骤与步骤s50相同;步骤s61,控制陀螺控制机器狗阶段,通过设置于控制陀螺上的复位传感器获取手指按压信息,确定空间坐标系,并以此空间坐标系为起始原点,通过悬浮球以及其上的加速度传感器或压力传感器获取控制陀螺的运动轨迹,由运动轨迹计算得出在此时的空间坐标系下控制陀螺中心相对于原点的空间位置坐标,通过速度传感器获取手指按压的压力值以及手指的滑动方向,压力值与机器狗的速度成正比,机器狗的运动方向于手指滑动方向相同;

本发明进一步设置为:场景模式选定为远程协控模式时,成像头盔、控制魔方与无人机配合控制方法包括以下步骤,步骤s42,信息采集阶段,通过无人机摄像头实时采集周边环境的视频数据;步骤s52,视频数据接收与传送阶段,无人机摄像头采集到的视频数据通过通信单元发送至成像头盔,由头盔投屏装置将视频数据投射至用户视觉界面,根据控制魔方中的各个传感器单元完成控制魔方的动作数据获取,动作数据通过通信单元发送至无人机,由无人机上的执行电机完成动作数据的实现;步骤s62,控制魔方控制无人机阶段,通过设置于控制魔方上的压力传感器获取手指按压的压力值,压力值与无人机速度成正比,通过位移传感器获取控制魔方与之接触平面上的位移方向与位移距离,位移方向与位移距离与无人机的位移方向与位移距离成正比,通过触控传感器获取手指的触控动作,触控动作用于触发无人机执行特定动作。

12.本发明进一步设置为:场景模式选定为远程协控模式时,成像头盔、控制陀螺与无人机配合控制方法包括以下步骤,步骤s43,信息采集阶段,此步骤与s42相同;步骤s53,视频数据接收与传送阶段,此步骤与s52相同;步骤s63,控制陀螺控制无人机阶段,通过设置于控制陀螺上的复位传感器获取手指按压信息,以此按压时刻控制陀螺中心的空间位置坐标为原点建立空间坐标系,通过悬浮球以及其上的加速度传感器或压力传感器获取用户运动轨迹,通过联系用户运动轨迹,延此轨迹的运动距离与方向控制无人机运动方向,通过速度传感器获取手指按压的压力值,压力值与无人机速度成正比。

13.本发明进一步设置为:场景模式选定为辅助跟随模式时,成像头盔与无人机或机器狗配合控制方法包括以下步骤,步骤s44,信息采集阶段,通过无人机或机器狗上设置的摄像头实时采集无人机周边环境的视频数据;步骤s45,视频数据接收与传送阶段,视频数据通过通信单元发送至成像头盔,由成像头盔的头盔投屏装置将视频数据投射至用户视觉界面,用户可根据成像头盔上的头盔捕捉摄像头完成视频数据的画面调整和参数选择,根据成像头盔上的头盔捕捉摄像头完成用户在头盔成像屏前控制动作数据的捕获,动作数据通过通信单元发送至无人机或机器狗,由无人机或机器狗上的执行电机完成动作数据的实现。

14.通过采用上述技术方案,在系统面板处可选择所需的模式场景,方便快捷以及目标明确,在下级子菜单可选择不同场景模式所对应需要控制执行的模块单元,针对需要控制的模块单元,此系统具有对应的控制方法,远程协控模式的控制方法为,通过执行模块获取视频数据且传送至成像模块,成像模块通过控制模块控制执行模块进行工作,此方法快捷有效,目的性高,通讯反应迅速,可适应各种实际情况且可完成复杂的工作任务,辅助跟随模式的控制方法为,执行模块和成像模块绑定后,通过成型模块根据人体动作直接控制执行模块,此模式较远程协控模式具有较高的适应性,自主巡航模式的控制方法为,通过控制模块自主完成工作任务,此模式工作自由度较高,适用于夜间无人监控时的巡检任务。

附图说明

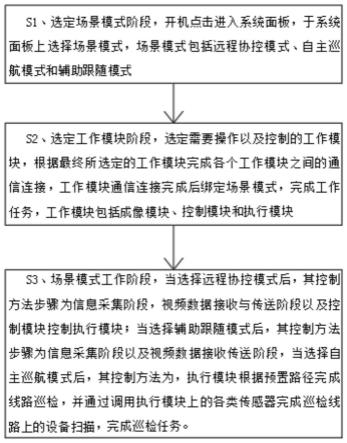

15.图1为本发明一种人机协同系统多场景控制方法的流程图。

具体实施方式

16.参照图1对本发明一种人机协同系统多场景控制方法实施例做进一步说明。

17.为了易于说明,实施例中使用了诸如“上”、“下”、“左”、“右”等空间相对术语,用于说明图中示出的一个元件或特征相对于另一个元件或特征的关系。应该理解的是,除了图中示出的方位之外,空间术语意在于包括装置在使用或操作中的不同方位。例如,如果图中的装置被倒置,被叙述为位于其他元件或特征“下”的元件将定位在其他元件或特征“上”。因此,示例性术语“下”可以包含上和下方位两者。装置可以以其他方式定位(旋转90度或位于其他方位),这里所用的空间相对说明可相应地解释。

18.而且,诸如“第一”和“第二”等之类的关系术语仅仅用来将一个与另一个具有相同名称的部件区分开来,而不一定要求或者暗示这些部件之间存在任何这种实际的关系或者顺序。

19.成像头盔包括头盔框架、头盔成像屏、头盔陀螺仪、头盔捕捉摄像头、头盔投屏装置、头盔通信装置和头盔控制芯片,其中头盔成像屏、头盔陀螺仪、头盔捕捉摄像头、头盔投屏装置、头盔通信装置和头盔控制芯片均设置于头盔框架上,捕捉摄像头位于头盔框架的前侧,用于捕捉头盔前侧人体手部影像,头盔成像屏、头盔投屏装置位于头盔框架的前侧,用于捕捉人体手部动作且用于成像显示,头盔陀螺仪用于同步头部动作,当人体头部旋转时,头盔陀螺仪可检测人体头部转动角度,并将其转化成定量动作数据,头盔控制芯片将实现成像头盔内部数据的通信、计算、控制,头盔通信装置将实现成像头盔与执行模块的数据互联,头盔通信装置将头部定量动作数据传送至执行模块处,由安装在执行模块上的摄像头电机控制执行模块的摄像头转动,从而实现执行模块的摄像头于头盔捕捉摄像头方向的同步,同时头盔通信装置将接收到的执行模块的摄像头上的画面传送至投屏装置,由投屏装置对接收到的画面在成像屏上进行成像。

20.控制魔方包括壳体和设置于壳体内的重力感应装置,重力感应装置包括主体部和副体部,主体部和副体部通过磁力完成非接触连接,副体部用于根据重力线完成与主体部的相对位置调整,控制魔方设置为一个正十二面体,每一个平面内设置有传感器,通过不同的平面上设置的传感器接收到人手不同的动作,完成对终端不同的控制,通过将传感器所获取的数据进行远程通信传输完成对终端的控制,控制魔方顶面设置有触控传感器,延顶面左右两侧设置有两个压力传感器,控制魔方底面设置有位移传感器,顶面内壁上设置有数据处理通信单元,压力传感器用于控制执行模块运动速度的大小,位移传感器用于控制执行模块在水平面上的运动方向,通过位移传感器所感知到的该平面相对于原点的坐标完成机器狗或无人机的方向控制,触控传感器用于控制执行模块在水平面之外的运动,重力感应装置的材料设置为与控制魔方的平面框架材料能生成磁力的材料,重力感应装置悬浮放置于控制魔方的腔体中心,副体部上固定设置有信号发射单元,控制魔方的平面框架的十二个平面内表面上均设置有信号接收器,信号发射单元与信号接收器建立信号连接,副体部根据控制魔方的重力线完成与主体部的相对位置的调整,副体部的重心与主体部的重心的连线始终与重力线重合,控制魔方根据接收到信号发射单元所发信号的平面上所设定

的模式或方向完成对终端的控制,由数据处理通信单元将所选择的终端执行模式或运动方向终端发送。

21.控制陀螺包括空心球壳、设置于空心球壳内的悬浮球或重力感应装置和用于填充空心球壳的球壳介质,空心球壳内设置有数据处理通信单元,球壳介质包覆于悬浮球外,悬浮球用于通过自身处于球壳介质内时的受力关系及运动关系计算控制陀螺的运动情况,球壳介质包覆于重力感应装置外,重力感应装置用于将自身的位移信息传输至数据处理通信单元,空心球壳与悬浮球设置方式具有以下两种方式,第一种方式为,空心球壳的材料设置为磁性材料,例如可被磁化的金属以及磁铁等,球壳介质为气体介质,悬浮球的材料为与空心球壳的材料能生成磁力的材料,悬浮球悬浮放置于空心球壳的腔体中心,通过此种配合方式,悬浮球通过与空心球壳产生磁力作用,即可将悬浮球固定设置于球壳介质中部,由于球体为中心对称立体结构,所以可保证在控制陀螺静置时,悬浮球所述各个方向磁力相同,即可保证恒处于球壳介质的中央,第二种方式为,空心球壳的材料设置为防渗透材料,球壳介质为液体介质,悬浮球在球壳介质中心处悬浮,安装悬浮球时,悬浮球周侧设置有用于固定悬浮球位置的软杆,软杆与空心球壳固定连接,用于对悬浮物进行位置限位,然后向其内部注入液体介质,使得悬浮球漂浮于液体介质中部,当人员移动控制陀螺时,悬浮球受力发生位置偏移,通过加速度传感器获取悬浮球在球壳介质中的受力关系及运动关系计算控制陀螺的运动情况,并以此运动关系控制机器狗、无人机运动,重力感应装置包括主体部和副体部,主体部与副体部通过磁力完成非接触连接,副体部上设置有信号发射单元,空心球壳的内表面上设置有信号接收器,信号发射单元与信号接收器建立信号连接,副体部根据控制陀螺的重力线完成与主体部的相对位置的调整,副体部的重心与主体部的重心的连线始终与重力线重合,控制陀螺根据接收到信号发射单元所发信号的接收器布置方位确定对应方向并完成对终端运动方向的控制,由数据处理通信单元将所确定的运动方向发送至机器狗、无人机完成对应方向的执行,重力感应装置设置于球壳介质中心处,主体部与副体部非接触连接同时位置相对固定,并且具有各自的运动状态,当主体部与副体部因人员移动控制陀螺发生位置偏移时,设置于副体部上的信号发射单元将位移信号传送至设置于空心球壳表面的信号接收器端,信号接收器作为中转设备将此信号传送至机器狗、无人机,控制机器狗、无人机完成指令动作。

22.机器狗包括机器狗本体、机器狗控制芯片、机器狗通信装置和机器狗摄像头,其中机器狗控制芯片、机器狗通信装备和机器狗摄像设置于机器狗本体上,机器狗摄像头设置为多个,前端摄像头设置在机器狗本体的头部,其余机器狗摄像头均匀分布在机器狗本体的两侧和尾部,结合前端摄像头实现机器狗所处环境的视频获取,机器狗摄像头可完成全景图像的采集获取,机器狗控制芯片、机器狗通信装置位于机器狗本体外壳所包裹的腔体内,机器狗控制芯片用于进行复杂运动的计算和肢体控制,机器狗通信装置用于与成像模块和控制模块进行通信联络和数据传输,机器狗本体的主体上可根据特定需要装配传感器,与各类传感器进行模块组合实现特定场景应用,传感器类型可包括电磁传感器、红外测温传感器、红外距离传感器、视频传感器、雷达传感器、声波传感器、三维景深传感器等,机器狗本体的主体上可根据特定需要装配机械设备,与各类机械设备进行模块组合实现特定场景应用,机械设备类型可包括操作机械臂、感知机械臂、清洗机械臂等,机器狗本体的尾部可装设机械尾,该机械尾在机器狗运动过程中处于折叠收紧状态,在需要机器狗进行切

断电源等操作时可伸长扩展成机械手完成相关操作。

23.无人机包括无人机本体、无人机控制芯片、无人机通信装置和无人机摄像头,无人机控制芯片、无人机通信装置和无人机摄像头设置于无人机本体上,无人机摄像头设置为多个,前部摄像头设置在无人机本体的头部,其余无人机摄像头均匀分布在无人机本体的两侧和尾部,结合前部摄像头实现无人机所处环境的视频获取,底部摄像头设置在无人机本体的底部,用于获取无人机下方视频画面,及计算对应高度;无人机控制芯片、无人机通信装置位于无人机本体外壳所包裹的腔体内,无人机控制芯片用于进行复杂运动的计算和叶片转速的控制,无人机通信装置用于与成像模块和控制模块进行通信联络和数据传输,无人机本体的主体上可根据特定需要装配传感器,与各类传感器进行模块组合实现特定场景应用,传感器类型可包括电磁传感器、红外测温传感器、红外距离传感器、视频传感器、雷达传感器、声波传感器、三维景深传感器等,无人机本体的主体上可根据特定需要装配机械设备,与各类机械设备进行模块组合实现特定场景应用,机械设备类型可包括操作机械臂、感知机械臂、清洗机械臂等。

24.一种人机协同系统多场景控制方法,包括以 下步骤:s1、选定场景模式阶段,开机点击进入系统面板,于系统面板上选择场景模式,场景模式包括远程协控模式、自主巡航模式和辅助跟随模式;s2、选定工作模块阶段,点击进入任一场景模式后,选定需要操作以及控制的工作模块,根据最终所选定的工作模块完成各个工作模块之间的通信连接,工作模块通信连接完成后绑定场景模式,完成工作任务,工作模块包括成像模块、控制模块和执行模块;s3、场景模式工作阶段,当选择远程协控模式后,其控制方法为,根据执行模块中的视频获取单元实时采集执行模块周边环境的视频数据,视频数据通过通信单元发送至成像模块,由成像模块的成像单元将视频数据投射至用户视觉界面,用户可根据成像模块上的动作传感完成视频数据的画面调整和参数选择,根据控制模块中的各个传感器单元完成执行模块的动作数据获取,动作数据通过通信单元发送至执行模块,由执行模块上的执行电机完成动作数据的实现,当选择辅助跟随模式后,其控制方法为,执行模块和成像模块通过定位单元完成位置绑定,当用户佩戴成像模块后,执行模块由于位置绑定将开启跟随模式,执行模块在与成像模块保持一定距离的同时合理避障,根据成像模块的视频获取单元实时采集用户实时视觉区域,识别视觉区域内的设备,同时采集视觉区域内的视频数据,视频数据和识别数据通过通信单元发送至执行模块,执行模块通过调整方向将执行模块的视角调至与视频数据同一视角,并根据识别数据调用执行模块上的各类传感器完成识别设备的扫描传感,得到数字化的传感器数据,传感器数据通过通信单元发送至成像模块,成像模块通过内置算法将上述数据转化成可视化图像投射至用户视觉界面,当选择自主巡航模式后,其控制方法为,执行模块根据预置路径完成线路巡检,并通过调用执行模块上的各类传感器完成巡检线路上的设备扫描,完成巡检任务。

25.场景模式选定为远程协控模式时,成像头盔、控制魔方与机器狗配合控制方法包括以下步骤,步骤s40,信息采集阶段,通过机器狗摄像头实时采集周边环境的视频数据;步骤s50,视频数据接收与传送阶段,机器狗摄像头采集的视频数据传输至成像头盔后,通过头盔投屏装置进行投射,用户通过成像头盔观测机器狗正前方的环境信息,当用

户头戴成像头盔进行转动时,通过成像头盔上的头盔陀螺仪获取人体头部转动角度,将转动角度通过通信单元传送至机器狗控制芯片上,由机器狗控制芯片控制机器狗头部转动,同步人体头部的转动角度,以此来完成视频画面的旋转和调整;步骤s60,控制魔方控制机器狗阶段,通过控制魔方上设置的压力传感器获取手指施压的压力值,压力值与机器狗速度成正比,通过位移传感器获取控制魔方与之接触平面上的位移方向与位移距离,位移方向与位移距离与机器狗的位移方向与位移距离成正比,通过触控传感器获取手指的触控动作,触控动作用于触发机器狗执行特定动作。

26.场景模式选定为远程协控模式时,成像头盔、控制陀螺与机器狗配合控制方法包括以下步骤,步骤s41,信息采集阶段,此步骤与步骤s40相同;步骤s51,视频数据接收与传送阶段,此步骤与步骤s50相同;步骤s61,控制陀螺控制机器狗阶段,通过设置于控制陀螺上的复位传感器获取手指按压信息,确定空间坐标系,并以此空间坐标系为起始原点,通过悬浮球以及其上的加速度传感器或压力传感器获取控制陀螺的运动轨迹,由运动轨迹计算得出在此时的空间坐标系下控制陀螺中心相对于原点的空间位置坐标,通过速度传感器获取手指按压的压力值以及手指的滑动方向,压力值与机器狗的速度成正比,机器狗的运动方向于手指滑动方向相同;场景模式选定为远程协控模式时,成像头盔、控制魔方与无人机配合控制方法包括以下步骤,步骤s42,信息采集阶段,通过无人机摄像头实时采集周边环境的视频数据;步骤s52,视频数据接收与传送阶段,无人机摄像头采集到的视频数据通过通信单元发送至成像头盔,由头盔投屏装置将视频数据投射至用户视觉界面,根据控制魔方中的各个传感器单元完成控制魔方的动作数据获取,动作数据通过通信单元发送至无人机,由无人机上的执行电机完成动作数据的实现;步骤s62,控制魔方控制无人机阶段,通过设置于控制魔方上的压力传感器获取手指按压的压力值,压力值与无人机速度成正比,通过位移传感器获取控制魔方与之接触平面上的位移方向与位移距离,位移方向与位移距离与无人机的位移方向与位移距离成正比,通过触控传感器获取手指的触控动作,触控动作用于触发无人机执行特定动作。

27.场景模式选定为远程协控模式时,成像头盔、控制陀螺与无人机配合控制方法包括以下步骤,步骤s43,信息采集阶段,此步骤与s42相同;步骤s53,视频数据接收与传送阶段,此步骤与s52相同;步骤s63,控制陀螺控制无人机阶段,通过设置于控制陀螺上的复位传感器获取手指按压信息,以此按压时刻控制陀螺中心的空间位置坐标为原点建立空间坐标系,通过悬浮球以及其上的加速度传感器或压力传感器获取用户运动轨迹,通过联系用户运动轨迹,延此轨迹的运动距离与方向控制无人机运动方向,通过速度传感器获取手指按压的压力值,压力值与无人机速度成正比。

28.场景模式选定为辅助跟随模式时,成像头盔与无人机或机器狗配合控制方法包括以下步骤,

步骤s44,信息采集阶段,通过无人机或机器狗上设置的摄像头实时采集无人机周边环境的视频数据;步骤s45,视频数据接收与传送阶段,视频数据通过通信单元发送至成像头盔,由成像头盔的头盔投屏装置将视频数据投射至用户视觉界面,用户可根据成像头盔上的头盔捕捉摄像头完成视频数据的画面调整和参数选择,根据成像头盔上的头盔捕捉摄像头完成用户在头盔成像屏前控制动作数据的捕获,动作数据通过通信单元发送至无人机或机器狗,由无人机或机器狗上的执行电机完成动作数据的实现。

29.步骤s1中,在系统面板处可选择所需的模式场景,场景模式分栏设计,方便快捷选定以及选定目标明确,在下级子菜单可选择不同场景模式所对应需要控制执行的模块单元,针对需要控制的不同模块单元,此系统具有对应的不同控制方法。

30.步骤s2中,远程协控模式的工作模块包括成像模块、控制模块和执行模块;辅助跟随模式的工作模块包括成像模块和执行模块;自主巡航模式的工作模块包括执行模块。

31.步骤s3中,远程协控模式的控制方法为,通过执行模块获取视频数据且传送至成像模块,成像模块通过控制模块控制执行模块进行工作,此方法快捷有效,目的性高,通讯反应迅速,可适应各种实际情况且可完成复杂的工作任务,辅助跟随模式的控制方法为,执行模块和成像模块绑定后,通过成型模块根据人体动作直接控制执行模块,此模式较远程协控模式具有较高的适应性,自主巡航模式的控制方法为,通过控制模块自主完成工作任务,此模式工作自由度较高,适用于夜间无人监控时的巡检任务。

32.步骤s50中,视频数据接收与传送阶段,机器狗采集视频数据可通过单一的前端摄像头进行环境信息采集,也可通过所有摄像头进行环境信息采集,当单一摄像头采集时,成像头盔内设置的陀螺将机器狗摄像头与人体头部转动同步,当所有摄像头进行采集时,所有摄像头的视频数据连接整合成全景视频数据,通过通信单元将实时全景视频数据传送至成像头盔的控制芯片中,人体通过头盔成像屏感知机器狗周侧环境。

33.步骤s60中,通过压力传感器获取手指按压的压力值压力大小,压力值与机器狗的目标速度大小一一对应,压力越大机器狗的速度越快,通过位移传感器在与之接触平面上的位移量,位移量与机器狗的移动方向有相对对应关系,在平面上相对于原点的位移量即机器狗的移动方向,通过触控传感器获取手指的触控动作,触控动作与机器狗的特定动作一一对应,由触控动作触发机器狗执行特定动作,例如手指单击触控对应机器狗的翻滚一圈动作,手指双击触控对应机器狗的上楼梯动作,手指长按对应机器狗的匍匐动作。

34.步骤s61中,通过复位传感器获取用户按压信息,若用户按压则将此时控制陀螺中心的空间位置坐标设为原点,即坐标数据归零,以按压时刻控制陀螺中心的空间位置坐标为原点重新建立空间坐标系,否则继续采用上一个按压时刻控制陀螺中心为原点的空间坐标系,坐标数据由上一时刻更新数据继续叠加,通过悬浮球以及其上的加速度传感器或压力传感器获取用户运动轨迹,由运动轨迹计算得出在此时的空间坐标系下控制陀螺中心相对于原点的空间位置坐标,通过速度传感器获取用户操作的压力大小,压力值与机器狗的目标速度大小一一对应,压力越大机器狗的速度越快,通过控制陀螺中的控制算法将控制陀螺中获取的压力值转换成机器狗的对应目标速度,将控制陀螺中获取的空间位置坐标转换成机器狗的移动方向,将转换后的信息数据——机器狗的对应目标速度、机器狗的移动方向通过通信单元传送至机器狗的控制芯片,由机器狗的控制芯片控制机器狗的执行电机

执行对应信息数据的动作。

35.步骤s52中,视频数据接收与传送阶段,无人机采集视频数据可通过单一的前端摄像头进行环境信息采集,也可通过所有摄像头进行环境信息采集,当单一摄像头采集时,成像头盔内设置的陀螺将无人机摄像头与人体头部转动同步,当所有摄像头进行采集时,所有摄像头的视频数据连接整合成全景视频数据,通过通信单元将实时全景视频数据传送至成像头盔的控制芯片中,人体通过头盔成像屏感知无人机周侧环境。

36.步骤s62中,通过压力传感器获取手指按压的压力值压力大小,压力值与无人机的目标速度大小一一对应,压力越大无人机的速度越快,通过位移传感器在与之接触平面上的位移量,位移量与无人机的移动方向有相对对应关系,在平面上相对于原点的位移量即无人机的移动方向,通过触控传感器获取手指的触控动作,触控动作与无人机的特定动作一一对应,由触控动作触发无人机执行特定动作,例如手指单击触控对应无人机的翻滚一圈动作,手指双击触控对应无人机的上楼梯动作,手指长按对应无人机的匍匐动作。

37.步骤s63中,通过复位传感器获取用户按压信息,若用户按压则将此时控制陀螺中心的空间位置坐标设为原点,即坐标数据归零,以按压时刻控制陀螺中心的空间位置坐标为原点重新建立空间坐标系,否则继续采用上一个按压时刻控制陀螺中心为原点的空间坐标系,坐标数据由上一时刻更新数据继续叠加,通过悬浮球以及其上的加速度传感器或压力传感器获取用户运动轨迹,由运动轨迹计算得出在此时的空间坐标系下控制陀螺中心相对于原点的空间位置坐标,通过速度传感器获取用户操作的压力大小,压力值与无人机的目标速度大小一一对应,压力越大无人机的速度越快,通过控制陀螺中的控制算法将控制陀螺中获取的压力值转换成无人机的对应目标速度,将控制陀螺中获取的空间位置坐标转换成无人机的移动方向,将转换后的信息数据——无人机的对应目标速度、无人机的移动方向通过通信单元传送至无人机的控制芯片,由无人机的控制芯片控制无人机的执行电机执行对应信息数据的动作。

38.步骤s44中,机器狗与成像头盔进行辅助跟随模式时的具体流程包括以下步骤,首先根据机器狗上的摄像头实时采集机器狗周边环境的视频数据,其次视频数据通过通信单元发送至成像头盔,由成像头盔的投屏装置将视频数据投射至用户视觉界面,用户可根据成像头盔上的捕捉摄像头或陀螺仪完成视频数据的画面调整和参数选择,然后根据成像头盔上的捕捉摄像头完成用户在成像屏前控制动作数据的捕获,包含速度数据、方向数据等,最后动作数据通过通信单元发送至机器狗,由机器狗上的执行电机完成动作数据的实现。

39.步骤s45中,用户可根据成像头盔上的捕捉摄像头或陀螺仪完成视频数据的画面调整和参数选择具体可以为下述三种方式:第一种方式,将机器狗上的前端摄像头的视频数据传送至成像头盔上,通过投屏装置进行投射,用户通过成像头盔看到机器狗正前方的视角视频,当用户头戴成像头盔进行转动时,通过成像头盔上的陀螺仪获取人体头部转动角度,将转动角度通过通信单元传送至机器狗的控制芯片上,由控制芯片控制机器狗执行机器狗头部的转动,同步人体头部的转动角度,以此来完成视频画面的旋转和调整。

40.第二种方式,将机器狗上的所有摄像头的视频数据连接整合成全景视频数据,通过通信单元将实时全景视频数据传送至成像头盔的控制芯片中,由控制芯片根据陀螺仪的位置截取全景视频数据的对应角度的画面,通过成像头盔的投屏装置对截取的画面进行投

射,当用户头戴成像头盔进行转动时,通过成像头盔上的陀螺仪获取人体头部转动角度,将在全景视频数据上截取的角度旋转对应人体头部的转动角度进行画面的截取,通过成像头盔的投屏装置对转动后截取的画面进行投射,以此来完成视频画面的旋转和调整。

41.第三种方式,将机器狗上的所有摄像头的视频数据连接整合成全景视频数据,通过通信单元将实时全景视频数据传送至成像头盔的控制芯片中,由控制芯片根据陀螺仪的位置截取全景视频数据的对应角度的画面,通过成像头盔的投屏装置对截取的画面进行投射,通过成像头盔上的捕捉摄像头捕捉人体手部动作,根据动作的方向和幅度旋转截取画面的角度,对旋转后的截取角度的画面进行投射,以此来完成视频画面的旋转和调整。

42.步骤s44中,无人机与成像头盔进行辅助跟随模式时的具体流程包括以下步骤,首先根据无人机上的摄像头实时采集无人机周边环境的视频数据,其次视频数据通过通信单元发送至成像头盔,由成像头盔的投屏装置将视频数据投射至用户视觉界面,用户可根据成像头盔上的捕捉摄像头或陀螺仪完成视频数据的画面调整和参数选择,然后根据成像头盔上的捕捉摄像头完成用户在成像屏前控制动作数据的捕获,包含速度数据、方向数据等,最后动作数据通过通信单元发送至无人机,由无人机上的执行电机完成动作数据的实现。

43.步骤s45中,用户可根据成像头盔上的捕捉摄像头或陀螺仪完成视频数据的画面调整和参数选择具体可以为下述三种方式:第一种方式,将无人机上的前端摄像头的视频数据传送至成像头盔上,通过投屏装置进行投射,用户通过成像头盔看到无人机正前方的视角视频,当用户头戴成像头盔进行转动时,通过成像头盔上的陀螺仪获取人体头部转动角度,将转动角度通过通信单元传送至无人机的控制芯片上,由控制芯片控制无人机执行无人机头部的转动,同步人体头部的转动角度,以此来完成视频画面的旋转和调整。

44.第二种方式,将无人机上的所有摄像头的视频数据连接整合成全景视频数据,通过通信单元将实时全景视频数据传送至成像头盔的控制芯片中,由控制芯片根据陀螺仪的位置截取全景视频数据的对应角度的画面,通过成像头盔的投屏装置对截取的画面进行投射,当用户头戴成像头盔进行转动时,通过成像头盔上的陀螺仪获取人体头部转动角度,将在全景视频数据上截取的角度旋转对应人体头部的转动角度进行画面的截取,通过成像头盔的投屏装置对转动后截取的画面进行投射,以此来完成视频画面的旋转和调整。

45.第三种方式,将无人机上的所有摄像头的视频数据连接整合成全景视频数据,通过通信单元将实时全景视频数据传送至成像头盔的控制芯片中,由控制芯片根据陀螺仪的位置截取全景视频数据的对应角度的画面,通过成像头盔的投屏装置对截取的画面进行投射,通过成像头盔上的捕捉摄像头捕捉人体手部动作,根据动作的方向和幅度旋转截取画面的角度,对旋转后的截取角度的画面进行投射,以此来完成视频画面的旋转和调整。

46.以上所述仅为本发明的较佳实施例,并不用以限制本发明,本领域的技术人员在本发明技术方案范围内进行通常的变化和替换都应包含在本发明的保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1