一种多方安全计算方法与流程

1.本发明涉及多方安全计算技术和深度学习算法技术领域,具体为一种多方安全计算方法。

背景技术:

2.随着大数据技术及ai技术的发展,利用大数据训练人工智能模型的应用越来越多,这些模型能够在企业内部广泛使用。随着ai领域深度学习的发展,模型能够使用的数据越多,模型效果能提升的越好,因此业界提出了联合多方数据共同训练模型,但这时碰到了数据安全问题,各方并不希望自己的数据被对方掌握,尤其有一些数据是个人隐私数据,法律上是不能直接使用的。业界出现了一种联邦学习算法,目标是在保证不透露原始数据的基础上,多方联合建模。

3.联邦学习包括横向联邦学习和纵向联邦学习,本专利针对的应用场景同纵向联邦学习一致,简单来说,a方有一批数据和学习目标,b方有另一批数据,这两批数据有一部分数据能够匹配,例如是相同的用户,要求在a不知道b的数据,b也不知道a数据和学习目标的情况下,训练一个ai模型,能够达到a的学习目标。现有的技术无法实现上述功能。

技术实现要素:

4.为解决上述问题,本专利提供了一种多方安全计算方法。

5.一种多方安全计算方法,包括如下步骤:

6.1、数据对齐:a方和b方都有自己的数据,但是训练模型的时候每条数据必须是同一个样本的,例如不能把一个人的性别和另一个人的年龄合成一个样本。所以要把a和b的数据做对齐,用md5的方法,a和b方约定某种很难穷举的数据作为样本id,例如身份证号+姓名+手机号,a将自己的样本id转换成md5,发送给b方,b方也将自己数据的id转化成md5,然后看那些能够和a方的md5样本id对应上,对应上的这批就是双方共有的样本,b方将共有id的结果发送给a方,这样就对齐了双方的样本。

7.2、b方对数据进行处理,使处理后的数据不能还原成原数据,包括:归一化、标准化、随机加噪声;为数据引入随机性,从而将这么多的数据变成一个随机数,随机数的范围限制在现有数据范围中。

8.3、b方将处理后的信息连同id发送给a方,a方会将b方发送的数据和自身数据相结合,对b方数据用多层dense建模,a方对自身数据,根据数据的特定形式,可以用dense、cnn或者rnn建模,模型的目标是自己的目标。

9.进一步的,本专利的归一化的具体方法如下:对一列数据x1,x2,

…

xn,按照下列公式变换:

[0010][0011]

min(xi)表示这列数中最小数,max(xi)表示这列数中最大数,对每个x计算,可以

生成新的一列数;

[0012]

进一步的,本专利的标准化的具体方法如下:对一列数据x1,x2,

…

xn,按照下列公式变换:

[0013][0014]

其中每项x减去这列数的均值,然后除以标准差,标准差的公式如下:

[0015]

标准差公式

[0016][0017]

公式描述:公式中数值x1,x2,x3,......xn(皆为实数),其平均值(算术平均值)为μ,标准差为σ。

[0018]

进一步的,本专利的随机加噪声的具体方法如下:随机选择预订比例的数据,替换成随机数,随机数的取值范围同原数据,即:大于等于min(x),小于等于max(x)。

[0019]

本专利的优点在于:在保证数据安全的情况下,解决了现有纵向联邦学习建模受网络传输的影响,导致建模慢和不能建大型模型的问题,本专利只在需求方的本地训练模型,而不会通过网络大量传输训练调参信息,这样既提高了训练速度,又解决了模型性能的瓶颈问题。

附图说明

[0020]

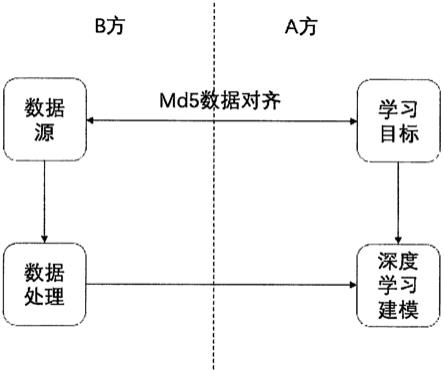

图1为本专利的工作流程示意图

具体实施方式

[0021]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0022]

如图1所示,一种多方安全计算方法,包括如下步骤:

[0023]

1、数据对齐:a方和b方都有自己的数据,但是训练模型的时候每条数据必须是同一个样本的,例如不能把一个人的性别和另一个人的年龄合成一个样本。所以要把a和b的数据做对齐,用md5的方法,a和b方约定某种很难穷举的数据作为样本id,例如身份证号+姓名+手机号,a将自己的样本id转换成md5,发送给b方,b方也将自己数据的id转化成md5,然后看那些能够和a方的md5样本id对应上,对应上的这批就是双方共有的样本,b方将共有id的结果发送给a方,这样就对齐了双方的样本。

[0024]

2、b方对数据进行处理,使处理后的数据不能还原成原数据,包括:归一化、标准化、随机加噪声;为数据引入随机性,从而将这么多的数据变成一个随机数,随机数的范围限制在现有数据范围中。

[0025]

3、b方将处理后的信息连同id发送给a方,a方会将b方发送的数据和自身数据相结合,对b方数据用多层dense建模,a方对自身数据,根据数据的特定形式,可以用dense、cnn

或者rnn建模,模型的目标是自己的目标。

[0026]

进一步的,本专利的归一化的具体方法如下:对一列数据x1,x2,

…

xn,按照下列公式变换:

[0027][0028]

min(xi)表示这列数中最小数,max(xi)表示这列数中最大数,对每个x计算,可以生成新的一列数;

[0029]

进一步的,本专利的标准化的具体方法如下:对一列数据x1,x2,

…

xn,按照下列公式变换:

[0030][0031]

其中每项x减去这列数的均值,然后除以标准差,标准差的公式如下:

[0032]

标准差公式

[0033][0034]

公式描述:公式中数值x1,x2,x3,......xn(皆为实数),其平均值(算术平均值)为μ,标准差为σ。

[0035]

进一步的,本专利的随机加噪声的具体方法如下:随机选择预订比例的数据,替换成随机数,随机数的取值范围同原数据,比如:设定一个20%的噪声比例,10个数会有2个数被替换成随机数,即:x1,x2,

…

x10,对其中的x4和x7进行替换,选择是随机的,替换的数也是一个随机数,该随机数大于等于min(x),小于等于max(x)。

[0036]

本专利的优点在于:在保证数据安全的情况下,解决了现有纵向联邦学习建模受网络传输的影响,导致建模慢和不能建大型模型的问题,本专利只在需求方的本地训练模型,而不会通过网络大量传输训练调参信息,这样既提高了训练速度,又解决了模型性能的瓶颈问题。

[0037]

对于本领域技术人员而言,显然本发明不限于上述示范性实施例的细节,而且在不背离本发明的精神或基本特征的情况下,能够以其他的具体形式实现本发明。因此,无论从哪一点来看,均应将实施例看作是示范性的,而且是非限制性的,本发明的范围由所附权利要求而不是上述说明限定,因此旨在将落在权利要求的等同要件的含义和范围内的所有变化囊括在本发明内。不应将权利要求中的任何附图标记视为限制所涉及的权利要求。

[0038]

在本发明的描述中,除非另有说明,“多个”的含义是两个或两个以上;术语“上”、“下”、“左”、“右”、“内”、“外”、“前端”、“后端”、“头部”、“尾部”等指示的方位或位置关系为基于附图所示的方位或位置关系,仅是为了便于描述本发明和简化描述,而不是指示或暗示所指的装置或元件必须具有特定的方位、以特定的方位构造和操作,因此不能理解为对本发明的限制。此外,术语“第一”、“第二”、“第三”等仅用于描述目的,而不能理解为指示或暗示相对重要性。

[0039]

在本发明的描述中,需要说明的是,除非另有明确的规定和限定,术语“相连”、“连接”应做广义理解,例如,可以是固定连接,也可以是可拆卸连接,或一体地连接;可以是机械连接,也可以是电连接;可以是直接相连,也可以通过中间媒介间接相连。对于本领域的

普通技术人员而言,可以具体情况理解上述术语在本发明中的具体含义。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1