多模态维度情感识别方法与流程

1.本申请涉及数据处理技术领域,尤其涉及多模态维度情感识别方法。

背景技术:

2.目前的情感识别方法大多局限于单一、离散的情感类别,比如常见的心理学家提出的六类情感:生气、厌恶、恐惧、高兴、悲伤和惊讶。这种离散模型虽然简单直观,但只能表示有限种类的、单一明确的情感类型;而且,很多情感类别之间存在高度的相关性,但在离散化后很难对这种相关性进行度量和处理;此外,情感的产生、发展和消失是一个连续变化的过程,而离散模型却很难描述连续变化的情感。维度情感模型的提出较好地克服了离散情感模型的缺点,可以刻画细微的情感波动。维度情感识别依赖于多模态信息的有效融合以及时序上下文信息的高效建模。现有技术的缺点是,将提取出的各个模态的特征进行简单的拼接,而不同时刻不同模态特征的贡献度往往不同;同时,主流方法普遍使用的循环神经网络因为梯度消失问题在面对长时序列时建模效果不好,导致情感识别效果不佳。

3.申请公布号cn 110033029 a公开了一种基于多模态情感模型的情感识别方法和装置,建立基础维度预测模型,并由基础维度预测模型得到视频维度预测模型、音频维度预测模型和文本维度预测模型,分别分析表情姿态视频特征、音频特征、话语文本特征得到第一情感结果、第二情感结果和第三情感结果;将三个结果融合并结合基于基础维度预测模型的映射关系得到目标对象的情感类别;其从多模态和多角度进行情感识别,具有信息全面、抗干扰性强以及高准确度的优点。

4.申请公布号cn 110188343 a公开了一种基于融合注意力网络的多模态情感识别方法,提取文本、视觉和音频三个模态的高维特征并按字级对齐和归一化处理,然后输入至双向门控循环单元网络进行训练,提取三个单模态子网络中的双向门控循环单元网络输出的状态信息计算多模态间状态信息的相关度,再计算多个模态每一时刻的注意力分布,即每一时刻状态信息的权重参数,将三个模态子网络的状态信息和对应的权重参数加权平均得到融合特征向量作为全连接网络的输入,将待识别的文本、视觉和音频输入训练后各个模态的双向门控循环单元网络,得到最终的情感强度输出。本发明能克服多模态融合时各模态的权重一致性问题,提高多模态融合下的情感识别准确率。

技术实现要素:

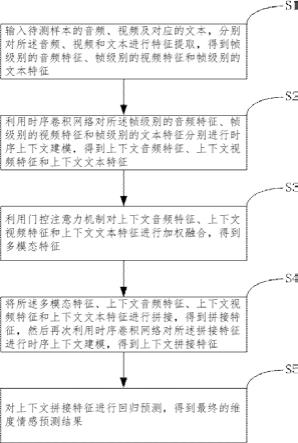

5.为了解决上述技术问题或者至少部分地解决上述技术问题,本申请提供了一种多模态维度情感识别方法,包括:s1:输入待测样本的音频、视频及对应的文本,分别对所述音频、视频和文本进行特征提取,得到帧级别的音频特征、帧级别的视频特征和帧级别的文本特征;s2:利用时序卷积网络对所述帧级别的音频特征、帧级别的视频特征和帧级别的文本特征分别进行时序上下文建模,得到上下文音频特征、上下文视频特征和上下文文本特征;

s3:利用门控注意力机制对上下文音频特征、上下文视频特征和上下文文本特征进行加权融合,得到多模态特征;s4:将所述多模态特征、上下文音频特征、上下文视频特征和上下文文本特征进行拼接,得到拼接特征,然后再次利用时序卷积网络对所述拼接特征进行时序上下文建模,得到上下文拼接特征;s5:对上下文拼接特征进行回归预测,得到最终的维度情感预测结果。

6.优选地,所述分别对所述音频文件、视频文件和文本文件进行特征提取的具体方法为:对所述音频文件进行切分得到帧级别的短时音频片段;将所述短时音频片段分别输入至预先训练好的音频特征提取网络,得到所述帧级别的音频特征;利用人脸检测工具从所述视频文件提取帧级别的人脸图像;将所述帧级别的人脸图像分别输入至预先训练好的人脸表情特征提取网络,得到所述帧级别的视频特征;利用分词工具对所述文本文件进行分词;将所述分词后的文本文件输入至预先训练好的文本特征提取网络,得到所述词级别的文本特征;利用文本对齐工具,获取待测样本的文本文件中每个词语的对齐信息;根据对齐信息,将词级别的文本特征转化为帧级别的文本特征。

7.优选地,所述利用时序卷积网络对所述帧级别的音频特征、帧级别的视频特征和帧级别的文本特征分别进行时序上下文建模的具体方法为:将所述帧级别的音频特征输入至n层的时序卷积网络中,得到上下文音频特征,n设置为1

‑

3;将所述帧级别的视频特征输入至n层的时序卷积网络中,得到上下文视频特征,n设置为1

‑

3;将所述帧级别的文本特征输入至n层的时序卷积网络中,得到上下文文本特征,n设置为1

‑

3。

8.优选地,所述利用门控注意力机制对上下文音频特征、上下文视频特征和上下文文本特征进行加权融合,得到多模态特征的具体方法为:拼接上下文音频特征和上下文文本特征,得到上下文音文特征,利用注意力机制和上下文音文特征计算上下文音频特征的权重系数;拼接上下文视频特征和上下文文本特征,得到上下文视文特征,利用注意力机制和上下文视文特征计算上下文视频特征的权重系数;利用所述上下文音频特征的权重系数和所述上下文视频特征的权重系数对上下文音频特征和上下文视频特征进行加权,然后叠加至上下文文本特征中,得到融合三模态信息的多模态特征。

9.优选地,所述拼接上下文音频特征和上下文文本特征,得到上下文音文特征的具体方法为:对于每一时刻,拼接该时刻上下文音频特征和上下文文本特征,得到上下文音文特征,;其中,为所述该时刻的音频特征,为所述该时刻的文本特征;

利用注意力机制和上下文音文特征计算上下文音频特征的权重系数的具体方法为:,其中,为上下文音频特征的权重系数;是一种激活函数;是线性变换矩阵,为常数;是偏置系数,为常数。

10.优选地,所述拼接上下文视频特征和上下文文本特征,得到上下文视文特征的具体方法为:对于每一时刻,拼接该时刻上下文视频特征和上下文文本特征,得到上下文视文特征,;其中,为所述该时刻的视频特征,为所述该时刻的文本特征;利用注意力机制和上下文视文特征计算上下文视频特征的权重系数的具体方法为:,其中,为上下文视频特征的权重系数;是一种激活函数;是线性变换矩阵,为常数;是偏置系数,为常数。

11.优选地,所述利用所述上下文音频特征的权重系数和所述上下文视频特征的权重系数对上下文音频特征和上下文视频特征进行加权的具体方法为:对于每一时刻,对该时刻上下文音频特征和上下文视频特征进行加权得到,其中,是偏置系数,为常数;所述得到融合三模态信息的多模态特征的体方法为:,其中,为所述该时刻的多模态特征,是一个经验系数。

12.优选地,所述设为0到1之间。

13.优选地,所述对上下文拼接特征进行回归预测,得到最终的维度情感预测结果的具体方法为:将上下文拼接特征输入至全连接网络中进行回归预测,

其中,为sigmoid激活函数;是线性变换矩阵,为常数;是偏置系数,为常数;为维度情感预测结果。

14.本发明还提供了一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述计算机程序时,实现以上方案所述的方法的步骤。

15.本申请实施例提供的上述技术方案与现有技术相比具有如下优点:本申请实施例提供的该方法,采用门控注意力机制显式地刻画了音频、视频以及文本三个模态的特征在不同时刻的贡献度,达到了自适应整合多模态信息的功能,通过堆叠含有膨胀卷积的一维卷积块使得时序卷积网络的感受野大大增加,有效地完成了时序上下文的建模,较好地避免了循环神经网络在长时上文建模时存在的梯度消失问题,实现了细微情感波动的有效识别。

附图说明

16.此处的附图被并入说明书中并构成本说明书的一部分,示出了符合本发明的实施例,并与说明书一起用于解释本发明的原理。

17.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,对于本领域普通技术人员而言,在不付出创造性劳动性的前提下,还可以根据这些附图获得其他的附图。

18.图1为本申请实施例提供的多模态维度情感识别方法流程图。

具体实施方式

19.为使本申请实施例的目的、技术方案和优点更加清楚,下面将结合本申请实施例中的附图,对本申请实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本申请的一部分实施例,而不是全部的实施例。基于本申请中的实施例,本领域普通技术人员在没有做出创造性劳动的前提下所获得的所有其他实施例,都属于本申请保护的范围。

20.实施例1:图1,为本申请实施例提供的多模态维度情感识别方法,包括:s1:输入待测样本的音频、视频及对应的文本,分别对所述音频、视频和文本进行特征提取,得到帧级别的音频特征、帧级别的视频特征和帧级别的文本特征;s2:利用时序卷积网络对所述帧级别的音频特征、帧级别的视频特征和帧级别的文本特征分别进行时序上下文建模,得到上下文音频特征、上下文视频特征和上下文文本特征;s3:利用门控注意力机制对上下文音频特征、上下文视频特征和上下文文本特征进行加权融合,得到多模态特征;s4:将所述多模态特征、上下文音频特征、上下文视频特征和上下文文本特征进行拼接,得到拼接特征,然后再次利用时序卷积网络对所述拼接特征进行时序上下文建模,得

到上下文拼接特征;s5:对上下文拼接特征进行回归预测,得到最终的维度情感预测结果。

21.根据上述方案,进一步,所述分别对所述音频文件、视频文件和文本文件进行特征提取的具体方法为:对所述音频文件进行切分得到帧级别的短时音频片段;将所述短时音频片段分别输入至预先训练好的音频特征提取网络,得到所述帧级别的音频特征;利用人脸检测工具从所述视频文件提取帧级别的人脸图像;将所述帧级别的人脸图像分别输入至预先训练好的人脸表情特征提取网络,得到所述帧级别的视频特征;利用分词工具对所述文本文件进行分词;将所述分词后的文本文件输入至预先训练好的文本特征提取网络,得到所述词级别的文本特征;利用文本对齐工具,获取待测样本的文本文件中每个词语的对齐信息;根据对齐信息,将词级别的文本特征转化为帧级别的文本特征。

22.根据上述方案,进一步,所述利用时序卷积网络对所述帧级别的音频特征、帧级别的视频特征和帧级别的文本特征分别进行时序上下文建模的具体方法为:将所述帧级别的音频特征输入至n层的时序卷积网络中,得到上下文音频特征,n设置为1

‑

3;将所述帧级别的视频特征输入至n层的时序卷积网络中,得到上下文视频特征,n设置为1

‑

3;将所述帧级别的文本特征输入至n层的时序卷积网络中,得到上下文文本特征,n设置为1

‑

3。

23.根据上述方案,进一步,所述利用门控注意力机制对上下文音频特征、上下文视频特征和上下文文本特征进行加权融合,得到多模态特征的具体方法为:拼接上下文音频特征和上下文文本特征,得到上下文音文特征,利用注意力机制和上下文音文特征计算上下文音频特征的权重系数;拼接上下文视频特征和上下文文本特征,得到上下文视文特征,利用注意力机制和上下文视文特征计算上下文视频特征的权重系数;利用所述上下文音频特征的权重系数和所述上下文视频特征的权重系数对上下文音频特征和上下文视频特征进行加权,然后叠加至上下文文本特征中,得到融合三模态信息的多模态特征。

24.根据上述方案,进一步,所述拼接上下文音频特征和上下文文本特征,得到上下文音文特征的具体方法为:对于每一时刻,拼接该时刻上下文音频特征和上下文文本特征,得到上下文音文特征,;其中,为所述该时刻的音频特征,为所述该时刻的文本特征;利用注意力机制和上下文音文特征计算上下文音频特征的权重系数的具体方法为:,其中,

为上下文音频特征的权重系数;是一种激活函数;是线性变换矩阵,为常数;是偏置系数,为常数。

25.根据上述方案,进一步,所述拼接上下文视频特征和上下文文本特征,得到上下文视文特征的具体方法为:对于每一时刻,拼接该时刻上下文视频特征和上下文文本特征,得到上下文视文特征,;其中,为所述该时刻的视频特征,为所述该时刻的文本特征;利用注意力机制和上下文视文特征计算上下文视频特征的权重系数的具体方法为:,其中,为上下文视频特征的权重系数;是一种激活函数;是线性变换矩阵,为常数;是偏置系数,为常数。

26.根据上述方案,进一步,所述利用所述上下文音频特征的权重系数和所述上下文视频特征的权重系数对上下文音频特征和上下文视频特征进行加权的具体方法为:对于每一时刻,对该时刻上下文音频特征和上下文视频特征进行加权得到,其中,是偏置系数,为常数;所述得到融合三模态信息的多模态特征的体方法为:,其中,为所述该时刻的多模态特征,是一个经验系数。所述设为0到1之间。

27.根据上述方案,进一步,所述对上下文拼接特征进行回归预测,得到最终的维度情感预测结果的具体方法为:将上下文拼接特征输入至全连接网络中进行回归预测,其中,为sigmoid激活函数;是线性变换矩阵,为常数;是偏置系数,为常数;为维度情感预测结果。

28.基于同一发明构思,本申请实施例还提供了一种电子设备,包括存储器、处理器及

存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述计算机程序时,实现以上任一方案所述的多模态维度情感识别方法的步骤。

29.实施例2:如图1所示,本申请实施例提供的多模态维度情感识别方法包括以下步骤:s1:输入待测样本的音频、视频及对应的文本,分别对所述音频、视频和文本进行特征提取,得到帧级别的音频特征、帧级别的视频特征和帧级别的文本特征;在一些实施例中,待测音频、待测视频是同一个片段中的视频和音频,待测文本和待测音频、待测视频相对应,音频、视频和文本分别为这段视频中的三种模态。

30.在一些实施例中,本实施例中需要对这三种模态的数据进行分析,以识别输入片段中的人物在每一时刻的维度情感状态。

31.在一些实施例中,可以输入一个片段,该片段中有一个人物说话,这一个人物说话的连续画面就是待测视频,该片段中出现的音频就是待测音频,该片段中的视频和音频中对应的文本就是待测文本,例如该片段中一个人说了一句话,这个人说话的画面就是待测视频,这个人说话的语音就是待测音频,这个人说的话的文字内容就是待测文本。

32.对所述待测音频、待测视频以及待测文本分别进行特征提取,得到帧级别的音频特征、帧级别的视频特征以及词级别的文本特征。

33.在一些实施例中,对待测音频、待测视频以及待测文本进行特征提取是将待测音频、待测视频以及待测文本输入到预先训练好的神经网络中进行隐层特征抽取,帧级别的音频特征指的是经过短时切分的每一帧音频的特征,帧级别的视频特征指的是视频中每一帧图像的特征,帧级别的文本特征指的是每一帧对应的文本中词语的特征。

34.在一些实施例中,对所述待测音频、待测视频以及待测文本分别进行特征提取,得到帧级别的音频特征、帧级别的视频特征以及词级别的文本特征的具体步骤为:s1

‑

1:将所述待测样本的音频进行切分然后输入至预先训练好的音频特征提取网络中,从所述待样本的音频中提取出所述帧级别的音频特征。

35.在一些实施例中,将所述待测样本的音频进行切分然后输入至预先训练好的音频特征提取网络中,从所述待样本的音频中提取出所述帧级别的音频特征的具体步骤包括:s1

‑1‑

1:将待测样本的音频以1s帧长和0.1s帧移进行滑动切分得到多帧的短时音频片段。

36.s1

‑1‑

2:将上述短时音频片段分别输入预先训练好的音频特征提取网络中,提取其中间层输出得到帧级别的音频特征。

37.在一些实施例中,音频特征提取网络可以采用常见的特征提取网络,例如vggish,本实施例不做限制。

38.s1

‑

2:将所述待测样本的视频进行分帧提取人脸图像然后输入至预先训练好的人脸表情特征提取网络中,从所述待样本的视频中提取出所述帧级别的视频特征。

39.在一些实施例中,将所述待测样本的音频进行切分然后输入至预先训练好的音频特征提取网络中,从所述待样本的音频中提取出所述帧级别的音频特征的具体步骤包括:s1

‑2‑

1:利用人脸检测工具从所述待测样本的视频中提取每一帧的人脸图像;

s1

‑2‑

2:将所述帧级别的人脸图像分别输入至所述预先训练好的人脸表情特征提取网络,得到所述帧级别的视频特征。

40.在一些实施例中,人脸表情特征提取网络可以采用常见的特征提取网络,例如在人脸表情数据库上预训练的resnet,本实施例不做限制。

41.s1

‑

3:将所述待测样本的文本进行分词然后输入至预先训练好的文本特征提取网络中,从所述待测样本的文本中提取出所述词级别的文本特征。

42.在一些实施例中,将所述待测样本的文本进行分词然后输入至预先训练好的文本特征提取网络中,从所述待测样本的文本中提取出所述词级别的文本特征的具体步骤包括:s1

‑3‑

1:利用分词工具对所述待测语音的文本进行分词;在一些实施例中,分词工具采用常用的分词工具,本实施例不做限制。

43.s1

‑3‑

2:将所述分词后的文本输入至所述预先训练好的文本特征提取网络,得到所述词级别的文本特征。

44.在一些实施例中,文本特征提取网络可以采用常见的特征提取网络,例如bert,本实施例不做限制。

45.s2:利用时序卷积网络对所述帧级别的音频特征、帧级别的视频特征和帧级别的文本特征分别进行时序上下文建模,得到上下文音频特征、上下文视频特征和上下文文本特征。

46.在一些实施例中,利用时序卷积网络对所述帧级别的音频特征、帧级别的视频特征和帧级别的文本特征分别进行时序上下文建模,得到上下文音频特征、上下文视频特征和上下文文本特征的具体步骤为:s2

‑

1:利用时序卷积网络对对所述帧级别的音频特征进行时序上下文建模得到融合上下文信息的音频特征,上下文音频特征。

47.在一些实施例中,直接将所述帧级别的深度音频特征输入至n层的时序卷积网络中,n在此不做限制,一般可设为1

‑

3。具体如下:其中即为所述的时序卷积网络。

48.s2

‑

2:利用时序卷积网络对对所述帧级别的视频特征进行时序上下文建模得到融合上下文信息的视频特征,上下文视频特征。

49.在一些实施例中,直接将所述帧级别的视频特征输入至n层的时序卷积网络中,n在此不做限制,一般可设为1

‑

3。具体如下:s2

‑

3:利用时序卷积网络对对所述帧级别的文本特征进行时序上下文建模得到融合上下文信息的文本特征,上下文文本特征。

50.在一些实施例中,直接将所述帧级别的深度文本特征输入至n层的时序卷积网络中,n在此不做限制,一般可设为1

‑

3。具体如下:

s3:利用门控注意力机制对上下文音频特征、上下文视频特征和上下文文本特征进行加权融合,得到融合后的多模态特征。

51.在一些实施例中,门控注意力机制可以计算出在每一时刻不同模态特征的贡献度,让模型在识别维度情感状态时可以对权重高的模态特征重点关注,从而有利于提高情感识别的准确率。

52.在一些实施例中,利用门控注意力机制对上下文音频特征、上下文视频特征和上下文文本特征进行加权融合,得到融合后的多模态特征的具体步骤是:s3

‑

1:拼接上下文音频特征和上下文文本特征,得到上下文音文特征,利用注意力机制和上下文音文特征计算上下文音频特征的权重系数;s3

‑1‑

1:所述拼接上下文音频特征和上下文文本特征,得到上下文音文特征的具体方法为:对于每一时刻t,拼接该时刻上下文音频特征和上下文文本特征,得到上下文音文特征,;其中,为所述该时刻的音频特征,为所述该时刻的文本特征;s3

‑1‑

2:利用注意力机制和上下文音文特征计算上下文音频特征的权重系数的具体方法为:,其中,为上下文音频特征的权重系数;是一种激活函数;是线性变换矩阵,为常数;是偏置系数,为常数。

53.s3

‑

2:拼接上下文视频特征和上下文文本特征,得到上下文视文特征,利用注意力机制和上下文视文特征计算上下文视频特征的权重系数;s3

‑2‑

1:所述拼接上下文视频特征和上下文文本特征,得到上下文视文特征的具体方法为:对于每一时刻,拼接该时刻上下文视频特征和上下文文本特征,得到上下文视文特征,;其中,为所述该时刻的视频特征,为所述该时刻的文本特征;s3

‑2‑

2:利用注意力机制和上下文视文特征计算上下文视频特征的权重系数的具体方法为:,其中,为上下文视频特征的权重系数;是一种激活函数;是线性变换矩阵,为常数;

是偏置系数,为常数。

54.s3

‑

3:利用所述上下文音频特征的权重系数和所述上下文视频特征的权重系数对上下文音频特征和上下文视频特征进行加权,然后叠加至上下文文本特征中,得到融合三模态信息的多模态特征。

55.s3

‑3‑

1:对于每一时刻,对该时刻上下文音频特征和上下文视频特征进行加权得到,其中,是偏置系数,为常数;s3

‑3‑

2:所述得到融合三模态信息的多模态特征的体方法为:,其中,为所述该时刻的多模态特征,是一个经验系数,设为0到1之间,其作用是为了减弱音视频特征的影响,增强文本特征对多模态特征的贡献度。

56.s4:将所述多模态特征、上下文音频特征、上下文视频特征和上下文文本特征进行拼接,得到拼接特征,然后再次利用时序卷积网络对所述拼接特征进行时序上下文建模,得到上下文拼接特征;在一些实施例中,将所述多模态特征、上下文音频特征、上下文视频特征和上下文文本特征进行拼接,得到拼接特征,然后再次利用时序卷积网络对所述拼接特征进行时序上下文建模,得到上下文拼接特征的具体步骤是:s4

‑

1:将所述多模态特征、上下文音频特征、上下文视频特征和上下文文本特征进行拼接,得到拼接特征。

57.s4

‑

2:利用n层的时序卷积网络对对所述拼接后的特征进行时序上下文建模,得到上下文拼接特征。这里n可以设置为3

‑

5。具体如下:其中,为所述时序卷积网络。

58.s5:对上下文拼接特征进行回归预测,得到最终的维度情感预测结果。

59.在一些实施例中,对上下文拼接特征进行回归预测,得到最终的维度情感预测结果的具体步骤为:s5

‑

1:将上下文拼接特征输入至全连接网络中进行回归预测。具体如下:其中,为sigmoid激活函数,和分别是线性变换矩阵和偏置系数。

60.s5

‑

2:所述全连接网络的输出即为最终的维度情感预测结果。

61.基于同一发明构思,本申请另一实施例提供一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行时实现本申请上述任一实施例所述的多模态维度情感识别方法中的步骤。

62.对于装置实施例而言,由于其与方法实施例基本相似,所以描述的比较简单,相关之处参见方法实施例的部分说明即可。

63.本说明书中的各个实施例均采用递进的方式描述,每个实施例重点说明的都是与

其他实施例的不同之处,各个实施例之间相同相似的部分互相参见即可。

64.本领域内的技术人员应明白,本申请实施例的实施例可提供为方法、装置、或计算机程序产品。因此,本申请实施例可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本申请实施例可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd

‑

rom、光学存储器等)上实施的计算机程序产品的形式。

65.本申请实施例是参照根据本申请实施例的方法、终端设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理终端设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理终端设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

66.这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理终端设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

67.这些计算机程序指令也可装载到计算机或其他可编程数据处理终端设备上,使得在计算机或其他可编程终端设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程终端设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

68.需要说明的是,在本文中,诸如“第一”和“第二”等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

69.以上所述仅是本发明的具体实施方式,使本领域技术人员能够理解或实现本发明。对这些实施例的多种修改对本领域的技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本发明的精神或范围的情况下,在其它实施例中实现。因此,本发明将不会被限制于本文所示的这些实施例,而是要符合与本文所申请的原理和新颖特点相一致的最宽的范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1