基于人工智能的宠物狗识别方法、装置、设备及存储介质与流程

1.本技术涉及生物识别的技术领域,尤其涉及一种基于人工智能的宠物狗识别方法、装置、设备及存储介质。

背景技术:

2.目前,用户可以给自家的宠物投保宠物险,当自己的宠物生病或出现意外时,可以向保险公司申请理赔,可以保障宠物的安全和减少自己的经济损失。投保宠物险时,需要对宠物进行身份认证,现有的dna认证、芯片认证等手段操作复杂,成本较高。为解决上述问题,可以通过识别狗的鼻纹特征来对宠物狗进行身份认证,但在进行鼻纹识别之前,需要进行狗脸识别、狗鼻识别和狗脸关键点检测,而现有的狗脸识别、狗鼻识别和狗脸关键点检测都是单独进行的,无法保证宠物狗的识别准确性。

技术实现要素:

3.本技术实施例提供一种基于人工智能的宠物狗识别方法、装置、设备及存储介质,旨在提高宠物狗的识别准确性。

4.第一方面,本技术实施例提供一种宠物狗识别方法,包括:

5.获取宠物狗图像和目标宠物狗识别模型,所述目标宠物狗识别模型包括特征提取网络、狗脸框预测网络、狗脸关键点检测网络和狗鼻框预测网络;

6.将所述宠物狗图像输入所述特征提取网络进行特征提取,得到多个分辨率不同的目标特征图;

7.将所述目标特征图输入所述狗脸框预测网络进行狗脸框预测,得到所述宠物狗图像的狗脸框的第一目标位置点组;

8.将所述目标特征图输入所述狗脸关键点检测网络进行狗脸关键点检测,得到所述宠物狗图像中的宠物狗的目标狗脸关键点组;

9.将所述目标特征图输入所述狗鼻框预测网络进行狗鼻框预测,得到所述宠物狗图像的狗鼻框的第二目标位置点组;

10.从所述宠物狗图像中框选所述第一目标位置点组所对应的狗脸图像和所述第二目标位置点组所对应的狗鼻图像;

11.根据所述狗脸图像和所述目标狗脸关键点组,对所述狗鼻图像进行校正,得到目标狗鼻图像;

12.将所述目标狗鼻图像输入预设的鼻纹特征提取模型,得到所述宠物狗图像中的宠物狗的鼻纹特征,并存储所述鼻纹特征。

13.第二方面,本技术实施例还提供一种宠物狗识别装置,所述宠物狗识别装置包括:

14.获取模块,用于获取宠物狗图像和目标宠物狗识别模型,所述目标宠物狗识别模型包括特征提取网络、狗脸框预测网络、狗脸关键点检测网络和狗鼻框预测网络;

15.特征提取模块,用于将所述宠物狗图像输入所述特征提取网络进行特征提取,得

到多个分辨率不同的目标特征图;

16.狗脸框预测模块,用于将所述目标特征图输入所述狗脸框预测网络进行狗脸框预测,得到所述宠物狗图像的狗脸框的第一目标位置点组;

17.狗脸关键点检测模块,用于将所述目标特征图输入所述狗脸关键点检测网络进行狗脸关键点检测,得到所述宠物狗图像中的宠物狗的目标狗脸关键点组;

18.狗鼻框预测模块,用于将所述目标特征图输入所述狗鼻框预测网络进行狗鼻框预测,得到所述宠物狗图像的狗鼻框的第二目标位置点组;

19.所述获取模块,还用于从所述宠物狗图像中框选所述第一目标位置点组所对应的狗脸图像和所述第二目标位置点组所对应的狗鼻图像;

20.校正模块,用于根据所述狗脸图像和所述目标狗脸关键点组,对所述狗鼻图像进行校正,得到目标狗鼻图像;

21.鼻纹提取模块,用于将所述目标狗鼻图像输入预设的鼻纹特征提取模型,得到所述宠物狗图像中的宠物狗的鼻纹特征,并存储所述鼻纹特征。

22.第三方面,本技术实施例还提供一种计算机设备,所述计算机设备包括处理器、存储器、以及存储在所述存储器上并可被所述处理器执行的计算机程序,其中所述计算机程序被所述处理器执行时,实现如上所述的宠物狗识别方法的步骤。

23.第四方面,本技术实施例还提供一种计算机可读存储介质,所述计算机可读存储介质上存储有计算机程序,其中所述计算机程序被处理器执行时,实现如上所述的宠物狗识别方法的步骤。

24.本技术实施例提供一种基于人工智能的宠物狗识别方法、装置、设备及存储介质,该方法通过特征提取网络对宠物狗图像进行处理,可以得到多个分辨率不同的目标特征图,再通过狗脸框预测网络和多个分辨率不同的目标特征图进行狗脸框预测,通过狗脸关键点检测网络和多个分辨率不同的目标特征图进行狗脸关键点检测,同时通过狗鼻框预测网络和多个分辨率不同的目标特征图进行狗鼻框预测,可以分别得到狗脸框的第一目标位置点组、目标狗脸关键点组和狗鼻框的第二目标位置点组,以实现狗脸框、狗鼻框和狗脸关键点的同时识别,可以极大地提高狗脸框、狗鼻框和狗脸关键点的识别准确性,此外,基于宠物狗图像中的第一目标位置点组所对应的狗脸图像和目标狗脸关键点组,可以对宠物狗图像中的第二目标位置点组所对应的狗鼻图像进行准确地校正,最后将校正后的狗鼻图像输入预设的鼻纹特征提取模型,可以得到准确的鼻纹特征,极大的提高了宠物狗的识别准确性。

附图说明

25.为了更清楚地说明本技术实施例技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

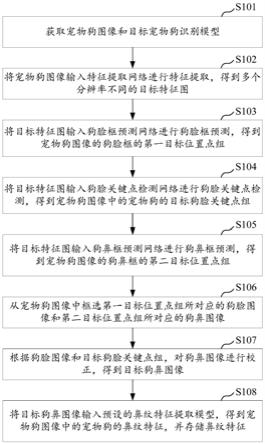

26.图1是本技术实施例提供的一种基于人工智能的宠物狗识别方法的流程示意图;

27.图2是本技术实施例中的目标宠物狗识别模型的一层级示意图;

28.图3是本技术实施例中的目标宠物狗识别模型的另一层级示意图;

29.图4是本技术实施例中的第四卷积层的一层级示意图;

30.图5是本技术实施例中的目标宠物狗识别模型的另一层级示意图;

31.图6是本技术实施例提供的一种宠物狗识别装置的示意性框图;

32.图7是本技术实施例提供的一种计算机设备的结构示意性框图。

33.本技术目的的实现、功能特点及优点将结合实施例,参阅附图做进一步说明。

具体实施方式

34.下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。

35.附图中所示的流程图仅是示例说明,不是必须包括所有的内容和操作/步骤,也不是必须按所描述的顺序执行。例如,有的操作/步骤还可以分解、组合或部分合并,因此实际执行的顺序有可能根据实际情况改变。

36.本技术实施例可以基于人工智能技术对相关的数据进行获取和处理。其中,人工智能(artificial intelligence,ai)是利用数字计算机或者数字计算机控制的机器模拟、延伸和扩展人的智能,感知环境、获取知识并使用知识获得最佳结果的理论、方法、技术及应用系统。

37.本技术实施例提供一种基于人工智能的宠物狗识别方法、装置、设备及存储介质。其中,该宠物狗识别方法可应用于终端设备或服务器,该终端设备可以手机、平板电脑、笔记本电脑、台式电脑、个人数字助理和穿戴式设备等,服务器可以是独立的服务器,也可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、内容分发网络(content delivery network,cdn)、以及大数据和人工智能平台等基础云计算服务的云服务器。

38.下面结合附图,对本技术的一些实施方式作详细说明。在不冲突的情况下,下述的实施例及实施例中的特征可以相互组合。

39.请参阅图1,图1是本技术实施例提供的一种基于人工智能的宠物狗识别方法的流程示意图。

40.如图1所示,所述基于人工智能的宠物狗识别方法可以包括步骤s101至步骤s108。

41.步骤s101、获取宠物狗图像和目标宠物狗识别模型。

42.示例性的,终端设备获取拍摄装置采集到的宠物狗图像,由终端设备基于宠物狗图像和目标宠物狗识别模型进行分类。其中,终端设备上部署有预先训练好的目标宠物狗识别模型。示例性的,终端设备获取拍摄装置采集到的宠物狗图像,并将该宠物狗图像上传至服务器,由服务器基于宠物狗图像和目标宠物狗识别模型进行分类。其中,服务器上部署有预先训练好的目标宠物狗识别模型。需要强调的是,为进一步保证上述目标宠物狗识别模型的私密和安全性,上述目标宠物狗识别模型还可以存储于一区块链的节点中。

43.如图2所示,目标宠物狗识别模型包括特征提取网络100、狗脸框预测网络200、狗脸关键点检测网络300和狗鼻框预测网络400,且特征提取网络100均与狗脸框预测网络200、狗脸关键点检测网络300和狗鼻框预测网络400连接,特征提取网络100用于将宠物狗图像转换为多个不同分辨率的特征图,狗脸框预测网络200用于融合多个不同分辨率的特

征图来预测狗脸框的多个位置点组,狗脸关键点检测网络300用于融合多个不同分辨率的特征图来检测多个狗脸关键点组,狗鼻框预测网络400用于融合多个不同分辨率的特征图来预测狗鼻框的多个位置点组。

44.其中,狗脸框的位置点组包括至少两个位置点,且至少两个位置点互为对角位置点,例如狗脸框的位置点组包括狗脸框的左上角对应的位置点和狗脸框的右下角对应的位置点。狗脸关键点组包括多个狗脸关键点,例如,狗脸关键点组包括三个狗脸关键点,且这三个狗脸关键关键点分别为宠物狗的左眼关键点、右眼关键点和狗鼻关键点。狗鼻框的位置点组包括至少两个位置点,且至少两个位置点互为对角位置点,例如狗鼻框的位置点组包括狗鼻框的左上角对应的位置点和狗鼻框的右下角对应的位置点。

45.在一实施例中,从样本数据集中获取样本数据,样本数据包括宠物样本图像、狗脸框的第一标注位置点组、第一狗脸关键点组、狗鼻框的第二标注位置点组;将宠物样本图像输入待训练的宠物狗识别模型,得到狗脸框的第一预测位置点组、第二狗脸关键点组和狗鼻框的第二预测位置点组;根据第一标注位置点组、第一预测位置点组、第一狗脸关键点组、第二狗脸关键点组、第二标注位置点组和第二预测位置点组确定模型损失值;根据模型损失值确定宠物狗识别模型是否收敛;若宠物狗识别模型未收敛,则更新宠物狗识别模型的参数;返回执行从样本数据集中获取样本数据的步骤,直至宠物狗识别模型收敛,得到目标宠物狗识别模型。

46.示例性的,将宠物样本图像输入待训练的宠物狗识别模型,得到狗脸框的第一预测位置点组、第二狗脸关键点组和狗鼻框的第二预测位置点组的方式可以为:将宠物样本图像输入特征提取网络进行特征提取,得到多个分辨率不同的特征图;将多个分辨率不同的特征图分别输入狗脸框预测网络进行狗脸框预测,得到狗脸框的多个预测位置点组和各预测位置点组的置信度,并根据狗脸框的各预测位置点组的置信度,确定狗脸框的第一预测位置点组;将多个分辨率不同的特征图分别输入狗脸关键点检测网络,得到多个狗脸关键点组和各狗脸关键点组的置信度,并根据各狗脸关键点组的置信度确定第二狗脸关键点组;将多个分辨率不同的特征图分别输入狗鼻框预测网络进行狗鼻框预测,得到狗鼻框的多个预测位置点组和各预测位置点组的置信度,并根据狗鼻框的各预测位置点组的置信度确定狗鼻框的第二预测位置点组。

47.示例性的,判断宠物样本图像中第一预测位置点组所对应的狗脸框内是否包含狗脸,并根据判断结果确定第一损失值;根据第一标注位置点组和第一预测位置点组,确定第二损失值;根据第二标注位置点组和第二预测位置点组,确定第三损失值;根据第一狗脸关键点组和第二狗脸关键点组,确定第四损失值;对第一损失值、第二损失值、第三损失值和第四损失值进行加权求和,得到模型损失值。

48.示例性的,若第一预测位置点组所对应的狗脸框中包含狗脸,则第一损失值为1,若第一预测位置点组所对应的狗脸框中不包含狗脸,则第一损失值为0。获取第一损失函数,并基于第一损失函数、第一标注位置点组和第一预测位置点组,确定第二损失值。其中,第一损失函数为:

49.50.其中,n1为狗脸框的位置点个数,x

i

为第一标注位置点组中的第i个位置点,为第一预测位置点组中的第i个位置点。

51.示例性的,根据第二标注位置点组和第二预测位置点组,确定第三损失值的方式可以为:获取第二损失函数,并根据第二损失函数、第二标注位置点组和第二预测位置点组,确定第三损失值。其中,第二损失函数为:

[0052][0053]

其中,n2为狗鼻框的位置点个数,y

j

为第二标注位置点组中的第j个位置点,为第二预测位置点组中的第j个位置点。

[0054]

示例性的,根据第一狗脸关键点和第二狗脸关键点,确定第四损失值的方式可以为:获取第三损失函数,并根据第三损失函数、第一狗脸关键点和第二狗脸关键点,确定第四损失值。其中,第三损失函数为:

[0055][0056]

其中,n3为狗脸关键点的总个数,z

p

为第一狗脸关键点组中的第p个狗脸关键点,为第二狗脸关键点组中的第p个狗脸关键点。

[0057]

示例性的,获取第一加权系数、第二加权系数、第三加权系数和第四加权系数;对第一加权系数与第一损失值进行乘法运算,得到第一加权损失值;对第二加权系数和第二损失值进行乘法运算,得到第二加权损失值;对第三加权系数和第三损失值进行乘法运算,得到第三加权损失值,对第四加权系数与预设位置损失值进行乘法运算,得到第四加权损失值;累计第一加权损失值、第二加权损失值、第三加权损失值和第四加权损失值,得到模型损失值。其中,第一加权系数、第二加权系数、第三加权系数和第四加权系数可基于实际情况进行设置,本实施例对此不做具体限定,例如,第一加权系数为280、第二加权系数为3.5、第三加权系数为7,第四加权系数为0.1。

[0058]

步骤s102、将宠物狗图像输入特征提取网络进行特征提取,得到多个分辨率不同的目标特征图。

[0059]

示例性的,多个分辨率不同的目标特征图至少包括第一目标特征图、第二目标特征图和第三目标特征图。如图3所示,特征提取网络100包括特征提取子网络101、第一卷积层102、第一上采样层103、第一拼接层104、第二卷积层105、第二上采样层106、第二拼接层107、第三卷积层108、第四卷积层109、第五卷积层110和第六卷积层111,且第一特征提取子网络101分别与第一卷积层102、第一拼接层104和第二拼接层107连接,第一卷积层102分别与第一上采样层103和第四卷积层109连接,第一上采样层103与第一拼接层104,第一拼接层104与第二卷积层105连接,第二卷积层105分别与第二上采样层106和第五卷积层110连接,第二上采样层106与第二拼接层107连接,第二拼接层107与第三卷积层108连接,第三卷积层108与第六卷积层111,第四卷积层109均与狗脸框预测网络200、狗脸关键点检测网络300和狗鼻框预测网络400连接,第五卷积层110均与狗脸框预测网络200、狗脸关键点检测网络300和狗鼻框预测网络400连接,第六卷积层111均与狗脸框预测网络200、狗脸关键点

检测网络300和狗鼻框预测网络400连接。

[0060]

示例性的,将宠物狗图像输入特征提取子网络,得到第一特征图、第二特征图和第三特征图,其中,第一特征图、第二特征图和第三特征图的分辨率不同;将第一特征图输入第一卷积层进行卷积,得到第四特征图,将第四特征图输入第四卷积层进行卷积,得到第一目标特征图;将第四特征图输入所述第一上采样层进行上采样,得到第五特征图;将第二特征图和第五特征图输入第一拼接层进行拼接,得到第一拼接特征图;将第一拼接特征图输入第二卷积层进行卷积,得到第六特征图,将第六特征图输入第五卷积层进行卷积,得到第二目标特征图;将第六特征图输入第二上采样层进行上采样,得到第七特征图;将第三特征图与第七特征图输入第二拼接层进行拼接,得到第二拼接特征图;将第二拼接特征图输入第三卷积层进行卷积,得到第八特征图,将第八特征图输入第六卷积层进行卷积,得到第三目标特征图。

[0061]

示例性的,第四卷积层、第五卷积层和第六卷积层包含的层级相同。例如,如图4所示,第四卷积层109包括第一卷积子层1091、第二卷积子层1092、第三卷积子层1093、第四卷积子层1094和拼接子层1095,且第一卷积层102与第一卷积子层1091和第二卷积子层1092连接,第一卷积子层1091与拼接子层1095连接,第二卷积子层1092与第三卷积子层1093和第四卷积子层1094连接,第三卷积子层1093和第四卷积子层1094均与拼接子层1095连接。其中,第一卷积子层1091、第二卷积子层1092、第三卷积子层1093和第四卷积子层1094的卷积核大小均为3

×

3。

[0062]

示例性的,将第四特征图输入第四卷积层进行卷积,得到第一目标特征图的方式可以为:将第四特征图输入第一卷积子层进行卷积得到第一候选特征图,将第四特征图输入第二卷积子层进行卷积得到第二候选特征图;将第二候选特征图输入第三卷积子层进行卷积得到第三候选特征图;将第二候选特征图输入第四卷积子层进行卷积得到第四候选特征图;将第一候选特征图、第三候选特征图和第四候选特征图输入拼接子层进行拼接,得到第一目标特征图。

[0063]

示例性的,特征提取子网络可以为resnet50网络。例如,如图5所示,特征提取子网络包括第五卷积子层1011、第一残差块层1012、第二残差块层1013、第三残差块层1014和第四残差块层1015,第四残差块层1015与第一卷积层102连接,第三残差块层1014与第一拼接层104连接,第二残差块层1013与第二拼接层104连接。

[0064]

示例性的,将宠物狗图像的尺寸调整为预设尺寸,得到目标宠物狗图像;将目标宠物狗图像输入第五卷积子层进行卷积,得到第五候选特征图;将第五候选特征图输入第一残差块层进行卷积,得到第六候选特征图;将第六候选特征图输入第二残差块层进行卷积,得到第三特征图;将第三特征图输入第三残差块层进行卷积,得到第二特征图;将第二特征图输入第四残差块层进行卷积,得到第一特征图。其中,预设尺寸可基于实际情况进行设置,本实施例对此不做具体限定。例如,预设尺寸为544

×

544。

[0065]

步骤s103、将目标特征图输入狗脸框预测网络进行狗脸框预测,得到宠物狗图像的狗脸框的第一目标位置点组。

[0066]

示例性的,将多个分辨率不同的目标特征图分别输入狗脸框预测网络进行狗脸框预测,得到狗脸框的多个第一位置点组和每个第一位置点组的第一置信度,并根据第一置信度和多个第一位置点组确定狗脸框的第一目标位置点组。其中,多个分辨率不同的目标

特征图可以包括第一目标特征图、第二目标特征图和第三目标特征图。

[0067]

示例性的,将第一目标特征图输入狗脸框预测网络进行狗脸框预测,得到狗脸框的第一预测结果;将第二目标特征图输入狗脸框预测网络进行狗脸框预测,得到狗脸框的第二预测结果;将第三目标特征图输入狗脸框预测网络进行狗脸框预测,得到狗脸框的第三预测结果;对第一预测结果、第二预测结果和第三预测结果进行汇总,得到狗脸框的多个第一位置点组和每个第一位置点组的第一置信度。其中,第一目标位置点组包括狗脸框的至少两个位置点,第一预测结果、第二预测结果和第三预测结果均包括狗脸框的多个位置点组和每个位置点组的置信度。

[0068]

示例性的,将多个第一位置点组中的第一置信度最大的第一位置点组确定为狗脸框的第一目标位置点组。或者,从多个第一位置点组中选择第一置信度大于或等于第一置信度阈值的第一位置点组作为第一候选位置点组;根据各第一候选位置点组的第一置信度,计算第一平均置信度;确定第一平均置信度与各第一候选位置点组的第一置信度之间的第一置信度差值;将第一置信度差值最小所对应的第一候选位置点组确定为狗脸框的第一目标位置点组。其中,第一置信度阈值可基于实际情况进行设置,本实施例对此不做具体限定。

[0069]

示例性的,根据各第一候选位置点组的坐标信息,确定第一平均坐标信息;根据第一平均坐标信息,确定第一目标位置点组。例如,第一候选位置点组a的坐标信息可以为(x1,y1,x2,y2),第二候选位置点组b的坐标信息为(x3,y3,x4,y4),则第一平均坐标信息为((x1+x3)/2,(y1+y3)/2,(x2+x4)/2,(y2+y4)/2),因此,可以将位置点((x1+x3)/2,(y1+y3)/2)和位置点((x2+x4)/2,(y2+y4)/2)确定为狗脸框的第一目标位置点组。

[0070]

步骤s104、将目标特征图输入狗脸关键点检测网络进行狗脸关键点检测,得到宠物狗图像中的宠物狗的目标狗脸关键点组。

[0071]

示例性的,将多个分辨率不同的目标特征图分别输入狗脸关键点检测网络进行狗脸关键点检测,得到多个狗脸关键点组和每个狗脸关键点组的第二置信度,并根据第二置信度和多个狗脸关键点组确定宠物狗图像中的宠物狗的目标狗脸关键点组。

[0072]

示例性的,将第一目标特征图输入狗脸关键点检测网络进行狗脸关键点检测,得到第一输出结果;将第二目标特征图输入狗脸关键点检测网络进行狗脸关键点检测,得到第二输出结果;将第三目标特征图输入狗脸关键点检测网络进行狗脸关键点检测,得到第三输出结果;对第一输出结果、第二输出结果和第三输出结果进行汇总,得到多个狗脸关键点组和每个狗脸关键点组的第二置信度。其中,目标狗脸关键点组包括多个狗脸关键点,第一输出结果、第二输出结果和第三输出结果均包括多个狗脸关键点组和每个狗脸关键点组的置信度。

[0073]

示例性的,将多个狗脸关键点组中的第二置信度最高所对应的狗脸关键点组确定为目标狗脸关键点组。或者,将多个狗脸关键点组中的第二置信度大于或等于第二置信度阈值的狗脸关键点组确定为候选狗脸关键点组;根据各候选狗脸关键点组的第二置信度,计算第二平均置信度,并确定第二平均置信度与各候选狗脸关键点组的第二置信度之间的第二置信度差值;将第二置信度差值最小所对应的候选狗脸关键点组确定为目标狗脸关键点组。其中,第二置信度阈值可基于实际情况进行设置,本实施例对此不做具体限定。

[0074]

示例性的,根据各候选狗脸关键点组的坐标信息,确定第二平均坐标信息;根据第

二平均坐标信息,确定目标狗脸关键点组。例如,候选狗脸关键点组a中的左眼关键点、右眼关键点和鼻部关键点的坐标分别为(x

l_eye1

,y

l_eye1

)、(x

r_eye1

,y

r_eye1

)和(x

nose1

,y

nose1

),候选狗脸关键点组b中的左眼关键点、右眼关键点和鼻部关键点的坐标分别为(x

l_eye2

,y

l_eye2

)、(x

r_eye2

,y

r_eye2

)和(x

nose2

,y

nose2

),则通过候选狗脸关键点组a和候选狗脸关键点组b的坐标信息,计算得到第二平均坐标信息((x

l_eye1+

x

l_eye2

)/2,(y

l_eye1+

y

l_eye2

)/2),((x

r_eye1+

x

r_eye2

)/2,(y

r_eye1+

y

r_eye2

)/2),((x

nose1+

x

nose2

)/2,(y

nose1+

y

nose2

)/2),因此,将关键点((x

l_eye1+

x

l_eye2

)/2,(y

l_eye1+

y

l_eye2

)/2)、关键点((x

r_eye1+

x

r_eye2

)/2,(y

r_eye1+

y

r_eye2

)/2)和关键点((x

nose1+

x

nose2

)/2,(y

nose1+

y

nose2

)/2)确定为目标狗脸关键点组。

[0075]

步骤s105、将目标特征图输入狗鼻框预测网络进行狗鼻框预测,得到宠物狗图像的狗鼻框的第二目标位置点组。

[0076]

示例性的,将多个分辨率不同的目标特征图分别输入狗鼻框预测网络进行狗鼻框预测,得到狗鼻框的多个第二位置点组和每个第二位置点组的第三置信度,并根据第三置信度和多个第二位置点组确定狗鼻框的第二目标位置点组。

[0077]

示例性的,将第一目标特征图输入狗鼻框预测网络进行狗脸框预测,得到第一狗鼻框预测结果;将第二目标特征图输入狗鼻框预测网络进行狗脸框预测,得到第二狗鼻框预测结果;将第三目标特征图输入狗鼻框预测网络进行狗脸框预测,得到第三狗鼻框预测结果;对第一狗鼻框预测结果、第二狗鼻框预测结果和第三狗鼻框预测结果进行汇总,得到狗鼻框的多个第二位置点组和每个第二位置点组的第三置信度。其中,第二目标位置点组包括狗鼻框的至少两个位置点,第一狗鼻框预测结果、第二狗鼻框预测结果和第三狗鼻框预测结果均包括狗鼻框的多个位置点组和每个位置点组的第三置信度。

[0078]

示例性的,将多个第二位置点组中的第三置信度最大的第二位置点组确定为狗鼻框的第二目标位置点组。或者,从多个第二位置点组中获取第三置信度大于或等于第三置信度阈值的第二位置点组作为第二候选位置点组;根据各第二候选位置点组的第三置信度,计算第三平均置信度,并确定第三平均置信度与每个第二候选位置点组的第三置信度之间的第三置信度差值;将第三置信度差值最小所对应的第二候选位置点组确定为狗鼻框的第二目标位置点组。其中,第三置信度阈值可基于实际情况进行设置,本实施例对此不做具体限定。

[0079]

示例性的,根据各第二候选位置点组的坐标信息确定第三平均坐标信息;根据第三平均坐标信息,确定第二目标位置点组。例如,第二候选位置点组c的坐标信息为(x5,y5,x6,y6),第二候选位置点组d的坐标信息为(x7,y7,x8,y8),则可以计算得到第三平均坐标信息为((x5+x7)/2,(y5+y7)/2,(x6+x8)/2,(y6+y8)/2),因此,可以将位置点((x5+x7)/2,(y5+y7)/2)和位置点((x6+x8)/2,(y6+y8)/2)确定为狗鼻框的第二目标位置点组。

[0080]

步骤s106、从宠物狗图像中框选第一目标位置点组所对应的狗脸图像和第二目标位置点组所对应的狗鼻图像。

[0081]

示例性的,在宠物狗图像中标记第一目标位置点组所对应的图像区域,并从该宠物狗图像中裁剪标记的图像区域,得到狗脸图像;在宠物狗图像中标记第二目标位置点组所对应的图像区域,并从该宠物狗图像中裁剪标记的图像区域,得到狗鼻图像。

[0082]

步骤s107、根据狗脸图像和目标狗脸关键点组,对狗鼻图像进行校正,得到目标狗鼻图像。

[0083]

示例性的,将狗脸图像输入预设的宠物狗分类模型,得到宠物狗类型,其中,该宠物狗分类模型是预先训练好的神经网络模型;获取该宠物狗类型对应的标准狗脸图像,并根据标准狗脸图像和目标狗脸关键点组,确定仿射变换矩阵;根据仿射变换矩阵,对狗鼻图像进行校正,得到目标狗鼻图像,即根据仿射变换矩阵,计算狗鼻图像中每个像素点经过仿射变换后的仿射变换坐标,且基于每个像素点的仿射变换坐标,对该狗鼻图像进行校正,得到目标狗鼻图像。其中,宠物狗类型可以包括阿拉斯加、斑点狗、比熊、博美、斗牛犬、金毛、哈士奇、柯基、拉布拉多和雪纳瑞等。

[0084]

其中,标准狗脸图像中标记有多个狗脸关键点,且标准狗脸图像中的狗脸正向,没有发生倾斜。

[0085]

仿射变换的公式具体为:

[0086][0087]

其中,θ

x

和θ

y

为旋转角度,t

x

和t

y

为坐标偏移量,(x

sp

,y

sp

)为该狗鼻图像中的像素点的坐标,(x

′

,y

′

)为(x

sp

,y

sp

)经仿射变换后的坐标,基于标准狗脸图像中的多个狗脸关键点和目标狗脸关键点组,可以计算得到旋转角度θ

x

和θ

y

,坐标偏移量t

x

和t

y

,通过旋转角度θ

x

和θ

y

,坐标偏移量t

x

和t

y

,可以确定仿射变换矩阵。

[0088]

其中,宠物狗分类模型的训练方式可以为:获取分类样本数据,其中,该分类样本数据包括狗脸样本图像和标注的第一宠物狗类型,狗脸样本图像包含有宠物狗的面部;将该狗脸样本图像输入预设的第一神经网络模型进行处理,得到预测的第二宠物狗类型;根据第一宠物狗类型和第二宠物狗类型确定模型损失值,并根据该模型损失值确定第一神经网络模型是否收敛,若第一神经网络模型未收敛,则更新第一神经网络模型的参数,并继续获取新的分类样本数据,以继续对更新后的第一神经网络模型进行训练,直至第一神经网络模型收敛,从而得到宠物狗分类模型。

[0089]

步骤s108、将目标狗鼻图像输入预设的鼻纹特征提取模型,得到宠物狗图像中的宠物狗的鼻纹特征,并存储鼻纹特征。

[0090]

其中,预设的鼻纹特征提取模型为预先训练好的神经网络模型,其训练过程可以为:获取狗鼻样本数据,其中,狗鼻样本数据包括狗鼻样本图像和标注的第一鼻纹特征,狗鼻样本图像包含有宠物狗的狗鼻;将狗鼻样本图像输入预设的第二神经网络模型,得到预测的第二鼻纹特征;根据第一鼻纹特征和第二鼻纹特征确定模型损失值,并根据模型损失值确定第二神经网络模型是否收敛,若第二神经网络模型未收敛,则重新获取狗鼻样本数据,并基于新的狗鼻样本数据对更新后的第二神经网络模型进行训练,直至第二神经网络模型收敛,从而得到鼻纹特征提取模型。

[0091]

上述实施例提供的宠物狗识别方法,通过特征提取网络对宠物狗图像进行处理,可以得到多个分辨率不同的目标特征图,再通过狗脸框预测网络和多个分辨率不同的目标特征图进行狗脸框预测,通过狗脸关键点检测网络和多个分辨率不同的目标特征图进行狗脸关键点检测,同时通过狗鼻框预测网络和多个分辨率不同的目标特征图进行狗鼻框预测,可以分别得到狗脸框的第一目标位置点组、目标狗脸关键点组和狗鼻框的第二目标位置点组,以实现狗脸框、狗鼻框和狗脸关键点的同时识别,可以极大地提高狗脸框、狗鼻框

和狗脸关键点的识别准确性,此外,基于宠物狗图像中的第一目标位置点组所对应的狗脸图像和目标狗脸关键点组,可以对宠物狗图像中的第二目标位置点组所对应的狗鼻图像进行准确地校正,最后将校正后的狗鼻图像输入预设的鼻纹特征提取模型,可以得到准确的鼻纹特征,极大的提高了宠物狗的识别准确性。

[0092]

请参阅图6,图6是本技术实施例提供的一种宠物狗识别装置的示意性框图。

[0093]

如图6所示,所述宠物狗识别装置500包括:

[0094]

获取模块510,用于获取宠物狗图像和目标宠物狗识别模型,所述目标宠物狗识别模型包括特征提取网络、狗脸框预测网络、狗脸关键点检测网络和狗鼻框预测网络;

[0095]

特征提取模块520,用于将所述宠物狗图像输入所述特征提取网络进行特征提取,得到多个分辨率不同的目标特征图;

[0096]

狗脸框预测模块530,用于将所述目标特征图输入所述狗脸框预测网络进行狗脸框预测,得到所述宠物狗图像的狗脸框的第一目标位置点组;

[0097]

狗脸关键点检测模块540,用于将所述目标特征图输入所述狗脸关键点检测网络进行狗脸关键点检测,得到所述宠物狗图像中的宠物狗的目标狗脸关键点组;

[0098]

狗鼻框预测模块550,用于将所述目标特征图输入所述狗鼻框预测网络进行狗鼻框预测,得到所述宠物狗图像的狗鼻框的第二目标位置点组;

[0099]

所述获取模块510,还用于从所述宠物狗图像中框选所述第一目标位置点组所对应的狗脸图像和所述第二目标位置点组所对应的狗鼻图像;

[0100]

校正模块560,用于根据所述狗脸图像和所述目标狗脸关键点组,对所述狗鼻图像进行校正,得到目标狗鼻图像;

[0101]

鼻纹提取模块570,用于将所述目标狗鼻图像输入预设的鼻纹特征提取模型,得到所述宠物狗图像中的宠物狗的鼻纹特征,并存储所述鼻纹特征。

[0102]

在一实施例中,所述特征提取网络包括特征提取子网络、第一卷积层、第一上采样层、第一拼接层、第二卷积层、第二上采样层、第二拼接层、第三卷积层、第四卷积层、第五卷积层、第六卷积层,所述特征提取模块520还用于:

[0103]

将所述宠物狗图像输入所述特征提取子网络,得到分辨率不同的第一特征图、第二特征图和第三特征图;

[0104]

将所述第一特征图输入所述第一卷积层进行卷积,得到第四特征图,将所述第四特征图输入所述第四卷积层进行卷积,得到第一目标特征图;

[0105]

将所述第四特征图输入所述第一上采样层进行上采样,得到第五特征图;

[0106]

将所述第二特征图和所述第五特征图输入所述第一拼接层进行拼接,得到第一拼接特征图;

[0107]

将所述第一拼接特征图输入所述第二卷积层进行卷积,得到第六特征图,将所述第六特征图输入所述第五卷积层进行卷积,得到第二目标特征图;

[0108]

将所述第六特征图输入所述第二上采样层进行上采样,得到第七特征图;

[0109]

将所述第三特征图与所述第七特征图输入所述第二拼接层进行拼接,得到第二拼接特征图;

[0110]

将所述第二拼接特征图输入所述第三卷积层进行卷积,得到第八特征图,将所述第八特征图输入所述第六卷积层进行卷积,得到第三目标特征图。

[0111]

在一实施例中,所述第四卷积层包括第一卷积子层、第二卷积子层、第三卷积子层、第四卷积子层和拼接子层,所述特征提取模块520还用于:

[0112]

将所述第四特征图输入所述第一卷积子层进行卷积得到第一候选特征图,将所述第四特征图输入所述第二卷积子层进行卷积得到第二候选特征图;

[0113]

将所述第二候选特征图输入所述第三卷积子层进行卷积得到第三候选特征图;

[0114]

将所述第二候选特征图输入所述第四卷积子层进行卷积得到第四候选特征图;

[0115]

将所述第一候选特征图、所述第三候选特征图和所述第四候选特征图输入所述拼接子层进行拼接,得到第一目标特征图。

[0116]

在一实施例中,所述校正模块560还用于:

[0117]

将所述狗脸图像输入预设的宠物狗分类模型,得到宠物狗类型,其中,所述宠物狗分类模型是预先训练好的神经网络模型;

[0118]

获取所述宠物狗类型对应的标准狗脸图像,并根据所述标准狗脸图像和所述目标狗脸关键点组,确定仿射变换矩阵;

[0119]

根据所述仿射变换矩阵,对所述狗鼻图像进行校正,得到目标狗鼻图像。

[0120]

在一实施例中,所述宠物狗识别装置500还包括模型训练模块,所述模型训练模块用于:

[0121]

从样本数据集中获取样本数据,所述样本数据包括宠物样本图像、狗脸框的第一标注位置点组、第一狗脸关键点组、狗鼻框的第二标注位置点组;

[0122]

将所述宠物样本图像输入待训练的宠物狗识别模型,得到狗脸框的第一预测位置点组、第二狗脸关键点组和狗鼻框的第二预测位置点组;

[0123]

根据所述第一标注位置点组、第一预测位置点组、第一狗脸关键点组、第二狗脸关键点组、第二标注位置点组和第二预测位置点组确定模型损失值;

[0124]

根据所述模型损失值确定所述宠物狗识别模型是否收敛;

[0125]

若所述宠物狗识别模型未收敛,则更新所述宠物狗识别模型的参数;

[0126]

返回执行所述从样本数据集中获取样本数据的步骤,直至所述宠物狗识别模型收敛,得到目标宠物狗识别模型。

[0127]

在一实施例中,所述模型训练模块还用于:

[0128]

判断所述宠物样本图像中所述第一预测位置点组所对应的狗脸框内是否包含狗脸,并根据判断结果确定第一损失值;

[0129]

根据所述第一标注位置点组和所述第一预测位置点组,确定第二损失值;

[0130]

根据所述第二标注位置点组和所述第二预测位置点组,确定第三损失值;

[0131]

根据所述第一狗脸关键点组和所述第二狗脸关键点组,确定第四损失值;

[0132]

对所述第一损失值、所述第二损失值、所述第三损失值和所述第四损失值进行加权求和,得到模型损失值。

[0133]

在一实施例中,所述模型训练模块还用于:

[0134]

获取第一损失函数,其中,所述第一损失函数为:

[0135]

n1为狗脸框的位置点个数,x

i

为所述第一标

注位置点组中的第i个位置点,为所述第一预测位置点组中的第i个位置点;

[0136]

基于所述第一损失函数、所述第一标注位置点组和所述第一预测位置点组,确定第二损失值。

[0137]

需要说明的是,所属领域的技术人员可以清楚地了解到,为了描述的方便和简洁,上述描述的装置和各模块及单元的具体工作过程,可以参考前述宠物狗识别方法实施例中的对应过程,在此不再赘述。

[0138]

上述实施例提供的装置可以实现为一种计算机程序的形式,该计算机程序可以在如图7所示的计算机设备上运行。

[0139]

请参阅图7,图7是本技术实施例提供的一种计算机设备的结构示意性框图。该计算机设备可以为服务器或终端设备。

[0140]

如图7所示,该计算机设备包括通过系统总线连接的处理器、存储器和网络接口,其中,存储器可以包括存储介质和内存储器。

[0141]

存储介质可存储操作系统和计算机程序。该计算机程序包括程序指令,该程序指令被执行时,可使得处理器执行任意一种宠物狗识别方法。

[0142]

处理器用于提供计算和控制能力,支撑整个计算机设备的运行。

[0143]

该网络接口用于进行网络通信,如发送分配的任务等。本领域技术人员可以理解,图7中示出的结构,仅仅是与本技术方案相关的部分结构的框图,并不构成对本技术方案所应用于其上的计算机设备的限定,具体的计算机设备可以包括比图中所示更多或更少的部件,或者组合某些部件,或者具有不同的部件布置。

[0144]

应当理解的是,处理器可以是中央处理单元(central processing unit,cpu),该处理器还可以是其他通用处理器、数字信号处理器(digital signal processor,dsp)、专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field

‑

programmable gate array,fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等。其中,通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。

[0145]

其中,在一实施例中,所述处理器用于运行存储在存储器中的计算机程序,以实现如下步骤:

[0146]

获取宠物狗图像和目标宠物狗识别模型,所述目标宠物狗识别模型包括特征提取网络、狗脸框预测网络、狗脸关键点检测网络和狗鼻框预测网络;

[0147]

将所述宠物狗图像输入所述特征提取网络进行特征提取,得到多个分辨率不同的目标特征图;

[0148]

将所述目标特征图输入所述狗脸框预测网络进行狗脸框预测,得到所述宠物狗图像的狗脸框的第一目标位置点组;

[0149]

将所述目标特征图输入所述狗脸关键点检测网络进行狗脸关键点检测,得到所述宠物狗图像中的宠物狗的目标狗脸关键点组;

[0150]

将所述目标特征图输入所述狗鼻框预测网络进行狗鼻框预测,得到所述宠物狗图像的狗鼻框的第二目标位置点组;

[0151]

从所述宠物狗图像中框选所述第一目标位置点组所对应的狗脸图像和所述第二目标位置点组所对应的狗鼻图像;

[0152]

根据所述狗脸图像和所述目标狗脸关键点组,对所述狗鼻图像进行校正,得到目标狗鼻图像;

[0153]

将所述目标狗鼻图像输入预设的鼻纹特征提取模型,得到所述宠物狗图像中的宠物狗的鼻纹特征,并存储所述鼻纹特征。

[0154]

在一实施例中,所述特征提取网络包括特征提取子网络、第一卷积层、第一上采样层、第一拼接层、第二卷积层、第二上采样层、第二拼接层、第三卷积层、第四卷积层、第五卷积层、第六卷积层,所述处理器在实现将所述宠物狗图像输入所述特征提取网络进行特征提取,得到多个分辨率不同的目标特征图时,用于实现:

[0155]

将所述宠物狗图像输入所述特征提取子网络,得到分辨率不同的第一特征图、第二特征图和第三特征图;

[0156]

将所述第一特征图输入所述第一卷积层进行卷积,得到第四特征图,将所述第四特征图输入所述第四卷积层进行卷积,得到第一目标特征图;

[0157]

将所述第四特征图输入所述第一上采样层进行上采样,得到第五特征图;

[0158]

将所述第二特征图和所述第五特征图输入所述第一拼接层进行拼接,得到第一拼接特征图;

[0159]

将所述第一拼接特征图输入所述第二卷积层进行卷积,得到第六特征图,将所述第六特征图输入所述第五卷积层进行卷积,得到第二目标特征图;

[0160]

将所述第六特征图输入所述第二上采样层进行上采样,得到第七特征图;

[0161]

将所述第三特征图与所述第七特征图输入所述第二拼接层进行拼接,得到第二拼接特征图;

[0162]

将所述第二拼接特征图输入所述第三卷积层进行卷积,得到第八特征图,将所述第八特征图输入所述第六卷积层进行卷积,得到第三目标特征图。

[0163]

在一实施例中,所述第四卷积层包括第一卷积子层、第二卷积子层、第三卷积子层、第四卷积子层和拼接子层,所述处理器在实现将所述第四特征图输入所述第四卷积层进行卷积,得到第一目标特征图时,用于实现:

[0164]

将所述第四特征图输入所述第一卷积子层进行卷积得到第一候选特征图,将所述第四特征图输入所述第二卷积子层进行卷积得到第二候选特征图;

[0165]

将所述第二候选特征图输入所述第三卷积子层进行卷积得到第三候选特征图;

[0166]

将所述第二候选特征图输入所述第四卷积子层进行卷积得到第四候选特征图;

[0167]

将所述第一候选特征图、所述第三候选特征图和所述第四候选特征图输入所述拼接子层进行拼接,得到第一目标特征图。

[0168]

在一实施例中,所述处理器在实现根据所述狗脸图像和所述目标狗脸关键点组,对所述狗鼻图像进行校正,得到目标狗鼻图像时,用于实现:

[0169]

将所述狗脸图像输入预设的宠物狗分类模型,得到宠物狗类型,其中,所述宠物狗分类模型是预先训练好的神经网络模型;

[0170]

获取所述宠物狗类型对应的标准狗脸图像,并根据所述标准狗脸图像和所述目标狗脸关键点组,确定仿射变换矩阵;

[0171]

根据所述仿射变换矩阵,对所述狗鼻图像进行校正,得到目标狗鼻图像。

[0172]

其中,在另一实施例中,所述处理器用于运行存储在存储器中的计算机程序,以实

现如下步骤:

[0173]

从样本数据集中获取样本数据,所述样本数据包括宠物样本图像、狗脸框的第一标注位置点组、第一狗脸关键点组、狗鼻框的第二标注位置点组;

[0174]

将所述宠物样本图像输入待训练的宠物狗识别模型,得到狗脸框的第一预测位置点组、第二狗脸关键点组和狗鼻框的第二预测位置点组;

[0175]

根据所述第一标注位置点组、第一预测位置点组、第一狗脸关键点组、第二狗脸关键点组、第二标注位置点组和第二预测位置点组确定模型损失值;

[0176]

根据所述模型损失值确定所述宠物狗识别模型是否收敛;

[0177]

若所述宠物狗识别模型未收敛,则更新所述宠物狗识别模型的参数;

[0178]

返回执行所述从样本数据集中获取样本数据的步骤,直至所述宠物狗识别模型收敛,得到目标宠物狗识别模型。

[0179]

在一实施例中,所述处理器在实现根据所述第一标注位置点组、第一预测位置点组、第一狗脸关键点组、第二狗脸关键点组、第二标注位置点组和第二预测位置点组确定模型损失值时,用于实现:

[0180]

判断所述宠物样本图像中所述第一预测位置点组所对应的狗脸框内是否包含狗脸,并根据判断结果确定第一损失值;

[0181]

根据所述第一标注位置点组和所述第一预测位置点组,确定第二损失值;

[0182]

根据所述第二标注位置点组和所述第二预测位置点组,确定第三损失值;

[0183]

根据所述第一狗脸关键点组和所述第二狗脸关键点组,确定第四损失值;

[0184]

对所述第一损失值、所述第二损失值、所述第三损失值和所述第四损失值进行加权求和,得到模型损失值。

[0185]

在一实施例中,所述处理器在实现根据所述第一标注位置点组和所述第一预测位置点组,确定第二损失值时,用于实现:

[0186]

获取第一损失函数,其中,所述第一损失函数为:

[0187]

n1为狗脸框的位置点个数,x

i

为所述第一标注位置点组中的第i个位置点,为所述第一预测位置点组中的第i个位置点;

[0188]

基于所述第一损失函数、所述第一标注位置点组和所述第一预测位置点组,确定第二损失值。

[0189]

需要说明的是,所属领域的技术人员可以清楚地了解到,为了描述的方便和简洁,上述描述的计算机设备的具体工作过程,可以参考前述宠物狗识别方法实施例中的对应过程,在此不再赘述。

[0190]

通过以上的实施方式的描述可知,本领域的技术人员可以清楚地了解到本技术可借助软件加必需的通用硬件平台的方式来实现。基于这样的理解,本技术的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在存储介质中,如rom/ram、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本技术各个实施例或者实施例的某些部分所述的方法。

[0191]

本技术实施例还提供一种计算机可读存储介质,所述计算机可读存储介质上存储有计算机程序,所述计算机程序中包括程序指令,所述程序指令被执行时所实现的方法可参阅本技术宠物狗识别方法的各个实施例。

[0192]

其中,所述计算机可读存储介质可以是易失性的,也可以是非易失性的。所述计算机可读存储介质可以是前述实施例所述的计算机设备的内部存储单元,例如所述计算机设备的硬盘或内存。所述计算机可读存储介质也可以是所述计算机设备的外部存储设备,例如所述计算机设备上配备的插接式硬盘,智能存储卡(smart media card,smc),安全数字(secure digital,sd)卡,闪存卡(flash card)等。

[0193]

进一步地,所述计算机可读存储介质可主要包括存储程序区和存储数据区,其中,存储程序区可存储操作系统、至少一个功能所需的应用程序等;存储数据区可存储根据区块链节点的使用所创建的数据等。

[0194]

本技术所指区块链是分布式数据存储、点对点传输、共识机制、加密算法等计算机技术的新型应用模式。区块链(blockchain),本质上是一个去中心化的数据库,是一串使用密码学方法相关联产生的数据块,每一个数据块中包含了一批次网络交易的信息,用于验证其信息的有效性(防伪)和生成下一个区块。区块链可以包括区块链底层平台、平台产品服务层以及应用服务层等。

[0195]

应当理解,在此本技术说明书中所使用的术语仅仅是出于描述特定实施例的目的而并不意在限制本技术。如在本技术说明书和所附权利要求书中所使用的那样,除非上下文清楚地指明其它情况,否则单数形式的“一”、“一个”及“该”意在包括复数形式。

[0196]

还应当理解,在本技术说明书和所附权利要求书中使用的术语“和/或”是指相关联列出的项中的一个或多个的任何组合以及所有可能组合,并且包括这些组合。需要说明的是,在本文中,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者系统不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者系统所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括该要素的过程、方法、物品或者系统中还存在另外的相同要素。

[0197]

上述本技术实施例序号仅仅为了描述,不代表实施例的优劣。以上所述,仅为本技术的具体实施方式,但本技术的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本技术揭露的技术范围内,可轻易想到各种等效的修改或替换,这些修改或替换都应涵盖在本技术的保护范围之内。因此,本技术的保护范围应以权利要求的保护范围为准。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1