图像融合方法、计算机程序产品、存储介质及电子设备与流程

1.本发明涉及图像处理技术领域,具体而言,涉及一种图像融合方法、计算机程序产品、存储介质及电子设备。

背景技术:

2.当强光源照射下的高亮度区域及阴影、逆光等相对亮度较低的区域在拍摄场景中同时存在时,摄像机采集的图像往往会出现明亮区域因曝光过度成为白色,而黑暗区域因曝光不足而成为黑色的现象,该现象将严重影响图像质量。摄像机在同一场景中对最亮区域及较暗区域的表现是存在局限的,这种局限就是通常所讲的“动态范围”。

3.高动态范围(high-dynamic range,简称hdr),是一种在拍摄场景中存在强烈亮度对比的情况下让图像尽量还原出场景中的细节的技术。该技术的一种典型的应用是:利用特定的融合算法,将针对同一场景采集的多帧曝光程度不同的图像,通过加权融合的方式合成一帧hdr图像,使得该hdr图像无论在高光部分还是阴影部分都有着良好的细节表现。

4.然而,现有融合算法所选择的权重往往缺乏鲁棒性,导致在待融合图像的曝光程度跨度较大时,所合成的图像容易出现画面发灰、缺少细节等问题,无法实现真正的hdr效果。

技术实现要素:

5.本技术实施例的目的在于提供一种图像融合方法、计算机程序产品、存储介质及电子设备,以改善上述技术问题。

6.为实现上述目的,本技术提供如下技术方案:

7.第一方面,本技术一种图像融合方法,包括:获取曝光程度不完全相同的n帧待融合图像;其中,n为大于1的整数,每帧待融合图像均包括至少一个通道,所述至少一个通道中包括目标通道;对所述n帧待融合图像中属于同一通道的n帧通道图像进行融合,得到至少一帧通道融合图像,并根据所述至少一帧通道融合图像确定融合结果图像;其中,对于所述n帧待融合图像中属于同一目标通道的n帧通道图像,通过以下步骤计算其对应的通道融合图像:利用预训练的神经网络模型中的主干网络提取所述n帧通道图像的基础特征图,并将所述基础特征图拆分为n帧子特征图;利用所述神经网络模型中的n个分支网络计算所述n帧通道图像对应的n帧融合掩膜;其中,每个分支网络用于根据一帧子特征图计算一帧通道图像对应的一帧融合掩膜,每帧融合掩膜中包括对应的一帧通道图像融合用的权重;利用所述n帧融合掩膜对所述n帧通道图像进行加权融合,得到所述通道融合图像。

8.上述方法在融合目标通道的通道图像时,利用神经网络模型来计算融合用的权重(融合掩膜),由于神经网络模型是通过训练数据训练得到的,并非是一种根据经验确定的预设规则,因此计算出的权重具有较好的鲁棒性,有利于改善在待融合图像的曝光程度跨度较大时,所得到的融合结果图像(hdr图像)的质量,避免其出现画面发灰、缺少细节等现象。

9.另外,该方法中使用的神经网络模型分为主干网络和分支网络两部分,主干网络是n帧通道图像共用的,从而有利于促进帧间信息交流,提升融合掩膜的精度,而每个分支网络则用于计算一帧通道图像对应的融合掩膜,从而有利于针对该帧通道图像进行参数优化,同样能够提升融合掩膜的精度。计算出的融合掩膜精度越高,进行融合的效果自然也就越好。

10.在第一方面的一种实现方式中,所述主干网络为具有注意力机制的网络,所述主干网络具有的注意力机制包括通道注意力、帧注意力以及空间注意力中的至少一种;和/或,所述分支网络为具有注意力机制的网络,所述分支网络具有的注意力机制包括通道注意力以及空间注意力中的至少一种;其中,所述通道注意力是指对特征图的不同通道中的数据赋予相应的权重,所述帧注意力是指对特征图的不同帧中的数据赋予相应的权重,所述空间注意力是指对特征图的不同空间位置处的数据赋予相应的权重。

11.在上述实现方式中,通过在神经网络中加入不同的注意力机制,有利于改善计算出的融合掩膜的精度。

12.在第一方面的一种实现方式中,所述主干网络包括多注意力模块,所述多注意力模块包括依次连接的通道注意力单元以及帧注意力单元;其中,所述通道注意力单元用于计算所述多注意力模块的输入特征图在通道维度的权重,并将计算出的权重与所述多注意力模块的输入特征图的不同通道中的数据相乘,得到所述通道注意力单元的输出特征图;所述帧注意力单元用于对所述通道注意力单元的输出特征图中的通道维度和帧维度进行转置,计算转置后的特征图在通道维度的权重,将计算出的权重与所述转置后的特征图的不同通道中的数据相乘,得到加权后的特征图,并对所述加权后的特征图中的通道维度和帧维度进行转置,得到所述多注意力模块的输出特征图。

13.上述实现方式中的多注意力模块包含了通道注意力和帧注意力,从而有利于强化通道间及帧间信息交流和共享,加强帧间的联系,进而改善计算出的融合掩膜的精度。

14.在第一方面的一种实现方式中,所述分支网络包括多感受野模块,所述多感受野模块包括m个特征提取分支以及特征融合单元;其中,m为大于1的整数,每个特征提取分支均用于对所述多感受野模块的输入特征图进行特征提取以得到自身的输出特征图,且各个特征提取分支对应的感受野不同,所述特征融合单元用于对所述m个特征提取分支的输出特征图进行融合,得到所述多感受野模块的输出特征图。

15.上述实现方式中的多感受野模块由于包含了多个对应不同感受野的特征提取分支,因此有利于提升空间信息的一致性,防止通道融合图像中出现融合分层(即图像画面不连续、出现断层)的现象。

16.在第一方面的一种实现方式中,所述m个特征提取分支中的至少m-1个特征提取分支包括空洞卷积层;其中,在m大于2时,所述至少m-1个特征提取分支中的空洞卷积层的空洞率各不相同;在包括空洞卷积层的特征提取分支为m-1个时,所述m个特征提取分支中剩余的一个特征提取分支仅包括普通卷积层或为直连分支。

17.在上述实现方式中,利用不同空洞率的空洞卷积实现不同的感受野,并且也可以加入一个只包含普通卷积层的特征提取分支(普通卷积可视为空洞率为1的空洞卷积),或者加入一个直连分支(用于与其他分支形成残差结构)。

18.在第一方面的一种实现方式中,所述至少m-1个特征提取分支中的每个特征提取

分支用于计算自身的空洞卷积层的输出特征图在空间维度的权重,并将计算出的权重与自身的空洞卷积层的输出特征图的不同空间位置处的数据相乘,得到自身的输出特征图。

19.在多感受野模块中还可以结合空间注意力机制,进一步改善计算出的融合掩膜的精度。

20.在第一方面的一种实现方式中,所述分支网络包括多感受野模块,所述多感受野模块包括依次连接的m个特征提取单元;其中,m为大于1的整数,所述m个特征提取单元中的首个特征提取单元用于对所述多感受野模块的输入特征图进行特征提取以得到自身的输出特征图,之后的每个特征提取单元均用于对上一个特征提取单元的输出特征图进行特征提取以得到自身的输出特征图,最后一个特征提取单元的输出特征图为所述多感受野模块的输出特征图,且各个特征提取单元对应感受野不同。

21.在之前的实现方式中,通过设置多个特征提取分支实现多感受野,这些特征提取分支之间是并联关系。在上述实现方式中,也可以将这些特征提取分支改为串联关系(相应地,其名称也改为特征提取单元),同样可以实现多感受野。

22.在第一方面的一种实现方式中,所述主干网络还用于对所述n帧通道图像进行下采样;所述利用所述神经网络模型中的n个分支网络计算所述n帧通道图像对应的n帧融合掩膜,包括:利用所述神经网络模型中的n个分支网络计算所述n帧通道图像对应的n帧低分辨率的融合掩膜;对所述n帧低分辨率的融合掩膜进行上采样,得到与所述n帧通道图像分辨率相同的所述n帧融合掩膜。

23.在上述实现方式中,对目标通道的通道图像先进行下采样降低其分辨率,然后再进行后续处理,直至在得到低分辨率的融合掩膜后,才通过上采样获得原始分辨率的融合掩膜。这就使得整个掩膜计算过程中的大部分运算得以在低分辨率的图像上进行,从而显著提高了掩膜计算的效率,进而也就提高了图像融合的效率。

24.在第一方面的一种实现方式中,所述对所述n帧低分辨率的融合掩膜进行上采样,得到与所述n帧通道图像分辨率相同的所述n帧融合掩膜,包括:对所述n帧低分辨率的融合掩膜进行保留边缘的平滑滤波以及上采样,得到与所述n帧通道图像分辨率相同的所述n帧融合掩膜。

25.上述实现方式在利用低分辨率的融合掩膜计算原始分辨率的融合掩膜时,不仅会进行上采样,还会进行保留边缘的平滑滤波(例如,引导滤波),从而有利于抑制因上采样造成的掩膜质量下降,改善融合掩膜的精度。

26.在第一方面的一种实现方式中,若每帧待融合图像均包括多个通道,且所述多个通道不全是目标通道,则利用在对目标通道的通道图像进行融合时计算出的融合掩膜,对于所述n帧待融合图像中属于同一非目标通道的n帧通道图像进行加权融合。

27.在上述实现方式中,对于非目标通道的通道图像,在融合时可以直接利用目标通道的通道图像使用的融合掩膜,从而简化融合过程,提高融合效率。例如,目标通道可以选择待融合图像中比较重要的通道(比如yuv图像的y通道),非目标通道可以选择待融合图像中相对次要的通道(比如yuv图像的u、v通道),这样非目标通道采用的融合掩膜即使不是根据自身的通道图像计算的,也不会对融合结果图像的图像质量造成太大的影响。

28.第二方面,本技术一种图像融合装置,包括:图像获取组件,用于获取曝光程度不完全相同的n帧待融合图像;其中,n为大于1的整数,每帧待融合图像均包括至少一个通道,

所述至少一个通道中包括目标通道;图像融合组件,用于对所述n帧待融合图像中属于同一通道的n帧通道图像进行融合,得到至少一帧通道融合图像,并根据所述至少一帧通道融合图像确定融合结果图像;其中,对于所述n帧待融合图像中属于同一目标通道的n帧通道图像,通过以下步骤计算其对应的通道融合图像:利用预训练的神经网络模型中的主干网络提取所述n帧通道图像的基础特征图,并将所述基础特征图拆分为n帧子特征图;利用所述神经网络模型中的n个分支网络计算所述n帧通道图像对应的n帧融合掩膜;其中,每个分支网络用于根据一帧子特征图计算一帧通道图像对应的一帧融合掩膜,每帧融合掩膜中包括对应的一帧通道图像融合用的权重;利用所述n帧融合掩膜对所述n帧通道图像进行加权融合,得到所述通道融合图像。

29.第三方面,本技术实施例提供一种计算机程序产品,包括计算机程序指令,所述计算机程序指令被处理器读取并运行时,执行第一方面或第一方面的任意一种可能的实现方式提供的方法。

30.第四方面,本技术实施例提供一种计算机可读存储介质,所述计算机可读存储介质上存储有计算机程序指令,所述计算机程序指令被处理器读取并运行时,执行第一方面或第一方面的任意一种可能的实现方式提供的方法。

31.第五方面,本技术实施例提供一种电子设备,包括:存储器以及处理器,所述存储器中存储有计算机程序指令,所述计算机程序指令被所述处理器读取并运行时,执行第一方面或第一方面的任意一种可能的实现方式提供的方法。

附图说明

32.为了更清楚地说明本技术实施例的技术方案,下面将对本技术实施例中所需要使用的附图作简单地介绍,应当理解,以下附图仅示出了本技术的某些实施例,因此不应被看作是对范围的限定,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他相关的附图。

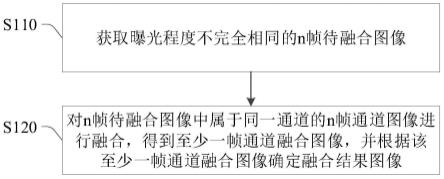

33.图1示出了本技术实施例提供的图像融合方法的步骤;

34.图2示出了图1中步骤s120可能包含的子步骤;

35.图3示出了本技术实施例提供的图像融合方法的一种具体工作流程;

36.图4示出了本技术实施例提供的多注意力模块的一种结构;

37.图5示出了一种用于计算多注意力模块中的权重的结构;

38.图6示出了本技术实施例提供的多感受野模块的一种结构;

39.图7示出了一种用于计算多感受野模块中的权重的结构;

40.图8示出了本技术实施例提供的图像融合装置包含的功能组件;

41.图9示出了本技术实施例提供的电子设备的一种结构。

具体实施方式

42.近年来,基于人工智能的计算机视觉、深度学习、机器学习、图像处理、图像识别等技术研究取得了重要进展。人工智能(artificial intelligence,简称ai)是研究、开发用于模拟、延伸人的智能的理论、方法、技术及应用系统的新兴科学技术。人工智能学科是一门综合性学科,涉及芯片、大数据、云计算、物联网、分布式存储、深度学习、机器学习、神经

网络等诸多技术种类。计算机视觉作为人工智能的一个重要分支,具体是让机器识别世界,计算机视觉技术通常包括人脸识别、活体检测、指纹识别与防伪验证、生物特征识别、人脸检测、行人检测、目标检测、行人识别、图像处理、图像识别、图像语义理解、图像检索、文字识别、视频处理、视频内容识别、行为识别、三维重建、虚拟现实、增强现实、同步定位与地图构建、计算摄影、机器人导航与定位等技术。随着人工智能技术的研究和进步,该项技术在众多领域展开了应用,例如安防、城市管理、交通管理、楼宇管理、园区管理、人脸通行、人脸考勤、物流管理、仓储管理、机器人、智能营销、计算摄影、手机影像、云服务、智能家居、穿戴设备、无人驾驶、自动驾驶、智能医疗、人脸支付、人脸解锁、指纹解锁、人证核验、智慧屏、智能电视、摄像机、移动互联网、网络直播、美颜、美妆、医疗美容、智能测温等领域。本技术实施例中的图像融合方法也利用了人工智能等方面的技术。

43.下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行描述。应注意到:相似的标号和字母在下面的附图中表示类似项,因此,一旦某一项在一个附图中被定义,则在随后的附图中不需要对其进行进一步定义和解释。

44.术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

45.图1示出了本技术实施例提供的图像融合方法的步骤,该方法可以但不限于由图9示出的电子设备执行,关于该电子设备的结构可以参考后文关于图9的阐述。参照图1,图像融合方法包括:

46.步骤s110:获取曝光程度不完全相同的n帧待融合图像。

47.其中,n为大于1的整数,待融合图像是指需要进行相互融合的图像,融合的目标是为了获得具有hdr效果的图像。待融合图像的曝光程度可以通过一定的方式进行量化表示,例如,曝光补偿值(ev)等。注意,步骤s110中只要求n帧待融合图像的曝光程度不完全相同,但并不要求n帧待融合图像的曝光程度要完全不同:例如,在n=3时,ev-1、ev0、ev+1的3帧图像是符合要求的一组待融合图像;在n=4时,ev-1、ev0、ev0、ev+1的4帧图像也是符合要求的一组待融合图像,其中ev0的图像出现了2次,表明ev0的图像比较重要,在融合结果中应当具有更高的占比。

48.至于如何获得满足上述要求的n帧待融合图像本技术并不限定:例如,可以是从电子设备的摄像头处接收其实时采集的图像作为待融合图像(比如,将摄像头的ev值分别设置成-1、0和1连续采集3帧图像);又例如,可以是直接从电子设备的存储器中读取事先保存好的待融合图像,等等。另外应当理解是,n帧待融合图像在内容上针对的是同一场景,否则对其进行融合意义不大。

49.步骤s120:对n帧待融合图像中属于同一通道的n帧通道图像进行融合,得到至少一帧通道融合图像,并根据至少一帧通道融合图像确定融合结果图像。

50.每帧待融合图像均包含至少一个通道,且各帧待融合图像包含的通道数量是相同的。例如,n帧待融合图像可以都是灰度图像,即均包含1个通道;又例如,n帧待融合图像可以都是yuv图像,即均包含3个通道;又例如,n帧待融合图像可以都是rgb图像,即均包含3个

通道,等等。

51.若每帧待融合图像仅包含一个通道,则该通道的通道图像就是待融合图像自身,步骤s120中对n帧通道图像进行融合也就是对n帧待融合图像进行融合,得到的通道融合图像也就是融合结果图像。

52.若每帧待融合图像包含两个或两个以上的通道,则应分通道进行图像融合,得到与通道数量相同的通道融合图像,再将这些通道融合图像按照其所属的通道拼接起来,就可以得到融合结果图像。例如,若n帧待融合图像均为yuv图像,则应对n帧y通道的通道图像进行融合,得到y通道的通道融合图像,对n帧u通道的通道图像进行融合,得到u通道的通道融合图像,对n帧v通道的通道图像进行融合,得到v通道的通道融合图像,最后将3帧通道融合图像分别作为新的y、u、v通道图像拼接起来,就可以得到融合结果图像,显然,融合结果图像仍然是yuv图像。

53.在每帧融合图像包含的通道中包括目标通道,目标通道的数量可以是一个或多个,除了目标通道外,若待融合图像还有剩余的通道,则这些剩余的通道可称为非目标通道,至于哪些通道是目标通道可以是预先确定好的。例如,若待融合图像是灰度图像,则其仅有的一个通道必然也是目标通道;若待融合图像是yuv图像,可以将y通道选为目标通道,此时u、v为非目标通道,或者也可以将y、u、v通道都选为目标通道,此时没有非目标通道。

54.目标通道和非目标通道的区别在于,对于每个目标通道的n帧通道图像,应执行图2中的步骤s121~s123融合为对应的一帧通道融合图像,而对于每个非目标通道的n帧通道图像(如果有非目标通道的话),则可以执行图2中的步骤s124融合为对应的一帧通道融合图像。显然,步骤s121~s124均属于步骤s120的子步骤。

55.其中,步骤s121~s123为本技术所提出的主要融合方案,能够显著改善图像融合的效果(主要指hdr效果),这些步骤的某些实现方式还可以显著提高图像融合的效率。因此,作为一种可选的策略,为尽可能改善图像融合效果,可以将待融合图像包含的所有通道都作为目标通道,或者,若出于效率等其他因素的考虑,也可以仅将待融合图像中对融合结果影响最明显的一个或几个通道作为目标通道(例如,yuv图像中的y通道),其余的通道作为非目标通道(例如,yuv图像中的u、v通道)。

56.下面对图2中的步骤进行详细阐述,在阐述时将主要结合图3示出的流程。

57.步骤s121:利用预训练的神经网络模型中的主干网络提取n帧通道图像的基础特征图,并将基础特征图拆分为n帧子特征图。

58.步骤s122:利用神经网络模型中的n个分支网络计算n帧通道图像对应的n帧融合掩膜。

59.步骤s121和s122结合在一起进行阐述。步骤中使用的神经网络模型是预先训练好的(指执行步骤s120之前),其训练过程后文再说明,如果目标通道有多个,可以针对每个目标通道都训练一个神经网络模型,或者为了节约计算资源,也可以多个目标通道共用一个神经网络模型。

60.神经网络模型具体采用哪种神经网络不限,例如,可以是卷积神经网络(cnn)、循环神经网络(rnn)、人工神经网络(ann)或者这些神经网络的结合。该神经网络模型至少包括两个部分,分别是主干网络和n个分支网络,主干网络的尾部与各个分支网络的头部连接,并且主干网络和分支网络各自也是神经网络,都具有可训练的参数。

61.利用主干网络可以对目标通道的n帧通道图像进行特征提取,得到其对应的基础特征图,然后将基础特征图拆分为n帧子特征图,每帧子特征图作为一个分支网络的输入。

62.参照图3,最上方的白色矩形表示目标通道的n帧通道图像(图3中n=3),记为x_h,n帧通道图像在输入主干网络时可以作为一个整体输入,其形状为n

×1×w×

h,其中n为帧数,1是每帧包含的通道数,w和h分别是通道图像的宽和高。多注意力模块(后文介绍)下方的长方体表示计算出的基础特征图,其形状为n

×c×w×

h,其中n为帧数,c是每帧包含的通道数(c>1),w和h分别是基础特征图的宽和高。拆分模块下方的n个形状为1

×c×w×

h的长方体表示n帧子特征图,可见,拆分模块是对基础特征图的帧维度进行了拆分,每帧子特征图可以认为与一帧通道图像相对应,但此处的“对应”不应理解为每帧子特征图是仅根据一帧通道图像计算的。

63.利用每个分支网络可以基于输入的一帧子特征图计算对应的一帧融合掩膜,对于总共n个分支网络,计算出的融合掩膜共有n帧。如前所述,子特征图与通道图像是相对应的,所以根据子特征图计算出的每帧融合掩膜也和一帧通道图像相对应。

64.融合掩膜可以视为一种权重图像,即融合掩膜中的每个像素值都代表对应的一帧通道图像在进行融合时使用的权重,融合掩膜的分辨率与通道图像是相同的。关于如何使用融合掩膜进行通道图像的融合,在步骤s123中再进行阐述。

65.可选的,为了便于使用融合掩膜,还可以对融合掩膜中的权重进行归一化,即使得在归一化之后,任取融合掩膜中的一个像素位置x,n帧融合掩膜在x处的n个权重之都为1,且每个权重的取值都位于区间[0,1]中。在后文介绍步骤s123时,为简单起见,不妨认为融合掩膜中的权重都是归一化以后的。

[0066]

参照图3,滤波/上采样模块(后文介绍)下方的n个灰色矩形代表n帧融合掩膜,记为m_h,其中每帧融合掩膜的形状为1

×1×w×

h,即一帧融合掩膜的形状与一帧通道图像的形状是完全相同的。

[0067]

此外需要注意,步骤s122虽然是利用分支网络计算融合掩膜,但并没有限定分支网络输出的就一定是融合掩膜,每个分支网络可能直接输出对应的融合掩膜,也可能还要对分支网络输出的结果进行进一步运算才能得到对应的融合掩膜。例如,在图3中,多感受野模块(后文介绍)下方的n个较小的灰色矩形才是分支网络输出,而n帧融合掩膜位于滤波/上采样模块下方,滤波/上采样模块已经不属于分支网络的范畴。

[0068]

步骤s123:利用n帧融合掩膜对n帧通道图像进行加权融合,得到通道融合图像。

[0069]

先以线性融合的方式为例,线性融合可以用公式表示为:

[0070][0071]

其中,y

*

表示通道融合图像,yi表示第i帧通道图像,mi表示第i帧融合掩膜(与yi对应的融合掩膜),符号

“⊙”

表示对应位置的像素值相乘,如前文所述,融合掩膜与通道图像分辨率相同,所以二者可以进行

⊙

运算。可见,线性融合实际上就是以n帧融合掩膜为权重图像,对n帧通道图像进行加权求和,从而得到通道融合图像的过程,如果融合掩膜中的权重是归一化以后的,可以保证通道融合图像中的像素和通道图像中的像素具有相同的取值范围,例如,都是[0,255]。

[0072]

当然,线性融合并非唯一的加权融合方式,例如还可以采用金字塔融合,其步骤简述如下:

[0073]

步骤a:根据每帧融合掩膜构造对应的一个高斯金字塔,共得到n个高斯金字塔,以及,根据每帧通道图像构造对应的一个拉普拉斯金字塔,共得到n个拉普拉斯金字塔。

[0074]

其中,高斯金字塔和拉普拉斯金字塔层数相同,且两种金字塔中位于同一层的金字塔图像的分辨率也相同,关于高斯金字塔和拉普拉斯金字塔的构造方式,可以参考现有技术,此处不详细解释,另外构造高斯金字塔和构造拉普拉斯金字塔的先后顺序不限,或者也可以同时进行。

[0075]

沿用上面的符号,若mi表示第i帧融合掩膜,则n个高斯金字塔可以表示为其中表示第i个高斯金字塔(基于mi构建)的第j层金字塔图像。若yi表示第i帧通道图像,则n个拉普拉斯金字塔可以表示为其中表示第i个拉普拉斯金字塔(基于yi构建)的第j层金字塔图像。上面的i和j应在各自的取值范围内取遍所有值,即i取遍1至n中的所有整数,假设高斯金字塔和拉普拉斯金字塔都是l层(l为大于1的整数),则j取遍1至l中的所有整数。

[0076]

步骤b:利用n个高斯金字塔对n个拉普拉斯金字塔进行加权融合,得到融合后的拉普拉斯金字塔。

[0077]

其中,融合后的拉普拉斯金字塔中的每层金字塔图像,是利用n个高斯金字塔中位于该层的n帧金字塔图像,对n个拉普拉斯金字塔中位于该层的n帧金字塔图像进行加权融合后得到的。例如,在采用线性融合时,融合过程可以表示为如下公式:

[0078][0079]

其中,yj表示融合后的拉普拉斯金字塔中位于第j层的金字塔图像,整个融合后的拉普拉斯金字塔可以记作j取遍1至l中的所有整数。

[0080]

步骤c:利用融合后的拉普拉斯金字塔进行图像重构,得到通道融合图像。

[0081]

基于拉普拉斯金字塔如何进行图像重构,可以参考现有技术,此处不详细解释,重构的结果就是步骤s123要计算的通道融合图像。

[0082]

对比可知,金字塔融合并不是直接利用融合掩膜对通道图像本身进行线性融合,而是利用融合掩膜的高斯金字塔,对通道图像的拉普拉斯金字塔进行分层的线性融合。根据拉普拉斯金字塔的构造过程可知,在拉普拉斯金字塔中,每一层的金字塔图像都可以视为从通道图像中提取出的特征图,而且这些特征图代表着通道图像中不同频率的图像细节。从而,对同层的金字塔图像进行加权融合,就相当于在每一种频率所对应的子空间上单独进行图像融合,因此其融合的难度较低,并且融合的效果也要好于直接在原始的通道图像上进行融合,进而有利于改善通道融合图像的质量。当然,采用金字塔融合在算法复杂度上要高于采用线性融合,所以在具体实施时可以根据需求采用不同的融合方式。

[0083]

参照图3,图3示出的是采用线性融合的方式,在m_h处,除了n个灰色矩形之外,还绘制有n个白色矩形,这些白色矩形表示n帧待融合图像,

“×”

和“+”代表用于线性融合的乘

法器和加法器,图3最下方的白色矩形代表目标通道的通道融合图像,其形状为1

×1×w×

h,和任意一帧通道图像相同。

[0084]

关于图3,还有两点需要说明:

[0085]

其一,滤波/上采样模块、用于线性融合的乘法器和加法器并未被包括在神经网络模型中,因为它们并未包含可训练的模型参数(但可能包含一些超参数),当然将它们也视为神经网络模型的一部分也是可以的,并不会对方案产生实质性影响。

[0086]

其二,图3中绘制的仅仅是神经网络模型的一种基本结构,但神经网络模型在此基本结构的基础上也可能包含很多额外的结构,例如池化层、卷积层等,为了避免模型的结构看起来过于繁杂,这些额外的结构没有绘制出来,但在实施时可以根据需求将其加入到模型中。对于图4~7,也存在类似的情况,不再逐一说明。

[0087]

步骤s124:利用其他方法对n帧通道图像进行融合,得到通道融合图像。

[0088]

对于属于同一非目标通道的通道图像,可采用其他方法进行融合,步骤s124中的“其他方法”是指除步骤s121~s123以外的方法,例如,现有的任意一种用于获得hdr图像的图像融合方法。

[0089]

此外,还可以直接利用在对目标通道的通道图像进行融合时计算出的融合掩膜,对于属于同一非目标通道的n帧通道图像进行加权融合。例如,待融合图像为yuv图像,目标通道为y通道,通过执行步骤s121~s123计算出了针对y通道的n帧融合掩膜,则对于u通道或v通道的n帧通道图像,均可以直接利用这n帧融合掩膜进行融合,融合方式可以参考步骤s123,比如可以选择线性融合或金字塔融合。对于目标通道有多个的情况,可以类似处理,例如,若目标通道有两个,则利用这两个目标通道的通道图像分别可以算出n帧融合掩膜,即共有2n帧融合掩膜,然后先将其中每两帧对应的融合掩膜取平均,得到n帧融合掩膜,再利用这n帧融合掩膜融合非目标通道的通道图像。

[0090]

上述融合方式简化了非目标通道的图像融合过程,提高了融合效率。例如,目标通道可以选择待融合图像中比较重要的通道(比如yuv图像的y通道),非目标通道可以选择待融合图像中相对次要的通道(比如yuv图像的u、v通道),这样非目标通道采用的融合掩膜即使不是根据自身的通道图像计算的,也不会对融合结果图像的图像质量造成太大的影响。

[0091]

下面简单总结图1和图2中的图像融合方法:该方法在融合目标通道的通道图像时,利用神经网络模型来计算融合用的权重(即融合掩膜),由于神经网络模型是通过训练数据训练得到的,并非是一种根据经验确定的预设规则,因此计算出的权重具有较好的鲁棒性,从而有利于改善在待融合图像的曝光程度跨度较大时,所得到的融合结果图像(hdr图像)的质量,避免其出现画面发灰、缺少细节等现象。

[0092]

其中,若采用ev值表示曝光程度,则曝光程度跨度较大可以理解为:将n帧待融合图像按照ev值递增或递减的顺序排列后,相邻的两帧待融合图像的ev值差距较大,或者,第一帧和最后一帧待融合图像的ev值差距较大。应当理解,即使待融合图像的曝光程度跨度不大,本技术实施例中的图像融合方法对于融合图像的质量仍具有改善效果。

[0093]

另外,该方法中使用的神经网络模型分为主干网络和分支网络两部分,主干网络是n帧通道图像共用的,从而有利于促进待融合图像的帧间信息交流,提升融合掩膜的精度,而每个分支网络则用于计算一帧通道图像对应的融合掩膜,从而有利于针对该帧通道图像进行参数优化,同样能够提升融合掩膜的精度。总之,计算出的融合掩膜精度越高,进

行图像融合的效果自然也就越好。

[0094]

下面,在以上实施例的基础上,继续介绍图像融合方法中的下采样和上采样机制:

[0095]

在一种实现方式中,主干网络中还包括下采样模块,该模块可以设置在主干网络的起始位置,用于对n帧通道图像进行下采样,如图3所示。下采样后将得到低分辨率的通道图像,注意,这里的“低分辨率”是相对意义上的而非绝对意义上的,意思是分辨率低于通道图像的原始分辨率,后文的“低分辨率”均应作此理解。继续参照图3,下采样模块下方的白色矩形表示低分辨率的通道图像,记为x_l,其形状为n

×1×w×

h,并且w<w且h<h,即其分辨率低于原始的通道图像。

[0096]

神经网络模型的后续计算都是基于低分辨率的通道图像进行的,并且n个分支网络的输出(也就是神经网络模型的输出)也是n帧低分辨率的融合掩膜,这些掩膜与n帧通道图像一一对应,并且其中的像素值也表征通道图像融合用的权重,但其分辨率低于步骤s122中提到的融合掩膜。参照图3,基础特征图的形状为n

×c×w×

h,子特征图的形状为1

×c×w×

h,神经网络模型的输出m_l的形状为n

×1×w×

h(在图中是n个1

×1×w×

h的掩膜,位于多感受野模块下方),其分辨率无一例外都低于通道图像的原始分辨率。

[0097]

由于n帧低分辨率的融合掩膜不便于进行加权融合,所以最后还需对其进行上采样,得到n帧与通道图像分辨率相同的融合掩膜(即步骤s122中提到的融合掩膜),再进行后续的融合步骤s123。在图3中,上采样操作由滤波/上采样模块(关于“滤波”的作用,稍后再解释)完成,不难看出,上采样之后,掩膜的形状变成1

×1×w×

h,即已经恢复原始分辨率。在进行上采样时,可以将n帧低分辨率的融合掩膜作为一个整体输入滤波/上采样模块,该模块可以批量地完成n帧图像的上采样。

[0098]

在上述实现方式中,对目标通道的通道图像先进行下采样降低其分辨率,然后再进行后续处理,直至在得到低分辨率的融合掩膜后,才通过上采样获得原始分辨率的融合掩膜。这就使得整个掩膜计算过程中的大部分运算得以在低分辨率的图像上进行,从而显著提高了掩膜计算的效率,进而也就提高了图像融合的效率。

[0099]

进一步的,发明人发现,上采样操作会在一定程度上造成掩膜质量下降,因此在一种可选方案中,在对n帧低分辨率的融合掩膜进行上采样时,还可以对其进行保留边缘的平滑滤波,改善得到的n帧融合掩膜的质量。因此,在图3中采用了具有滤波功能的上采样模块而非单纯的上采样模块(当然采用单纯的上采样模块也是可行的)。

[0100]

边缘保留的平滑滤波是一类图像滤波算法,例如双边滤波、引导滤波都属于此类,这类滤波算法可以在平滑图像内容的同时尽量保留图像中的边缘信息。滤波可以在上采样之前进行,以图3为例,可以先对m_l进行引导滤波(引导图选择x_l),再对滤波结果进行上采样得到m_h。

[0101]

或者,也可以同时进行滤波和上采样(此处的“同时”,应理解为上采样和滤波的过程混合在一起,二者之间的界限并不清晰,不应理解为“并行”),例如,图3中的滤波/上采样模块可以选择联合引导上采样(guided filtering for joint upsampling,简称gfu)模块,gfu模块包括3个输入,分别是x_l、m_l和x_h,输出为m_h,在gfu模块内部会根据x_l和m_l计算两个低分辨率的映射矩阵a和b,然后对a和b进行上采样,得到两个原始分辨率的映射矩阵a*和b*,最后将x_h作为引导图,利用公式m_h=a*

⊙

x_h+b将其映射为m_h。gfu模块中的引导图由于采用了分辨率较高的x_h而非x_l,所以能够在很大程度上降低上采样造成的

边缘信息丢失。

[0102]

应当理解,图像融合流程中的下采样机制和上采样机制是配合使用的,如果不进行下采样,自然也没有必要进行上采样。例如,在某些不同于图3的实现方式中,主干网络中不包含下采样模块,分支网络之后也没有必要设置滤波/上采样模块,分支网络可以直接输出与通道图像分辨率相同的n帧融合掩膜。

[0103]

下面,在以上实施例的基础上,介绍图像融合方法中的注意力机制:

[0104]

在一种实现方式中,图像融合方法中使用的神经网络模型具有注意力机制。人在观察图像时,会对图像中不同的部分表现出不同的关注程度——重要的部分关注程度较高,不重要的部分关注程度较低。从而,针对某个特定的图像处理任务(例如,分类、分割、融合、识别)而言,图像中不同部分的特征在重要性上是不同的,所谓注意力机制,就是通过某些技术手段,来表达图像中的不同部分的特征在重要性上的差异。例如,对图像中的不同部分的特征赋予不同的权重,被赋予权重较大的特征表明其重要性较高,被赋予权重较小的特征表明其重要性较低。

[0105]

在神经网络模型中,可以采用两个分支加一个乘法器的结构来实现注意力机制,两个分支中的一个分支用于将特征图输入至乘法器,另一个分支则用于计算特征图中不同部分的特征的权重,并将这些权重输入至乘法器,乘法器用于实现特征的加权。如何划分特征图中不同的部分,将形成不同类型的注意力机制。

[0106]

本技术的方案中,特征图共有4个维度,以图3中的基础特征图为例,其形状为n

×c×w×

h,其中n代表帧维度,c代表通道维度,w代表横坐标维度,h代表纵坐标维度。也可以将w和h视为一个维度,即空间维度,此时特征图共有3个维度。从而,本技术的方案中可能用到以下三种注意力机制:

[0107]

通道注意力,即通道维度的注意力机制,是指对特征图的不同通道中的数据赋予相应的权重;

[0108]

帧注意力,即帧维度的注意力机制,是指对特征图的不同帧中的数据赋予相应的权重;

[0109]

空间注意力,即空间维度的注意力机制,是指对特征图的不同空间位置处的数据赋予相应的权重。

[0110]

在神经网络模型中,注意力机制既可能被引入主干网络中,也可能被引入分支网络中,或者也可能主干网络和分支网络中都具有注意力机制。其中,主干网络中可能具有通道注意力、帧注意力以及空间注意力中的至少一种机制,而分支网络中可能具有通道注意力以及空间注意力中的至少一种机制。参照图3,由于输入每个分支网络的子特征图只有一帧,而根据帧注意力的定义,要对不同帧中的数据进行加权才有意义,所以对于分支网络无需考虑帧注意力。

[0111]

通过在神经网络中加入不同的注意力机制,有利于改善计算出的融合掩膜的精度,但应当理解,即使神经网络模型中没有添加与注意力机制相关的结构,仍然可以实现本技术提出的图像融合方法。后文将给出具体的例子,说明如何在主干网络和/或分支网络中引入注意力机制。

[0112]

在一种实现方式中,主干网络包括多注意力模块,多注意力模块包括依次连接的通道注意力单元以及帧注意力单元,如图4所示。多注意力模块在主干网络中的位置不限,

例如在图3中,多注意力模块的位置在下采样模块之后。

[0113]

其中,通道注意力单元的输入特征图也就是多注意力模块的输入特征图(这里的“特征图”应作广义理解,比如若多注意力模块设置在主干网络的起始位置,则待融合图像也视为特征图),通道注意力单元用于计算多注意力模块的输入特征图在通道维度的权重,并将计算出的权重与多注意力模块的输入特征图的不同通道中的数据相乘,得到通道注意力单元的输出特征图。对比通道注意力的定义可知,通道注意力单元具有通道注意力。

[0114]

参照图4,通道注意力单元的输入特征图形状为n

×c×w×

h(下采样模块和多注意单元之间设置有卷积层,将x_l的通道数从1提升为c,但图3中未示出),通道注意力单元的一个分支将该特征图直接输入乘法器,另一个分支则基于该特征图计算出形状为n

×c×1×

1的权重,即特征图的每个通道都计算一个对应的权重,乘法器负责将特征图的每个通道中的数据与该通道对应的权重相乘,使得更重要的通道中的数据被赋予较大的权重,而相对不重要的通道中的数据则被赋予较小的权重。

[0115]

进一步的,通道注意力单元中计算权重的分支可以、但不限于采用图5中的结构,该结构包括依次连接的全局池化层、第一全连接层、relu函数、第二全连接层以及sigmoid函数,全局池化层的输入也就是通道注意力单元的输入,sigmoid函数的输出也就是该分支要计算的权重。图5右侧示出了每层/函数输出的特征图的形状,其中,第一全连接层可以将自身的输入特征图的通道数从c变成c/r,第二全连接层则可以将自身的输入特征图的通道数从c/r变成c,r为一个预设的超参数。

[0116]

帧注意力单元的输入特征图也就是通道注意力单元的输出特征图,帧注意力单元用于对自身的输入特征图中的通道维度和帧维度进行转置,计算转置后的特征图在通道维度的权重,将计算出的权重与转置后的特征图的不同通道中的数据相乘,得到加权后的特征图,并对加权后的特征图中的通道维度和帧维度进行再次转置,得到自身的输出特征图,也就是多注意力模块的输出特征图。

[0117]

虽然帧注意力单元是对不同通道中的数据进行加权,但加权操作是在数据转置之后进行的,通过转置操作,特征图中原来的通道维度变成了帧维度,原来的帧维度变成了通道维度,即对转置后的特征图的不同通道中的数据进行加权,实质上是对转置前的特征图的不同帧中的数据进行加权,从而对比帧注意力的定义可知,帧注意力单元具有帧注意力。

[0118]

参照图4,帧注意力单元的输入特征图形状为n

×c×w×

h,经转置后其形状变成c

×n×w×

h,帧注意力单元的一个分支将该特征图直接输入乘法器,另一个分支则基于该特征图计算出形状为c

×n×1×

1的权重,即特征图的每个通道(此时的通道数为n)都计算一个对应的权重,乘法器负责将特征图的每个通道中的数据(实际上是原来的帧中的数据)与该通道对应的权重相乘,使得更重要的通道中的数据被赋予较大的权重,而相对不重要的通道中的数据则被赋予较小的权重,最后通过再次转置将特征图中的维度恢复为原来的次序。

[0119]

不难看出,通过转置,帧注意力单元可以复用通道注意力单元的结构,从而简化了网络设计。帧注意力单元中计算权重的分支可以、但不限于采用图5中的结构,不再重复阐述。

[0120]

上述实现方式中的多注意力模块包含了通道注意力和帧注意力,其中通道注意力强化了不同通道中的特征的差异,而帧注意力则强化了不同帧中的特征的差异,并且多注

意力模块是设置在由n帧待融合图像共享的主干网络中的,因此该模块有利于强化通道间及帧间的信息交流和共享,加强帧间的联系,进而改善计算出的融合掩膜的精度。

[0121]

应当理解,在其他一些实现方式中,即使只在主干网络中引入通道注意力和帧注意力,通道注意力单元和帧注意力单元也不一定要连接在一起,例如也可以独立设置在主干网络的不同位置。

[0122]

在一种实现方式中,每个分支网络都包括多感受野模块,如图3所示。多感受野模块在分支网络中的位置不限,例如在图3中,多感受野模块的位置在各个分支网络的起始位置。

[0123]

多感受野模块内部包括m个特征提取分支以及一个特征融合单元,其中,m为大于1的整数,每个特征提取分支均用于对多感受野模块的输入特征图进行特征提取以得到自身的输出特征图,特征融合单元用于对m个特征提取分支的输出特征图进行融合,得到多感受野模块的输出特征图。

[0124]

图6示出了多感受野模块的一种结构,在图6中,多感受野模块的输入是形状为1

×c×w×

h的特征图,模块中包括5个特征提取分支(m=5)和一个特征融合单元,特征融合单元则包括一个拼接结构和一个加法器,拼接结构用于将上面4个特征提取分支的输出特征图拼接为一个整体,加法器则用于将拼接产生的特征图与最下面的特征提取分支的输出特征图相加后输出,输出的特征图即为前文提到的低分辨率的融合掩膜,形状为1

×1×w×

h。

[0125]

应当理解,图6中的特征融合单元省略了一些结构未画出:比如,上面4个特征提取分支的输出特征图的形状可以是1

×c×w×

h,拼接之后的形状是1

×

4c

×w×

h(假设按通道拼接),在输入加法器之前可以通过设置卷积层将先其降维至1

×c×w×

h(为了保持与加法器的另一个输入形状相同);又比如,加法器的输出特征图本来的形状是1

×c×w×

h,可以通过设置卷积层将其降维至1

×1×w×

h后再输出。

[0126]

多感受野模块中的m个特征提取分支对应的感受野不同。所谓感受野,可以理解为特征图中的一个像素在原图中对应的区域面积,感受野越大,则特征图中的特征能够更好地描述原图中的较大的物体,感受野越小,则特征图中的特征只能够描述原图中的较小的物体。在本技术的方案中,上述“原图”可以理解为通道图像或待融合图像,特征提取分支对应的感受野可以理解为特征提取分支的中间特征图(比如,图6中空洞卷积层输出的特征图)或者输出特征图对应的感受野。

[0127]

多感受野模块由于包含了多个对应不同感受野的特征提取分支,使得多感受野模块提取到的特征能够在各个尺度上全面地描述通道图像中不同的物体,因此有利于提升空间信息的一致性,防止通道融合图像中出现融合分层的现象,进而改善融合结果图像的质量。其中,融合分层现象表现为图像画面在亮度上不连续、出现断层等,发明人研究后认为,融合分层现象是提取到的特征不能对通道图像中的物体进行有效描述造成的,例如,将同一物体的不同局部区域认为是不同的物体。

[0128]

下面具体说明各特征提取分支如何实现不同的感受野:

[0129]

方式1:采用空洞率不同的空洞卷积层

[0130]

若m>2,则在m个特征提取分支中的m-1个特征提取分支中设置空洞卷积层,且m-1个特征提取分支中的空洞卷积层的空洞率各不相同,剩余的一个特征提取分支采用直连分支(直接向后传递多感受野模块的输入特征图)。特别地,若m=2,则按照上述规则只有一个

特征提取分支中设置有空洞卷积层,其空洞率只要不等于1就可以了。

[0131]

例如,在图6中,上面4个特征提取分支都包括空洞卷积层,且空洞率分别为2、4、8、16(按2的幂次增长),使得这4个特征提取分支具有依次增大的感受野(且都大于多感受野模块的输入特征图的感受野),剩余的一个分支则为直连分支,其感受野等于多感受野模块的输入特征图的感受野,从而形成了5个感受野各不相同的特征提取分支。并且,将剩余的一个分支设置直连分支,还可以使得多感受野模块中形成一个残差结构,有利于提高融合掩膜的计算精度。

[0132]

作为一种替代方案,上面的直连分支也可以替换成仅包括普通卷积层(可视为空洞率为1的特殊空洞卷积层)的分支,并且可选的,该普通卷积的卷积核的尺寸可以和其他各个特征提取分支中的空洞卷积保持一致。

[0133]

作为另一种替代方案,在m个特征提取分支中都设置空洞卷积层,且使得m个特征提取分支中的空洞卷积层的空洞率各不相同,也可以实现多感受野。

[0134]

进一步的,在多感受野模块中还可以引入注意力机制以提升融合掩膜的计算精度。以m-1个特征提取分支中设置有空洞卷积层,剩余的一个特征提取分支是直连分支的情况为例,假设引入的注意力机制为空间注意力,由于直连分支不包含任何网络结构,所以空间注意力可以添加至剩余的m-1个特征提取分支中。具体而言,每个特征提取分支在进行完空洞卷积的计算之后,可以进一步计算自身的空洞卷积层的输出特征图在空间维度的权重,并将计算出的权重与自身的空洞卷积层的输出特征图的不同空间位置处的数据相乘,得到自身的输出特征图。

[0135]

参照图6,以最上面的特征提取分支为例,其输入特征图形状为1

×c×w×

h,假设空洞卷积未改变其形状,则空洞卷积层的输出特征图形状仍然是1

×c×w×

h,特征提取分支的剩余部分进一步分为两个子分支,一个子分支将该特征图直接输入乘法器,另一个分支则基于该特征图计算出形状为1

×1×w×

h的权重,即特征图的每个空间位置(即像素位置)都计算一个对应的权重,乘法器负责将特征图的空间位置处的数据与该位置对应的权重相乘,使得更重要的空间位置处的数据被赋予较大的权重,而相对不重要的空间位置处的数据则被赋予较小的权重。

[0136]

特征提取分支中计算权重的子分支可以、但不限于采用图7中的结构,该结构包括依次连接的两个池化层(并联)、拼接结构、卷积层以及sigmoid函数,两个池化层的输入也就是该子分支的输入,sigmoid函数的输出也就是该子分支要计算的权重。其中,两个池化层的池化操作是不同的,左侧的池化层进行的是通道维度的最大池化(每个通道中的数据取最大值),右侧的池化层进行的是通道维度的平均池化(每个通道中的数据取平均值)。图7右侧示出了每层/结构/函数输出的特征图的形状(左侧池化层的输出特征图的形状在左侧)。

[0137]

应当理解,若剩余的一个特征提取分支不是直连分支,而是仅包含有普通卷积层的分支,则也可以在其中添加空间注意力;若在m个特征提取分支中都设置空洞卷积层,则空间注意力可以添加所有的特征提取分支中。另外应当指出,注意力机制不是必须的,去掉注意力机制后(比如,去除图6中计算权重的子分支以及乘法器),多感受野模块仍然能够正常地进行特征提取。

[0138]

方式2:采用卷积核尺寸不同的普通卷积层

[0139]

若m>2,则在m个特征提取分支中的m-1个特征提取分支中设置普通卷积层,且m-1个特征提取分支中的普通卷积层的卷积核尺寸各不相同,剩余的一个特征提取分支采用直连分支。特别地,若m=2,则按照上述规则只有一个特征提取分支中设置有普通卷积层,其卷积核尺寸可以自由设置(大于1

×

1即可)。

[0140]

例如,一共4个特征提取分支,其中一个为直连分支,剩余3个分支可以分别采用3

×

3、5

×

5、7

×

7的卷积核。

[0141]

作为另一种替代方案,在m个特征提取分支中都设置普通卷积层,且使得m个特征提取分支中的普通卷积层的卷积核尺寸各不相同,也可以实现多感受野。

[0142]

应当理解,方式2的特征提取分支中也可以引入注意力机制,具体做法可以参考方式1,不再重复阐述。

[0143]

需要指出,方式1和方式2还可以结合,因为空洞率和卷积核尺寸对于感受野的大小都存在影响。并且,也可以通过其他因素使得各特征提取分支具有不同的感受野,例如,采用不同步长的卷积层,设置池化参数不同的池化层,等等。

[0144]

在上面的阐述中,无论是方式1还是方式2,都是基于多感受野模块包括并联的多个特征提取分支的结构进行阐述的,然而在其他一些实现方式中,也可以将这些特征提取分支改为串联关系,同样可以实现多感受野的效果。此时,多感受野模块包括依次连接(即串联)的m个特征提取单元,其中,m为大于1的整数,m个特征提取单元中的首个特征提取单元用于对多感受野模块的输入特征图进行特征提取以得到自身的输出特征图,之后的每个特征提取单元均用于对上一个特征提取单元的输出特征图进行特征提取以得到自身的输出特征图,最后一个特征提取单元的输出特征图为多感受野模块的输出特征图,且各个特征提取单元对应感受野不同。

[0145]

通过特征提取单元的功能描述不难看出,每个特征提取单元大致相当于前文的一个特征提取分支,在实现特征提取单元时也可以直接采用特征提取分支的结构(包括在其中还可以加入注意力机制),不再重复阐述,当然,直连分支就没有对应的特征提取单元了。另外,由于特征提取单元之间本就是串联的,所以此时的多感受野模块中也没有必要设置特征融合单元。

[0146]

对于内部采用串联结构的多感受野模块,同样有利于提升空间信息的一致性,防止通道融合图像中出现融合分层的现象,进而改善融合结果图像的质量。

[0147]

最后,在以上实施例的基础上,简单说明图像融合方法中的神经网络模型如何训练。该模型既可以采用无监督训练,也可以采用有监督训练。

[0148]

先以有监督训练为例,n帧曝光程度不完全相同的训练图像(为简单起见,不妨以单通道图像为例)可作为一个训练样本,将训练样本输入神经网络模型后,利用模型计算出的n帧融合掩膜可以计算出融合结果图像,注意,由于已经假定了训练图像为单通道图像,所以融合后直接就可以得到融合结果图像,另外这里的融合掩膜、融合结果图像都是指训练阶段的,切勿与步骤s120中的混淆。然后,可以利用该融合结果图像以及训练样本对应的标准结果图像计算预测损失,损失函数的形式不限,其中,标准结果图像具有较好的hdr效果,可由人工结合其他图像融合算法事先确定。最后,可以根据计算出的预测损失更新神经网络模型中的参数,例如,采用反向传播算法。

[0149]

对于无监督训练,则可以通过计算mef-ssim等盲评估指标来实现模型参数的更

新,不再详细阐述。

[0150]

图8示出了本技术实施例提供的图像融合装置200包含的功能组件。参照图8,图像融合装置200包括:

[0151]

图像获取组件210,用于获取曝光程度不完全相同的n帧待融合图像;其中,n为大于1的整数,每帧待融合图像均包括至少一个通道,所述至少一个通道中包括目标通道;

[0152]

图像融合组件220,用于对所述n帧待融合图像中属于同一通道的n帧通道图像进行融合,得到至少一帧通道融合图像,并根据所述至少一帧通道融合图像确定融合结果图像;其中,对于所述n帧待融合图像中属于同一目标通道的n帧通道图像,通过以下步骤计算其对应的通道融合图像:利用预训练的神经网络模型中的主干网络提取所述n帧通道图像的基础特征图,并将所述基础特征图拆分为n帧子特征图;利用所述神经网络模型中的n个分支网络计算所述n帧通道图像对应的n帧融合掩膜;其中,每个分支网络用于根据一帧子特征图计算一帧通道图像对应的一帧融合掩膜,每帧融合掩膜中包括对应的一帧通道图像融合用的权重;利用所述n帧融合掩膜对所述n帧通道图像进行加权融合,得到所述通道融合图像。

[0153]

在图像融合装置200的一种实现方式中,所述主干网络为具有注意力机制的网络,所述主干网络具有的注意力机制包括通道注意力、帧注意力以及空间注意力中的至少一种;和/或,所述分支网络为具有注意力机制的网络,所述分支网络具有的注意力机制包括通道注意力以及空间注意力中的至少一种;其中,所述通道注意力是指对特征图的不同通道中的数据赋予相应的权重,所述帧注意力是指对特征图的不同帧中的数据赋予相应的权重,所述空间注意力是指对特征图的不同空间位置处的数据赋予相应的权重。

[0154]

在图像融合装置200的一种实现方式中,所述主干网络包括多注意力模块,所述多注意力模块包括依次连接的通道注意力单元以及帧注意力单元;其中,所述通道注意力单元用于计算所述多注意力模块的输入特征图在通道维度的权重,并将计算出的权重与所述多注意力模块的输入特征图的不同通道中的数据相乘,得到所述通道注意力单元的输出特征图;所述帧注意力单元用于对所述通道注意力单元的输出特征图中的通道维度和帧维度进行转置,计算转置后的特征图在通道维度的权重,将计算出的权重与所述转置后的特征图的不同通道中的数据相乘,得到加权后的特征图,并对所述加权后的特征图中的通道维度和帧维度进行转置,得到所述多注意力模块的输出特征图。

[0155]

在图像融合装置200的一种实现方式中,所述分支网络包括多感受野模块,所述多感受野模块包括m个特征提取分支以及特征融合单元;其中,m为大于1的整数,每个特征提取分支均用于对所述多感受野模块的输入特征图进行特征提取以得到自身的输出特征图,且各个特征提取分支对应的感受野不同,所述特征融合单元用于对所述m个特征提取分支的输出特征图进行融合,得到所述多感受野模块的输出特征图。

[0156]

在图像融合装置200的一种实现方式中,所述m个特征提取分支中的至少m-1个特征提取分支包括空洞卷积层;其中,在m大于2时,所述至少m-1个特征提取分支中的空洞卷积层的空洞率各不相同;在包括空洞卷积层的特征提取分支为m-1个时,所述m个特征提取分支中剩余的一个特征提取分支仅包括普通卷积层或为直连分支。

[0157]

在图像融合装置200的一种实现方式中,所述至少m-1个特征提取分支中的每个特征提取分支用于计算自身的空洞卷积层的输出特征图在空间维度的权重,并将计算出的权

重与自身的空洞卷积层的输出特征图的不同空间位置处的数据相乘,得到自身的输出特征图。

[0158]

在图像融合装置200的一种实现方式中,所述分支网络包括多感受野模块,所述多感受野模块包括依次连接的m个特征提取单元;其中,m为大于1的整数,所述m个特征提取单元中的首个特征提取单元用于对所述多感受野模块的输入特征图进行特征提取以得到自身的输出特征图,之后的每个特征提取单元均用于对上一个特征提取单元的输出特征图进行特征提取以得到自身的输出特征图,最后一个特征提取单元的输出特征图为所述多感受野模块的输出特征图,且各个特征提取单元对应感受野不同。

[0159]

在图像融合装置200的一种实现方式中,所述主干网络还用于对所述n帧通道图像进行下采样;图像融合组件220利用所述神经网络模型中的n个分支网络计算所述n帧通道图像对应的n帧融合掩膜,包括:利用所述神经网络模型中的n个分支网络计算所述n帧通道图像对应的n帧低分辨率的融合掩膜;对所述n帧低分辨率的融合掩膜进行上采样,得到与所述n帧通道图像分辨率相同的所述n帧融合掩膜。

[0160]

在图像融合装置200的一种实现方式中,图像融合组件220对所述n帧低分辨率的融合掩膜进行上采样,得到与所述n帧通道图像分辨率相同的所述n帧融合掩膜,包括:对所述n帧低分辨率的融合掩膜进行保留边缘的平滑滤波以及上采样,得到与所述n帧通道图像分辨率相同的所述n帧融合掩膜。

[0161]

在图像融合装置200的一种实现方式中,若每帧待融合图像均包括多个通道,且所述多个通道不全是目标通道,则图像融合组件220利用在对目标通道的通道图像进行融合时计算出的融合掩膜,对于所述n帧待融合图像中属于同一非目标通道的n帧通道图像进行加权融合。

[0162]

本技术实施例提供的图像融合装置200,其实现原理及产生的技术效果在前述方法实施例中已经介绍,为简要描述,装置实施例部分未提及之处,可参考方法实施例中相应内容。

[0163]

图9示出了本技术实施例提供的电子设备300的结构。参照图9,电子设备300包括:处理器310、存储器320以及通信接口330,这些组件通过通信总线340和/或其他形式的连接机构(未示出)互连并相互通讯。

[0164]

其中,处理器310包括一个或多个(图中仅示出一个),其可以是一种集成电路芯片,具有信号的处理能力。上述的处理器310可以是通用处理器,包括中央处理器(central processing unit,简称cpu)、微控制单元(micro controller unit,简称mcu)、网络处理器(network processor,简称np)或者其他常规处理器;还可以是专用处理器,包括图形处理器(graphics processing unit,gpu)、神经网络处理器(neural-network processing unit,简称npu)、数字信号处理器(digital signal processor,简称dsp)、专用集成电路(application specific integrated circuits,简称asic)、现场可编程门阵列(field programmable gate array,简称fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件。并且,在处理器310为多个时,其中的一部分可以是通用处理器,另一部分可以是专用处理器。

[0165]

存储器320包括一个或多个(图中仅示出一个),其可以是,但不限于,随机存取存储器(random access memory,简称ram),只读存储器(read only memory,简称rom),可编

程只读存储器(programmable read-only memory,简称prom),可擦除可编程只读存储器(erasable programmable read-only memory,简称eprom),电可擦除可编程只读存储器(electric erasable programmable read-only memory,简称eeprom)等。

[0166]

处理器310以及其他可能的组件可对存储器320进行访问,读和/或写其中的数据。特别地,在存储器320中可以存储一个或多个计算机程序指令,处理器310可以读取并运行这些计算机程序指令,以实现本技术实施例提供的图像融合方法。

[0167]

通信接口330包括一个或多个(图中仅示出一个),可以用于和其他设备进行直接或间接地通信,以便进行数据的交互。通信接口330可以包括进行有线和/或无线通信的接口。

[0168]

可以理解,图9所示的结构仅为示意,电子设备300还可以包括比图9中所示更多或者更少的组件,或者具有与图9所示不同的配置。例如,电子设备300还可能包括摄像头,用于拍摄图像或视频,被拍摄的图像或者视频中的帧都可以作为步骤s110中的待融合图像;又例如,若电子设备300无需与其他设备通信,也可以不设置通信接口330。

[0169]

图9中所示的各组件可以采用硬件、软件或其组合实现。电子设备300可能是实体设备,例如手机、摄像机、照相机、pc机、笔记本电脑、平板电脑、服务器、机器人等,也可能是虚拟设备,例如虚拟机、容器等。并且,电子设备300也不限于单台设备,也可以是多台设备的组合或者大量设备构成的集群。

[0170]

本技术实施例还提供一种计算机可读存储介质,该计算机可读存储介质上存储有计算机程序指令,这些计算机程序指令被处理器读取并运行时,执行本技术实施例提供的图像融合方法。例如,计算机可读存储介质可以实现为图9中电子设备300中的存储器320。

[0171]

本技术实施例还提供一种计算机程序产品,该计算机程序产品包括计算机程序指令,这些计算机程序指令被处理器读取并运行时,执行本技术实施例提供的图像融合方法。

[0172]

以上所述仅为本技术的实施例而已,并不用于限制本技术的保护范围,对于本领域的技术人员来说,本技术可以有各种更改和变化。凡在本技术的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本技术的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1