车站清客方法及装置与流程

1.本发明涉及轨道交通领域,尤其涉及一种车站清客方法及装置。

背景技术:

2.每天地铁停运后,在进行票务结算、清洁车站、维保设备等工作前,需要首先确保站内乘客已全部离站并关闭车站出入口。

3.目前的闭站清客方法是:行车值班员播放今日列车服务结束的广播后,通过站内监控确认车站有无乘客逗留,以及让专门的清站人员将滞留在地铁站内的乘客引导出站。同时,清站人员会对车站站台、站厅、通道、出入口等位置进行全面巡视,以及对卫生间、不开放通道出入口、站台四角等摄像头死角进行重点清理,确保乘客全部离站之后向值班站长汇报清站结果,随后依次关闭车站的自动扶梯及出入口。

4.然而,通过人工看监控和人工巡视的方式进行闭站清客,不仅耗时费力,成本高昂,并且对于卫生间、不开放通道等摄像头死角处,仅能通过人工巡视的方法进行清客,十分耗时且有可能会发生错漏。

技术实现要素:

5.针对现有技术存在的问题,本发明提供一种车站清客方法及装置。

6.本发明提供一种车站清客方法,包括:获取一类区域出入口的每帧图像,并确定每帧图像中所有目标对象的检测框;将每帧图像的检测框输入预设的目标追踪模型,生成每帧图像的每个检测框对应的追踪器,并根据每帧图像的追踪器,对所述检测框对应的目标对象的位置进行追踪;根据所述目标对象位置的追踪结果,确定所述一类区域的目标对象的进出人数;其中,所述一类区域为无法拍摄内部图像的区域。

7.根据本发明提供的一种车站清客方法,所述将每帧图像的检测框输入预设的目标追踪模型,生成每帧图像的每个检测框对应的追踪器,包括:对于第二帧以及之后的每个当前帧图像,根据时间上最近图像帧生成的追踪器与目标对象的检测框进行匹配;并且重复对未匹配的检测框,使用次近帧图像生成的追踪器进行匹配的过程,直至到达最早帧图像生成的追踪器;根据匹配上的追踪器确定目标对象检测框的当前帧位置信息,根据所述当前帧位置信息,确定当前帧图像目标对象检测框对应的追踪器。

8.根据本发明提供的一种车站清客方法,所述直至到达最早帧图像生成的追踪器之后,还包括:对于还未匹配的目标对象检测框,根据交并比iou进行二次匹配,并确定位置变化最小帧对应的追踪器;根据位置变化最小帧对应的追踪器,确定目标对象检测框的当前帧追踪器。

9.根据本发明提供的一种车站清客方法,所述根据位置变化最小帧对应的追踪器,确定目标对象检测框的当前帧追踪器之后,还包括:对于仍未匹配的目标检测框,创建对应的临时追踪器;在后续图像帧中,若所述临时追踪器只出现一次,则在预设时长后将所述临时追踪器删除;若所述临时追踪器在图像帧中出现多次,但匹配失败时长大于预设周期,则

将所述临时追踪器删除。

10.根据本发明提供的一种车站清客方法,所述根据所述目标对象位置的追踪结果,确定所述一类区域的目标对象的进出人数,包括:将每个追踪器固定位置作为撞线点,并根据通行方向将图像划分为内部区域和外部区域;当检测到某个追踪器的撞线点由外部区域进入内部区域,则进入人数加一,当检测到某个追踪器的撞线点由内部区域进入外部区域,则离开人数加一;根据进入人数和离开人数,确定所述一类区域的目标对象的进出人数。

11.根据本发明提供的一种车站清客方法,所述方法还包括:获取二类区域的图像,将每个二类区域的图像输入训练后的第二目标检测模型,输出二类区域图像中的乘客识别结果;根据所述一类区域的目标对象的进出人数中的进出乘客数,和二类区域的乘客识别结果,确定是否完成清客;其中,所述第二目标检测模型,根据带有乘客和工作人员标签的二类区域样本图像训练后得到;所述二类区域为一类区域以外的其他区域。

12.根据本发明提供的一种车站清客方法,所述获取一类区域出入口的每帧图像,并确定每帧图像中所有目标对象的检测框,包括:将一类区域出入口的每帧图像,分别输入训练后的第一目标检测模型,输出每帧图像的目标对象的检测框;其中,所述第一目标检测模型,根据带有不同目标对象标签的一类区域样本图像训练后得到。

13.本发明还提供一种车站清客装置,包括:采集模块,用于获取一类区域出入口的每帧图像,并确定每帧图像中所有目标对象的检测框;追踪模块,用于将每帧图像的检测框输入预设的目标追踪模型,生成每帧图像的每个检测框对应的追踪器,并根据每帧图像的追踪器,对所述检测框对应的目标对象的位置进行追踪;处理模块,用于根据所述目标对象位置的追踪结果,确定所述一类区域的目标对象的进出人数。

14.本发明还提供一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现如上述任一种所述车站清客方法。

15.本发明还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现如上述任一种所述车站清客方法。

16.本发明提供的车站清客方法及装置,通过每帧图像的追踪器,对检测框对应的目标对象的位置进行追踪,从而实现如卫生间、不开放通道等一类区域的进出人数的统计,可避免摄像头死角处带来的无法确定乘客人数的问题,提高清客的准确率,同时无需通过人工巡视的方法进行清客,可全面替代人工清客,提高车站的清客效率。

附图说明

17.为了更清楚地说明本发明或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作一简单地介绍,显而易见地,下面描述中的附图是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

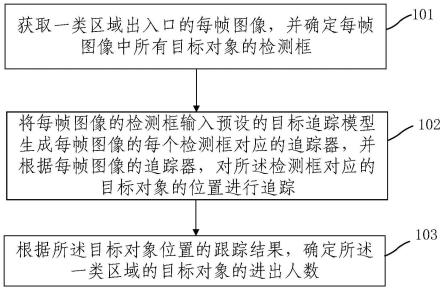

18.图1是本发明提供的车站清客方法的流程示意图之一;

19.图2是本发明提供的车站清客方法的流程示意图之二;

20.图3是本发明提供的双向碰撞检测示意图;

21.图4是本发明提供的车站清客方法的流程示意图之三;

22.图5是本发明提供的车站清客装置的结构示意图;

23.图6是本发明提供的电子设备的结构示意图。

具体实施方式

24.为使本发明的目的、技术方案和优点更加清楚,下面将结合本发明中的附图,对本发明中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

25.下面结合图1-图6描述本发明的车站清客方法及装置。图1是本发明提供的车站清客方法的流程示意图之一,如图1所示,本发明提供车站清客方法,包括:

26.101、获取一类区域出入口的每帧图像,并确定每帧图像中所有目标对象的检测框。

27.所述一类区域为无法拍摄内部图像的区域,如卫生间、端门等摄像头只能在入口处拍摄,而无法拍摄内部情况的区域,也称为特殊区域。

28.首先,在一类区域出入口处设置摄像头,例如,可借助现有的摄像头,获取出入口处的图像。然后,借助训练后的深度学习目标检测模型,如centernet、efficientnet、fasterrcnn、yolo系列等,确定目标对象的检测框。根据实际情况,目标对象可选择训练区分乘客和工作人员或是不进行区分的模型。

29.使用opencv等图像处理库从地铁特殊区域摄像头中逐帧获取图像,同时可记录该摄像头的位置信息。将图像传入上述目标检测模型,目标检测模型会输出图片的目标对象检测结果。一般为包含许多检测框的中心点坐标和宽高,以及检测框对应的标签。

30.102、将每帧图像的检测框输入预设的目标追踪模型,生成每帧图像的每个检测框对应的追踪器,并根据每帧图像的追踪器,对所述检测框对应的目标对象的位置进行追踪。

31.使用如deepsort、bytetrack、strongsort等深度学习的目标追踪模型对上一步中生成的若干检测框进行追踪,即将连续的摄像头帧生成的检测框传入追踪模型,追踪模型会将具有相似特征的检测框认为是同一个目标,附以相同的id编号,且不同目标之间的id编号彼此独立,各不相同。

32.103、根据所述目标对象位置的追踪结果,确定所述一类区域的目标对象的进出人数。

33.经由上述步骤,摄像头视频中每个人都会拥有一个id,在运动时此id也不会轻易改变,可以以此统计特殊区域的进出人数。然后根据进出人数对比,作为车站清客的依据。

34.本发明提供的车站清客方法,通过每帧图像的追踪器,对检测框对应的目标对象的位置进行追踪,从而实现如卫生间、不开放通道等一类区域的进出人数的统计,可避免摄像头死角处带来的无法确定乘客人数的问题,提高清客的准确率,同时无需通过人工巡视的方法进行清客,可全面替代人工清客,提高车站的清客效率。

35.在一个实施例中,所述将每帧图像的检测框输入预设的目标追踪模型,生成每帧图像的每个检测框对应的追踪器,包括:对于第二帧以及之后的每个当前帧图像,根据时间上最近图像帧生成的追踪器与目标对象的检测框进行匹配;并且重复对未匹配的检测框,使用次近帧图像生成的追踪器进行匹配的过程,直至到达最早帧图像生成的追踪器;根据

匹配上的追踪器确定目标对象检测框的当前帧位置信息,根据所述当前帧位置信息,确定当前帧图像目标对象检测框对应的追踪器。

36.考虑到经过上述103步骤生成的id虽然不会轻易改变,但在出现长时间遮挡等情况时,同一个人的id仍会发生变化,因此不可简单的将id数认为是人数。

37.具体而言,目标检测模型输出的检测框为detection,若干检测框为detections,首先将detections传入上述目标追踪模型,为每个detection创建一个追踪器track,若干追踪器为tracks。

38.在第二帧以及之后的每帧图片的detections传入目标追踪模型时,对已有的若干tracks和detections进行基于外观信息的级联匹配,即先使用最近生成的tracks与detections进行匹配,将拥有相似外观信息的tracks与detections匹配在一起,随后使用第二近生成的tracks与剩余的detections进行匹配,依次往下,直至到达最早生成的tracks,完成级联匹配。对于匹配上的matchedtracks,通过卡尔曼滤波计算出位置的输出值作为新的tarcks进入下一轮追踪。

39.本发明实施例的车站清客方法,对未匹配而无法追踪的检测框,依次根据次近时间的图像帧进行追踪,可避免长时间遮挡等情况下,追踪失败的问题。

40.在一个实施例中,所述直至到达最早帧图像生成的追踪器之后,还包括:对于还未匹配的目标对象检测框,根据交并比iou进行二次匹配,并确定位置变化最小帧对应的追踪器;根据位置变化最小帧对应的追踪器,确定目标对象检测框的当前帧追踪器。

41.图2是本发明提供的车站清客方法的流程示意图之二,如图2所述,其包括了结合上述实施例进行组合的情况,对于没匹配上的detections和tracks,使用iou匹配进行二次匹配,将位置变化较小的detection和track进行匹配,这一步是如果目标出现了部分遮挡,它的外观信息与之前不一样了,在外观匹配中会失配,但位置变化较小,仍可以将接近的track与之匹配。

42.本发明实施例的车站清客方法,通过iou进行二次匹配,以及根据位置变化最小的追踪器,确定目标对象检测框的位置信息,可避免乘客由于部分遮挡而导致的匹配失败问题,从而对每个乘客均能实现准确的追踪。

43.在一个实施例中,所述根据位置变化最小帧对应的追踪器,确定目标对象检测框的当前帧追踪器之后,还包括:对于仍未匹配的目标检测框,创建对应的临时追踪器;在后续图像帧中,若所述临时追踪器只出现一次,则在预设时长后将所述临时追踪器删除;若所述临时追踪器在图像帧中出现多次,但匹配失败时长大于预设周期,则将所述临时追踪器删除。

44.对于匹配失败的当前目标检测框,为其建立临时track。对于失配的track,若它只出现过一次再也没出现过,说明它对应的detection是误检测的结果,超过预设时长后,则删除此临时的track。若出现了不止一次,则判断它的失配次数是否大于人为规定的最大生命周期。若大于,说明此track对应的detection已经很久没出现过了,可能是目标离开了画面,则删除此track。若小于,则和匹配上的tracks一起,进入下一次迭代,这样做是当目标被短暂遮挡,几帧后又再次出现的情况时,track还能找到对应的detection。

45.本发明实施例的车站清客方法,通过对仍未匹配的目标检测框,创建对应的临时追踪器,可避免目标被短暂遮挡,几帧后又再次出现时被遗漏的情况。

46.在一个实施例中,所述根据所述目标对象位置的追踪结果,确定所述一类区域的目标对象的进出人数,包括:将每个追踪器固定位置作为撞线点,并根据通行方向将图像划分为内部区域和外部区域;当检测到某个追踪器的撞线点由外部区域进入内部区域,则进入人数加一,当检测到某个追踪器的撞线点由内部区域进入外部区域,则离开人数加一;根据进入人数和离开人数,确定所述一类区域的目标对象的进出人数。

47.图3是本发明提供的双向碰撞检测示意图,如图3所示,在上一步目标追踪获取许多追踪器tracks后,在每个track边缘固定的某点绘制撞线点。根据通行方向将图像上绘制两组区域,称上方的为内部区域,下方的为外部区域,作为判断进出的撞线。

48.当track的撞线点撞到内部区域时,在内部区域中加入此track的id(id2),判断此id是否曾出现在外部区域中,若有,说明此track曾经经过外部区域,即是从外部区域往内部区域走的,上行人数+1。

49.当track的撞线点撞到外部区域时,在外部区域中加入此track的id(id1),判断此id是否曾出现在内部区域中,若有,说明此track曾经经过内部区域,即是从内部区域往外部区域走的,下行人数+1。

50.可选地,将预设时长没出现在两个区域中的id删除,加快效率。

51.本发明实施例的车站清客方法,通过对追踪器的撞线点由外部区域进入内部区域以及外部区域进入内部区域的双向碰撞检测,可实现进出人数的准确统计,提高特殊区域的清客效率。

52.在一个实施例中,所述方法还包括:获取二类区域的图像,将每个二类区域的图像输入训练后的第二目标检测模型,输出二类区域图像中的乘客识别结果;根据所述一类区域的目标对象的进出人数中的进出乘客数,和二类区域的乘客识别结果,确定是否完成清客;其中,所述第二目标检测模型,根据带有乘客和工作人员标签的二类区域样本图像训练后得到;所述二类区域为一类区域以外的其他区域。

53.图4是本发明提供的车站清客方法的流程示意图之三,若上述一类区域的目标对象仅为乘客,则根据一类区域的目标对象的进出人数,直接确定一类区域(特殊区域)是否有乘客滞留,同时根据二类区域(常规区域)的乘客检测结果,确定二类区域是否有乘客滞留,若均没有,则允许闭站清客。其中,二类区域是指车站站台、站厅、通道、出入口等摄像头可以正常监控的部分。

54.对于常规区域的检测,可通过训练深度学习目标检测模型(为了与后文中的一类区域的目标检测模型进行区分,称为第二目标检测模型),如centernet、efficientnet、fasterrcnn、yolo系列等,对输入的图片进行识别,分别将乘客和工作人员框选出来,具体流程如下:

55.使用bbox-label-tool等标注工具对摄像头图片进行标注,对于乘客,采取头肩标注或半身标注,将标签设为乘客,对于清站人员、警务人员、清洁人员等地铁工作人员,采取半身标注,将标签设为工作人员。标注框需要完整框选工作服上半身,作为与乘客的区分特征。

56.将标注好的数据按照一定的比例分成训练集和测试集,如将80%的数据设为训练集,20%的数据设为测试集,交由模型训练和测试,得到训练好的模型权重。

57.在使用时,模型初始化加载训练好的权重,使用opencv等图像处理库从地铁常规

区域摄像头中逐帧获取图像,并记录该摄像头的位置信息。将图像传入模型,模型会输出对该张图片的检测结果,一般包含许多检测框的中心点坐标和宽高,以及它们对应的标签。根据之前标注的数据集,标签会是乘客和工作人员。

58.输出检测结果,若在上述流程中模型的输出结果包含乘客标签,则将记录的摄像头位置信息与“不允许闭站”一起作为常规区域的检测结果输出。若无乘客标签,则将“允许闭站”作为常规区域的检测结果输出。

59.本发明的车站清客方法,通过常规区域和特殊区域相结合的基于机器学习的目标识别,能够对整个车站的乘客滞留情况进行及时判断,从而提高了整个车站的清客效率。

60.在一个实施例中,所述获取一类区域出入口的每帧图像,并确定每帧图像中所有目标对象的检测框,包括:将一类区域出入口的每帧图像,分别输入训练后的第一目标检测模型,输出每帧图像的目标对象的检测框;其中,所述第一目标检测模型,根据带有不同目标对象标签的一类区域样本图像训练后得到。

61.对于一类区域,也就是特殊区域的目标对象的检测,可基于上述第二目标检测模型相同的检测模型进行相应训练后得到,为了区分,称用于一类区域检测的模型为第一目标检测模型。训练深度学习目标检测模型,如centernet、efficientnet、fasterrcnn、yolo系列等。具体训练及检测步骤见常规区域检测相关步骤。根据实际情况选择训练区分乘客和工作人员或是不进行区分的模型。

62.本发明实施例的车站清客方法,对于一类区域,也就是特殊区域,通过基于机器学习的目标检测模型确定检测框,可提高目标对象的识别效率,为目标追踪模型提供数据支持。

63.下面对本发明提供的车站清客装置进行描述,下文描述的车站清客装置与上文描述的车站清客方法可相互对应参照。

64.图5是本发明提供的车站清客装置的结构示意图,如图5所示,该车站清客装置包括:采集模块501、追踪模块502和处理模块503。其中,采集模块501用于获取一类区域出入口的每帧图像,并确定每帧图像中所有目标对象的检测框;追踪模块502用于将每帧图像的检测框输入预设的目标追踪模型,生成每帧图像的每个检测框对应的追踪器,并根据每帧图像的追踪器,对所述检测框对应的目标对象的位置进行追踪;处理模块503用于根据所述目标对象位置的追踪结果,确定所述一类区域的目标对象的进出人数;其中,所述一类区域为无法拍摄内部图像的区域。

65.在一个实施例中,所述追踪模块502具体用于:对于第二帧以及之后的每个当前帧图像,根据时间上最近图像帧生成的追踪器与目标对象的检测框进行匹配;并且重复对未匹配的检测框,使用次近帧图像生成的追踪器进行匹配的过程,直至到达最早帧图像生成的追踪器;根据匹配上的追踪器确定目标对象检测框的当前帧位置信息,根据所述当前帧位置信息,确定当前帧图像目标对象检测框对应的追踪器。

66.在一个实施例中,所述追踪模块502还用于,在直至到达最早帧图像生成的追踪器之后:对于还未匹配的目标对象检测框,根据交并比iou进行二次匹配,并确定位置变化最小帧对应的追踪器;根据位置变化最小帧对应的追踪器,确定目标对象检测框的当前帧追踪器。

67.在一个实施例中,所述追踪模块502还用于,在根据位置变化最小的追踪器,确定

目标对象检测框的位置信息之后:对于仍未匹配的目标检测框,创建对应的临时追踪器;在后续图像帧中,若所述临时追踪器只出现一次,则在预设时长后将所述临时追踪器删除;若所述临时追踪器在图像帧中出现多次,但匹配失败时长大于预设周期,则将所述临时追踪器删除。

68.在一个实施例中,处理模块503具体用于:将每个追踪器固定位置作为撞线点,并根据通行方向将图像划分为内部区域和外部区域;当检测到某个追踪器的撞线点由外部区域进入内部区域,则进入人数加一,当检测到某个追踪器的撞线点由内部区域进入外部区域,则离开人数加一;根据进入人数和离开人数,确定所述一类区域的目标对象的进出人数。

69.在一个实施例中,所述装置还包括第二处理模块,用于:获取二类区域的图像,将每个二类区域的图像输入训练后的第二目标检测模型,输出二类区域图像中的乘客识别结果;根据所述一类区域的目标对象的进出人数中的进出乘客数,和二类区域的乘客识别结果,确定是否完成清客;其中,所述第二目标检测模型,根据带有乘客和工作人员标签的二类区域样本图像训练后得到;所述二类区域为一类区域以外的其他区域。

70.在一个实施例中,所述采集模块501具体用于:将一类区域出入口的每帧图像,分别输入训练后的第一目标检测模型,输出每帧图像的目标对象的检测框;其中,所述第一目标检测模型,根据带有不同目标对象标签的一类区域样本图像训练后得到。

71.本发明实施例提供的装置实施例是为了实现上述各方法实施例的,具体流程和详细内容请参照上述方法实施例,此处不再赘述。

72.本发明实施例所提供的车站清客装置,其实现原理及产生的技术效果和前述车站清客方法实施例相同,为简要描述,车站清客装置实施例部分未提及之处,可参考前述车站清客方法实施例中相应内容。

73.图6是本发明提供的电子设备的结构示意图,如图6所示,该电子设备可以包括:处理器(processor)601、通信接口(communications interface)602、存储器(memory)603和通信总线604,其中,处理器601,通信接口602,存储器603通过通信总线604完成相互间的通信。处理器601可以调用存储器603中的逻辑指令,以执行车站清客方法,该方法包括:获取一类区域出入口的每帧图像,并确定每帧图像中所有目标对象的检测框;将每帧图像的检测框输入预设的目标追踪模型,生成每帧图像的每个检测框对应的追踪器,并根据每帧图像的追踪器,对所述检测框对应的目标对象的位置进行追踪;根据所述目标对象位置的追踪结果,确定所述一类区域的目标对象的进出人数;其中,所述一类区域为无法拍摄内部图像的区域。

74.此外,上述的存储器603中的逻辑指令可以通过软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本发明的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本发明各个实施例所述方法的全部或部分步骤。而前述的存储介质包括:u盘、移动硬盘、只读存储器(rom,read-only memory)、随机存取存储器(ram,random access memory)、磁碟或者光盘等各种可以存储程序代码的介质。

75.又一方面,本发明还提供一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现以执行上述各方法提供的车站清客方法,该方法包括:获取一类区域出入口的每帧图像,并确定每帧图像中所有目标对象的检测框;将每帧图像的检测框输入预设的目标追踪模型,生成每帧图像的每个检测框对应的追踪器,并根据每帧图像的追踪器,对所述检测框对应的目标对象的位置进行追踪;根据所述目标对象位置的追踪结果,确定所述一类区域的目标对象的进出人数;其中,所述一类区域为无法拍摄内部图像的区域。

76.以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。本领域普通技术人员在不付出创造性的劳动的情况下,即可以理解并实施。

77.通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到各实施方式可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,如rom/ram、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行各个实施例或者实施例的某些部分所述的方法。

78.最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1