一种基于虚拟现实桌面手势交互系统

1.本技术涉及虚拟现实技术领域,尤其涉及一种基于虚拟现实桌面手势交互系统。

背景技术:

2.以空中手势交互技术为主的自然手势交互技术是虚拟现实中最常用的交互技术之一,其以人的肢体运动作为输入通道贴合人在现实世界的行为习惯,可以有效促进虚拟环境和现实环境融合,保持虚拟现实人机交互过程中的沉浸感。然而,在长时间空中手势交互过程中,用户手臂长期处于不良体位带来的静肌负荷最终造成手部疲劳不适,降低了交互绩效。针对以空中手势交互为主的交互方式所存在的交互疲劳问题,研究者开始探索基于桌面环境的手势交互技术。但这些桌面手势交互技术基本基于具有较强侵入性的可穿戴设备和物理控制器,尚未出现基于自然裸手交互的桌面手势交互技术。

3.伴随着人工智能发展,计算机视觉技术凭借成本低、效果好等特点被广泛应用于自然手势识别领域。然而,计算机视觉技术容易受到外界环境干扰,在复杂的桌面手势交互环境下,提高计算机视觉的准确率是桌面手势交互技术需要解决的首要问题。

4.此外,桌面手势交互环境的交互区域较小。通常集中在显示器前的桌面空间之内,在这样的桌面虚拟现实环境下很难实现真实的交互体验,研究者对于在有限的交互区域下扩展可交互空间范围做了许多尝试。poupyrev等提出在虚拟现实环境下非线性映射的go-go技术,当用户手臂伸展到最远并停留时,虚拟手以一定加速度快速向远处延伸,从而将虚拟手扩展到用户无法触及的范围(poupyrev i,billinghurst m,weghorst s,et al.the go-go interaction technique:non-linear mapping for direct manipulation in vr[c]//proceedings of the 9th annual acm symposium on user interface software and technology.1996:79-80.);stoakley等提出微型世界(wim)技术,用户手持一个和交互空间等比例映射的微小模型,通过控制微小模型上的变换来控制整个交互空间(stoakley r,conway m j,pausch r.virtual reality on a wim:interactive worlds in miniature[c]//proceedings of the sigchi conference on human factors in computing systems.1995:265-272.);pierce等提出一种类似wim的voodoo doll技术,用户通过控制可触及范围内的巫毒娃娃来控制远处与娃娃绑定的虚拟对象(pierce js,stearns b c,pausch r.voodoo dolls:seamless interaction at multiple scales in virtual environments[c]//proceedings of the 1999symposium on interactive3d graphics.1999:141-145.);thanyadit等提出一种镜像隐喻的方式(thanyadit s,pong t c.desktop vr using a mirror metaphor for natural user interface[c]//proceedings of the 2017acm international conference on interactive surfaces and spaces.2017:92-99.),在桌面虚拟现实环境中模拟一面具有镜像属性的物理立体屏幕,用户的虚拟手可在镜像内的虚拟环境和镜像外的虚拟环境之间自由切换,镜像隐喻的存在使用户可交互空间扩大了一倍。然而,这些尝试大都基于有限的空中手势交互区域开展,如何更好的实现桌面手势交互亟需解决。

技术实现要素:

[0005]

本技术提供了一种基于虚拟现实桌面手势交互系统,其技术目的是缩小用户在与虚拟环境交互过程中的交互动作幅度,贴合人体生物力学性能,降低交互疲劳,提高交互效率;同时简化桌面手势交互系统的硬件结构,缩小硬件体积,确保硬件系统可随身携带。

[0006]

本技术的上述技术目的是通过以下技术方案得以实现的:

[0007]

一种基于虚拟现实桌面手势交互系统,包括硬件系统和软件系统,所述硬件系统包括红外激光投射模块和红外图像捕获模块,所述软件系统包括识别模块、校正模块和交互模块;

[0008]

所述红外激光投射模块通过红外激光头对桌面手势交互环境进行构建;

[0009]

所述红外图像捕获模块通过红外摄像机镜头对桌面手势交互图像进行捕获;

[0010]

所述识别模块通过桌面手势识别算法对桌面手势交互图像进行识别;

[0011]

所述校正模块识别的桌面手势交互图像进行校正;

[0012]

所述交互模块根据校正后的桌面手势交互图像完成虚拟现实响应。

[0013]

进一步地,所述硬件系统还包括摄像机前盖、cmos图像传感器、调整转轴上盖、摄像机后盖、壳体后盖、降压模块、type-c电源口、壳体底盖和壳体前盖,所述壳体后盖、所述壳体底盖和所述壳体前盖组成壳体,所述红外激光头设在所述壳体前盖底部,所述摄像机前盖设在所述壳体前盖顶部,所述红外摄像机镜头设在所述摄像机前盖中,所述摄像机后盖设在所述壳体后盖顶部,所述摄像机后盖顶部设有所述调整转轴上盖,所述cmos图像传感器设在所述摄像机前盖与所述摄像机后盖之间且与所述红外摄像机镜头连接,所述降压模块设在所述壳体前盖和所述壳体后盖之间且与所述cmos图像传感器连接,所述type-c电源口设在所述壳体底盖上且与所述红外摄像机镜头连接。

[0014]

进一步地,所述红外激光头为一字型激光头,激光头直径为6mm,激光头长度为13mm,发散角度为120

°

,激光波长为980nm;

[0015]

所述红外摄像机镜头的镜头广角为120

°

,镜头滤光片为980nm滤光片。

[0016]

进一步地,所述识别模块通过桌面手势识别算法进行桌面手势识别,所述桌面手势识别算法包括:

[0017]

对所述红外图像捕获模块捕获的桌面手势交互图像进行灰度化和二值化处理,得到第一桌面手势交互图像;

[0018]

将第一桌面手势交互图像的第一帧作为背景帧,通过背景帧去除桌面环境产生的静态干扰,得到第二桌面手势交互图像;

[0019]

对第二桌面手势交互图像中的手指特征进行提取,将手指特征与其余噪点分离开,消除动态干扰;

[0020]

对第二桌面手势交互图像中的手指轮廓进行提取;

[0021]

对手指轮廓的手势信息进行记录,手势信息包括手指轮廓数量、手指轮廓中心点坐标、手指轮廓面积和当前时间点;

[0022]

对手势状态进行判断,完成桌面手势识别,得到手势识别图像;其中,手势状态包括手指滑移、手指单击、手指双击和手指长按。

[0023]

进一步地,所述校正模块通过桌面图像畸变校正算法对桌面手势交互图像进行校正,包括:

[0024]

对手势识别图像的像素坐标进行坐标转换,将像素坐标转换为世界坐标,以消除图像畸变,得到校正后的手势识别图像。

[0025]

进一步地,所述交互模块通过虚拟现实桌面手势交互方法完成虚拟现实响应,所述虚拟现实桌面手势交互方法包括物理射线交互方法和图形射线交互方法,所述物理射线交互方法包括:

[0026]

桌面单根手指进行滑移,捕获手指滑移图像;

[0027]

对手指滑移图像进行识别和校正,获取手指滑移速度;

[0028]

虚拟现实系统发出物理射线,物理射线光标默认位于视野中心,物理射线移动角度跟随手指移动速度变化而变化;

[0029]

物理射线与三维物体进行碰撞,虚拟现实系统自动储存碰撞得到的三维物体碰撞信息;其中,所述三维物体碰撞信息包括三维物体名称、图层和碰撞点世界坐标;

[0030]

通过三维物体碰撞信息获取交互事件触发手势;

[0031]

根据所述交互事件触发手势触发交互事件;

[0032]

所述图形射线交互方法包括:

[0033]

桌面单根手指进行滑移,捕获手指滑移图像;

[0034]

对手指滑移图像进行识别和校正,获取手指滑移速度;

[0035]

虚拟现实系统发出图形射线,图形射线光标默认位于视野中心,图形射线移动角度跟随手指移动速度变化而变化;

[0036]

图形射线仅与虚拟现实场景中的ui控件进行碰撞,虚拟现实系统自动储存碰撞得到的ui控件碰撞信息;其中,所述ui控件碰撞信息包括ui控件名称、数量和碰撞点世界坐标;所述ui控件包括按钮、滚动条、下拉菜单和框选条;

[0037]

通过ui控件碰撞信息获取虚拟现实交互事件触发手势;

[0038]

根据所述虚拟现实交互事件触发手势触发虚拟现实交互事件。

[0039]

本技术的有益效果在于:本技术提出的基于虚拟现实桌面手势交互系统大幅提升虚拟现实交互技术可用性,其具体表现为:缩小用户在与虚拟环境交互过程中的交互动作幅度,贴合人体生物力学性能,降低交互疲劳,提高交互效率;简化硬件结构,缩小硬件体积,确保硬件系统可随身携带;桌面手势交互作为独立的交互系统并不干涉其他手势交互方式(空中手势交互、虚拟手接触点击交互等),具有良好的技术兼容性。同时,基于计算机视觉技术的桌面手势识别算法通过对桌面图像干扰针对性分类处理,大幅提升手势识别准确率。

附图说明

[0040]

图1为本技术所述交互系统的框架图;

[0041]

图2为硬件系统的结构示意图;

[0042]

图3为硬件系统的爆炸图;

[0043]

图4为硬件系统的电路图;

[0044]

图5为桌面手势识别算法的流程图;

[0045]

图6为物理射线交互方法的流程图;

[0046]

图7为图像射线交互方法的流程图;

[0047]

图中:1-红外摄像机镜头;2-摄像机前盖;3-cmos图像传感器;4-调整转轴上盖;5-摄像机后盖;6-壳体后盖;7-降压模块;8-type-c电源口;9-壳体底盖;10-壳体前盖;11-红外激光头。

具体实施方式

[0048]

下面将结合附图对本技术技术方案进行详细说明。

[0049]

本技术所述的基于虚拟现实桌面手势交互系统,包括硬件系统和软件系统,如图1所示。

[0050]

虚拟现实桌面手势交互系统的硬件系统基于红外激光投影原理,包括红外激光投射模块和红外图像捕获模块两大部分,如图2和图3所示。

[0051]

红外激光投射模块包括红外激光头,红外图像捕获模块包括红外摄像机镜头。该硬件系统还包括摄像机前盖、cmos图像传感器、调整转轴上盖、摄像机后盖、壳体后盖、降压模块、type-c电源口、壳体底盖和壳体前盖,所述壳体后盖、所述壳体底盖和所述壳体前盖组成壳体,所述红外激光头设在所述壳体前盖底部,所述摄像机前盖设在所述壳体前盖顶部,所述红外摄像机镜头设在所述摄像机前盖中,所述摄像机后盖设在所述壳体后盖顶部,所述摄像机后盖顶部设有所述调整转轴上盖,所述cmos图像传感器设在所述摄像机前盖与所述摄像机后盖之间且与所述红外摄像机镜头连接,所述降压模块设在所述壳体前盖和所述壳体后盖之间且与所述cmos图像传感器连接,所述type-c电源口设在所述壳体底盖上且与所述红外摄像机镜头连接。

[0052]

具体地,红外激光投射模块的红外激光头以980nm红外一字型激光头为主体,负责投射平行桌面的红外激光层,构建桌面手势交互环境。当用户手指侵入红外激光层与桌面接触时,用户手指因反射红外光线而被红外图像捕获模块捕获,并作为手势信息用于后续手势交互算法中。此外,980nm长波具有强衍射能力,能够显著提高手势识别的准确性。

[0053]

红外图像捕获模块的红外摄像机镜头以980nm红外数字摄像头为主体,负责捕获桌面手势交互图像,为后续计算机视觉图像处理、桌面手势识别提供桌面图像信息。该模块通过cmos图像传感器将桌面图像光信号转换为电信号,以保证捕获桌面图像高分辨率、高帧率、低延迟,同时保证硬件系统高效率、低功耗、低成本。相比于传统ccd图像传感器,cmos图像传感器将图像传感部分和控制电路高度集成在同一芯片里,体积明显减小、功耗也大大降低,满足了对高度小型化、低功耗成像系统的要求,具有集成度高、控制简单、价格低廉等诸多优点。

[0054]

整个硬件系统的电路图如图4所示,硬件系统统一的供电方式保证硬件系统即插即用,以降低系统使用难度,简化交互设备适配过程。其中,红外图像捕获模块由type-c电源口直接供电,并通过type-c数据线将捕获到的桌面图像传递给计算机;红外激光投射模块由type-c电源口、降压模块降压后完成供电。

[0055]

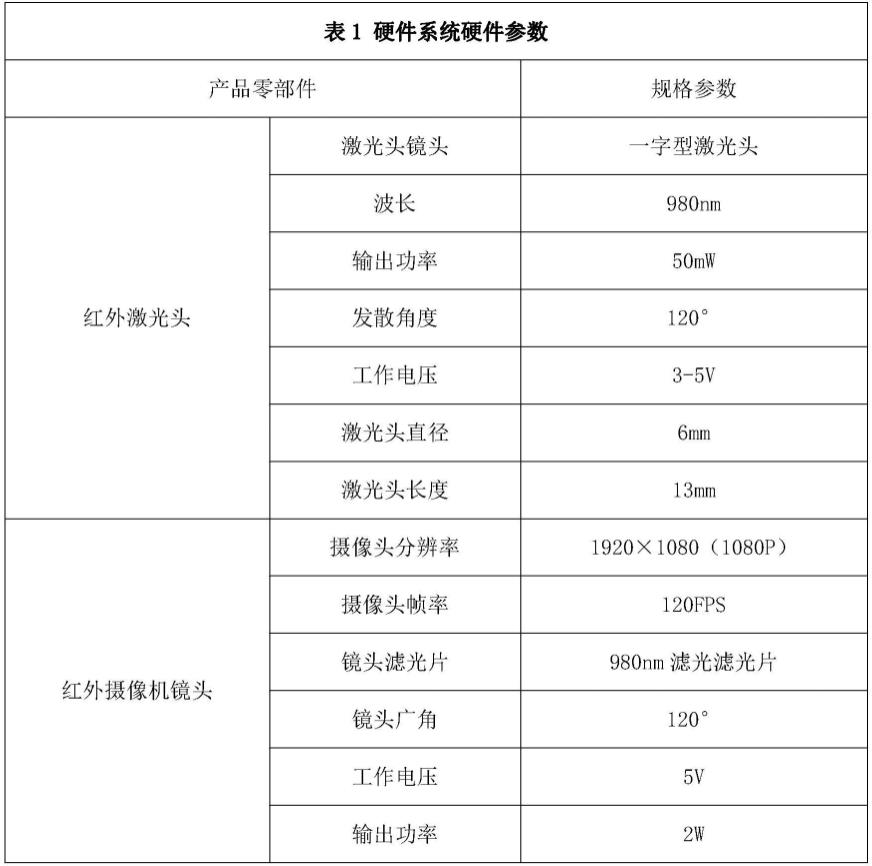

作为具体实施例地,硬件系统的具体参数如表1所示:

[0056][0057]

虚拟现实桌面手势交互的软件系统负责处理桌面手势交互硬件系统采集到的桌面图像,利用计算机视觉技术识别桌面手势,并完成与虚拟现实系统的交互功能。软件系统包括识别模块、校正模块和交互模块,识别模块通过桌面手势识别算法对桌面手势交互图像进行识别;校正模块识别的桌面手势交互图像进行校正;交互模块根据校正后的桌面手势交互图像完成虚拟现实响应。

[0058]

基于计算机视觉技术的桌面手势识别算法流程如图5所示。本算法需要克服复杂桌面环境中的噪音干扰,根据各干扰、图像噪声的运动状态,可以将干扰分为动态干扰和静态干扰。桌面上杂物遮挡所产生的图像光点属于静态干扰,桌面手势识别算法以摄像头捕获到的第一帧图像作为背景帧,通过当前帧与背景帧做差即背景剔除的方法去除图像中的静态干扰。用户肢体在移动过程中手臂等部位与桌面接触所产生的图像光点属于动态干扰,相对于静态干扰,动态干扰引入时间变量并且具有较高随机性,排除难度加大。桌面手势识别算法通过提取用户手指特征,包含手指轮廓面积大小、手指轮廓外接矩形长宽比、手指轮廓与轮廓外接圆面积比等,剔除不满足手指特征的图像噪点,留下目标手指轮廓,从而去除图像动态干扰。

[0059]

基于计算机视觉技术的桌面手势识别算法的一般过程为:

[0060]

(1)对红外图像捕获模块捕获的原始图像进行图像处理:灰度化、二值化;

[0061]

(2)将第一帧作为背景帧,采用背景剔除方法去除桌面环境因杂物遮挡等因素产生的静态干扰;

[0062]

(3)提取手势交互点特征(即手指特征),将手指特征与其余噪点分离开,消除因用户肢体在桌面运动产生的动态干扰;

[0063]

(4)提取手势交互点轮廓(即手指轮廓);

[0064]

(5)记录手势交互点手势信息(即手指手势信息):手指轮廓数量、手指轮廓中心点坐标、手指轮廓面积及当前时间点等;

[0065]

(6)判断桌面手势状态(例如手指滑移、手指单击、手指双击、手指长按),完成桌面手势识别。在完成桌面手势判断后,将以0.5s前的手势交互点手势信息为准触发交互事件,防止手指双击等手势因手指位置第二次点击与先前不一致所导致的交互偏差。

[0066]

由于摄像头倾斜、广角等因素,基于计算机视觉技术的桌面手势识别算法获取的桌面手势交互点信息是存在畸变的,手指在图像中移动的方位与手指在现实中移动的方位并不完全线性对应。桌面图像畸变校正算法根据摄像头的成像原理,将上述基于计算机视觉技术的桌面手势识别算法提取出的手指轮廓中心点坐标(u,v)与手指在现实桌面世界坐标系中的实际位置(x

ω

,y

ω

,0)建立映射转换关系。其具体转换过程如下:

[0067]

(1)像素坐标系转换到图像坐标系:

[0068]

上述基于计算机视觉技术的桌面手势识别算法可获取到手指轮廓中心点在像素坐标系下的像素坐标(u,v),该坐标系以图像左上角为原点,水平方向为u轴,竖直方向为v轴,单位为像素;

[0069]

图像坐标系o-xy是表征物像在图像中实际距离的坐标系,该坐标系以图像中心为原点,水平方向为x轴,竖直方向为y轴,单位为mm;

[0070]

手指轮廓中心点像素坐标(u,v)与其在相机成像平面上的图像物理坐标(x,y)之间的坐标关系为:

[0071][0072]

其中:为物理单位转换成像素单位的比例因子,(u0,v0)为整个图像中心点在像素坐标系中的像素坐标。

[0073]

(2)图像坐标系转换到相机坐标系:

[0074]

相机坐标系o

c-xcyczc是表征现实中的目标点相对于相机光心位置关系的坐标系,其原点为相机光心,z轴为相机光轴;

[0075]

手指轮廓中心在相机成像平面上的图像物理坐标(x,y)与手指在相机坐标系中的三维坐标(xc,yc,zc)之间的的坐标关系:

[0076][0077]

其中:f表示相机焦距。

[0078]

(3)相机坐标系转换到世界坐标系:

[0079]

世界坐标系o

ω-x

ωyωzω

是表征目标点在现实中实际位置的坐标系;桌面图像畸变校正算法以激光头出射点为坐标系原点,激光头出射方向为y轴,垂直激光头出射方向为x轴,高度方向为z轴,由于手指交互点始终在桌面上,z

ω

=0;

[0080]

手指在相机坐标系中的三维坐标(xc,yc,zc)与手指在现实中的世界坐标系三维坐标(x

ω

,y

ω

,0)之间的坐标关系:

[0081][0082]

其中,r表示旋转矩阵,表示为:

[0083][0084]

t表示平移矩阵,表示为:

[0085][0086]

(4)建立像素坐标系坐标点(u,v)与世界坐标系(x

ω

,y

ω

,0)的转换关系:

[0087][0088]

其中,

[0089]

表示相机内参,可通过棋盘格标定方法求解;

[0090]

表示相机外参,桌面图像畸变校正算法中,由红外摄像机方位与红外激光头方位求解;

[0091]

zc=r

20

xw+r

21yw

+t2,与xw、yw值相关;

[0092]

在已知相机内参与相机外参的情况下,桌面图像畸变校正算法可通过输入手指交互点的像素坐标(u,v),输出手指交互点在现实中的世界坐标(x

ω

,y

ω

,0),以求得手指交互点在桌面上的实际位置,消除图像畸变。

[0093]

完成上述桌面手势识别及图像畸变校正后,需根据桌面手势输入完成虚拟现实系统响应,本技术提出了一种基于射线隐喻的虚拟现实桌面手势交互方法,可通过用户单根手指移动速度调控桌面手势系统控制显示比(c/d比),该桌面手势交互方法包括基于物理

射线和图像射线这两类。

[0094]

如图6所示,基于物理射线的交互方法利用unity3d的物理引擎,从用户眼中心投射出一条带有碰撞体属性的物理射线,射线光标默认位于视野中心,射线移动角度、方向将随用户在桌面上的单根手指在桌面上的滑移速度大小、方向变化而变化,射线交互事件由用户手势(快速单击、快速双击等)触发。当物理射线与其他具有碰撞体属性的三维物体碰撞时,将碰撞到的三维物体碰撞信息(三维物体名称、图层、碰撞点世界坐标等)储存在交互系统中。通过向碰撞结果添加交互响应事件即可完成“桌面手势输入-虚拟现实系统响应”的基本交互单元。

[0095]

上述物理射线方法适用于具有碰撞体属性的三维物体交互,和物理射线发射形式一样,物理射线可以识别和任何带有碰撞体熟悉的物体碰撞。也就是说,物理射线可以识别照射到所有虚拟物体。

[0096]

如图7所示,基于图形射线的交互方法利用unity3d引擎中的交互事件系统,从用户眼中心投射出一条图形射线,射线光标默认位于视野中心,射线移动角度、方向随用户在桌面上的单根手指滑移速度大小、方向变化而变化,射线交互事件同样由用户手势(快速单击、快速双击等)触发。当图形射线与虚拟现实ui控件碰撞时,将碰撞到的ui控件碰撞信息(ui控件名称、数量、碰撞点世界坐标等)储存在交互系统中。图形射线方法直接作用于虚拟现实交互系统,可直接在各ui控件中添加触发事件即可完成“桌面手势输入-虚拟现实系统响应”的基本交互单元。

[0097]

该图形射线方法适用于虚拟现实的ui控件交互,可识别虚拟现实里的ui组件(按钮,滚动条,下拉菜单,框选条等)碰撞。图形射线只能识别照射到特定虚拟物体。

[0098]

上述系统亦能够应用到增强现实和混合现实中。

[0099]

以上为本技术示范性实施例,本技术的保护范围由权利要求书及其等效物限定。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1