一种卷积神经网络拟合Tikhonov正则化分解的图像增强方法与流程

一种卷积神经网络拟合tikhonov正则化分解的图像增强方法

技术领域

1.本发明涉及一种图像高低频分解技术,具体涉及一种卷积神经网络拟合tikhonov正则化分解的图像增强方法,属于图像处理技术领域。

背景技术:

2.图像高低频分解技术在现在的计算机视觉领域变得越来越重要,图像的分解可以从大量的复杂背景中得到感兴趣的区域进行处理,降低了计算机处理的时间和运算的计算量;tikhonv正则化通过近似的方法来逼近一个不适定的问题,在此基础上,通过将图像的灰度跳变区域变化为一阶导数的形式,将tikhonv正则化应用于图像的分解中,相对于小波变化和低秩分解,其具有较强的抗噪能力,能够更好的保持高频细节,可广泛应用于图像去噪、图像融合等方面;现有的tikhonv正则化分解方法主要通过函数方式实现,但是对于大尺寸、高分辨率图像,存在分解速度慢,计算量大等特点,给图像的实时处理带来难度;且由于利用函数实现的方式无法很好地和神经网络进行整合,组成端到端的网络,降低网络输入输出地复杂度,同时也会给网络梯度的回传带来一定的影响。因此现有的基于函数的分解方法迫切需要改进;此外对于图像增强技术,现有的图像锐化算法存在着增强效果较差、在增强的同时也会过分增强图像中噪声,无法很好地突出图像的边缘等细节部分,无法达到很好的增强效果。

技术实现要素:

3.为解决上述问题,本发明提出了一种卷积神经网络拟合tikhonov正则化分解的图像增强方法,采用泛化能力好,结构简单,计算量小的tikhonv正则化分解网络,用于拟合图像的tikhonv正则化分解,解决tikhonv正则化难以应用于端到端神经网络结构问题;同时将原图像和分解的高频分量进行融合输出达到很好锐化增强效果,同时防止传统增强方法在图像增强时过度增强噪声细节的劣势。

4.本发明的卷积神经网络拟合tikhonov正则化分解的图像增强方法,所述方法如下:在卷积神经网络的基础上,利用深度学习的方式,同时引入上采样层和特征融合的方法实现了分解增强网络,网络的输入是三通道或者单通道图像,通过特征提取网络进行下采样,提取图像中的特征,之后利用上采样层,恢复图像的特征,将恢复的特征进行融合,得到最终的分解图像,之后将分解的高频图像和原图像融合输出,得到最终的增强图像。

5.进一步地,所述方法具体如下:首先利用tikhonov正则化分解获取训练所需的图像对,之后利用sigmoid函数将分解的高频图像归一化到[0,1],用上述网络逼近原真值高频图,之后使用反sigmoid变换得到最终的分解高频结果,之后将该结果与原图像进行相加卷积得到最终的分解效果图和增强结果图。

[0006]

进一步地,所述方法如下:在vgg-16网络的基础上,利用迁移学习的方式,同时引入上采样层和特征融合的方法实现了分解网络,其具体为:将由正则化分解得到的高频图像经函数处理后融入到vgg-16网络中,得到网络分解的高频图像,再经反函数变化后得到

函数分解的高频图像,从而实现端到端的神经网络分解图像。

[0007]

进一步地,所述方法还通过改变tikhonov正则化分解的惩罚项系数重新训练网络得到不同的高频分解结果。

[0008]

与现有技术相比,本发明的卷积神经网络拟合tikhonov正则化分解的图像增强方法,采用泛化能力好,结构简单,计算量小的tikhonv正则化分解网络,用于拟合图像的tikhonv正则化分解,解决tikhonv正则化难以应用于端到端神经网络结构问题;同时将原图像和分解的高频分量进行融合输出达到很好锐化增强效果,同时防止传统增强方法在图像增强时过度增强噪声细节的劣势。

附图说明

[0009]

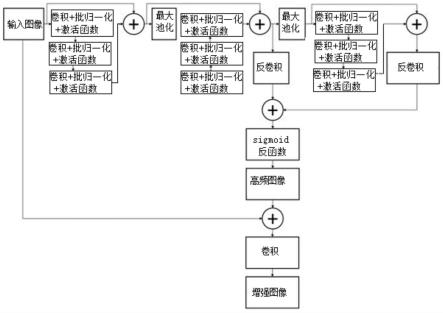

图1为本发明的拟合tikhonov正则化图像分解的神经网络结构示意图。

[0010]

图2为本发明的relu激活函数结构示意图。

[0011]

图3为本发明的惩罚项系数为0.5时,分解效果示意图。

[0012]

图4为本发明的惩罚项系数为0.1时,分解效果示意图。

[0013]

图5为本发明的增强效果与传统算法增强效果对比示意图。

[0014]

其中,a和c为输入图像,b为函数分解效果(高频部分)图像,d为网络分解效果(高频部分)图像;e为传统增强算法图像,f为网络增强图像。

具体实施方式

[0015]

如图1所示的卷积神经网络拟合tikhonov正则化分解的图像增强方法,所述方法如下:在卷积神经网络的基础上,利用深度学习的方式,同时引入上采样层和特征融合的方法实现了分解增强网络,网络的输入是三通道或者单通道图像,通过特征提取网络进行下采样,提取图像中的特征,之后利用上采样层,恢复图像的特征,将恢复的特征进行融合,得到最终的分解图像,之后将分解的高频图像和原图像融合输出,得到最终的增强图像。

[0016]

其中,所述方法具体如下:首先利用tikhonov正则化分解获取训练所需的图像对,之后利用sigmoid函数将分解的高频图像归一化到[0,1],即先进行批归一化处理,用上述网络逼近原真值高频图,之后使用反sigmoid变换得到最终的分解高频结果,之后将该结果与原图像进行相加卷积得到最终的分解效果图和增强结果图。

[0017]

所述方法如下:在vgg-16网络的基础上,利用迁移学习的方式,同时引入上采样层和特征融合的方法实现了分解网络,其具体为:将由正则化分解得到的高频图像经函数处理后融入到vgg-16网络中,得到网络分解的高频图像,再经反函数变化后得到函数分解的高频图像,从而实现端到端的神经网络分解图像。

[0018]

所述方法还通过改变tikhonov正则化分解的惩罚项系数重新训练网络得到不同的高频分解结果。

[0019]

实施例1:

[0020]

本发明的卷积神经网络拟合tikhonov正则化分解的图像增强方法,所述方法如下:

[0021]

训练阶段:

[0022]

网络训练使用的数据集是bsd中的500张图片,使用的是500张尺寸180

×

180的图

像,测试集使用的是set12和set68数据集,训练集和测试集完全分开;首先网络的输入是原始的图像和经过tikhonov正则化分解后的高频真值图像,以及经过增强处理的增强真值图像,其中tikhonov正则化的惩罚项系数设置为3;为了降低网络输入数据之间的均方差差异,将原始图像矩阵缩放到[0,1],同时为了降低网络训练拟合的难度,同时将标签图像(即经过tikhonov正则化函数分解的高频图像)利用sigmoid函数将输入缩放到[0,1],得到高低频分解图像,之后将输出高频分量图像和输入图像相结合卷积输出,得到最终的增强结果效果图;其具体结构如下:

[0023]

输入层:输入的为单通道或者三通道的图像,及其对应的高频图像和高频图像,

[0024]

第一阶段:两次卷积,kernel_size=3

×

3,stride=1,padding=1;

[0025]

第二阶段:最大池化层,降低输出特征图的尺寸,减少网络的参数量;

[0026]

第三阶段:两次卷积,kernel_size=3

×

3,stride=1,padding=1;

[0027]

第四阶段:最大池化层,进一步降低输出特征图的尺寸,减少网络的参数量;

[0028]

第五阶段:三次卷积,kernel_size=3

×

3,stride=1,padding=1进一步提取网络的深层次语义特征;

[0029]

第六阶段:分别将第二次池化操作前的特征图和特征提取网络的输出进行反卷积操作,生成对应的初步的分解图像,反卷积kernel_size=3

×

3,stride=1;

[0030]

第七阶段:将对应的分解高频图像和原图进行在通道上进行拼接;

[0031]

第八阶段:将初步的融合图像进行卷积,卷积的kernel_size=3

×

3,stride=1;

[0032]

输出层:将融合后的图像利用反sigmoid变换将输出的预测图像x变换到原始范围内图像y;对应公式为:如图2所示,上述网络的激活函数均采用relu激活函数,进一步简化网络了的运算速度,同时减小了网络梯度消失的问题;

[0033]

网络的损失函数使用的是均方差损失:

[0034][0035]

其中n代表训练样本的数量,img

pre

代表网络的输出值,img

real

表示经过函数得到的实际的分解图像,img

pre_enhance

表示网络预测的增强图像,img

realenhance

表示真实的增强图像;为了约束网络的各层输出的权重,得到较好的分解效果,将融合后的输出图像的损失系数设置为1,另外的三个系数α1,α2,α3分别表示网络的第3、6、10层输出经过反卷积得到的初步分解图和真是分解图像之间的损失系数,为了强调融合图像和深层特征图反卷积后的效果,将其分别设置为0.1、0.2、0.3;平衡融合高频图像和深层特征图反卷积后高频图像的效果,以及高频分解效果和增强效果之间的关系,得到较好的分解增强效果,将α1,α2,α3和β其分别设置为0.1、0.2、0.3和1。

[0036]

推理阶段:

[0037]

直接将待分解增强的图像送入到网络中,网络输出分解后的高频图像和增强图像,利用原图像和高频图像的差值得到低频图,实现了端到端的图像分解增强网络;如图3和图4所示,其分别将惩罚项系数为0.5时和惩罚项系数为0.1时,得到的分解效果示意图,能够实现端到端的神经网络分解图像,如图5所示,其为本技术输出的增强图像,与现有的增强算法输出的图像相比,明显具备更好的效果。

[0038]

上述实施例,仅是本发明的较佳实施方式,故凡依本发明专利申请范围所述的构

造、特征及原理所做的等效变化或修饰,均包括于本发明专利申请范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1